Scopri subito cosa è pubblicato da persone e cosa dall'IA su Twitter, LinkedIn, Substack e altre piattaforme. Scarica la nostra nuova estensione per Chrome.

Foto di Angel Bena.

Foto di Angel Bena.

La scorsa settimana, il Parlamento europeo ha approvato l'Artificial Intelligence Act (AI Act), un quadro normativo completo che gli Stati membri dell'UE dovranno seguire nella regolamentazione dei prodotti e dei servizi di intelligenza artificiale.

L'AI Act è inteso come normativa a tutela dei consumatori e adotta un "approccio basato sul rischio" nei confronti dei prodotti o servizi che utilizzano l'intelligenza artificiale: più un'applicazione di IA è rischiosa, maggiore è il controllo a cui è sottoposta. I livelli di rischio sono suddivisi in diverse categorie, tra cui:

- I sistemi di IA che utilizzano "tecniche subliminali, manipolative o ingannevoli per distorcere il comportamento e compromettere il processo decisionale informato" o che rappresentano un "chiaro rischio per i diritti umani fondamentali" saranno considerati "rischi inaccettabili" e saranno vietati.

- I sistemi di IA considerati "ad alto rischio", come quelli utilizzati nelle infrastrutture critiche, nell'istruzione, nella sanità, nelle forze dell'ordine, nella gestione delle frontiere o nelle elezioni, dovranno soddisfare requisiti rigorosi.

- I sistemi di IA per uso generico che non rientrano nelle categorie ad alto rischio saranno considerati a rischio limitato e soggetti a obblighi di trasparenza meno stringenti. Le applicazioni di IA generativa saranno considerate sistemi di IA per uso generico.

Sia i produttori (come Open AI/Google) che gli utenti (aziende che utilizzano tali applicazioni) saranno tenuti a superare test di accuratezza e trasparenza, in modo che gli utenti finali (consumatori) siano consapevoli di interagire con l'IA. Le aziende che non saranno in grado di soddisfare questi nuovi requisiti saranno soggette a multe fino a 35 milioni di euro o pari al 7% del loro fatturato annuo globale.

Cosa significa questo per le piattaforme online?

Qualsiasi azienda, indipendentemente dalla sua sede, che abbia utenti finali nell'UE e utilizzi sistemi di IA nei propri prodotti sarà soggetta alla legge sull'IA. Sebbene si tratti di un ambito di applicazione ampio e con alcune ambiguità, è chiaro che le piattaforme online che utilizzano o pubblicano contenuti di IA dovranno conformarsi a questi nuovi obblighi normativi.

Con l'aumento dei contenuti generati dall'intelligenza artificiale pubblicati su molte piattaforme di contenuti generati dagli utenti, la maggior parte dei siti online (ad esempio editori, marketplace e siti di social media) dovrà probabilmente implementare alcuni controlli di trasparenza e moderazione, tra cui:

- Rivelare se i contenuti generati o pubblicati sulla piattaforma sono stati creati dall'intelligenza artificiale.

- Progettare la piattaforma in modo da rifiutare i contributi illegali generati dall'intelligenza artificiale.

- Pubblicazione di sintesi dei dati protetti da copyright utilizzati per addestrare modelli interni.

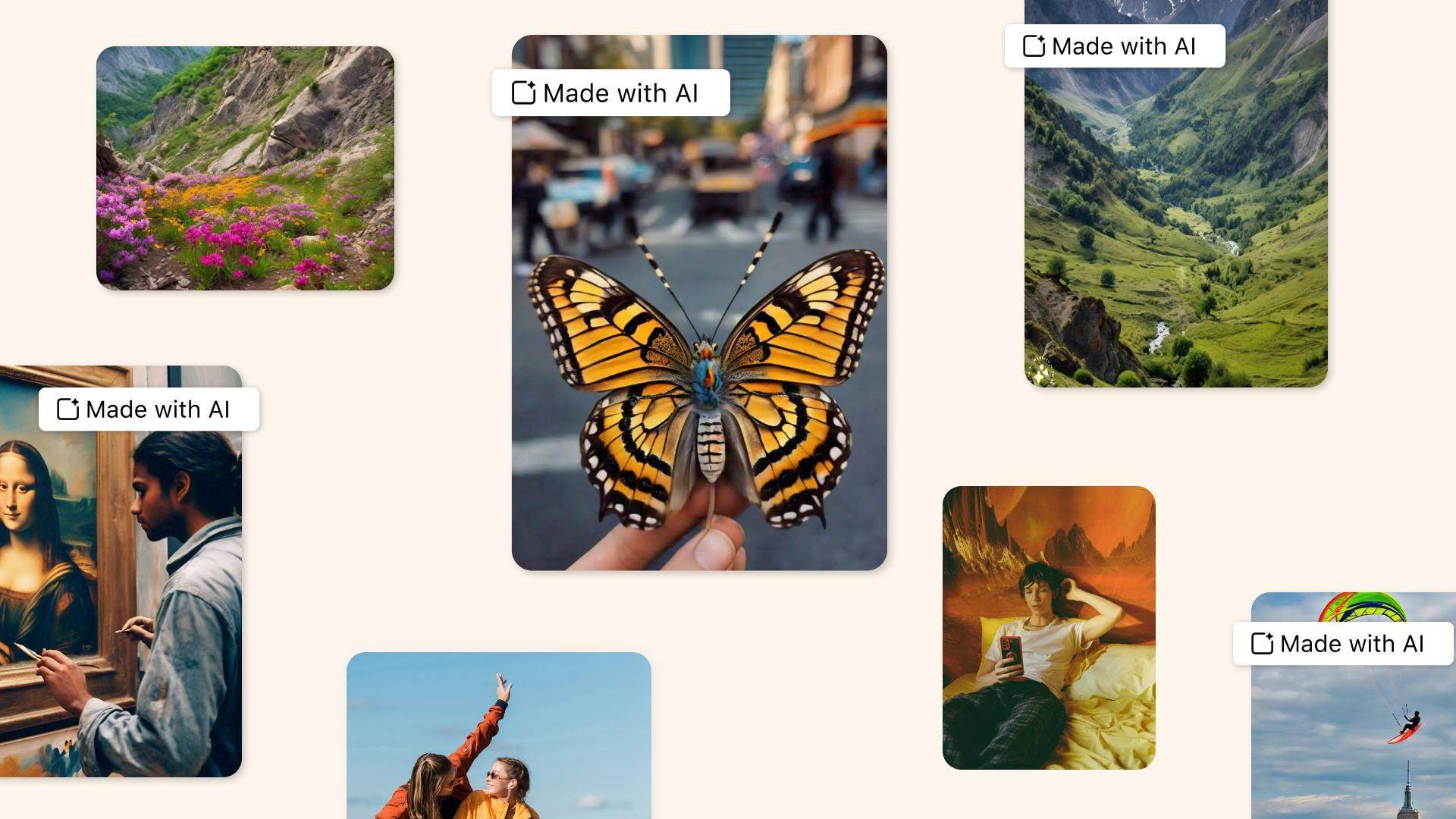

L'etichettatura e, per procura, l'individuazione dei contenuti generati dall'intelligenza artificiale saranno ora obbligatorie se tali contenuti vengono diffusi su piattaforme di contenuti. Ciò vale per qualsiasi forma di contenuto: testo, audio, immagini e video:

"I fornitori di sistemi di IA, compresi i sistemi di IA per uso generico, che generano contenuti audio, immagini, video o testi sintetici, devono garantire che i risultati del sistema di IA siano contrassegnati in un formato leggibile da una macchina e riconoscibili come generati o manipolati artificialmente."

Pur sostenendo l'intenzione legislativa dell'UE di promuovere sistemi di IA sicuri, riconosciamo anche che per le aziende potrebbe essere fonte di confusione interpretare e rispettare questa legge. Tali obblighi possono sembrare piuttosto ambigui e l'AI Act non specifica in modo dettagliato se i tipi di contenuti secondari (come le recensioni o i commenti degli utenti) siano soggetti a questi requisiti, né quali controlli di conformità le aziende dovranno integrare.

Come possono le aziende stare al passo con l'AI Act?

La buona notizia è che le aziende avranno tempo per sviluppare soluzioni che consentano la conformità. La legge dovrebbe entrare in vigore entro maggio e le sue disposizioni inizieranno ad avere effetto in più fasi, con molti dei requisiti di trasparenza che si applicheranno solo a partire da un anno da oggi.

Detto questo, riteniamo che ci siano alcune azioni che le aziende possono intraprendere fin da ora per prevenire l'applicazione della legge. In particolare, le aziende dovrebbero cercare di sviluppare:

- Linee guida chiare e governance relative ai contenuti generati dagli utenti.

- Flussi di lavoro più efficienti per la moderazione dei contenuti, al fine di identificare quelli generati dall'intelligenza artificiale.

- Automazioni per impedire la diffusione di contenuti generati dall'intelligenza artificiale.

Già ora vediamo alcune aziende prendere provvedimenti: alcune piattaforme come YouTube e Instagram chiedono agli utenti di segnalare autonomamente quando caricano contenuti "realistici" generati dall'IA. Non è chiaro se questo "sistema di fiducia" sarà sufficiente per conformarsi alla legge, ma è un segnale forte che i leader del settore stanno prendendo sul serio questa legislazione e la sicurezza dell'IA.

Noi di Pangram Labs stiamo lavorando alacremente per sviluppare i migliori sistemi di rilevamento basati sull'intelligenza artificiale, affinché le aziende possano gestire piattaforme online sicure e responsabili. Siamo incoraggiati dall'obiettivo dell'UE di garantire la trasparenza di Internet e non vediamo l'ora di collaborare con ricercatori e responsabili politici per definire questi importanti standard.

Vuoi metterti in contatto con noi? Inviaci un'e-mail all'indirizzo info@pangram.com!

Altre letture

Come gli studenti cercano di evitare il rilevamento dell'IA

Il rilevamento dell'intelligenza artificiale è appena migliorato notevolmente: annunciamo Checkfor.ai

Pangram è l'unico rilevatore di IA che supera gli esperti umani nell'identificazione dei contenuti generati dall'intelligenza artificiale.

Dichiarazione sull'ordine esecutivo di Biden sulla sicurezza dell'intelligenza artificiale

Vi presentiamo Open Pangram

Meta inizierà a identificare i contenuti generati dall'intelligenza artificiale

per ricevere i nostri aggiornamenti