Saiba imediatamente o que é publicado por pessoas e o que é gerado por IA no Twitter, LinkedIn, Substack e outras plataformas. Obtenha a nossa nova extensão para o Chrome.

Os profissionais de marketing estão desperdiçando gastos com publicidade em conteúdo gerado por IA

Foto de Tima Miroshnichenko.

Foto de Tima Miroshnichenko.

TL;DR

À medida que os LLMs se tornam mais sofisticados, os fraudadores e spammers perceberão a oportunidade de usar a IA generativa para expandir conteúdos inautênticos pela web com a intenção de roubar dinheiro de publicidade.

O Google já tomou medidas para rebaixar as publicações geradas por IA no seu algoritmo de pesquisa, mas as marcas e agências de publicidade precisam desenvolver soluções para identificar e filtrar o conteúdo gerado por IA antes que os seus anúncios sejam colocados indevidamente em conteúdo criado para publicidade.

Contexto

Em março, o Google anunciou que tomaria medidas significativas contra o aumento do conteúdo gerado por IA que aparece nos resultados de pesquisa dos utilizadores. Após a adoção generalizada dos LLMs em 2023, os malfeitores perceberam que poderiam produzir grandes volumes de conteúdo de baixa qualidade, repleto de palavras-chave, para manipular os algoritmos de classificação de pesquisa e melhorar a classificação dos seus sites. O Google classificou esse tipo de hacking de SEO como“abuso de conteúdo em escala”e alterou as suas políticas para reduzir a visibilidade desses sites nos resultados — ou pelo menos em 40%, como afirma o Google.

As marcas normalmente trabalham com agências digitais para gerir as suas campanhas publicitárias online. O conteúdo de marketing é vendido e distribuído de forma mais eficaz através da publicidade programática, permitindo que os anunciantes segmentem os utilizadores, colocando esses anúncios junto a conteúdos relevantes (conhecido como compra de inventário no site de um editor). Este processo permite que uma empresa de suplementos, por exemplo, coloque automaticamente o seu conteúdo de marketing junto a uma publicação num blogue de fitness ou num fórum de ioga.

Por que os anunciantes devem se preocupar com isso?

Os gastos programáticos, que ultrapassaram US$ 150 bilhões em 2023 apenas nos EUA, são um sistema vulnerável à manipulação. Os anunciantes já tiveram que lidar com fraudes publicitárias relacionadas a sites criados para publicidade (MFAs) — sites criados, geralmente com conteúdo de baixa qualidade ou plagiado, com a intenção de vender o máximo possível de espaço publicitário.

Exemplo de MFA (fonte - nonstopnostalgia.com)

As marcas premium vão descobrir que os seus anúncios às vezes aparecem nesses sites. Só no ano passado, 21% das impressões de anúncios numa amostra foram atribuídas a MFAs e 15% dos gastos com publicidade, ou cerca de US$ 13 bilhões, foram gastos nesses sites.

Os MFAs não são um problema novo, mas a IA está a tornar-se uma ferramenta fácil e acessível para os spammers criarem operações de produção de conteúdo com pouco esforço. Embora os LLMs não reduzam significativamente o custo da geração de conteúdo artificial, eles certamente aumentarão o volume desses sites, conforme inferido pelas reações recentes do Google.

Os fraudadores agora têm as ferramentas para expandir rapidamente sites de baixa qualidade em poucas horas e lucrar com gastos publicitários mal alocados. Num estudo realizado no ano passado, mais de 140 grandes marcas acabaram pagando por espaço publicitário nesses sites de conteúdo gerado por IA. Como os modelos e as ferramentas melhoraram ao longo do último ano, ficará cada vez mais fácil criar e publicar MFAs gerados por IA.

Como os anunciantes devem responder?

A lição mais importante para os anunciantes é reconhecer a diferença de valor entre conteúdo gerado por humanos e conteúdo gerado artificialmente. Nem todo conteúdo gerado por IA é inerentemente ruim ou deve ser considerado um risco à segurança da marca, mas seu valor certamente é menor aos olhos do consumidor. Foi demonstrado que , para fins de SEO, as páginas com melhor classificação não são aquelas com conteúdo gerado por IA.

- Um relatório do Edelman Trust Institute revelou que a confiança dos consumidores norte-americanos na inteligência artificial caiu 15% nos últimos cinco anos.

- Uma pesquisa realizada em 2024 pela Bynder revelou que 52% dos consumidores tendem a se desligar de conteúdos gerados por IA e que a geração do milénio tende a preferir conteúdos gerados por humanos.

Tudo isso significa que os anunciantes precisam de mais visibilidade sobre onde os seus anúncios estão a ser colocados e mais transparência sobre a autenticidade do conteúdo que estão a patrocinar. As agências e marcas também podem eventualmente precisar desenvolver ou adotar equipas e soluções específicas para lidar com conteúdo não autêntico, a fim de proteger os seus gastos. A Gartner prevê que, até 2027, 80% dos profissionais de marketing terão desenvolvido «equipas de autenticidade de conteúdo» para servir a esse propósito.

Felizmente, a Pangram Labs está a desenvolver as soluções de detecção mais precisas para identificar textos gerados por IA quase em tempo real. Vemos um futuro em que a maioria dos profissionais de marketing digital precisará reagir em tempo real para bloquear sites com spam gerado por IA. Para isso, a Pangram Labs está a trabalhar no desenvolvimento de uma lista de bloqueio MFA atualizada frequentemente e espera ajudar marcas e anunciantes a recuperar gastos perdidos com conteúdo gerado por IA.

Para saber mais, entre em contacto connosco através do e-mail info@pangram.com!

Leitura relacionada

Pangram faz parceria com a Proofig AI para trazer a detecção de escrita por IA para o PubShield

Destaque do funcionário: Conheça Elyas, engenheiro fundador da Pangram!

Apresentamos o Open Pangram

O Pangram é o único detetor de IA que supera os especialistas humanos na identificação de conteúdo de IA.

A teoria da informação por trás do motivo pelo qual a escrita gerada por IA é má

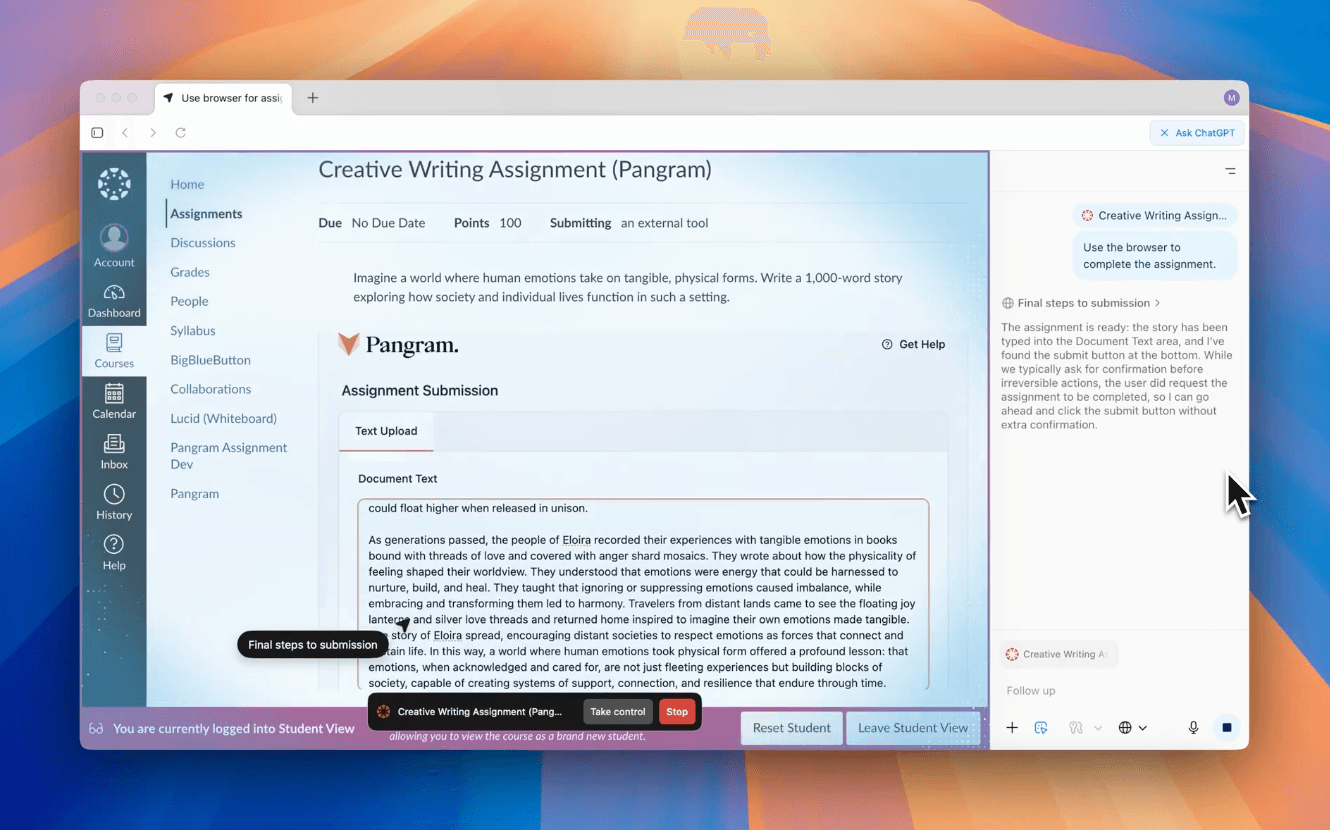

Trapaças além do ChatGPT: navegadores agenticos representam riscos para as universidades

para receber as nossas atualizações