Saiba imediatamente o que é publicado por pessoas e o que é gerado por IA no Twitter, LinkedIn, Substack e outras plataformas. Obtenha a nossa nova extensão para o Chrome.

O que é um verificador de ensaios?

No passado, «verificador de ensaios» era um termo usado para ferramentas que analisavam um texto em busca de erros ortográficos, gramaticais e de vocabulário. Também podiam ser usadas para verificar problemas com citações, como visto no Recite. O Turnitin, uma ferramenta educacional popular, tem sido uma grande ajuda na verificação de plágio.

Atualmente, o boom da IA levou os educadores a considerar verificadores que procuram conteúdo gerado por IA.

Os verificadores de trabalhos académicos com IA são precisos?

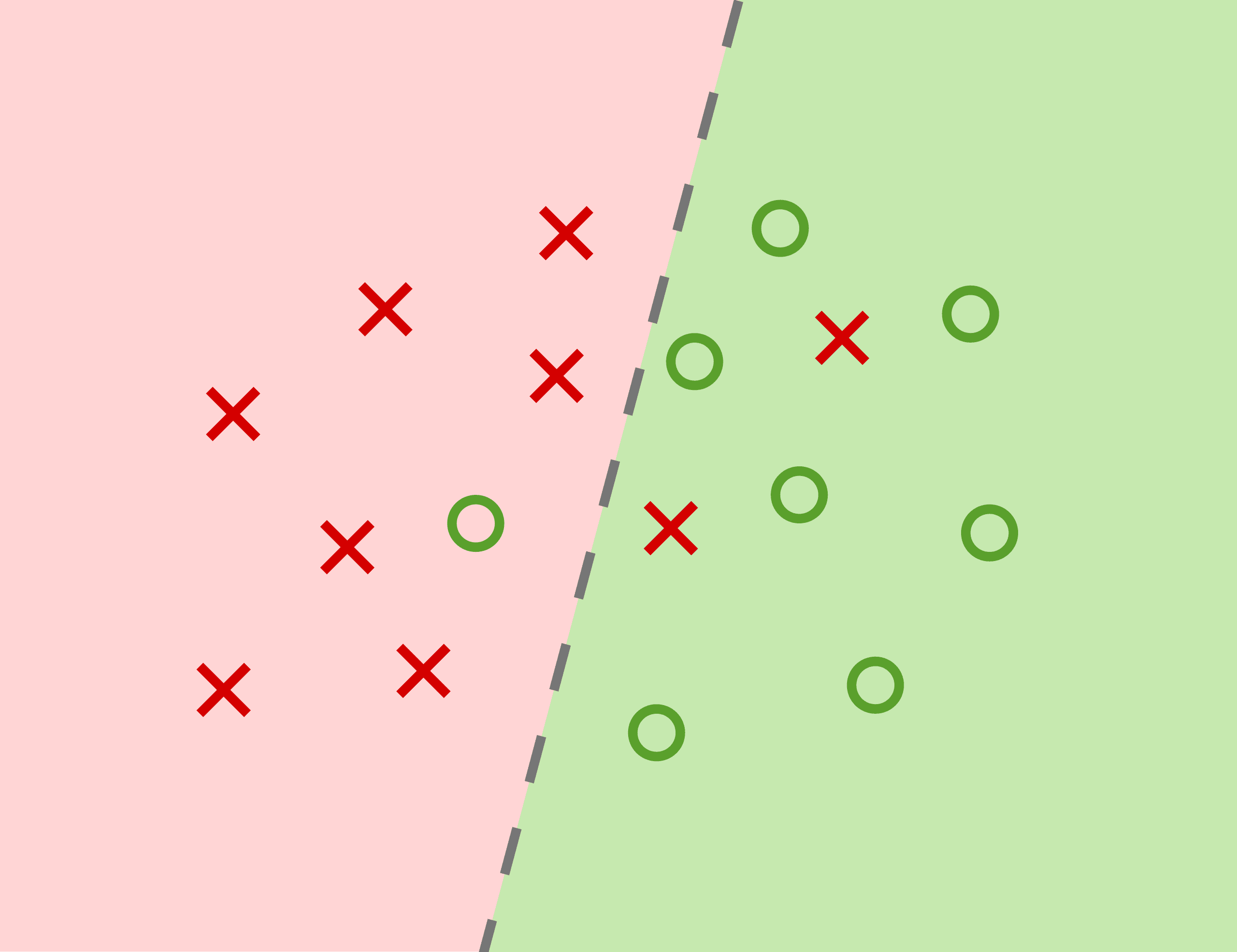

Altas taxas de falsos positivos (FPRs) são uma grande preocupação para os educadores. Apresentar uma alegação de desonestidade académica pode ser arriscado, pois fazer essa alegação com base num falso positivo pode ser prejudicial para a relação professor-aluno.

No entanto, o FPR de 0,01% do Pangram torna-o um detetor fiável para utilização no ensino superior. Isto também foi corroborado por terceiros, que concluíram que o Pangram é o detetor de IA mais preciso disponível no mercado.

Verificador de ensaios com IA vs. verificador de plágio

Um verificador de ensaios com IA assinala o uso de IA num determinado texto. Os verificadores de plágio determinam o uso de material externo num texto.

O Pangram é uma ferramenta comercial capaz de detetar conteúdo gerado por IA e plagiado. O Pangram identifica ambos como casos separados ao analisar o texto.

A IA pode plagiar o trabalho humano?

Um verificador de plágio compara um ensaio com textos já existentes para encontrar semelhanças. Um verificador de ensaios com IA analisa um texto em busca de padrões linguísticos semelhantes aos modelos atuais de IA.

LLMs como o ChatGPT geram texto usando grandes conjuntos de dados e são conhecidos por plagiar esses dados. Em um artigo da Amy B. Cyphert, professora associada da Faculdade de Direito da Universidade de West Virginia, observa que:

“Pesquisas sugerem que quanto mais frequentemente materiais protegidos por direitos autorais são incluídos em um conjunto de dados, mais provável é que um LLM produza um resultado que inclua texto inalterado dessa obra.”

A memorização ocorre quando um LLM reproduz frases do texto no conjunto de treino. Intencionalmente ou não, os LLMs podem ser solicitados a reproduzir o trabalho de outros em grandes partes. Isso significa que o resultado final da solicitação pode ser plagiado em parte ou na totalidade.

Enquanto os investigadores continuam a debater uma definição mais matizada de plágio, as políticas de integridade académica das universidades afirmam que plágio é o uso do trabalho de outra pessoa sem lhe dar crédito. A Universidade de Michigan observa que o plágio pode ser intencional ou não intencional. A Universidade de Oxford detalha várias formas de plágio, incluindo citações literais não reconhecidas, copiar e colar da Internet, parafrasear, conluio, não reconhecer ajuda, etc.

Portanto, numa instituição académica:

Quando um aluno entrega um trabalho gerado por IA, ele pode estar a entregar também um trabalho plagiado escrito por humanos!

Os seres humanos podem plagiar trabalhos gerados por IA?

Por alguns padrões, talvez!

Quando um aluno submete um trabalho gerado por IA sem creditar a IA, ocorre desonestidade académica. A política da Universidade do Sul da Flórida afirma:

«Uma vez que os chatbots de IA e outras ferramentas de IA generativa geram novos textos e imagens em resposta a prompts, a utilização de material proveniente da IA generativa pode ser considerada mais como ghost writing do que como plágio.»

O Comité de Ética em Publicações observa que a IA não pode ser considerada autora de um artigo científico porque «as ferramentas de IA não podem cumprir os requisitos de autoria, uma vez que não podem assumir a responsabilidade pelo trabalho submetido. Como entidades não jurídicas, não podem afirmar a presença ou ausência de conflitos de interesses, nem gerir acordos de direitos autorais e licenças».

Algumas instituições académicas acreditam que o uso de conteúdo gerado por IA constitui definitivamente plágio:

“Plágio é o ato de apresentar ideias, pesquisas ou textos que não são seus como se fossem seus. Exemplos de plágio incluem: copiar palavras ou imagens reais de outra pessoa ou de uma ferramenta de IA sem o uso de aspas e citações atribuindo as palavras à sua fonte. - City University of New York

“Plágio é quando você pega as ideias de outra pessoa e as apresenta como se fossem suas, mesmo que sem intenção. Se você está usando IA para resumir uma ideia ou escrever o seu trabalho, ele não é 100% seu.” - Universidade de Ohio

E, em outros casos, os educadores são encarregados de criar políticas de IA, tais como:

«Diretrizes claras para cursos ou tarefas individuais permitem que os alunos se concentrem nos objetivos de aprendizagem que você deseja que eles alcancem. Como os alunos muitas vezes não têm certeza de quando ou se podem usar a IA generativa, as políticas podem ser mais úteis quando são adaptadas ao seu curso e tarefas específicas, uma vez que alguns usos da IA podem apoiar a aprendizagem dos alunos, mas outros usos podem interromper processos importantes que os alunos precisam realizar por conta própria.» - UPenn

«Criar políticas claras sobre o uso da IA é essencial para manter a integridade académica e definir as expectativas dos alunos. Essas políticas devem definir quando e como ferramentas de IA como ChatGPT, Perplexity.ai ou Grammarly podem ser usadas e garantir que os alunos compreendam as implicações éticas da IA no trabalho académico.» - NYU

A partir desta pequena amostra de políticas universitárias, podemos compreender as diferentes formas como as instituições encaram a utilização da IA e o plágio. Embora a IA seja uma ferramenta e não um autor, apresentar resultados gerados por IA sem reconhecimento é desonesto. Os educadores devem definir expectativas claras para os seus alunos. Para saber mais sobre políticas de curso aplicáveis, o professor Christopher Ostro apresentou uma abordagem matizada para lidar com a fraude com IA.

A Pangram adota uma abordagem pró-transparência no uso da IA e do conteúdo externo, especialmente no meio académico. Se estiver interessado no nosso modelo, experimente gratuitamente os verificadores de IA e deteção de plágio da Pangram!

A Destiny é estagiária de análise de investigação na Pangram. É também estudante do NYC College of Technology, onde frequenta os cursos de Matemática Aplicada e Química. O trabalho da Destiny na Pangram tem contribuído significativamente para a investigação de conteúdo de IA na Internet. Para além do trabalho e dos estudos, a Destiny é apaixonada por escrita criativa e ficção de terror.

Leitura relacionada

Marcação de água com IA: Por que é que as grandes empresas tecnológicas estão a apostar na proveniência com IA — e a sair a perder

Verificadores de IA para professores: por que as escolas precisam de ferramentas de deteção de IA

O Google vai penalizar o conteúdo gerado por IA em 2026?

Humanizadores de IA: O problema (Slop)^2

Analisando as frases mais utilizadas em relação à IA

Tudo sobre falsos positivos em detectores de IA

para receber as nossas atualizações