اعرف على الفور ما هو من صنع البشر وما هو من صنع الذكاء الاصطناعي على تويتر ولينكدإن وسوبستاك وغيرها. احصل على ملحق كروم الجديد الخاص بنا.

الصورة من تصوير أنجيل بينا.

الصورة من تصوير أنجيل بينا.

في الأسبوع الماضي، أقر البرلمان الأوروبي قانون الذكاء الاصطناعي (AI Act)، وهو إطار شامل يتعين على الدول الأعضاء في الاتحاد الأوروبي اتباعه في تنظيم منتجات وخدمات الذكاء الاصطناعي.

يهدف قانون الذكاء الاصطناعي إلى أن يكون بمثابة تشريع لسلامة المستهلك، حيث يتبع "نهجًا قائمًا على المخاطر" تجاه المنتجات أو الخدمات التي تستخدم الذكاء الاصطناعي - فكلما زادت مخاطر تطبيق الذكاء الاصطناعي، زادت الرقابة عليه. تنقسم مستويات المخاطر إلى فئات مختلفة، منها:

- ستُعتبر أنظمة الذكاء الاصطناعي التي تستخدم "تقنيات خفية أو تلاعبية أو خادعة لتشويه السلوك وإعاقة اتخاذ قرارات مستنيرة" أو تشكل "خطراً واضحاً على حقوق الإنسان الأساسية" "مخاطرة غير مقبولة" وستُحظر.

- سيتعين على أنظمة الذكاء الاصطناعي التي تعتبر "عالية المخاطر"، مثل تلك المستخدمة في البنية التحتية الحيوية والتعليم والرعاية الصحية وإنفاذ القانون وإدارة الحدود أو الانتخابات، أن تمتثل لمتطلبات صارمة.

- ستُعتبر أنظمة الذكاء الاصطناعي للأغراض العامة التي لا تندرج ضمن فئات المخاطر العالية ذات مخاطر محدودة وتخضع لالتزامات شفافية أقل صرامة. وستُعتبر تطبيقات الذكاء الاصطناعي التوليدي أنظمة ذكاء اصطناعي للأغراض العامة.

سيُطلب من كل من المنتجين (مثل Open AI/Google) والمستخدمين (الشركات التي تستخدم هذه التطبيقات) اجتياز اختبارات الدقة والشفافية حتى يكون المستخدمون النهائيون (المستهلكون) على دراية بأنهم يتعاملون مع الذكاء الاصطناعي. وتواجه الشركات التي لا تستطيع الامتثال لهذه المتطلبات الجديدة غرامات تصل إلى 35 مليون يورو أو 7% من إيراداتها السنوية العالمية.

ماذا يعني هذا بالنسبة للمنصات الإلكترونية؟

أي شركة، بغض النظر عن مكان وجودها، لديها مستخدمون نهائيون في الاتحاد الأوروبي وتستخدم أنظمة الذكاء الاصطناعي في منتجاتها، ستخضع لقانون الذكاء الاصطناعي. على الرغم من أن هذا القانون واسع النطاق ويحتوي على بعض الغموض، إلا أنه من الواضح أن المنصات الإلكترونية التي تستخدم أو تنشر محتوى الذكاء الاصطناعي ستحتاج إلى الامتثال لهذه الالتزامات التنظيمية الجديدة.

مع زيادة المحتوى الذي يتم نشره بواسطة الذكاء الاصطناعي على العديد من منصات المحتوى التي ينشئها المستخدمون، من المرجح أن تضطر معظم المواقع الإلكترونية (مثل الناشرين والأسواق ومواقع التواصل الاجتماعي) إلى وضع بعض الضوابط للشفافية والرقابة، بما في ذلك:

- الكشف عما إذا كان المحتوى الذي تم إنشاؤه أو نشره على المنصة قد تم إنشاؤه بواسطة الذكاء الاصطناعي.

- تصميم المنصة بحيث ترفض الطلبات غير القانونية التي تم إنشاؤها بواسطة الذكاء الاصطناعي.

- نشر ملخصات للبيانات المحمية بحقوق النشر المستخدمة لتدريب النماذج الداخلية.

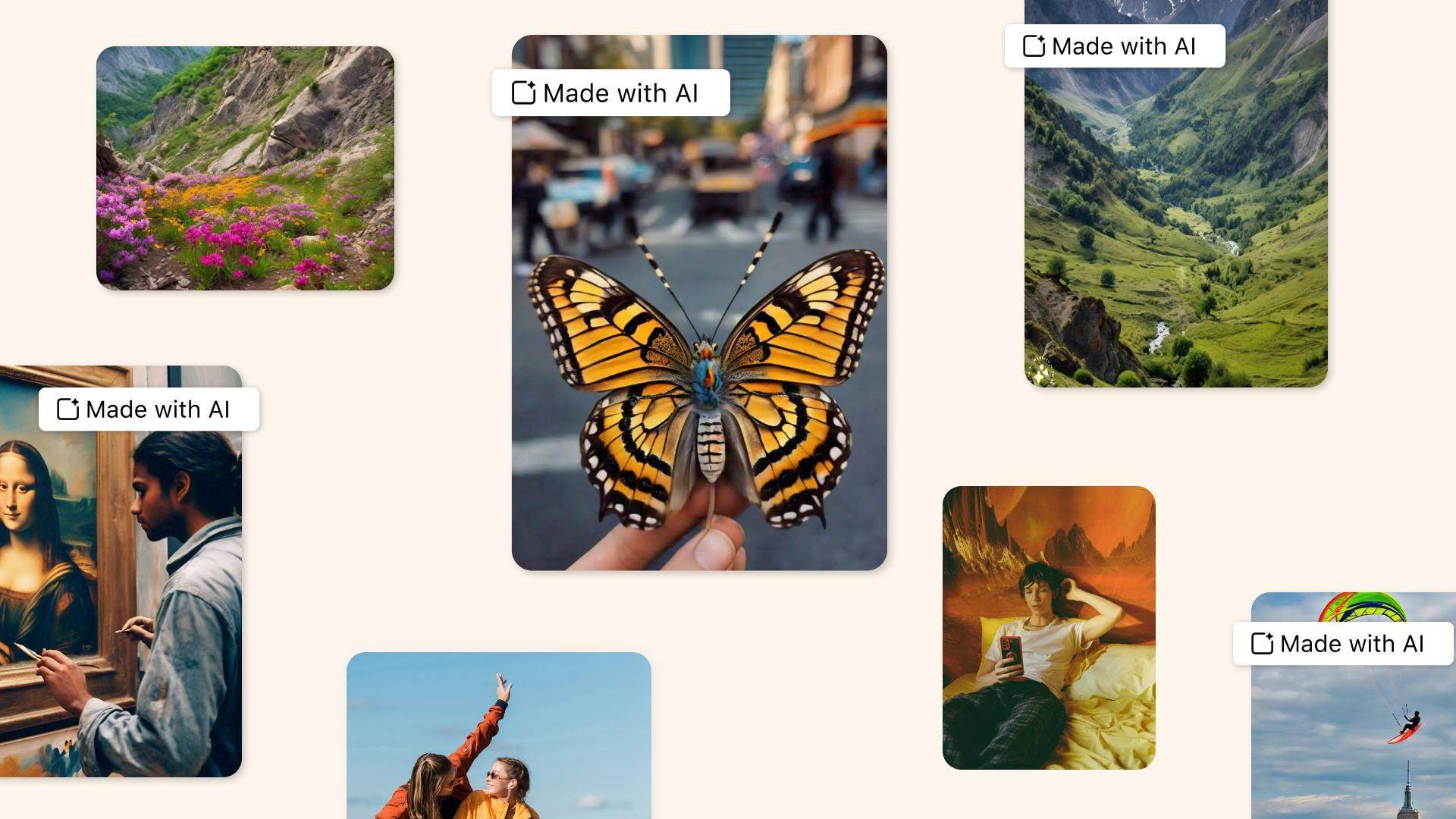

سيصبح وضع العلامات، والكشف بالوكالة عن المحتوى الذي تم إنشاؤه بواسطة الذكاء الاصطناعي، مطلبًا إلزاميًا إذا تم نشر هذا المحتوى على منصات المحتوى. وينطبق هذا على أي شكل من أشكال المحتوى - النصوص والصوت والصور ومقاطع الفيديو:

"يجب على مزودي أنظمة الذكاء الاصطناعي، بما في ذلك أنظمة الذكاء الاصطناعي للأغراض العامة، التي تولد محتوى صوتيًا أو صوريًا أو فيديو أو نصيًا اصطناعيًا، ضمان أن تكون مخرجات نظام الذكاء الاصطناعي محددة بتنسيق يمكن قراءته آليًا ويمكن اكتشافه على أنه مولد أو معالج اصطناعيًا."

بينما ندعم نية الاتحاد الأوروبي التشريعية الرامية إلى تعزيز أنظمة الذكاء الاصطناعي الآمنة، فإننا ندرك أيضًا أن تفسير هذا القانون والامتثال له قد يكون أمرًا مربكًا للشركات. قد تبدو هذه الالتزامات غامضة إلى حد ما، ولا يحدد قانون الذكاء الاصطناعي بشكل محدد ما إذا كانت الأنواع الثانوية من المحتوى (مثل تقييمات المستخدمين أو تعليقاتهم) خاضعة لهذه المتطلبات، أو ما هي إجراءات التحقق من الامتثال التي سيتعين على الشركات تضمينها.

كيف يمكن للشركات أن تسبق قانون الذكاء الاصطناعي؟

الخبر السار هو أن الشركات سيكون لديها الوقت الكافي لتطوير حلول تتيح الامتثال. من المتوقع أن يصبح القانون ساري المفعول بحلول شهر مايو، وستبدأ أحكامه في الدخول حيز التنفيذ على مراحل، حيث لن يتم تطبيق العديد من متطلبات الشفافية إلا بعد مرور عام من الآن.

ومع ذلك، نعتقد أن هناك إجراءات معينة يمكن للشركات اتخاذها الآن لاستباق أي تطبيق للقانون. وعلى وجه الخصوص، ينبغي للشركات أن تسعى إلى تطوير ما يلي:

- إرشادات واضحة وحوكمة حول المحتوى الذي ينشئه المستخدمون.

- عمليات تدقيق المحتوى الأكثر كفاءة لتحديد المحتوى الذي تم إنشاؤه بواسطة الذكاء الاصطناعي.

- أتمتة لمنع انتشار المحتوى الذي تم إنشاؤه بواسطة الذكاء الاصطناعي.

نرى بالفعل بعض الشركات تتخذ إجراءات - بعض المنصات مثل Youtube و Instagram تطلب من المستخدمين الإبلاغ عن أنفسهم عند تحميل محتوى "واقعي" تم إنشاؤه بواسطة الذكاء الاصطناعي. من غير الواضح ما إذا كان هذا "نظام الثقة" كافياً للامتثال للقانون، ولكن هذه إشارة قوية على أن قادة الصناعة يأخذون هذا التشريع وسلامة الذكاء الاصطناعي على محمل الجد.

في Pangram Labs، نبذل قصارى جهدنا لبناء أفضل أنظمة الكشف بالذكاء الاصطناعي حتى تتمكن الشركات من تشغيل منصات إلكترونية آمنة ومسؤولة. ونشعر بالتفاؤل إزاء هدف الاتحاد الأوروبي المتمثل في تحقيق الشفافية على الإنترنت، ونتطلع إلى العمل مع الباحثين وصانعي السياسات لتجسيد هذه المعايير المهمة.

هل تريد التواصل معنا؟ أرسل لنا بريدًا إلكترونيًا على info@pangram.com!

مقالات ذات صلة

كيف يحاول الطلاب تجنب كشف الذكاء الاصطناعي

أصبح الكشف عن الذكاء الاصطناعي أفضل بكثير: الإعلان عن Checkfor.ai

Pangram هو الكاشف الوحيد للذكاء الاصطناعي الذي يتفوق على الخبراء البشريين في تحديد محتوى الذكاء الاصطناعي.

بيان بشأن الأمر التنفيذي الصادر عن بايدن بشأن سلامة الذكاء الاصطناعي

تقديم "أوبن بانجرام"

ستبدأ Meta في تحديد المحتوى الذي تم إنشاؤه بواسطة الذكاء الاصطناعي

للحصول على آخر المستجدات