اعرف على الفور ما هو من صنع البشر وما هو من صنع الذكاء الاصطناعي على تويتر ولينكدإن وسوبستاك وغيرها. احصل على ملحق كروم الجديد الخاص بنا.

ملاحظة: لقد غيرنا اسمنا إلى Pangram Labs! انظر منشورنا على المدونة لمزيد من التفاصيل.

أصدرت إدارة بايدن اليوم معايير جديدة لسلامة وأمن الذكاء الاصطناعي، بما في ذلك هذا التوجيه بشأن الكشف عن محتوى الذكاء الاصطناعي:

ستقوم وزارة التجارة بوضع إرشادات لتوثيق المحتوى ووضع علامات مائية عليه بهدف تمييز المحتوى الذي تم إنشاؤه بواسطة الذكاء الاصطناعي بوضوح. وستستخدم الوكالات الفيدرالية هذه الأدوات لتسهيل معرفة الأمريكيين بأن الاتصالات التي يتلقونها من حكومتهم هي اتصالات أصلية — وتكون بذلك مثالاً يحتذى به للقطاع الخاص والحكومات في جميع أنحاء العالم.

جو بايدن، من ai.gov.

جو بايدن، من ai.gov.

تدعم Checkfor.ai بشكل كامل التزام إدارة بايدن بالنشر الآمن والمسؤول لنماذج اللغة الكبيرة. نعتقد أن وضع مبادئ توجيهية وسياسات حول مصادقة محتوى الذكاء الاصطناعي هو خطوة مهمة في الاتجاه الصحيح لسلامة الذكاء الاصطناعي ويتوافق مع مهمتنا المتمثلة في حماية الإنترنت من البريد العشوائي والمحتوى الضار الآخر الذي تولده نماذج اللغة الكبيرة. سيكون العالم في وضع أفضل، كمستهلكين ومستخدمين لتكنولوجيا الذكاء الاصطناعي، إذا استثمرنا كمجتمع بشكل أكبر في الكشف عن المحتوى الذي يتم إنشاؤه بواسطة الذكاء الاصطناعي. اليوم، نود أن نصدر بيانًا حول موقفنا كشركة بشأن مصادقة المحتوى والعلامات المائية والكشف.

- نعتقد أنه لا يوجد حل كافٍ حاليًا لحل المشكلة في الوقت الحالي، ويجب علينا استثمار المزيد من الموارد في حل مشكلة الكشف عن الذكاء الاصطناعي على وجه التحديد.

- نعتقد أن العلامات المائية ليست الحل لهذه المشكلة، لأنها تعزز إحساسًا زائفًا بالأمان، وقد ثبتت محدوديتها عندما يكون لدى المستخدم إمكانية الوصول إلى أوزان النماذج أو القدرة على تحرير الناتج (https://arxiv.org/pdf/2305.03807.pdf، https://arxiv.org/pdf/2301.10226.pdf). توجد بالفعل نماذج مفتوحة المصدر قوية وفعالة بدون علامات مائية، وسيتمكن المخترقون دائمًا من ضبط إصداراتهم المحلية من هذه النماذج لتفادي الكشف. علاوة على ذلك، نعتقد أن مشكلة الكشف قابلة للحل حتى في النماذج التي لا تحتوي على علامات مائية.

- نحن ندعم التنظيم المتعلق بسلامة الذكاء الاصطناعي وتطوير نماذج اللغة الكبيرة، مع الشرط الأساسي بأن جميع اللوائح التنظيمية يجب أن تدعم النظام البيئي مفتوح المصدر. يوفر مفتوح المصدر ضوابط وتوازنات على شركات التكنولوجيا الكبيرة والقوية، وشفافية للمستهلكين، ويسمح للجمهور بتقييم هذه النماذج ونقدها ومقارنتها بحرية.

- نعتقد أن دور الحكومة في تعزيز سلامة الذكاء الاصطناعي والاستثمار في أبحاث الكشف عن الذكاء الاصطناعي يجب أن يركز على تمويل المشاريع الأكاديمية والصناعية في مجال الكشف عن الذكاء الاصطناعي.

- لتعزيز فعالية الأبحاث في مجال الكشف عن الذكاء الاصطناعي، يجب أن نضع معايير ومقاييس تقييمية، بحيث يمكن للمستهلكين أن يكونوا على دراية بفعالية وقيود أجهزة الكشف عن الذكاء الاصطناعي المتاحة. نحن ملتزمون بتطوير المعايير الخاصة بالكشف عن الذكاء الاصطناعي على مستوى الصناعة والمساهمة فيها، بحيث يمكن نشر نماذج لغوية أكبر وأكثر قوة بشكل آمن ومسؤول.

في Checkfor.ai، نحن نعمل جاهدين على بناء أنظمة كشف موثوقة تعتمد على الذكاء الاصطناعي حتى يمكن نشر نماذج اللغة من الجيل التالي بأمان وإنتاجية. نحن متحمسون لرؤية التزام إدارة بايدن بالتمييز بين المحتوى الذي ينتجه البشر والمحتوى الذي ينتجه الذكاء الاصطناعي، ونتطلع إلى العمل مع الباحثين وصانعي السياسات لتطوير هذه المعايير المهمة.

ماكس مهندس متمرس في مجال التعلم الآلي. عمل مؤخراً في شركة Nuro في مجال المركبات ذاتية القيادة، حيث قاد جهود التعلم النشط في الشركة. له تاريخ طويل في نشر منتجات التعلم الآلي الناجحة في Google و Two Sigma و Yelp.

ماكس حاصل على بكالوريوس في علوم الكمبيوتر النظرية وماجستير في الذكاء الاصطناعي من جامعة ستانفورد. بالإضافة إلى شغفه بالبناء، فهو أيضًا عضو نشط في مجتمع Magic: the Gathering cube.

مقالات ذات صلة

تسوق حتى التعب: الذكاء الاصطناعي يتسلل إلى المنتجات وتسويقها

لماذا يحدد Pangram الحد الأدنى لعدد الكلمات؟

Pangram هو الكاشف الوحيد للذكاء الاصطناعي الذي يتفوق على الخبراء البشريين في تحديد محتوى الذكاء الاصطناعي.

أصبح الكشف عن الذكاء الاصطناعي أفضل بكثير: الإعلان عن Checkfor.ai

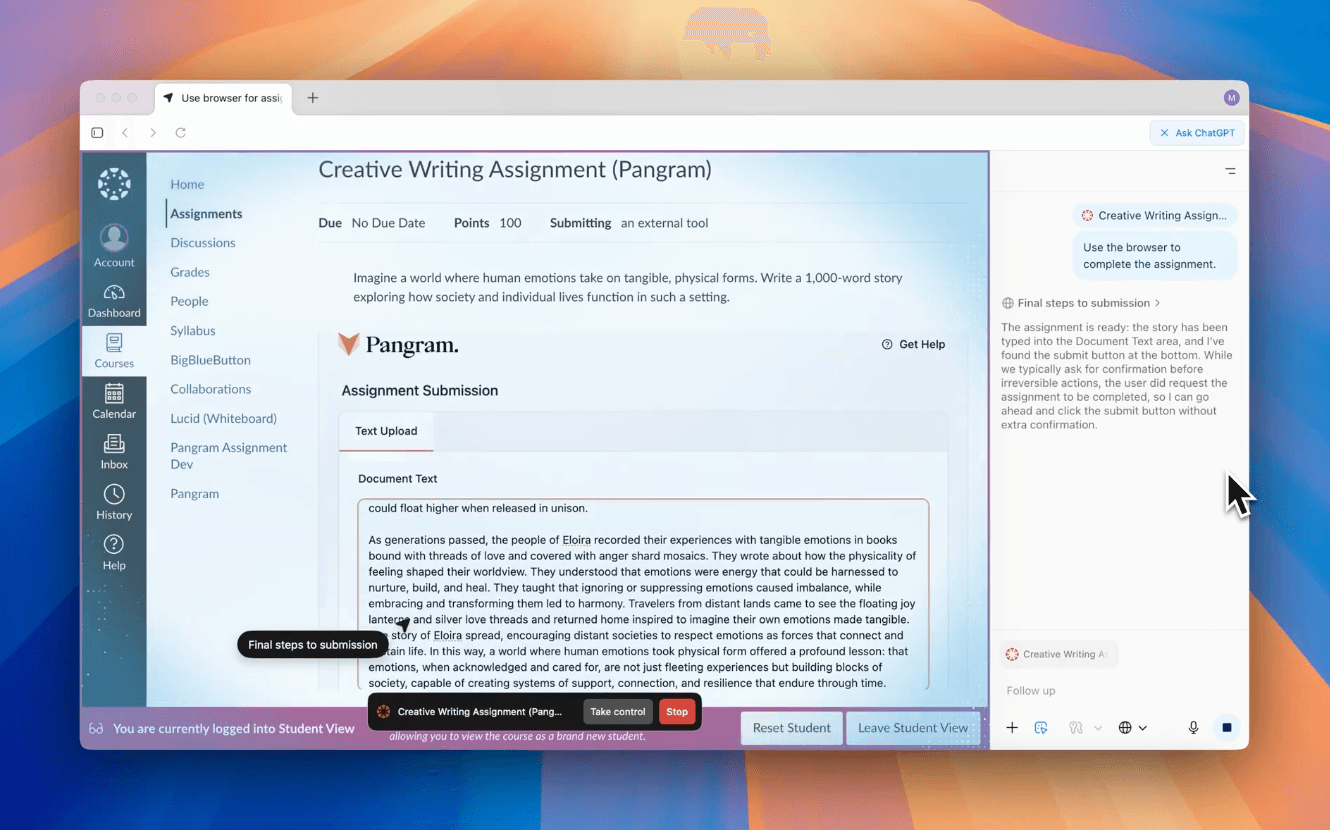

الغش خارج نطاق ChatGPT: المتصفحات الوكيلة تشكل مخاطر على الجامعات

تسليط الضوء على الموظفين: تعرفوا على كاثرين، عالمة أبحاث في مجال الذكاء الاصطناعي

للحصول على آخر المستجدات