اعرف على الفور ما هو من صنع البشر وما هو من صنع الذكاء الاصطناعي على تويتر ولينكدإن وسوبستاك وغيرها. احصل على ملحق كروم الجديد الخاص بنا.

ما هو مدقق المقالات؟

في الماضي، كان مصطلح "مدقق المقالات" يستخدم للإشارة إلى الأدوات التي تحلل النصوص بحثًا عن الأخطاء الإملائية والنحوية والمفردات. وقد تستخدم أيضًا للتحقق من وجود مشكلات في الاقتباسات، كما هو الحال في Recite. وقد كان Turnitin، وهو أداة تعليمية شائعة، عونًا كبيرًا في التحقق من الانتحال.

حالياً، دفع ازدهار الذكاء الاصطناعي المعلمين إلى التفكير في استخدام برامج فحص تبحث عن المحتوى الذي تم إنشاؤه بواسطة الذكاء الاصطناعي.

هل أدوات التدقيق الورقي بالذكاء الاصطناعي دقيقة؟

تعد معدلات الإيجابية الكاذبة المرتفعة (FPRs) مصدر قلق كبير للمعلمين. قد يكون تقديم ادعاء بالغش الأكاديمي أمراً محفوفاً بالمخاطر، حيث أن تقديم هذا الادعاء بناءً على إيجابية كاذبة قد يضر بالعلاقة بين المعلم والطالب.

ومع ذلك، فإن معدل FPR لبرنامج Pangram البالغ 0.01٪ يجعله أداة كشف موثوقة للاستخدام في التعليم العالي. وقد تم تأكيد ذلك أيضًا من قبل أطراف ثالثة، التي خلصت إلى أن Pangram هو أكثر أدوات الكشف عن الذكاء الاصطناعي دقةً المتوفرة تجاريًا.

مدقق مقالات الذكاء الاصطناعي مقابل مدقق الانتحال

يلاحظ مدقق المقالات بالذكاء الاصطناعي استخدام الذكاء الاصطناعي في نص معين. تحدد أدوات فحص الانتحال استخدام المواد الخارجية في النص.

Pangram هي أداة تجارية قادرة على اكتشاف المحتوى الذي تم إنشاؤه بواسطة الذكاء الاصطناعي والمحتوى المسروق. تلاحظ Pangram كلا الحالتين على حدة عند تحليل النص.

هل يمكن للذكاء الاصطناعي أن يسرق أعمال البشر؟

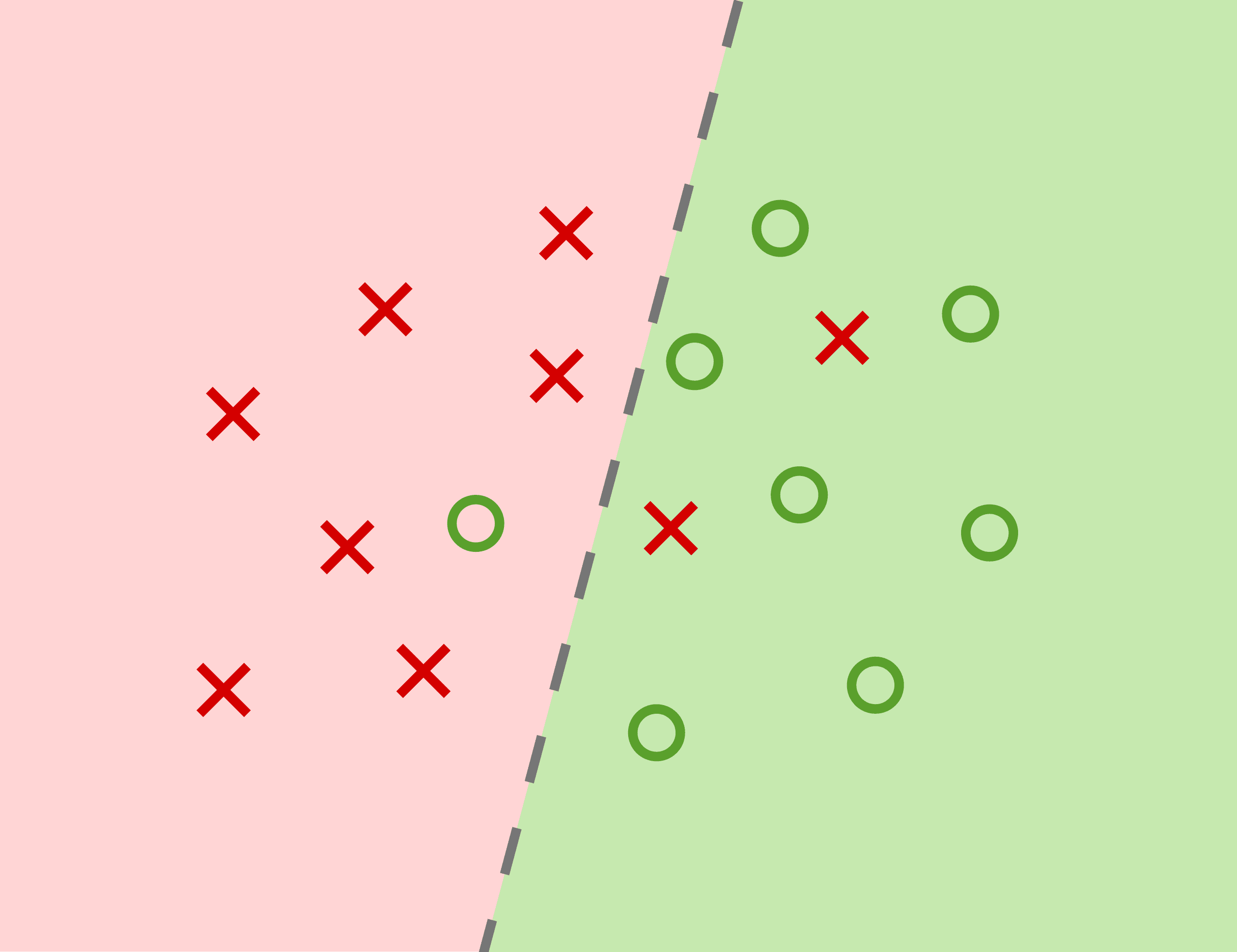

يقوم مدقق الانتحال بمقارنة المقالة بالنصوص الموجودة مسبقًا لمطابقة أوجه التشابه. يقوم مدقق المقالات بالذكاء الاصطناعي بمسح النص بحثًا عن أنماط لغوية مشابهة لنماذج الذكاء الاصطناعي الحالية.

تقوم برامج LLM مثل ChatGPT بإنشاء نصوص باستخدام مجموعات بيانات ضخمة، ومن المعروف أنها تنتحل هذه البيانات. في مقال نشرته آمي ب. سيفرت، الأستاذة المشاركة في كلية الحقوق بجامعة وست فرجينيا، تشير إلى أن:

"تشير الأبحاث إلى أنه كلما زادت نسبة المواد المحمية بحقوق النشر في مجموعة البيانات، زادت احتمالية أن ينتج LLM ناتجًا يتضمن نصًا غير معدل من ذلك العمل."

يحدث الحفظ عندما يقوم LLM بإعادة إنتاج عبارات من نص في مجموعة التدريب. عن قصد أو غير ذلك، يمكن حث LLMs على إعادة إنتاج أعمال الآخرين في أجزاء كبيرة. وهذا يعني أن النتيجة النهائية للحث قد تكون مسروقة جزئيًا أو كليًا.

بينما يواصل الباحثون النقاش حول تعريف أكثر دقة للسرقة الأدبية، تنص سياسات النزاهة الأكاديمية في الجامعات على أن السرقة الأدبية هي استخدام عمل شخص آخر دون الإشارة إلى مصدره. تشير جامعة ميشيغان إلى أن السرقة الأدبية يمكن أن تكون متعمدة أو غير متعمدة. توضح جامعة أكسفورد عدة أشكال من السرقة الأدبية، منها الاقتباس الحرفي دون الإشارة إلى المصدر، والنسخ واللصق من الإنترنت، وإعادة الصياغة، والتواطؤ، وعدم الإشارة إلى المساعدة، وما إلى ذلك.

لذا في مؤسسة أكاديمية:

عندما يقدم الطالب عملاً تم إنشاؤه بواسطة الذكاء الاصطناعي، فقد يكون قد قدم عملاً مسروقاً كتبته يد بشرية أيضاً!

هل يمكن للبشر أن يسرقوا الأعمال التي أنتجتها الذكاء الاصطناعي؟

بعض المعايير، ربما!

عندما يقدم الطالب عملاً تم إنشاؤه بواسطة الذكاء الاصطناعي دون الإشارة إلى مصدره، فإن ذلك يعتبر غشًا أكاديميًا. تنص سياسة جامعة جنوب فلوريدا على ما يلي:

"نظرًا لأن روبوتات الدردشة التي تعمل بالذكاء الاصطناعي وأدوات الذكاء الاصطناعي التوليدي الأخرى تولد نصوصًا وصورًا جديدة استجابةً للمطالبات، فإن استخدام مواد من الذكاء الاصطناعي التوليدي يمكن اعتباره أقرب إلى الكتابة بالنيابة عن الغير منه إلى الانتحال."

تشير لجنة أخلاقيات النشر إلى أنه لا يمكن اعتبار الذكاء الاصطناعي مؤلفًا لورقة بحثية لأن "أدوات الذكاء الاصطناعي لا تستوفي متطلبات التأليف، حيث إنها لا تستطيع تحمل مسؤولية العمل المقدم. وباعتبارها كيانات غير قانونية، لا يمكنها تأكيد وجود أو عدم وجود تضارب في المصالح، ولا إدارة اتفاقيات حقوق النشر والترخيص".

تعتقد بعض المؤسسات الأكاديمية أن استخدام المحتوى الذي تم إنشاؤه بواسطة الذكاء الاصطناعي يشكل بالتأكيد سرقة أدبية:

"السرقة الأدبية هي فعل تقديم أفكار أو أبحاث أو كتابات لا تخصك على أنها تخصك. ومن أمثلة السرقة الأدبية: نسخ كلمات أو صور شخص آخر أو أداة ذكاء اصطناعي دون استخدام علامات الاقتباس والاقتباسات التي تنسب الكلمات إلى مصدرها. - جامعة مدينة نيويورك

"السرقة الأدبية هي أن تأخذ أفكار شخص آخر وتقدمها على أنها أفكارك الخاصة، حتى لو كان ذلك دون قصد. إذا كنت تستخدم الذكاء الاصطناعي لتلخيص فكرة أو كتابة عملك، فإنه لا يكون عملك بنسبة 100٪." - جامعة أوهايو

وفي حالات أخرى، يتحمل المعلمون مسؤولية وضع سياسات الذكاء الاصطناعي مثل:

"تتيح الإرشادات الواضحة للدورات أو المهام الفردية للطلاب التركيز على الأهداف التعليمية التي تريدهم أن يحققوها. نظرًا لأن الطلاب غالبًا ما يكونون غير متأكدين من متى أو ما إذا كان بإمكانهم استخدام الذكاء الاصطناعي التوليدي، يمكن أن تكون السياسات مفيدة للغاية عندما تكون مخصصة لدورتك ومهامك المحددة، نظرًا لأن بعض استخدامات الذكاء الاصطناعي قد تدعم تعلم الطلاب، ولكن استخدامات أخرى قد تعطل العمليات المهمة التي يحتاج الطلاب إلى القيام بها بأنفسهم." - جامعة بنسلفانيا

"إن وضع سياسات واضحة حول استخدام الذكاء الاصطناعي أمر ضروري للحفاظ على النزاهة الأكاديمية وتحديد توقعات الطلاب. يجب أن تحدد هذه السياسات متى وكيف يمكن استخدام أدوات الذكاء الاصطناعي مثل ChatGPT و Perplexity.ai و Grammarly، وأن تضمن فهم الطلاب للآثار الأخلاقية للذكاء الاصطناعي في العمل الأكاديمي." - جامعة نيويورك

من هذه العينة الصغيرة من سياسات الجامعات، يمكننا أن نفهم الطرق المختلفة التي تنظر بها المؤسسات إلى استخدام الذكاء الاصطناعي والانتحال. في حين أن الذكاء الاصطناعي هو أداة وليس مؤلفًا، فإن تقديم مخرجات تم إنشاؤها بواسطة الذكاء الاصطناعي دون الإقرار بذلك يعد أمرًا غير أمين. يجب على المعلمين وضع توقعات واضحة لطلابهم. لمعرفة المزيد عن سياسات الدورات الدراسية القابلة للتنفيذ، قدم البروفيسور كريستوفر أوسترو نهجًا دقيقًا للتعامل مع الغش باستخدام الذكاء الاصطناعي.

تتبنى Pangram نهجًا مؤيدًا للشفافية في استخدام الذكاء الاصطناعي والمحتوى الخارجي، خاصة في الأوساط الأكاديمية. إذا كنت مهتمًا بنموذجنا، جرب أدوات Pangram للذكاء الاصطناعي والكشف عن الانتحال مجانًا!

ديستيني هي محللة أبحاث متدربة في شركة بانغرام. وهي أيضًا طالبة في كلية نيويورك للتكنولوجيا، حيث تدرس الرياضيات التطبيقية والكيمياء. وقد ساهم عمل ديستيني في بانغرام بشكل كبير في التحقيق في "الفضلات" الناتجة عن الذكاء الاصطناعي على الإنترنت. وخارج نطاق العمل والدراسة، تهوى ديستيني الكتابة الإبداعية وأدب الرعب الخيالي.

مقالات ذات صلة

العلامات المائية المدعومة بالذكاء الاصطناعي: لماذا تراهن شركات التكنولوجيا الكبرى على تتبع مصدر المحتوى باستخدام الذكاء الاصطناعي، وتخسر

أدوات فحص الذكاء الاصطناعي للمعلمين: لماذا تحتاج المدارس إلى أدوات الكشف عن الذكاء الاصطناعي

هل ستعاقب Google المحتوى الذي تم إنشاؤه بواسطة الذكاء الاصطناعي في عام 2026؟

مُؤنِّشِّو الذكاء الاصطناعي: مشكلة (الفضلات)^2

تجول بين أكثر العبارات استخدامًا في مجال الذكاء الاصطناعي

كل ما يتعلق بالإيجابيات الخاطئة في أجهزة الكشف التي تعمل بالذكاء الاصطناعي

للحصول على آخر المستجدات