اعرف على الفور ما هو من صنع البشر وما هو من صنع الذكاء الاصطناعي على تويتر ولينكدإن وسوبستاك وغيرها. احصل على ملحق كروم الجديد الخاص بنا.

النقاط الرئيسية:

- تُظهر نماذج اللغة الكبيرة (LLMs) أنماطًا معينة تسمح لأدوات الكشف عن الذكاء الاصطناعي المختلفة بتحديد ما إذا كان النص من إنتاج بشري أم من إنتاج الذكاء الاصطناعي.

- كانت أجهزة الكشف القديمة تعتمد على الاندفاعية والحيرة، ولكنها غير موثوقة. تعمل أجهزة الكشف الجديدة بشكل أفضل بكثير وتعتمد على مجموعات بيانات أكبر والتعلم النشط.

- عند اختيار أداة الكشف، يجب على المستخدمين تحديد معدلات الإيجابيات الكاذبة والسلبيات الكاذبة التي يناسبهم. كما يجب عليهم تحديد ما إذا كانوا بحاجة إلى أداة للتحقق من الانتحال أو ميزات أخرى قبل اختيار الأداة.

- البشر الذين لم يتدربوا على اكتشاف الذكاء الاصطناعي ليسوا بارعين في ذلك. ومع ذلك، فإن أولئك الذين تدربوا أو يتعرضون بشكل روتيني لنصوص تم إنشاؤها بواسطة الذكاء الاصطناعي يمكنهم التعرف على محتوى الذكاء الاصطناعي بشكل أفضل من أولئك الذين لم يتدربوا. يمكن أن يعمل هذا الاكتشاف بشكل جيد للغاية عند دمجه مع البرامج.

ما هي أجهزة الكشف عن الذكاء الاصطناعي؟

يمكن اكتشاف الذكاء الاصطناعي. إنه ليس سحرًا أسود، بل شيء يستند إلى الكثير من الأبحاث. في عصر يزداد فيه انتشار المحتوى الذي تولده الذكاء الاصطناعي في الأوساط الأكاديمية والإعلامية والتجارية، تعد القدرة على التمييز بين النصوص التي كتبها الإنسان وتلك التي كتبتها الآلة مهارة بالغة الأهمية. يتخذ الذكاء الاصطناعي خيارات لغوية وأسلوبية ودلالية يمكن اكتشافها بواسطة عين مدربة أو برامج اكتشاف آلية جيدة بما فيه الكفاية. وذلك لأننا نستطيع أن نفهم سبب طريقة تحدث الذكاء الاصطناعي، والأنماط التي يمكننا استخدامها لاكتشافه.

كيف تعمل نماذج اللغة الكبيرة؟

قبل أن نتحدث عن كيفية عمل برامج الكشف عن الذكاء الاصطناعي، من المهم أن نفهم أن نماذج الذكاء الاصطناعي هي توزيعات احتمالية. نموذج اللغة الكبيرة (LLM) مثل ChatGPT هو نسخة معقدة للغاية من هذا، حيث يتنبأ باستمرار بالكلمة أو "الرمز" التالي الأكثر احتمالية في تسلسل ما. يتم تعلم هذه التوزيعات الاحتمالية من كمية هائلة من البيانات، والتي غالبًا ما تشمل جزءًا كبيرًا من الإنترنت العام.

أحد الأسئلة التي كثيراً ما تُطرح هو: "هل نماذج اللغة الاصطناعية هي متوسط كل ما يكتبه البشر؟" والجواب هو بالطبع لا. نماذج اللغة لا تأخذ فقط متوسط ما يقوله جميع البشر. فمن ناحية، تتخذ نماذج اللغة خيارات شديدة الخصوصية. كما أنها شديدة التحيز بسبب مجموعات البيانات التدريبية وتحيزات مبتكريها. وأخيرًا، تم تحسين نماذج اللغة الحديثة لتتبع التعليمات وتقول الأشياء التي يرغب المستخدمون في سماعها، بدلاً من الصحة أو الدقة، وهي سمة تجعلها مساعدات مفيدة ولكنها مصادر غير موثوقة للحقيقة.

هذا نتيجة لإجراءات التدريب الحديثة لبرنامج الماجستير في القانون، والتي تتكون من ثلاث مراحل:

- التدريب المسبق: خلال هذه المرحلة من التدريب، يتعلم النموذج الأنماط الإحصائية للغة. تظهر التحيزات من بيانات التدريب في هذه الأنماط. على سبيل المثال، البيانات التي تظهر بشكل متكرر على الإنترنت، مثل ويكيبيديا، ممثلة بشكل مفرط، وهذا هو السبب في أن النصوص التي تولدها الذكاء الاصطناعي غالبًا ما تكون ذات نبرة رسمية وموسوعية. بالإضافة إلى ذلك، يتم استخدام العمالة الرخيصة والمستعان بها من الخارج لإنشاء بيانات التدريب، وهو ما يجعل كلمات مثل "delve" و"tapestry" و"intricate" شائعة للغاية في النصوص التي تولدها الذكاء الاصطناعي، مما يعكس المعايير اللغوية لمنشئي البيانات بدلاً من المستخدم النهائي.

- ضبط التعليمات: خلال هذه المرحلة، يتعلم النموذج اتباع التعليمات والامتثال للأوامر. ونتيجة لذلك، يتعلم النموذج أنه من الأفضل اتباع التعليمات بدلاً من تقديم معلومات دقيقة وصحيحة. وينتج عن ذلك سلوك متملق أو "مُرضي للناس"، حيث تعطي الذكاء الاصطناعي الأولوية لتوليد استجابة مفيدة ومقبولة، حتى لو اضطرت إلى اختلاق الحقائق أو "الهلوسة" للقيام بذلك. فمن الأهم بالنسبة لها أن ترضي الناس أكثر من الحصول على المعلومات الصحيحة.

- المواءمة: خلال هذه المرحلة، يتعلم النموذج كيفية التعبير عن ما يحبه الناس ويفضلونه. يتعلم ما هي الأشياء "الجيدة" و"السيئة" التي يمكن قوله. ومع ذلك، يمكن أن تكون بيانات التفضيل هذه متحيزة للغاية، وغالبًا ما تفضل الردود المحايدة والآمنة وغير المسيئة. يمكن أن تجرد هذه العملية النموذج من صوته المميز، مما يدفعه إلى تجنب الجدل أو الآراء القوية. لا يوجد لدى LLM أي أساس راسخ في الحقيقة أو الصحة.

نماذج الذكاء الاصطناعي التوليدي هي منتجات تصدرها شركات التكنولوجيا، وتقوم عمداً بإدخال تحيزات وسلوكيات تنعكس في مخرجاتها.

ما هي الأنماط في لغة الذكاء الاصطناعي؟

بمجرد فهمك لكيفية تدريب نماذج اللغة الكبيرة (LLM)، يمكنك اكتشاف "علامات" أدوات الكتابة التي تعتمد على الذكاء الاصطناعي. غالبًا ما لا يكون هناك دليل دامغ واحد، بل مزيج من كل هذه الكلمات هو ما يثير انتباه أجهزة الكشف.

اللغة والأسلوب

- اختيار الكلمات: لدى مؤلفي المحتوى بالذكاء الاصطناعي كلمات مفضلة، مثل: جانب، تحديات، التعمق، تعزيز، نسيج، شهادة، أصيل، شامل، حاسم، مهم، تحويلي، وظروف مثل بالإضافة إلى ذلك وعلاوة على ذلك. يحدث هذا بسبب التحيز في مجموعات البيانات قبل التدريب. الاستخدام المتكرر لهذه الكلمات يمكن أن يخلق نبرة مفرطة في الرسمية أو الفخامة، وغالبًا ما تبدو غير مناسبة في سياق مقال طلابي نموذجي أو اتصال غير رسمي.

- أنماط الصياغة: تستخدم الكتابة بالذكاء الاصطناعي أنماط صياغة مثل "بينما نحن [فعل] الموضوع"، ومن المهم ملاحظة أنه ليس فقط ذلك، بل أيضًا، تمهيد الطريق، وعندما يتعلق الأمر بـ. هذه العبارات، على الرغم من صحتها النحوية، غالبًا ما تستخدم كملء للمحادثة ويمكن أن تجعل الكتابة تبدو عامة ونمطية.

- التهجئة والنحو: تستخدم الكتابة بالذكاء الاصطناعي عمومًا تهجئة ونحوًا مثاليين، وتفضل استخدام الجمل المعقدة. أما الكتابة البشرية فتستخدم مزيجًا من الجمل البسيطة والمعقدة، وحتى الكتّاب الخبراء يستخدمون أحيانًا أنماطًا نحوية غير "مثالية تمامًا" لأسباب أسلوبية، مثل استخدام أجزاء من الجمل للتأكيد.

الهيكل والتنظيم

- الفقرات وبنية الجمل: عادةً ما تستخدم الكتابة الآلية فقرات منظمة للغاية، تكون جميعها بنفس الطول وتشبه القوائم. وقد يؤدي ذلك إلى إيقاع رتيب يفتقر إلى التنوع الطبيعي الذي تتميز به الكتابة البشرية. وينطبق ذلك أيضًا على طول الجمل.

- المقدمات والخاتمات: عادةً ما تحتوي المقالات التي يتم إنشاؤها بواسطة الذكاء الاصطناعي على مقدمة وخاتمة منظمة للغاية، وغالبًا ما تكون الخاتمة طويلة جدًا، وتبدأ بعبارة "بشكل عام" أو "في الختام"، وتكرر معظم ما تمت كتابته بالفعل، حيث تعيد صياغة الأطروحة والنقاط الرئيسية دون إضافة أي رؤى أو تحليلات جديدة.

الغرض والشخصية

- الغرض والهدف: عادة ما تكون الكتابة غامضة للغاية ومليئة بالعموميات. يحدث هذا لأن ضبط التعليمات يعطي أولوية مفرطة للالتزام الفوري، ومن أجل البقاء في الموضوع، يتعلم النموذج أنه من الأفضل أن يكون غامضًا وعامًا للغاية لتقليل مخاطر الخطأ.

- التفكير والتفكير النقدي: الذكاء الاصطناعي سيئ جدًا في التفكير وربط الكتابة بالتجارب الشخصية... لأنه لا يمتلك أي تجارب شخصية يمكنه ربطها بها! يمكن للكتابة البشرية أن تعكس الصوت الفريد والتجربة الشخصية لمؤلفها، وتربط بين الأفكار وتولد أفكارًا جديدة لا تقتصر على مجرد إعادة صياغة المعلومات الموجودة.

- تغيرات مفاجئة في الأسلوب والنبرة: في بعض الأحيان، تحدث تغيرات مفاجئة ومزعجة في النبرة والأسلوب. يحدث هذا عندما يستخدم الطالب الذكاء الاصطناعي في كتابة بعض أجزاء النص، وليس كله، مما يؤدي إلى نتاج نهائي غير متسق ومفكك.

كيف يعمل الكشف عن الذكاء الاصطناعي: ثلاث خطوات

- تدريب نموذج الكشف عن الذكاء الاصطناعي: أولاً، يتم تدريب النموذج. لم تعمل أجهزة الكشف عن الذكاء الاصطناعي المبكرة بشكل جيد لأنها حاولت الكشف عن أجزاء من النص ذات درجة عالية من التعقيد أو التقطع. التعقيد هو مدى توقع أو مفاجأة كل كلمة في جزء من النص بالنسبة لنموذج لغوي كبير. التقلب هو التغير في التعقيد على مدار المستند. ومع ذلك، فإن هذه الطريقة بها عدة عيوب، وغالبًا ما تفشل في اكتشاف مخرجات الذكاء الاصطناعي. كما أنها تستخدم فقط مجموعة محدودة من البيانات النصية للتدريب. تستخدم النماذج الحديثة والناجحة مثل Pangram مجموعة أوسع من البيانات وتستخدم تقنيات مثل التعلم النشط للحصول على نتائج أكثر دقة.

- أدخل النص الذي تريد تصنيفه وقم بتجزئته: يقوم المستخدم بإدخال النص. عندما يتلقى المصنف النص المدخل، يقوم بتجزئته. وهذا يعني أنه يأخذ النص بأكمله ويقسمه إلى سلسلة من الأرقام التي يمكن للنموذج فهمها. ثم يحول النموذج كل جزء إلى تضمين، وهو متجه من الأرقام يمثل معنى كل جزء.

- تصنيف الرمز البشري أو الذكاء الاصطناعي: يتم تمرير المدخلات عبر الشبكة العصبية، مما ينتج عنه تضمين المخرجات. يقوم رأس المصنف بتحويل تضمين المخرجات إلى تنبؤ 0 أو 1، حيث 0 هو التسمية البشرية و 1 هو التسمية الذكاء الاصطناعي.

ماذا عن النتائج الإيجابية الكاذبة والنتائج السلبية الكاذبة؟

يتم قياس قيمة أداة الكشف عن الذكاء الاصطناعي من خلال عدد النتائج الإيجابية الخاطئة (FPR) والنتائج السلبية الخاطئة (NPR) الناتجة عن استخدام الأداة. النتيجة الإيجابية الخاطئة هي عندما يتنبأ الكاشف خطأً بأن عينة محتوى مكتوبة بواسطة الإنسان هي مكتوبة بواسطة الذكاء الاصطناعي. في المقابل، النتيجة السلبية الخاطئة هي عندما يتم التنبؤ خطأً بأن عينة مولدة بواسطة الذكاء الاصطناعي هي نص مكتوب بواسطة الإنسان.

الكشف البشري مقابل الكشف الآلي

إذا اخترت الكشف عن الذكاء الاصطناعي بالعين المجردة فقط، فيجب أن تكون مدربًا على ذلك. لا يمكن لغير الخبراء أن يفعلوا أكثر من التخمين العشوائي. حتى اللغويون المتقدمون لا يمكنهم الكشف عن الذكاء الاصطناعي دون تدريب صريح. نوصي باستخدام كلتا الطريقتين للحصول على أفضل النتائج، مما يخلق عملية تقييم أكثر قوة وإنصافًا.

في حين أن أجهزة الكشف عن محتوى الذكاء الاصطناعي يمكنها أن تخبرك ما إذا كان شيء ما قد تم إنشاؤه بواسطة أدوات الذكاء الاصطناعي أم لا. يمكن للبشر أن يخبرك ليس فقط ما إذا كان شيء ما من إنتاج الذكاء الاصطناعي أم لا، بل يمكنهم أيضًا إضافة سياق وفروق دقيقة إضافية إلى هذا القرار. يعرف الإنسان السياق: عينات كتابات الطلاب السابقة، وكيف تبدو الكتابة على مستوى الصف الدراسي، وكيف تبدو الإجابة النموذجية للطالب على الواجب. هذا السياق مهم للغاية، حيث أن مدى ملاءمة استخدام الذكاء الاصطناعي يمكن أن يختلف بشكل كبير اعتمادًا على تعليمات الواجب.

أدوات الكشف بالذكاء الاصطناعي هي مجرد البداية. فهي ليست دليلاً قاطعاً على أن الطالب قد انتهك النزاهة الأكاديمية، بل هي نقطة بيانات أولية تستدعي إجراء مزيد من التحقيق في السياق. قد يكون استخدام الذكاء الاصطناعي غير مقصود أو عرضي أو حتى مسموحاً به في نطاق مهمتك الخاصة: هذا يعتمد على الحالة!

مكافأة: ماذا عن Humanizers؟!

أدوات الإنسانية هي أدوات تُستخدم لـ "إضفاء الطابع الإنساني" على محتوى الذكاء الاصطناعي لتجنب اكتشافه. غالبًا ما يستخدمها مؤلفو المحتوى لتغيير شكل الكتابة التي ينتجها الذكاء الاصطناعي. تقوم أدوات الإنسانية بإعادة صياغة النص وإزالة كلمات معينة وإضافة "أخطاء" شبيهة بالأخطاء البشرية إلى جزء من المحتوى. في بعض الأحيان، قد يؤدي ذلك إلى جعل النص غير قابل للقراءة أو إلى انخفاض جودته بشكل كبير. تقوم العديد من أجهزة الكشف عن الذكاء الاصطناعي بتدريب برامجها على اكتشاف النصوص التي تم إضفاء الطابع الإنساني عليها. غالبًا ما يكون استخدام أدوات الإنسانية مخاطرة لأنه قد يؤدي إلى انخفاض جودة النص بشكل كبير، وهو أمر مقلق بشكل خاص بالنسبة لأعمال الطلاب.

الآن بعد أن عرفت كيف يعملون، جرب المحتوى الخاص بك. هل هو ذكاء اصطناعي أم بشري؟

أليكس رويتمان هو رئيس قسم النمو في شركة «بانغرام لابس»، وهي شركة متخصصة في الكشف عن المحتوى المُنتج بواسطة الذكاء الاصطناعي. يركز عمله على الكيفية التي يُعيد بها النص المُنتج بواسطة الذكاء الاصطناعي تشكيل ملامح الكتابة والتعليم والثقة في شبكة الإنترنت المفتوحة.

مقالات ذات صلة

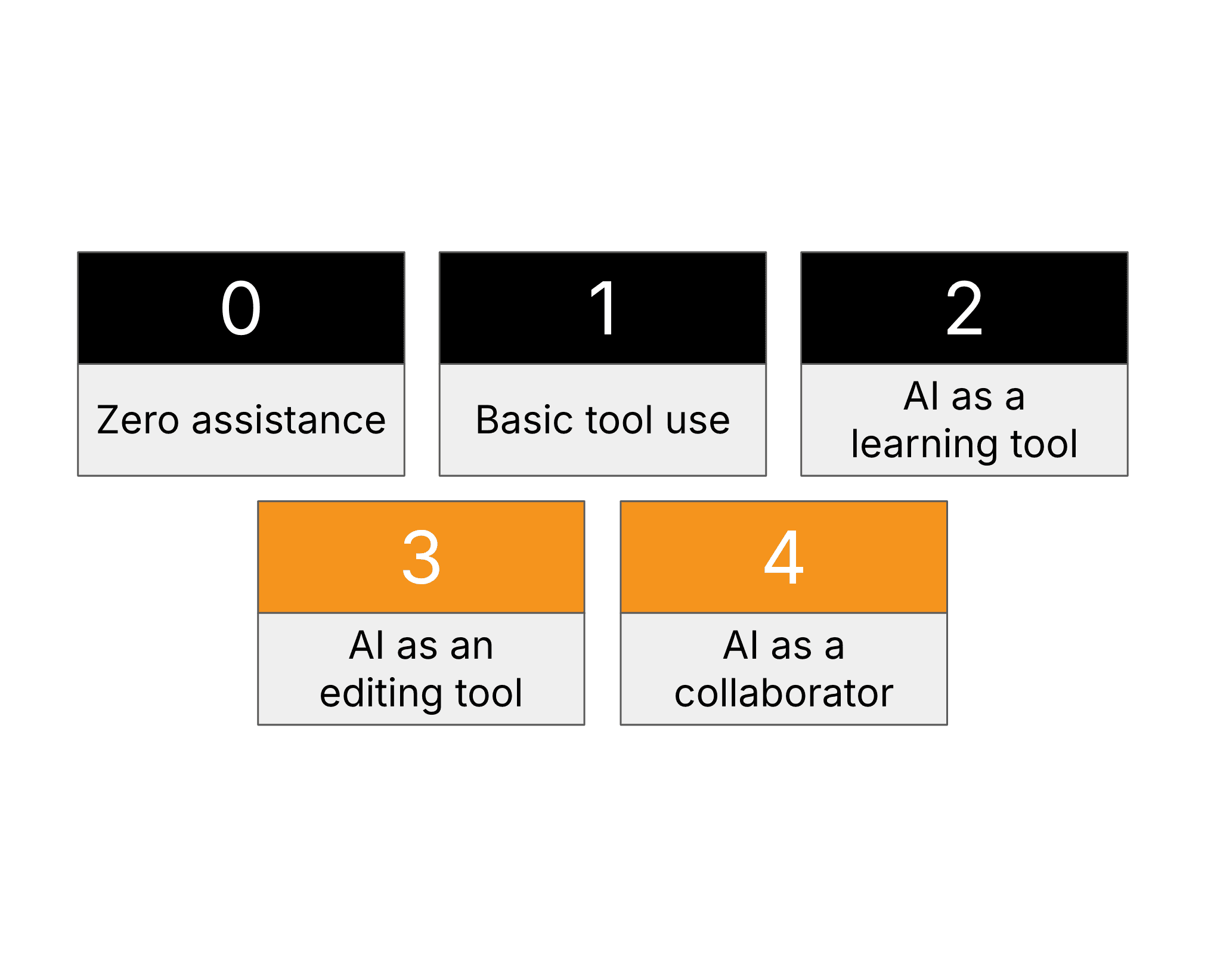

سياسات مفيدة في مجال الذكاء الاصطناعي للمعلمين

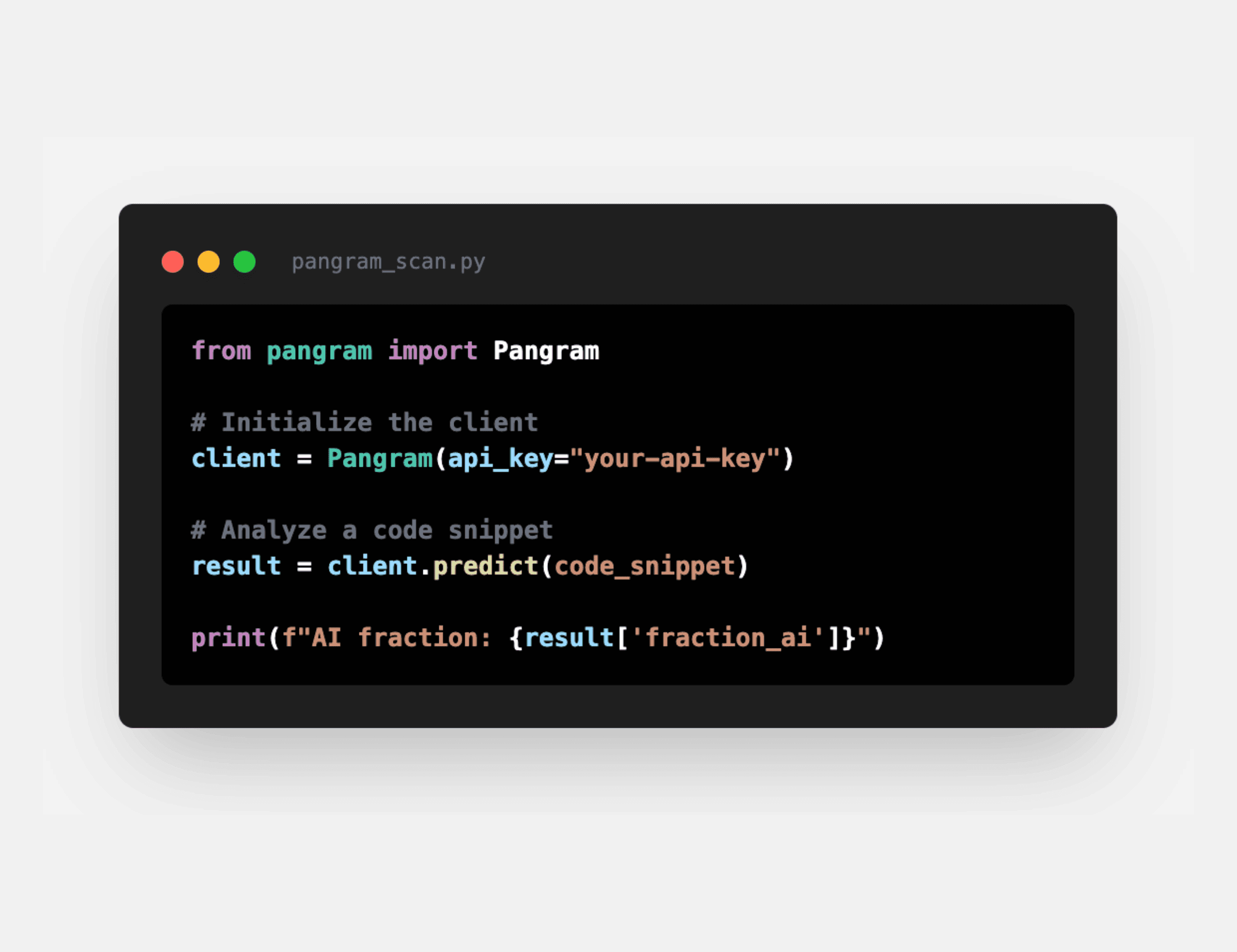

كاشف كود الذكاء الاصطناعي: كيفية التحقق مما إذا كان الكود قد كُتب بواسطة ChatGPT أو Copilot أو Claude

هل كتبته الذكاء الاصطناعي؟ 4 طرق للتحقق مما إذا كان النص قد تم إنشاؤه آليًا

دليل شامل لاكتشاف أنماط الكتابة باستخدام الذكاء الاصطناعي

أيهما أفضل: Pangram أم Turnitin؟

ماذا يحدث عندما يخطئ كاشف الذكاء الاصطناعي؟

للحصول على آخر المستجدات