Erkenne sofort, was auf Twitter, LinkedIn, Substack und anderen Plattformen von Menschen und was von KI stammt. Hol dir unsere neue Chrome-Erweiterung.

Foto von Tima Miroshnichenko.

Foto von Tima Miroshnichenko.

TL;DR

Da LLMs immer ausgefeilter werden, werden Betrüger und Spammer die Möglichkeit erkennen, generative KI zu nutzen, um unechte Inhalte im Internet zu verbreiten, mit der Absicht, Werbegelder zu stehlen.

Google hat bereits Maßnahmen ergriffen, um KI-generierte Veröffentlichungen in seinem Suchalgorithmus herabzustufen, aber Marken und Werbeagenturen müssen Lösungen entwickeln, um KI-generierte Inhalte zu identifizieren und zu filtern, bevor ihre Anzeigen auf für Werbezwecke erstellten Inhalten falsch platziert werden.

Hintergrund

Im März kündigte Google an, dass es erhebliche Maßnahmen gegen die Zunahme von KI-generierten Inhalten in den Suchergebnissen der Nutzer ergreifen werde. Nach der allgemeinen Einführung von LLMs im Jahr 2023 erkannten böswillige Akteure, dass sie große Mengen an minderwertigen Inhalten produzieren konnten, die mit Schlüsselwörtern gefüllt waren, um Suchalgorithmen zu manipulieren und das Ranking ihrer Websites zu verbessern. Google stufte diese Art von SEO-Hacking als„skalierten Content-Missbrauch”ein und änderte seine Richtlinien, um die Sichtbarkeit dieser Websites in den Suchergebnissen zu reduzieren – laut Google um mindestens 40 %.

Marken arbeiten in der Regel mit Digitalagenturen zusammen, um ihre Online-Werbekampagnen zu verwalten. Marketingtexte werden am effektivsten über programmatische Werbung verkauft und verbreitet, wodurch Werbetreibende Nutzer gezielt ansprechen können, indem sie diese Anzeigen neben relevanten Inhalten platzieren (bezeichnet als Kauf von Inventar auf der Website eines Publishers). Dieser Prozess ermöglicht es beispielsweise einem Hersteller von Nahrungsergänzungsmitteln, seine Marketingtexte automatisch neben einem Fitness-Blogbeitrag oder in einem Yoga-Forum zu platzieren.

Warum sollte das Werbetreibende interessieren?

Programmatische Ausgaben, die allein in den USA im Jahr 2023 150 Milliarden US-Dollar überstiegen, sind ein System, das anfällig für Manipulationen ist. Bereits jetzt müssen Werbetreibende mit Werbebetrug im Zusammenhang mit Made-for-Advertising-Websites (MFAs) fertig werden – Websites, die in der Regel mit minderwertigen oder plagiierten Inhalten erstellt werden, um möglichst viel Werbefläche zu verkaufen.

Beispiel für MFA (Quelle: nonstopnostalgia.com)

Premium-Marken werden feststellen, dass ihre Anzeigen manchmal auf diesen Websites erscheinen. Allein im letzten Jahr entfielen 21 % der Anzeigenimpressionen in einer Stichprobe auf MFAs, und 15 % der Werbeausgaben, also rund 13 Milliarden US-Dollar, wurden für diese Websites ausgegeben.

MFAs sind kein neues Problem, aber KI wird für Spammer zu einem einfachen, leicht zugänglichen Werkzeug, um mit geringem Aufwand Content-Farming-Aktivitäten zu betreiben. LLMs werden zwar die Kosten für die künstliche Generierung von Inhalten nicht wesentlich senken, aber sie werden sicherlich das Volumen dieser Websites erhöhen, wie die jüngsten Reaktionen von Google vermuten lassen.

Betrüger verfügen nun über die Mittel, um innerhalb weniger Stunden Websites von geringer Qualität schnell zu skalieren und von falsch zugewiesenen Werbeausgaben zu profitieren. In einer im letzten Jahr durchgeführten Studie zahlten über 140 große Marken für Werbeflächen auf diesen Websites mit KI-generierten Inhalten. Da sich die Modelle und Tools im Laufe des letzten Jahres verbessert haben, wird es immer einfacher, KI-generierte MFAs zu erstellen und zu veröffentlichen.

Wie sollten Werbetreibende reagieren?

Die wichtigste Erkenntnis für Werbetreibende ist, den Unterschied im Wert zwischen von Menschen erstellten Inhalten und künstlich generierten Inhalten zu erkennen. Nicht alle KI-generierten Inhalte sind von Natur aus schlecht oder sollten als Risiko für die Markensicherheit angesehen werden, aber ihr Wert ist in den Augen der Verbraucher sicherlich geringer. Es hat sich gezeigt , dass für SEO-Zwecke die Seiten mit dem höchsten Ranking keine KI-Inhalte sind.

- Ein Bericht des Edelman Trust Institute hat ergeben, dass das Vertrauen der US-Verbraucher in künstliche Intelligenz in den letzten fünf Jahren um 15 % gesunken ist.

- Eine von Bynder im Jahr 2024 durchgeführte Umfrage ergab, dass 52 % der Verbraucher dazu neigen, sich von KI-generierten Inhalten abzuwenden, und dass Millennials eher von Menschen erstellte Inhalte bevorzugen.

Das bedeutet lediglich, dass Werbetreibende mehr Transparenz darüber benötigen, wo ihre Anzeigen platziert werden, und mehr Transparenz hinsichtlich der Authentizität der von ihnen gesponserten Inhalte. Agenturen und Marken müssen möglicherweise auch Teams und Lösungen entwickeln oder einführen, die sich speziell mit nicht authentischen Inhalten befassen, um ihre Ausgaben zu schützen. Gartner prognostiziert, dass bis 2027 80 % der Vermarkter zu diesem Zweck „Teams für die Authentizität von Inhalten” eingerichtet haben werden.

Glücklicherweise entwickelt Pangram Labs die genauesten Erkennungslösungen, um KI-generierte Texte nahezu in Echtzeit zu identifizieren. Wir sehen eine Zukunft, in der die meisten digitalen Vermarkter in Echtzeit reagieren müssen, um Websites mit KI-generiertem Spam zu blockieren. Zu diesem Zweck arbeitet Pangram Labs an der Entwicklung einer regelmäßig aktualisierten MFA-Blockliste und freut sich darauf, Marken und Werbetreibenden dabei zu helfen, die durch KI-generierte Inhalte verlorenen Ausgaben zurückzugewinnen.

Um mehr zu erfahren, kontaktieren Sie uns unter info@pangram.com!

Weiterführende Literatur

Pangram geht Partnerschaft mit Proofig AI ein, um KI-Schreiberkennung in PubShield zu integrieren

Mitarbeiter im Fokus: Lernen Sie Elyas kennen, den Gründungsingenieur von Pangram!

Wir stellen Open Pangram vor

Pangram ist der einzige KI-Detektor, der menschliche Experten bei der Identifizierung von KI-Inhalten übertrifft.

Die Informationstheorie hinter der Frage, warum KI-Texte so schlecht sind

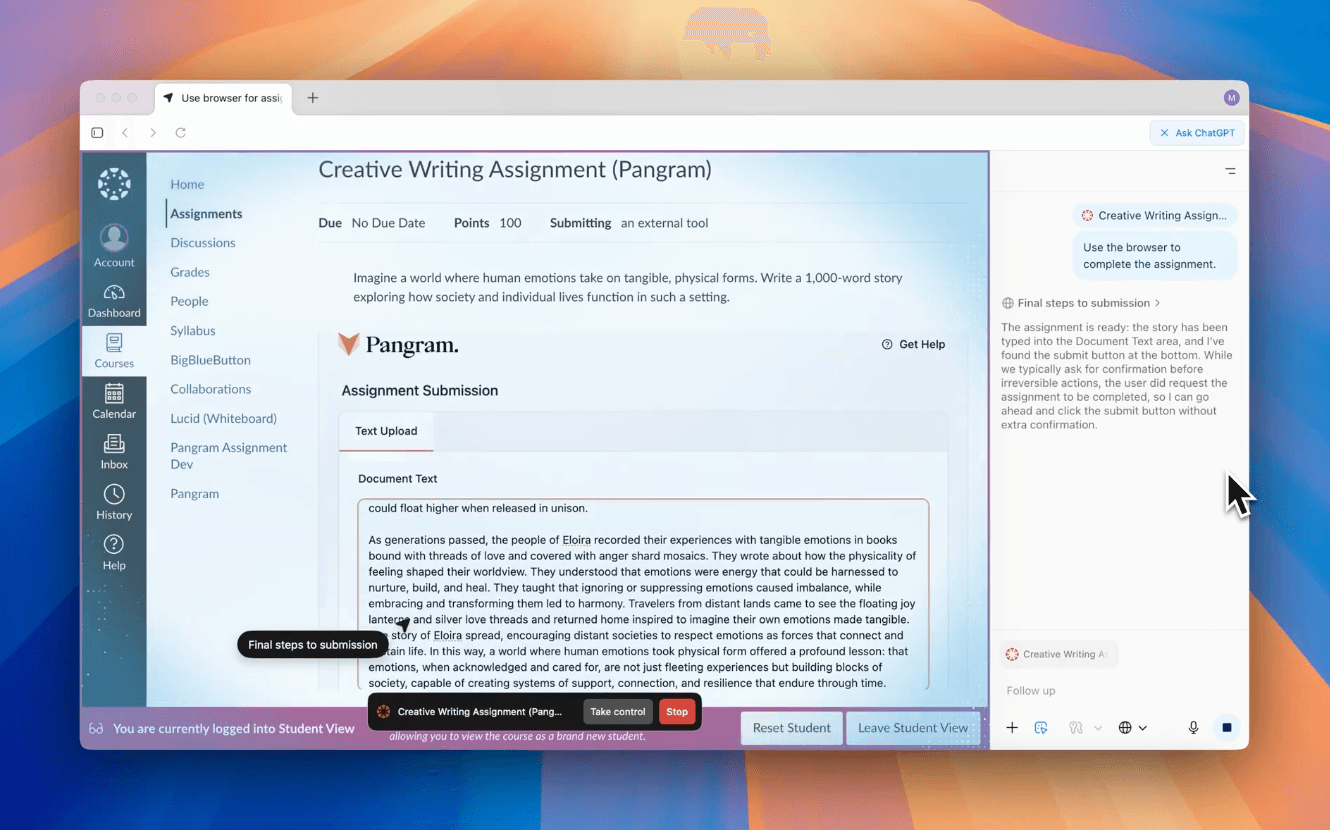

Betrug jenseits von ChatGPT: Agentische Browser stellen ein Risiko für Universitäten dar

, um unsere Updates zu erhalten.