Erkenne sofort, was auf Twitter, LinkedIn, Substack und anderen Plattformen von Menschen und was von KI stammt. Hol dir unsere neue Chrome-Erweiterung.

KI-Erkennung für Vertrauen und Sicherheit

KI-gestützte Inhaltsmoderation für Teams im Bereich Vertrauen und Sicherheit

Wir bieten Unternehmenskunden eine bedarfsorientierte KI-Erkennung über eine API an. Skalieren Sie Ihre Content-Moderation mit dem präzisesten KI-Erkennungssystem – zu einem Bruchteil der Kosten einer manuellen Überprüfung.

- und Sicherheitsteams geschätzt

Von den Gründern

Ein Hinweis an die Teams für Vertrauen und Sicherheit

Vor Pangram habe ich bei Google und Yelp gearbeitet, wo ich die Gefahren betrügerischer Inhalte aus erster Hand erlebt habe. Als KI-Forscher glauben wir daran, dass KI eine Kraft zum Guten in der Welt ist, und wollen verhindern, dass KI dazu missbraucht wird, die Realität und Wahrheit an Orten zu verzerren, an denen Inhalte vertrauenswürdig sein müssen.

Wir haben Pangram hier ins Leben gerufen und sind der Überzeugung, dass die Flut von KI-generierten Inhalten im Internet eines der größten Probleme unserer Zeit ist. Zu Beginn hatten wir uns zum Ziel gesetzt, den genauesten KI-Detektor auf dem Markt zu entwickeln, und dank unserer Forschungsdurchbrüche ist es uns gelungen, einen Klassifikator mit höchster Genauigkeit und der niedrigsten Falsch-Positiv-Rate zu trainieren.

Wir unterstützen Trust-and-Safety-Teams dabei, ihre Initiativen kostengünstig auszuweiten. Pangram stellt Teams die Tools zur Verfügung, die sie benötigen, um Richtlinien sicher festzulegen und KI-Inhalte effektiv zu moderieren – damit von Menschen erstellte Inhalte erhalten bleiben und KI-generierte Inhalte gemäß den Unternehmensrichtlinien gekennzeichnet werden.

— Max, Mitbegründer von Pangram Labs

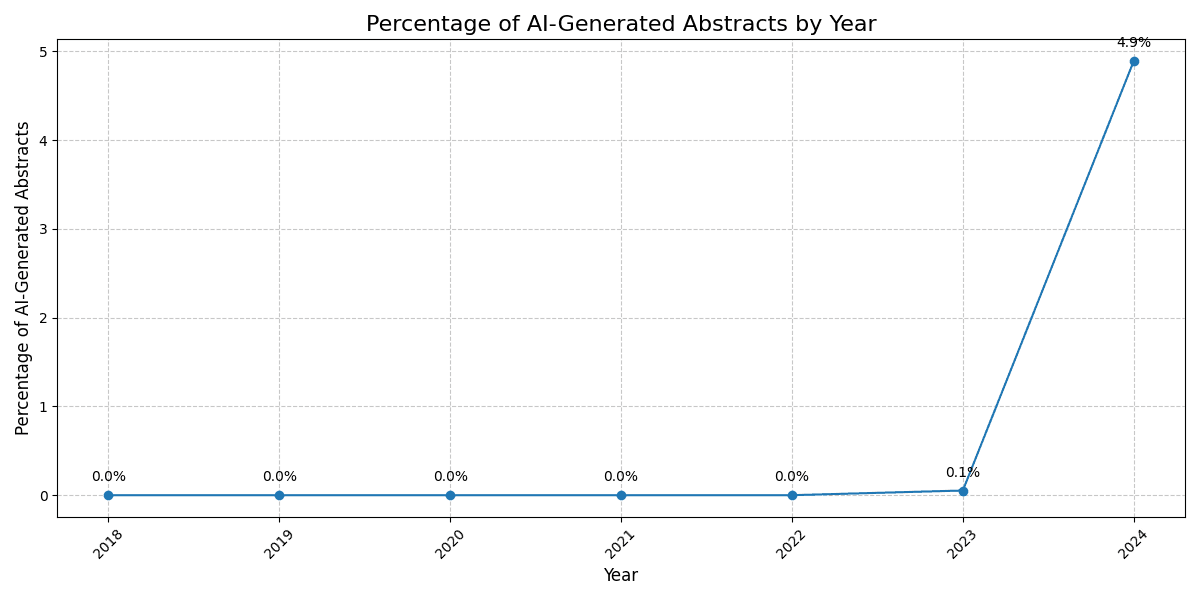

Warum das wichtig ist

Von KI verfasste Bewertungen untergraben das Vertrauen

und schaden dem Ruf der Plattform.

Einhaltung der FTC-Vorschriften

Die Federal Trade Commission hat Vorschriften zum Verbot gefälschter Bewertungen, einschließlich KI-generierter Bewertungen, bekannt gegeben. Stellen Sie die Einhaltung der Vorschriften sicher, indem Sie künstlich erzeugte Inhalte erkennen und kennzeichnen, bevor sie auf Ihrer Plattform erscheinen.

Integrität der Rangliste

Von KI verfasste Bewertungen sind nicht nur für Verbraucher wenig hilfreich, sondern täuschen auch Ranking-Systeme, die KI-Bewertungen aufgrund ihres ausführlichen Textes und der korrekten Grammatik oft hoch einstufen. Schützen Sie die Ranking-Qualität Ihrer Plattform.

Urheberrechtsschutz

„Wenn eine KI-Technologie die gestalterischen Elemente ihrer Ausgabe bestimmt, ist das generierte Material nicht das Werk eines menschlichen Urhebers.“ – US-amerikanisches Urheberrechtsamt, März 2023

Umfang und Genauigkeit

Erweitern Sie Ihre Moderations

, ohne dass die Kosten steigen

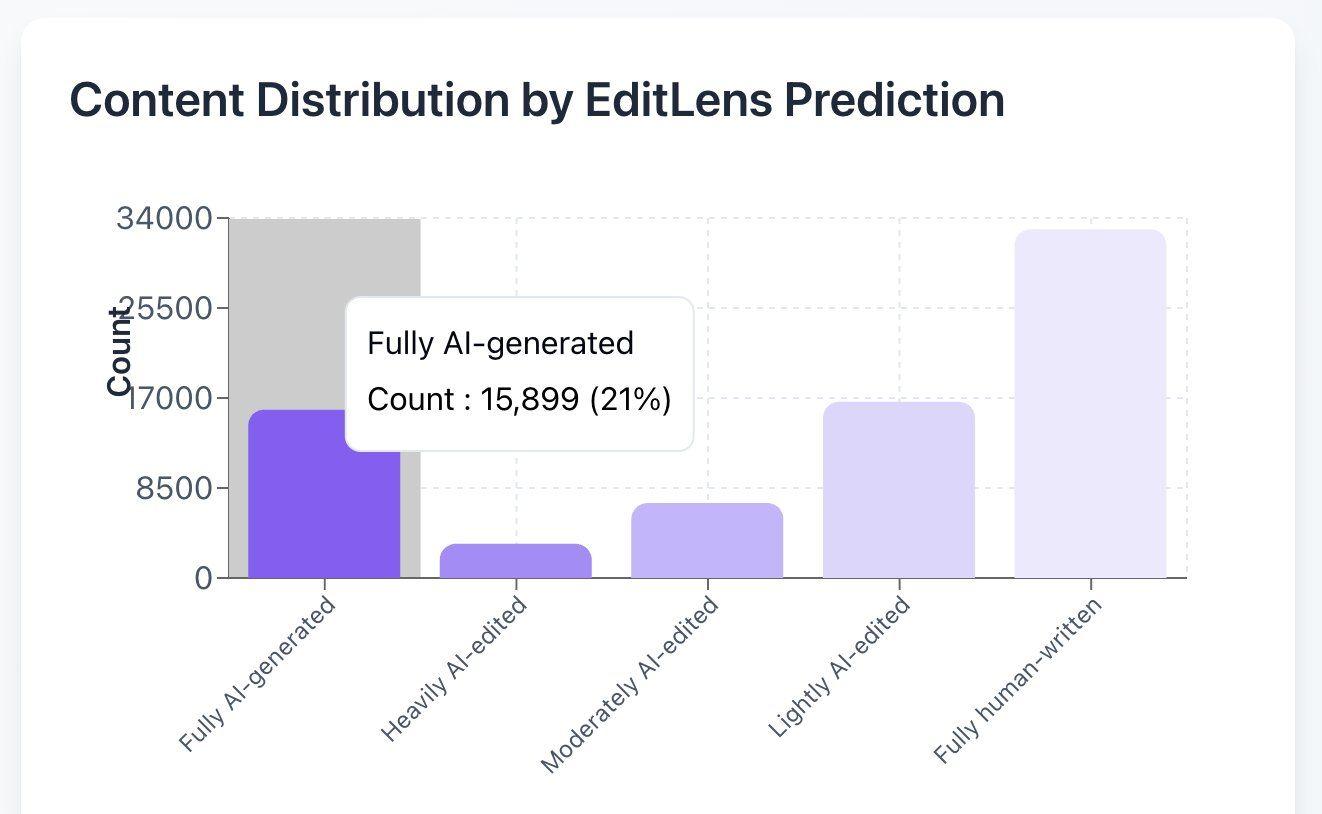

Pangram hilft dabei, Trust-and-Safety-Teams zu einem Bruchteil der Kosten zu vergrößern, unterstützt zeitlich stark beanspruchte Sicherheitsteams und senkt gleichzeitig die Kosten.

100-mal kostengünstiger

Die manuelle Überprüfung von Inhalten ist kostspielig und zeitaufwendig. Pangram ist der einzige KI-Detektor, der bei der Erkennung von KI-Inhalten besser abschneidet als menschliche Experten und so dazu beiträgt, diesen Arbeitsablauf zu automatisieren und gleichzeitig Kosten zu senken.

Erkennung von Kurzformen

Kurze Social-Media-Beiträge, Direktnachrichten und Kommentare sind für herkömmliche KI-Detektoren oft zu kurz. Das Modell von Pangram erkennt KI-Inhalte bereits ab einer Länge von 75 Wörtern und kann mehrere Inhalte gleichzeitig scannen, um ein besseres Ergebnis zu erzielen.

Technologischer Vorsprung

Entwickelt von KI-Forschern bei Tesla und Google mit dem Ziel, eine außergewöhnliche Genauigkeit zu erreichen. Unsere firmeneigene „Hard Negative Mining“-Methode sorgt für eine Genauigkeit von 99,99 % und die niedrigste Falsch-Positiv-Rate auf dem Markt.

Häufig gestellte Fragen

Häufig gestellte Fragen zur KI-Erkennung

Suchen Sie nach Antworten? Entdecken Sie häufig gestellte Fragen

und erhalten Sie alle benötigten Informationen an einem Ort.

Pangram bietet eine RESTful-API mit umfassender Dokumentation und einem Python-SDK. Die meisten Teams integrieren die Erkennung als Schritt vor der Moderation – sie scannen nutzergenerierte Inhalte vor der Veröffentlichung oder leiten markierte Inhalte zur Überprüfung an menschliche Moderatoren weiter. Die Integration dauert in der Regel weniger als einen Tag.

Die Falsch-Positiv-Rate von Pangram liegt bei etwa 1 zu 10.000 – das ist der branchenweit niedrigste Wert. Dies ist besonders wichtig für Plattformen, auf denen die fälschliche Kennzeichnung legitimer Nutzer das Vertrauen und die Nutzeraktivität beeinträchtigen kann.

Ja. Im Gegensatz zu den meisten Detektoren, die längere Texte erfordern, kann Pangram KI-Inhalte bereits in Texten mit einer Länge von nur 75 Wörtern zuverlässig erkennen. Bei noch kürzeren Inhalten können wir mehrere Texte desselben Autors zusammenfassen, um ein aussagekräftigeres Ergebnis zu erzielen.

Pangram ist nach SOC 2 Typ 2 zertifiziert. Über die API übermittelte Inhalte werden vorübergehend verarbeitet und anschließend gelöscht – sie werden weder gespeichert noch indexiert oder für das Modelltraining verwendet. Dies steht im Einklang mit den Anforderungen der DSGVO und den Richtlinien für den Umgang mit Unternehmensdaten.

Ja. Pangram unterstützt die KI-Erkennung in über 20 Sprachen mit einer Genauigkeit von über 99 %, darunter Spanisch, Französisch, Arabisch, Chinesisch und viele weitere. Damit eignet es sich für globale Plattformen mit einer vielfältigen Nutzerbasis.

Ja. Unsere API unterstützt die Stapelverarbeitung für Anwendungsfälle mit hohem Durchsatz. Viele Teams für Vertrauen und Sicherheit führen nächtliche oder stündliche Scans neuer Inhalte durch und kennzeichnen verdächtige Beiträge zur Überprüfung. Die API verarbeitet Tausende von Anfragen pro Stunde mit gleichbleibender Latenz. Erfahren Sie, wie Publisher Pangram für die Überprüfung großer Inhaltsmengen nutzen.

Mehr entdecken

KI-Erkennung für

jedes Unternehmens

Für Verlagswesen und Medien

KI-Erkennung für Verlage und Redaktionsteams. Schützen Sie die redaktionelle Integrität und überprüfen Sie die Authentizität von Inhalten in großem Umfang bei minimaler Falsch-Positiv-Rate.

Mehr erfahren →Für Entwickler

KI-Code-Erkennung für Entwickler und Technikteams. Erkennen Sie von ChatGPT, Copilot und Claude generierten KI-Code in Python, Java, C++ und weiteren Sprachen.

Mehr erfahren →Für Anwaltskanzleien

KI-Erkennung für Anwaltskanzleien und Juristen. Erkennen Sie KI-generierte Schriftsätze, überprüfen Sie Rechtszitate und stellen Sie bei jeder Einreichung die authentische Urheberschaft sicher.

Mehr erfahren →Erweitern Sie Ihre Maßnahmen im Bereich Vertrauen und Sicherheit.

Erkennen Sie KI-generierte Inhalte in großem Umfang, schützen Sie die Integrität Ihrer Plattform und senken Sie die Moderationskosten um das 100-Fache.

, um unsere Updates zu erhalten.