Erkenne sofort, was auf Twitter, LinkedIn, Substack und anderen Plattformen von Menschen und was von KI stammt. Hol dir unsere neue Chrome-Erweiterung.

Inhaltsverzeichnis

- Setzen juristische Fakultäten KI-Detektoren bei Zulassungsaufsätzen ein?

- Werden bei Aufgaben an juristischen Fakultäten KI-Detektoren eingesetzt?

- Das Problem mit dem „Juristenjargon“: Bekomme ich ein falsch positives Ergebnis?

- Umgang mit KI-Richtlinien in der juristischen Ausbildung

- Bewährte Methoden zum Schutz Ihrer akademischen Leistungen

Ein Jurastudium ist mit viel Lese- und Schreibarbeit verbunden. Der Einsatz generativer KI-Tools wie ChatGPT ist sehr verlockend, zumal diese persönliche Statements, Fallzusammenfassungen und Forschungsmemos entwerfen können.

Dieser Leitfaden befasst sich damit, wie sich die Richtlinien verschiedener juristischer Fakultäten entwickeln und warum Sie äußerst vorsichtig sein müssen, wenn es darum geht, wie KI in Ihre juristische Ausbildung integriert wird.

Setzen juristische Fakultäten KI-Detektoren bei Zulassungsaufsätzen ein?

Die Antwort auf diese Frage lautet „Ja“. Viele Zulassungsstellen von juristischen Fakultäten, unabhängige Studienberater für angehende Juristen und Anwaltskanzleien setzen aktiv KI-Erkennungssoftware ein, um sicherzustellen, dass die persönlichen Statements und Diversity-Aufsätze, aus denen sich eine Bewerbung zusammensetzt, tatsächlich von dem jeweiligen Bewerber verfasst wurden.

Jurafakultäten möchten Bewerber aufnehmen, die einzigartige Perspektiven und eine authentische Stimme mitbringen sowie über die intellektuelle Stärke verfügen, ihr Studium erfolgreich zu absolvieren. Ein von ChatGPT verfasster Aufsatz ist von Natur aus sehr allgemein gehalten und verfehlt letztlich den Zweck eines Motivationsschreibens.

Bei der Zulassung zu juristischen Fakultäten kommt bereits zu Beginn des Verfahrens KI-Erkennung zum Einsatz. Führende Zulassungsberater – wie beispielsweise Gradpilot – integrieren Tools wie Pangram direkt in ihren Bewertungsprozess. Auf diese Weise können sie feststellen, ob sich ein Bewerber übermäßig auf KI stützt, noch bevor der Aufsatz überhaupt beim LSAC eingereicht wird.

Werden bei Aufgaben an juristischen Fakultäten KI-Detektoren eingesetzt?

Ja, Stellen für akademische Integrität und Rechtsprofessoren nutzen in ihre Lernmanagementsysteme integrierte KI-Detektoren auf Unternehmensniveau, um alle Arten von Aufgaben an juristischen Fakultäten zu überprüfen. Zu den Aufgaben, die sie überprüfen, gehören unter anderem juristische Schreibaufgaben, Forschungsmemos und Hausarbeiten.

In jeder Art von juristischer Schriftstück sind Genauigkeit und Authentizität unabdingbar. Der Einsatz von LLMs wie ChatGPT ist problematisch, da diese dazu neigen, Rechtsprechung, Zitate und juristische „Fakten“ zu erfinden. Aus diesem Grund birgt das Verlassen auf KI bei juristischen Arbeiten nicht nur das Risiko einer Plagiatsanklage, sondern auch das Risiko schwerwiegender akademischer Sanktionen wegen der Erfindung von Rechtsprechungsfällen.

Dozenten nutzen KI-Bewertungen als Diagnoseinstrument. Sie kombinieren die Diagnose eines KI-Detektors für juristische Fakultäten mit ihrem eigenen Wissen über die bisherigen schriftlichen Fähigkeiten eines Studierenden, um akademische Unredlichkeit aufzudecken. Dieser mosaikartige Ansatz erleichtert, wenn er angewendet wird, die Aufdeckung von KI-Nutzung.

Das Problem mit dem „Juristenjargon“: Bekomme ich ein falsch positives Ergebnis?

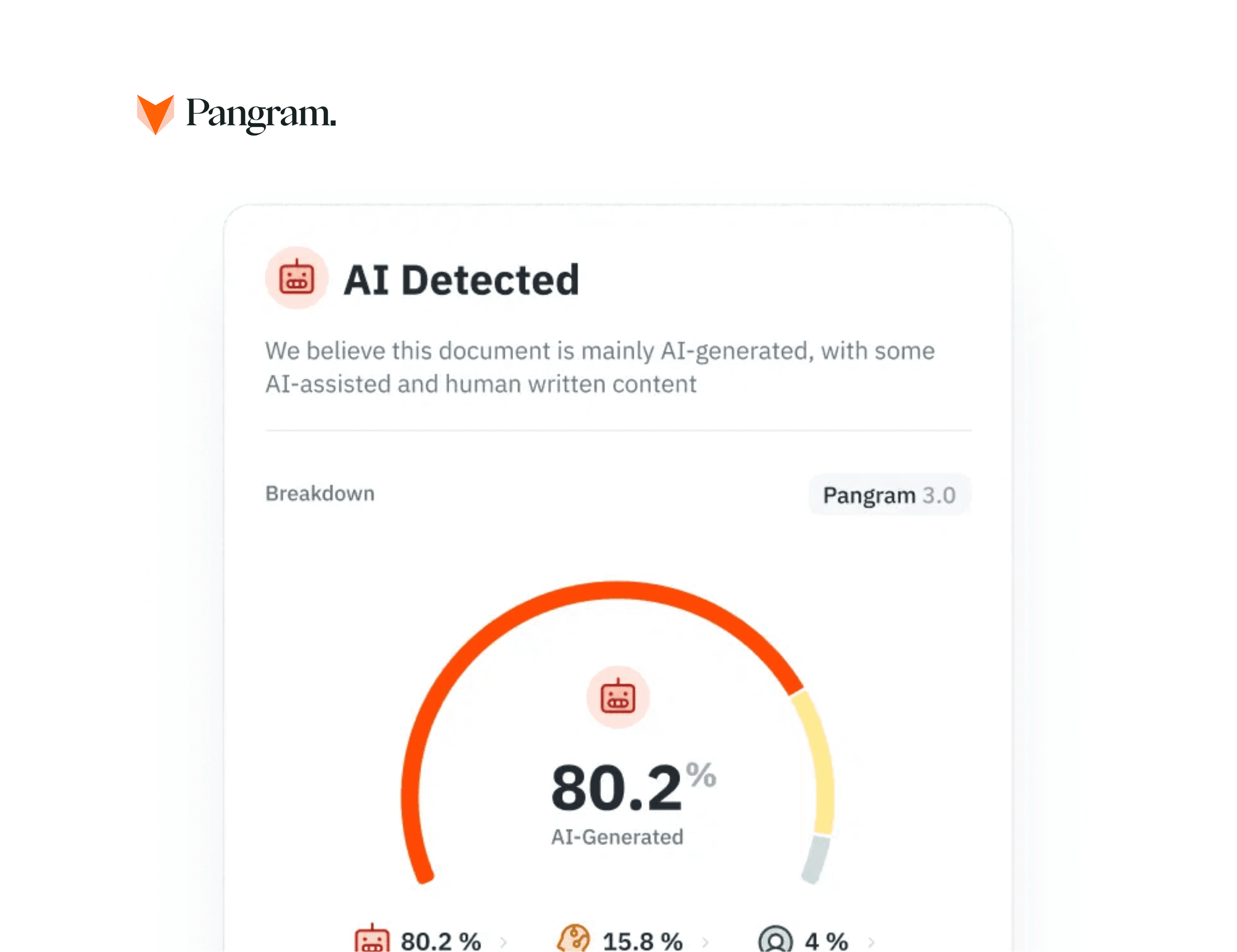

Die gängigen, kostenlosen KI-Detektoren sind dafür bekannt, dass sie sehr formelle, strukturierte Texte – beispielsweise juristische Schriftsätze – fälschlicherweise als KI-generiert einstufen. Dies trifft jedoch nicht auf die professionellen Tools zu, die Universitäten zur Überprüfung juristischer Dokumente auf KI-Einsatz nutzen; diese Tools sind darauf trainiert, diesen Fehler zu vermeiden und präzise KI-Bewertungen zu liefern.

Standardmäßige, kostenlose KI-Detektoren suchen nach Perplexity. Perplexity ist ein Maß für statistische Überraschung, was bedeutet, dass einfache KI-Detektoren auf Vorhersehbarkeit und ein hohes Maß an Struktur achten, um den Einsatz von KI zu erkennen.

Dokumente wie die „Unabhängigkeitserklärung“ sind sehr strukturiert und vorhersehbar, weshalb viele einfache KI-Detektoren sie als KI-Text kennzeichnen. Die von Universitäten verwendeten Tools sind bei ihren Bewertungen jedoch weitaus genauer.

Wenn du ein Student bist, der seine Arbeiten selbst verfasst und KI nur in zulässiger Weise nutzt, brauchst du dir keine Sorgen zu machen. Hochwertige Tools für Hochschulen, wie beispielsweise Pangram, verwenden „Hard Negative Mining“, um formale, korrekte Syntax von KI-generiertem Text zu unterscheiden. Dies führt zu einer Falsch-Positiv-Rate von nahezu Null, nämlich 1 zu 10.000.

Umgang mit KI-Richtlinien in der juristischen Ausbildung

Jede juristische Fakultät hat ihre eigenen Richtlinien zum Einsatz von KI. Manche Professoren sind streng: KI ist gänzlich verboten. Andere Professoren stehen der Technologie weitaus offener gegenüber und integrieren KI in ihre Lehrpläne, um angehenden Juristen den verantwortungsvollen Umgang mit Legal Tech beizubringen.

Derzeit setzt die Rechtsbranche generative KI für Routineaufgaben ein. Zu diesen Aufgaben gehören unter anderem die Prüfung von Dokumenten und die Analyse von Verträgen. Aus diesem Grund gestatten einige Professoren den Einsatz von KI zum Brainstorming oder zur Gliederung – allerdings meist nur unter der Voraussetzung, dass man einen Quellenverweis auf die verwendete KI angibt.

Wenn im Lehrplan einer bestimmten juristischen Fakultät oder eines bestimmten Rechtsprofessors nicht ausdrücklich angegeben ist, dass die Verwendung eines LLM für eine Hausarbeit erlaubt ist, sollten Sie davon ausgehen, dass die Verwendung eines LLM strengstens untersagt ist. Falls es an der juristischen Fakultät eine Richtlinie zu ChatGPT oder eine Reihe von Leitlinien zur Verwendung von LLMs gibt, sollten Sie sich an diese Richtlinie bzw. diese Leitlinien halten.

Das Einreichen von KI-generierten Texten jeglicher Art ohne entsprechenden Hinweis gilt allgemein als akademischer Betrug. Wenn Sie des akademischen Betrugs für schuldig befunden werden, drohen Ihnen schwerwiegende Konsequenzen – wobei der Ausschluss aus der Hochschule eine der gravierendsten ist.

Bewährte Methoden zum Schutz Ihrer akademischen Leistungen

Jura-Studierende und Studienbewerber sollten diese bewährten Vorgehensweisen befolgen, um ihre akademische Laufbahn zu schützen: Verfassen Sie Ihre Arbeiten stets selbst, dokumentieren Sie den Versionsverlauf, bewahren Sie diesen auch nach Einreichung der Arbeit auf und überprüfen Sie Ihre Dokumente vorab, um sicherzustellen, dass Sie keine KI für kleinere grammatikalische Korrekturen, zum Brainstorming oder für andere Zwecke verwendet haben.

Neben der Anwendung dieser bewährten Methoden sollten Sie Ihren Text auf typische KI-Ausdrücke überprüfen. Die Wörter „delve“, „tapestry“ und „pivotal“ gehören zu den häufigsten KI-Ausdrücken. Wenn Sie diese Wörter zu häufig verwenden, könnte dies Misstrauen wecken und den Eindruck erwecken, dass Sie KI eingesetzt haben.

Wenn Sie ein KI-Tool zur Rechtschreibprüfung verwenden, kann ein fortschrittlicher KI-Prüfer für juristische Texte wie Pangram zwischen „leicht KI-unterstützten“ Grammatikprüfungen und „vollständig KI-generierten“ Texten unterscheiden. Diese Unterscheidung kann Ihnen dabei helfen, nachzuweisen, dass Sie die Kernargumente eines bestimmten Dokuments selbst verfasst haben.

Die juristischen Fakultäten beobachten den Einsatz von KI aufmerksam, um die Integrität des Rechtswesens und der darin tätigen Personen zu schützen.

Zwar ist KI ein leistungsstarkes Werkzeug für die Synthese, doch kann sie die fundierte juristische Argumentation und das kritische Denken, die für den Erwerb eines JD-Abschlusses erforderlich sind, nicht ersetzen.

Stellen Sie sicher, dass Ihr persönliches Statement oder Ihr juristisches Memo vollständig von Ihnen selbst verfasst wurde. Überprüfen Sie die Echtheit Ihres Textes, bevor Sie ihn einreichen.

Weiterführende Literatur

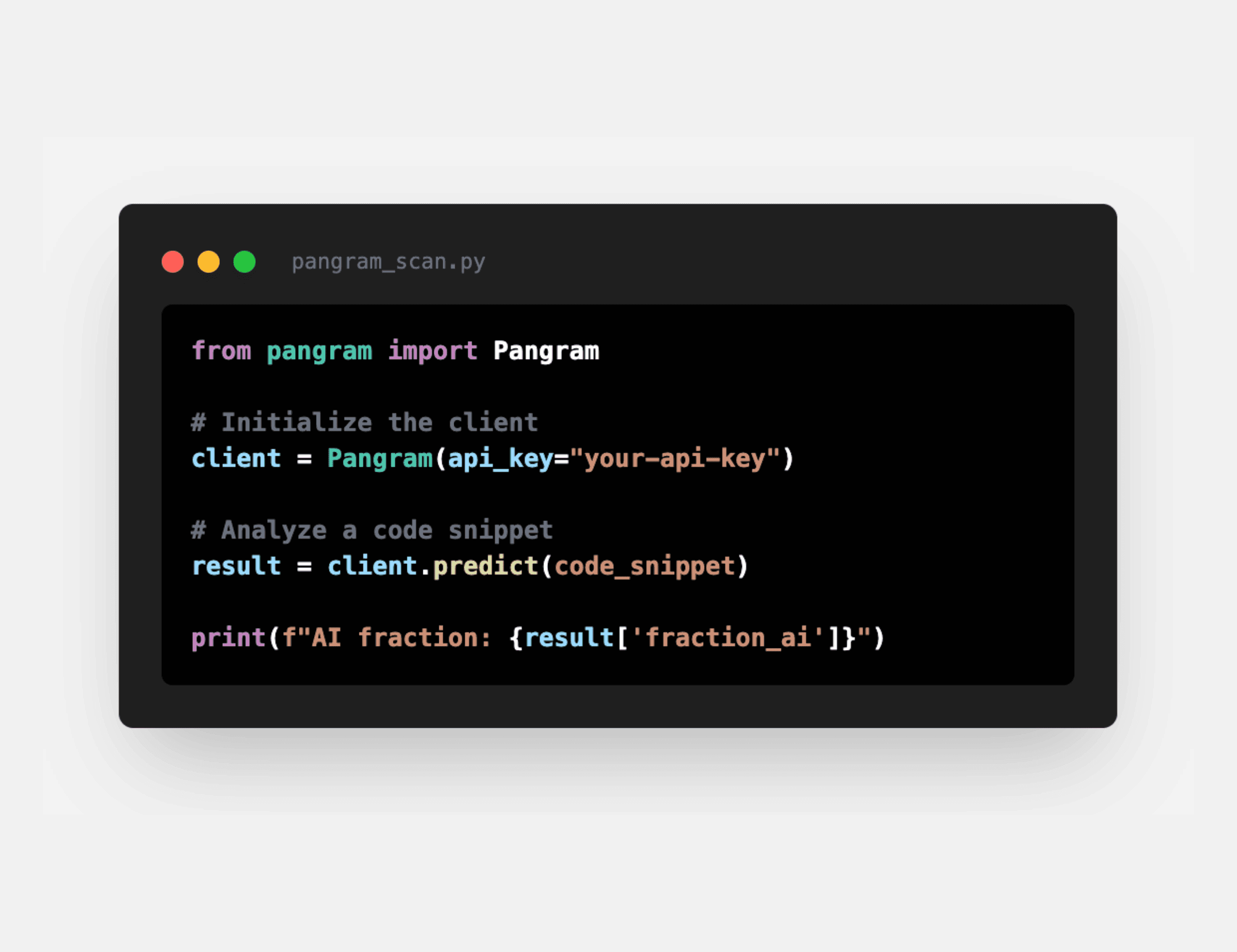

Wie gut funktioniert Pangram bei KI-Code?

Was bedeutet Ihr KI-Erkennungswert?

AI-Code-Detektor: So überprüfen Sie, ob Code von ChatGPT, Copilot oder Claude geschrieben wurde

Hat eine KI das geschrieben? 4 Möglichkeiten, um zu überprüfen, ob ein Text generiert wurde

Ein mosaikartiger Ansatz für akademische Integrität im Zeitalter der KI (mit Chris Ostro)

Vorstellung der Plagiatserkennung von Pangram

, um unsere Updates zu erhalten.