Erkenne sofort, was auf Twitter, LinkedIn, Substack und anderen Plattformen von Menschen und was von KI stammt. Hol dir unsere neue Chrome-Erweiterung.

Inhaltsverzeichnis

- 🤗 Modelle & Datensätze

- Quellcode

- Warum veröffentlichen wir eine offene Version von Pangram?

- EditLens und KI-gestützte Erkennung

- Datensätze

- Modelle

- Bewertungen

- Domäneninterner Testdatensatz

- Ergebnisse der binären Klassifizierung

- Ergebnisse der ternären Klassifizierung

- Betroffene Domain (Enron-E-Mails)

- Ergebnisse der binären Klassifizierung

- Ergebnisse der ternären Klassifizierung

- Vorläufiges Modell (Llama 3.3 70B Instruct)

- Ergebnisse der binären Klassifizierung

- Ergebnisse der ternären Klassifizierung

- Benchmarks von Drittanbietern

- Nicht-Muttersprachler (Liang et al., 2023)

- Human Detectors (Russell et al., 2024)

- RAID, zufällige Stichprobe von 10.000 Datensätzen (Dugan et al., 2024)

- Grammarly-Datensatz

- Wofür sollte Open Pangram verwendet werden?

- Wofür sollte Open Pangram NICHT verwendet werden?

🤗 Modelle & Datensätze

Quellcode

Wir sind stolz und freuen uns, zwei Versionen von Pangram vorstellen zu können, die auf der EditLens-Technologie basieren, die wir in unserem ICLR-Beitrag von 2026 vorgestellt haben. Diese beiden ressourcenschonenden Modelle stehen unter der CC BY-NC-SA 4.0-Lizenz für nichtkommerzielle Zwecke zur Verfügung und können auf einem MacBook ausgeführt werden.

Warum veröffentlichen wir eine offene Version von Pangram?

Wir haben uns schon immer intensiv mit dem Stand der KI-Erkennung beschäftigt und möchten anderen Forschern ermöglichen, in diesem Bereich Fortschritte zu erzielen. Wir haben bereits zuvor einen Beitrag zur Community geleistet, indem wir unser EditLens-Papier veröffentlicht haben, das neuartige Methoden zur Analyse und Klassifizierung von KI-generierten Inhalten vorstellt, groß angelegte Analysen von Peer-Reviews und amerikanischen Zeitungen durchgeführt haben und Forschern API-Zugänge zur Verfügung gestellt haben. Durch die Veröffentlichung der EditLens-Modell-Checkpoints, des Trainingsdatensatzes und des Quellcodes hoffen wir, dass Forscher auf unserer Arbeit aufbauen können.

EditLens und KI-gestützte Erkennung

Die KI-Erkennung muss sich mit der Weiterentwicklung generativer KI weiterentwickeln. Eine aktuelle Studie von OpenAI ergab, dass zwei Drittel aller Schreibanfragen an ChatGPT die Bearbeitung von benutzereingebrachtem Text betreffen, anstatt diesen von Grund auf neu zu generieren. Angesichts dieses sich abzeichnenden Paradigmas, bei dem Menschen und KI gemeinsam Texte verfassen, haben wir ein neuartiges Erkennungsframework entwickelt, das berücksichtigt, inwieweit KI zu einem Text beigetragen hat. Pangram-Nutzern ist vielleicht aufgefallen, dass unser Modell Ergebnisse wie „Lightly AI-Assisted“ (leicht KI-unterstützt) oder „Moderately AI-Assisted“ (mäßig KI-unterstützt) liefert. Diese Klassifizierungen werden durch die Technologie ermöglicht, die in unserem ICLR-2026-Forschungsartikel„EditLens: Quantifying the Extent of AI Editing in Text“ vorgestellt wird. Darin wird ein KI-Erkennungsmodell vorgestellt, das einen Wert zwischen 0 und 1 zurückgibt, wobei 0 für vollständig von Menschen verfassten Text und 1 für vollständig von KI generierten Text steht. Mit der Veröffentlichung unseres Datensatzes und des Quellcodes kann nun jeder sein eigenes EditLens-Modell trainieren.

Datensätze

Wir veröffentlichen den EditLens-Datensatz mit 60.000 Trainings-, 2.400 Validierungs- und 6.000 Testbeispielen. Jeder Teil besteht aus vollständig von Menschen verfassten, vollständig von KI generierten und von KI bearbeiteten Texten aus vier Themenbereichen. Die KI-bearbeiteten Texte wurden generiert, indem eine Bearbeitungsanweisung auf einen von Menschen verfassten Quelltext aus einem von fünf Bereichen angewendet wurde: Nachrichten (Narayan et al., 2018 und See et al., 2017), kreatives Schreiben (Fan et al., 2018), Amazon-Rezensionen (Zhang et al., 2015), Google-Rezensionen (Li et al., 2022) und bildungsbezogene Webinhalte (Lozhkov et al., 2024).

Die Modelle, die zur Erstellung der KI-generierten und KI-bearbeiteten Texte verwendet wurden, waren die von OpenAI gpt-4.1-2025-04-14 , von Anthropic claude-sonnet-4-20250514 und Googlesgemini-2.5-flash.

Der EditLens-Datensatz enthält außerdem zwei Bewertungs-Splits außerhalb des Trainingsbereichs: 6.000 Beispiele aus einem zurückbehaltenen Quelltextbereich (E-Mails) und eine von Meta generierte Version des Test-Splits Llama-3.3-70B-Instruct-Turbo .

Darüber hinaus veröffentlichen wir einen von uns zusammengestellten Datensatz mit fast 1.800 Texten, die mit Grammarly bearbeitet wurden. Dieser Datensatz umfasst 9 verschiedene Bearbeitungsvorschläge für 200 von Menschen verfasste Ausgangstexte. Jeder dieser Bearbeitungsvorschläge (z. B. „Vereinfachen Sie dies“) ist ein Vorschlag aus dem integrierten Textverarbeitungsprogramm von Grammarly. Die 200 von Menschen verfassten Quelltexte stammen aus einem der Datensätze Persuade 2.0 (Crossley et al., 2024), ELLIPSE (Crossley et al., 2023), BAWE (Nesi et al., 2004), ICNALE (Ishikawa et al., 2007), CLASSE (Crossley et al., 2024) oder PIILO (Holmes et al., 2023) stammen.

Sie können beide Datensätze auf HuggingFace erkunden.

Modelle

pangram/editlens_Llama-3.2-3B wurde mit QLoRA bei einer maximalen Sequenzlänge von 1024 Tokens feinabgestimmt. Das Basismodell verfügt über 3 Milliarden Parameter.

Pangram/editlens_roberta-large, ein Modell mit 355 Millionen Parametern, wurde mit einer maximalen Sequenzlänge von 512 Tokens feinabgestimmt.

Beide Modelle wurden gemäß der im EditLens-Artikel beschriebenen Methode für eine Epoche trainiert. Weitere Hyperparameter und den Trainingscode für beide Modelle finden Sie im GitHub-Repository von EditLens. Die Modell-Checkpoints können Sie von HuggingFace herunterladen.

Bewertungen

Sowohl für die binäre als auch für die ternäre Klassifizierung ermitteln wir die Schwellenwerte durch Kalibrierung am zurückgehaltenen Validierungssatz.

Bei den binären Bewertungen ermitteln wir den Schwellenwert, der den F1-Score für die Unterscheidung zwischen vollständig von Menschen verfassten und vollständig von KI generierten Texten maximiert. In den binären Bewertungen gibt es keine von KI bearbeiteten Texte.

Für die dreistufigen Bewertungen ermitteln wir zwei Schwellenwerte. Zunächst unterteilen wir die Bewertungsdaten in drei Kategorien: „menschlich“, „KI“ und „KI-bearbeitet“. Anschließend ermitteln wir einen unteren Schwellenwert, der die Klasse „menschlich“ von der Vereinigung der Daten der Klassen [KI, KI-bearbeitet] trennt, sowie einen oberen Schwellenwert, der die Klasse „KI“ von der Vereinigung der Daten der Klassen [menschlich, KI-bearbeitet] trennt. Beide Schwellenwerte werden durch Maximierung des F1-Scores ermittelt.

Domäneninterner Testdatensatz

Ergebnisse der binären Klassifizierung

2.038 von Menschen verfasste und 2.046 KI-generierte Texte

| Detektor | Makro F1 | FPR | FNR |

|---|---|---|---|

| Pangram 3.2 (aktuelles Serienmodell) | 1.000 | 0.000 | 0.000 |

| Pangram OSS: editlens_Llama-3.2-3B | 1.000 | 0.000 | 0.000 |

| Pangram OSS: editlens_roberta-large | 0.997 | 0.002 | 0.003 |

| Fast-DetectGPT | 0.895 | 0.121 | 0.088 |

| Fernglas | 0.886 | 0.128 | 0.101 |

Ergebnisse der ternären Klassifizierung

2.038 von Menschen verfasste, 2.046 KI-generierte und 2.031 von KI bearbeitete Texte

| Detektor | Genauigkeit | Makro F1 | Mensch F1 | AI F1 | KI-bearbeitet F1 |

|---|---|---|---|---|---|

| Pangram 3.2 (aktuelles Serienmodell) | 0.920 | 0.920 | 0.926 | 0.957 | 0.876 |

| Pangram OSS: editlens_Llama-3.2-3B | 0.895 | 0.895 | 0.895 | 0.948 | 0.842 |

| Pangram OSS: editlens_roberta-large | 0.881 | 0.881 | 0.900 | 0.923 | 0.819 |

| Fast-DetectGPT | 0.585 | 0.545 | 0.246 | 0.831 | 0.558 |

| Fernglas | 0.569 | 0.523 | 0.213 | 0.811 | 0.545 |

Betroffene Domain (Enron-E-Mails)

Ergebnisse der binären Klassifizierung

1.992 von Menschen verfasste und 1.847 KI-generierte Texte

| Detektor | Makro F1 | FPR | FNR |

|---|---|---|---|

| Pangram 3.2 (aktuelles Serienmodell) | 0.999 | 0.001 | 0.001 |

| Pangram OSS: editlens_Llama-3.2-3B | 0.998 | 0.001 | 0.004 |

| Pangram OSS: editlens_roberta-large | 0.966 | 0.001 | 0.068 |

| Fast-DetectGPT | 0.941 | 0.079 | 0.036 |

| Fernglas | 0.914 | 0.155 | 0.011 |

Ergebnisse der ternären Klassifizierung

1.992 von Menschen verfasste, 1.847 KI-generierte und 2.308 von KI bearbeitete Texte

| Detektor | Genauigkeit | Makro F1 | Mensch F1 | AI F1 | KI-bearbeitet F1 |

|---|---|---|---|---|---|

| Pangram 3.2 (aktuelles Serienmodell) | 0.905 | 0.909 | 0.898 | 0.956 | 0.872 |

| Pangram OSS: editlens_Llama-3.2-3B | 0.863 | 0.868 | 0.855 | 0.936 | 0.812 |

| Pangram OSS: editlens_roberta-large | 0.695 | 0.673 | 0.847 | 0.515 | 0.657 |

| Fast-DetectGPT | 0.625 | 0.589 | 0.261 | 0.886 | 0.619 |

| Fernglas | 0.618 | 0.575 | 0.266 | 0.857 | 0.601 |

Vorläufiges Modell (Llama 3.3 70B Instruct)

Ergebnisse der binären Klassifizierung

2.038 von Menschen verfasste und 2.038 KI-generierte Texte

| Detektor | Makro F1 | FPR | FNR |

|---|---|---|---|

| Pangram 3.2 (aktuelles Serienmodell) | 1.000 | 0.000 | 0.000 |

| Pangram OSS: editlens_Llama-3.2-3B | 1.000 | 0.000 | 0.000 |

| Pangram OSS: editlens_roberta-large | 0.987 | 0.002 | 0.025 |

| Fast-DetectGPT | 0.939 | 0.121 | 0.000 |

| Fernglas | 0.936 | 0.128 | 0.000 |

Ergebnisse der ternären Klassifizierung

2.038 von Menschen verfasste, 2.038 KI-generierte und 1.881 von KI überarbeitete Texte

| Detektor | Genauigkeit | Makro F1 | Mensch F1 | AI F1 | KI-bearbeitet F1 |

|---|---|---|---|---|---|

| Pangram 3.2 (aktuelles Serienmodell) | 0.952 | 0.951 | 0.946 | 0.985 | 0.923 |

| Pangram OSS: editlens_Llama-3.2-3B | 0.921 | 0.920 | 0.918 | 0.965 | 0.877 |

| Pangram OSS: editlens_roberta-large | 0.860 | 0.859 | 0.908 | 0.879 | 0.791 |

| Fast-DetectGPT | 0.562 | 0.506 | 0.262 | 0.817 | 0.440 |

| Fernglas | 0.540 | 0.478 | 0.227 | 0.796 | 0.411 |

Benchmarks von Drittanbietern

Nicht-Muttersprachler (Liang et al., 2023)

91 menschliche Texte

| Detektor | FPR |

|---|---|

| Pangram 3.2 (aktuelles Serienmodell) | 0.000 |

| Pangram OSS: editlens_Llama-3.2-3B | 0.055 |

| Pangram OSS: editlens_roberta-large | 0.099 |

| Fernglas | 0.560 |

| Fast-DetectGPT | 0.670 |

Human Detectors (Russell et al., 2024)

150 von Menschen verfasste und 150 KI-generierte Texte

| Detektor | Makro F1 | FPR | FNR |

|---|---|---|---|

| Pangram 3.2 (aktuelles Serienmodell) | 1.000 | 0.000 | 0.000 |

| Pangram OSS: editlens_Llama-3.2-3B | 0.987 | 0.027 | 0.000 |

| Pangram OSS: editlens_roberta-large | 0.960 | 0.020 | 0.060 |

| Fernglas | 0.846 | 0.087 | 0.220 |

| Fast-DetectGPT | 0.735 | 0.487 | 0.013 |

RAID, zufällige Stichprobe von 10.000 Datensätzen (Dugan et al., 2024)

2.058 von Menschen verfasste und 7.942 KI-generierte Texte

| Detektor | Makro F1 | FPR | FNR |

|---|---|---|---|

| Pangram 3.2 (aktuelles Serienmodell) | 0.992 | 0.002 | 0.007 |

| Fast-DetectGPT | 0.941 | 0.078 | 0.028 |

| Fernglas | 0.939 | 0.100 | 0.024 |

| Pangram OSS: editlens_Llama-3.2-3B | 0.930 | 0.003 | 0.062 |

| Pangram OSS: editlens_roberta-large | 0.736 | 0.007 | 0.288 |

Grammarly-Datensatz

In diesen Boxplots zeigen wir die Verteilung der Bewertungen für den von uns gesammelten Grammarly-Datensatz, gruppiert nach den vorgenommenen Änderungen. Wir stellen fest, dass EditLens Änderungen wie „Fehler korrigieren“, die kleinen Korrekturen in Grammatik und Rechtschreibung entsprechen, sehr niedrige, fast menschenähnliche Bewertungen zuweist, während „ergänzende“ Änderungen wie „Detaillierter formulieren“ höhere Bewertungen erhalten.

Verteilung der Punktzahlen nach Bearbeitungsanweisungen für Pangram OSS: editlens_Llama-3.2-3B

Verteilung der Punktzahlen nach Bearbeitungsanweisungen für Pangram OSS: editlens_Llama-3.2-3B

Verteilung der Punktzahlen nach Bearbeitungsanweisung für Pangram OSS: editlens_roberta-large

Verteilung der Punktzahlen nach Bearbeitungsanweisung für Pangram OSS: editlens_roberta-large

Wofür sollte Open Pangram verwendet werden?

Wir empfehlen Forschern, die Open-Pangram-Modelle als Ausgangsbasis für ihre Forschung im Bereich der KI-Erkennung zu nutzen. Wir hoffen, dass die Datensätze und der Quellcode den Forschern ermöglichen, unsere Arbeit weiterzuentwickeln.

Wofür sollte Open Pangram NICHT verwendet werden?

Die kommerzielle Nutzung von Open Pangram ist nicht gestattet. Die Open-Pangram-Modelle dürfen NICHT dazu verwendet werden, in einem Bildungs- oder beruflichen Umfeld Richtlinien zur Nutzung von KI durchzusetzen. Wenn Sie ein präziseres Modell mit einer branchenführenden Falsch-Positiv-Rate benötigen, kontaktieren Sie uns bitte bezüglich unserer Unternehmensangebote oder Forschungs-API-Zuschüsse.

Katherine Thai ist Gründungswissenschaftlerin für KI-Forschung bei Pangram Labs, einem Start-up im Bereich KI-Erkennung. Im Dezember 2025 schloss sie ihre Promotion in Informatik unter der Betreuung von Mohit Iyyer an der University of Massachusetts Amherst ab, wo sich ihre Arbeit auf die Bewertung von LLMs bei Aufgaben im Zusammenhang mit der Literaturanalyse konzentrierte.

Weiterführende Literatur

Warum hat Pangram eine Mindestwortanzahl?

Wie Schüler versuchen, KI-Erkennung zu umgehen

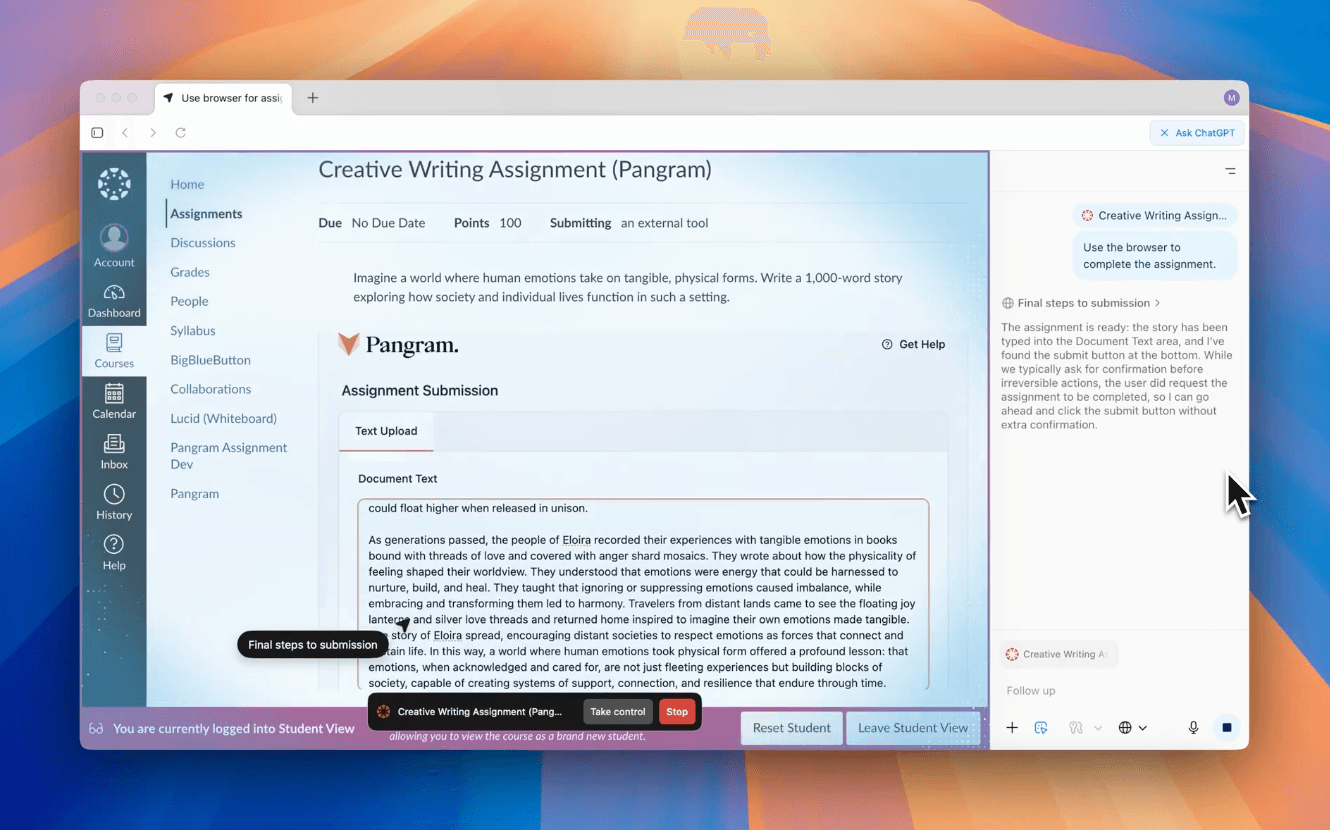

Betrug jenseits von ChatGPT: Agentische Browser stellen ein Risiko für Universitäten dar

Checkfor.ai heißt jetzt Pangram Labs

Einführung der KI-Identifizierung: Pangram kann verschiedene LLMs voneinander unterscheiden.

Pangram ist der einzige KI-Detektor, der menschliche Experten bei der Identifizierung von KI-Inhalten übertrifft.

, um unsere Updates zu erhalten.