Descubre al instante qué publicaciones son de personas y cuáles de IA en Twitter, LinkedIn, Substack y otras plataformas. Descarga nuestra nueva extensión para Chrome.

¿Qué es un corrector de ensayos?

En el pasado, «corrector de ensayos» era un término utilizado para referirse a herramientas que analizaban un texto en busca de errores ortográficos, gramaticales y de vocabulario. También podían utilizarse para comprobar si había problemas con las citas, como se ve en Recite. Turnitin, una popular herramienta educativa, ha sido de gran ayuda para detectar plagios.

Actualmente, el auge de la IA ha llevado a los educadores a considerar el uso de verificadores que escanean el contenido generado por IA.

¿Son precisos los correctores de trabajos académicos basados en IA?

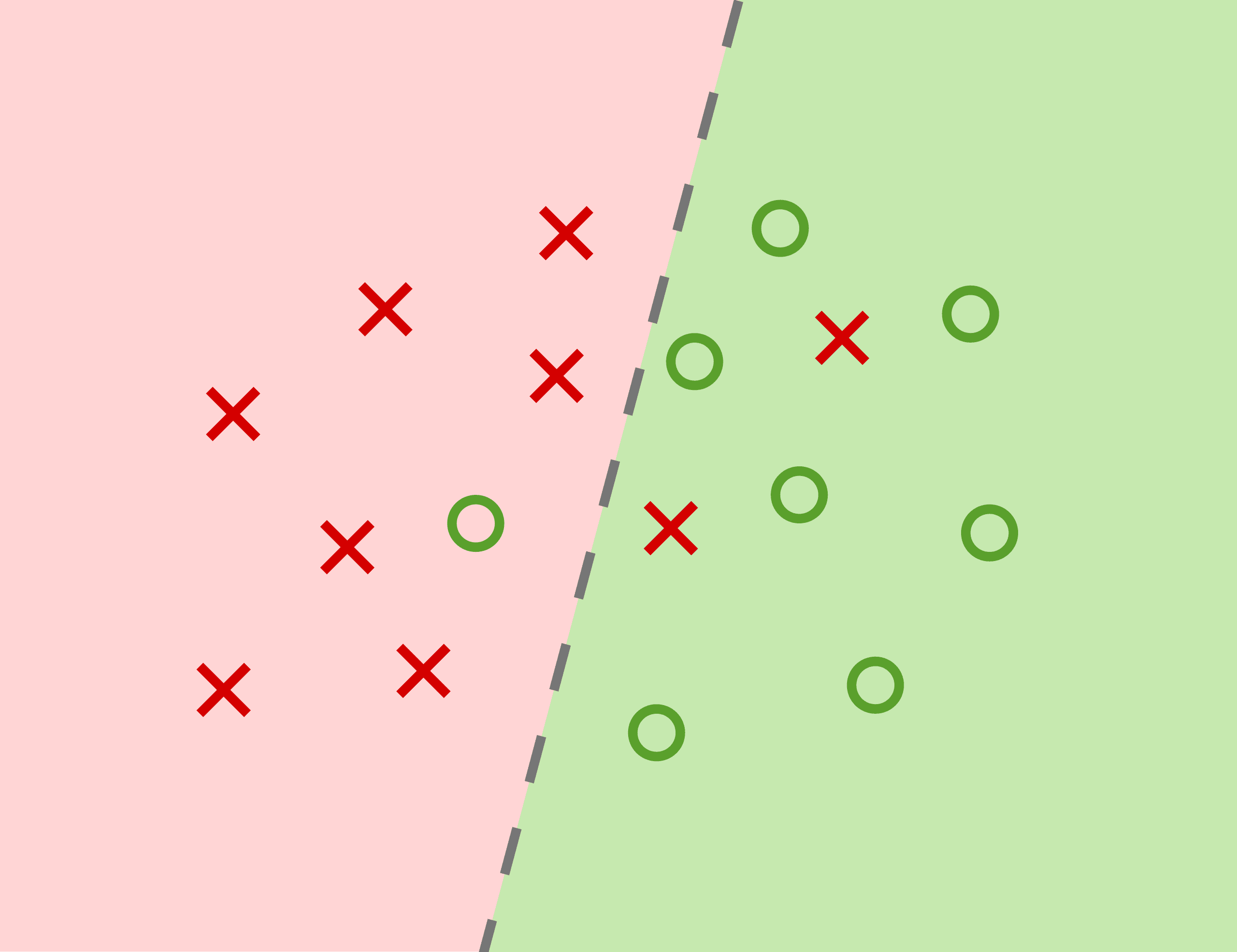

Las altas tasas de falsos positivos (FPR) son una gran preocupación para los educadores. Presentar una denuncia por falta de honestidad académica puede ser arriesgado, ya que hacerlo basándose en un falso positivo puede perjudicar la relación entre el profesor y el alumno.

Sin embargo, el FPR del 0,01 % de Pangram lo convierte en un detector fiable para su uso en la educación superior. Esto también ha sido corroborado por terceros, que concluyen que Pangram es el detector de IA más preciso disponible en el mercado.

Corrector de ensayos con IA frente a corrector de plagio

Un verificador de ensayos con IA detecta el uso de IA en un texto concreto. Los verificadores de plagio determinan el uso de material externo en un texto.

Pangram es una herramienta comercial capaz de detectar tanto contenido generado por IA como plagado. Pangram señala ambos como casos separados al analizar el texto.

¿Puede la IA plagiar el trabajo humano?

Un verificador de plagio compara un ensayo con textos existentes previamente para encontrar similitudes. Un verificador de ensayos con IA analiza un texto en busca de patrones lingüísticos similares a los modelos actuales de IA.

Los modelos de lenguaje grande (LLM) como ChatGPT generan texto utilizando grandes conjuntos de datos y se sabe que plagian a partir de estos datos. En un artículo de Amy B. Cyphert, profesora asociada de la Facultad de Derecho de la Universidad de Virginia Occidental, se señala que:

«Las investigaciones sugieren que cuanto más a menudo se incluye material protegido por derechos de autor en un conjunto de datos, más probable es que un LLM produzca un resultado que incluya texto inalterado de esa obra».

La memorización se produce cuando un LLM reproduce frases del texto del conjunto de entrenamiento. De forma intencionada o no, se puede incitar a los LLM a reproducir gran parte del trabajo de otros. Esto significa que el resultado final de la incitación puede ser plagiado en parte o en su totalidad.

Mientras los investigadores continúan debatiendo sobre una definición más matizada del plagio, las políticas de integridad académica de las universidades establecen que el plagio es el uso del trabajo de otra persona sin darle crédito. La Universidad de Michigan señala que el plagio puede ser intencional o no intencional. La Universidad de Oxford detalla varias formas de plagio, entre las que se incluyen las citas textuales sin reconocimiento, el copiado y pegado de Internet, la paráfrasis, la colusión, la falta de reconocimiento de la ayuda recibida, etc.

Por lo tanto, en una institución académica:

Cuando un estudiante entrega un trabajo generado por IA, ¡es posible que también esté entregando un trabajo plagiado escrito por un humano!

¿Pueden los seres humanos plagiar obras generadas por la IA?

¡Según algunos criterios, tal vez!

Cuando un estudiante presenta un trabajo generado por IA sin citarla como fuente, se produce una falta de honestidad académica. La política de la Universidad del Sur de Florida establece lo siguiente:

«Dado que los chatbots con IA y otras herramientas de IA generativa crean nuevos textos e imágenes en respuesta a indicaciones, el uso de material procedente de la IA generativa podría considerarse más como escritura fantasma que como plagio».

El Comité de Ética Editorial señala que la IA no puede considerarse autora de un artículo de investigación porque «las herramientas de IA no pueden cumplir los requisitos de autoría, ya que no pueden asumir la responsabilidad del trabajo presentado. Al no ser entidades jurídicas, no pueden afirmar la existencia o inexistencia de conflictos de intereses ni gestionar acuerdos de derechos de autor y licencias».

Algunas instituciones académicas consideran que el uso de contenido generado por IA constituye sin duda alguna plagio:

«El plagio es el acto de presentar como propias ideas, investigaciones o escritos que no lo son. Algunos ejemplos de plagio son: copiar las palabras o imágenes reales de otra persona o de una herramienta de inteligencia artificial sin utilizar comillas ni citas que atribuyan las palabras a su fuente. - City University of New York

«El plagio es cuando se toman las ideas de otra persona y se presentan como propias, aunque sea de forma involuntaria. Si se utiliza la inteligencia artificial para resumir una idea o escribir un trabajo, este no es 100 % propio». - Universidad de Ohio

Y en otros casos, los educadores deben asumir la responsabilidad de crear políticas de IA, tales como:

«Unas directrices claras para cada curso o tarea permiten a los alumnos centrarse en los objetivos de aprendizaje que usted desea que alcancen. Dado que los alumnos a menudo no están seguros de cuándo o si pueden utilizar la IA generativa, las políticas pueden resultar muy útiles cuando se adaptan a su curso y tareas específicos, ya que algunos usos de la IA pueden favorecer el aprendizaje de los alumnos, pero otros pueden interrumpir procesos importantes que los alumnos deben realizar por sí mismos». - UPenn

«Crear políticas claras sobre el uso de la IA es esencial para mantener la integridad académica y establecer las expectativas de los estudiantes. Estas políticas deben describir cuándo y cómo se pueden utilizar herramientas de IA como ChatGPT, Perplexity.ai o Grammarly, y garantizar que los estudiantes comprendan las implicaciones éticas de la IA en el trabajo académico». - NYU

A partir de esta pequeña muestra de políticas universitarias, podemos comprender las diferentes formas en que las instituciones ven el uso de la IA y el plagio. Si bien la IA es una herramienta y no un autor, presentar resultados generados por la IA sin reconocerlo es deshonesto. Los educadores deben establecer expectativas claras para sus alumnos. Para obtener más información sobre las políticas aplicables en los cursos, el profesor Christopher Ostro proporcionó un enfoque matizado para abordar el fraude con IA.

Pangram adopta un enfoque a favor de la transparencia en el uso de la IA y el contenido externo, especialmente en el ámbito académico. Si te interesa nuestro modelo, ¡prueba gratis los verificadores de IA y detección de plagio de Pangram!

Destiny es becaria de análisis de investigación en Pangram. Además, estudia Matemáticas Aplicadas y Química en el NYC College of Technology. El trabajo de Destiny en Pangram ha contribuido enormemente a la investigación sobre el contenido de IA en Internet. Fuera del ámbito laboral y académico, a Destiny le apasiona la escritura creativa y la ficción de terror.

Lecturas relacionadas

Marcas de agua con IA: por qué las grandes empresas tecnológicas apuestan por la trazabilidad mediante IA y están fracasando

Herramientas de detección de IA para profesores: por qué las escuelas necesitan herramientas de detección de IA

¿Google penalizará el contenido generado por IA en 2026?

Humanizadores de IA: el problema (Slop)^2

Un repaso a las frases más manidas de la IA

Todo sobre los falsos positivos en los detectores de IA

para recibir nuestras actualizaciones.