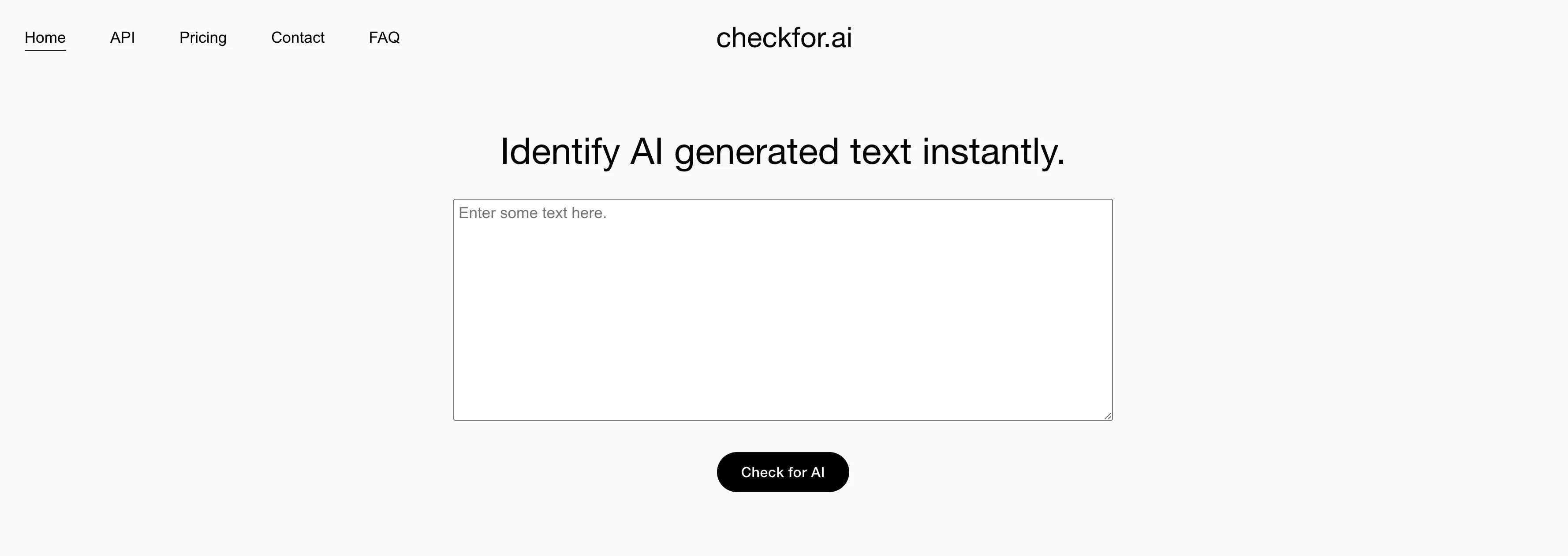

Sachez immédiatement ce qui est publié par des humains et ce qui l'est par l'IA sur Twitter, LinkedIn, Substack et bien d'autres plateformes. Téléchargez notre nouvelle extension Chrome.

Déclaration sur le décret présidentiel de Biden relatif à la sécurité de l'IA

REMARQUE : Nous avons changé notre nom pour Pangram Labs ! Consultez notre article de blog pour plus de détails.

Aujourd'hui, l'administration Biden a publié de nouvelles normes en matière de sûreté et de sécurité de l'IA, notamment cette directive sur la détection de contenu généré par l'IA :

Le ministère du Commerce élaborera des lignes directrices pour l'authentification et le tatouage numérique des contenus afin d'identifier clairement les contenus générés par l'IA. Les agences fédérales utiliseront ces outils pour permettre aux Américains de savoir facilement que les communications qu'ils reçoivent de leur gouvernement sont authentiques, et montreront ainsi l'exemple au secteur privé et aux gouvernements du monde entier.

Joe Biden, tiré de ai.gov.

Joe Biden, tiré de ai.gov.

Checkfor.ai soutient pleinement l'engagement de l'administration Biden en faveur d'un déploiement sûr et responsable des grands modèles linguistiques. Nous pensons que l'élaboration de lignes directrices et de politiques relatives à l'authentification du contenu généré par l'IA est une étape importante dans la bonne direction pour la sécurité de l'IA et s'inscrit dans notre mission de protection de l'internet contre le spam et autres contenus malveillants générés par les grands modèles linguistiques. Le monde sera meilleur, tant pour les consommateurs que pour les utilisateurs de technologies d'IA, si nous, en tant que société, investissons davantage dans la détection des contenus générés par l'IA. Aujourd'hui, nous souhaitons publier une déclaration sur notre position en tant qu'entreprise en matière d'authentification, de tatouage numérique et de détection des contenus.

- Nous pensons qu'aucune solution de détection actuelle n'est suffisante pour résoudre le problème dans l'immédiat, et que nous devons investir davantage de ressources dans la résolution spécifique de la détection de l'IA.

- Nous pensons que le tatouage numérique n'est pas la solution à ce problème, car il donne un faux sentiment de sécurité et présente des limites avérées lorsqu'un utilisateur a accès aux poids du modèle ou peut modifier le résultat (https://arxiv.org/pdf/2305.03807.pdf, https://arxiv.org/pdf/2301.10226.pdf). Il existe déjà des modèles open source puissants et performants sans filigrane, et les acteurs malveillants pourront toujours affiner localement leurs propres versions de ces modèles pour échapper à la détection. De plus, nous pensons que le problème de détection peut être résolu même sur des modèles sans filigrane.

- Nous soutenons la réglementation relative à la sécurité de l'IA et au développement de grands modèles linguistiques, à condition que toute réglementation soutienne l'écosystème open source. L'open source permet de contrôler et d'équilibrer les puissantes entreprises technologiques, d'assurer la transparence pour les consommateurs et de permettre au public d'évaluer, de critiquer et de comparer librement ces modèles.

- Nous pensons que le rôle du gouvernement dans la promotion de la sécurité de l'IA et l'investissement dans la recherche sur la détection de l'IA devrait se concentrer sur le financement de projets universitaires et industriels dans le domaine de la détection de l'IA.

- Pour faire progresser la recherche efficace en matière de détection de l'IA, nous devons établir des références et des critères d'évaluation, afin que les consommateurs puissent être conscients de l'efficacité et des limites des détecteurs d'IA disponibles. Nous nous engageons à développer et à contribuer à l'élaboration de normes industrielles en matière de détection de l'IA, afin que des modèles linguistiques plus grands et plus puissants puissent être déployés de manière sûre et responsable.

Chez Checkfor.ai, nous travaillons d'arrache-pied pour mettre au point des systèmes de détection IA fiables afin que les modèles linguistiques de nouvelle génération puissent être déployés de manière sûre et productive. Nous sommes ravis de voir l'engagement de l'administration Biden à différencier les contenus générés par l'homme et ceux générés par l'IA, et nous sommes impatients de travailler avec les chercheurs et les décideurs politiques pour élaborer ces normes importantes.

Max est un ingénieur chevronné en apprentissage automatique. Il a récemment travaillé sur les véhicules autonomes chez Nuro, où il a dirigé les efforts d'apprentissage actif. Il a une longue expérience dans le déploiement de produits d'apprentissage automatique couronnés de succès chez Google, Two Sigma et Yelp.

Max est titulaire d'une licence en informatique théorique et d'un master en intelligence artificielle de l'université de Stanford. Outre sa passion pour la construction, il est également un membre actif de la communauté Magic: the Gathering cube.

Lectures complémentaires

Faites vos achats jusqu'à plus soif : l'IA s'immisce dans les produits et leur commercialisation

Pourquoi Pangram impose-t-il un nombre minimum de mots ?

Pangram est le seul détecteur d'IA qui surpasse les experts humains dans l'identification de contenu généré par l'IA.

La détection par IA vient de faire un bond en avant : annonce de Checkfor.ai

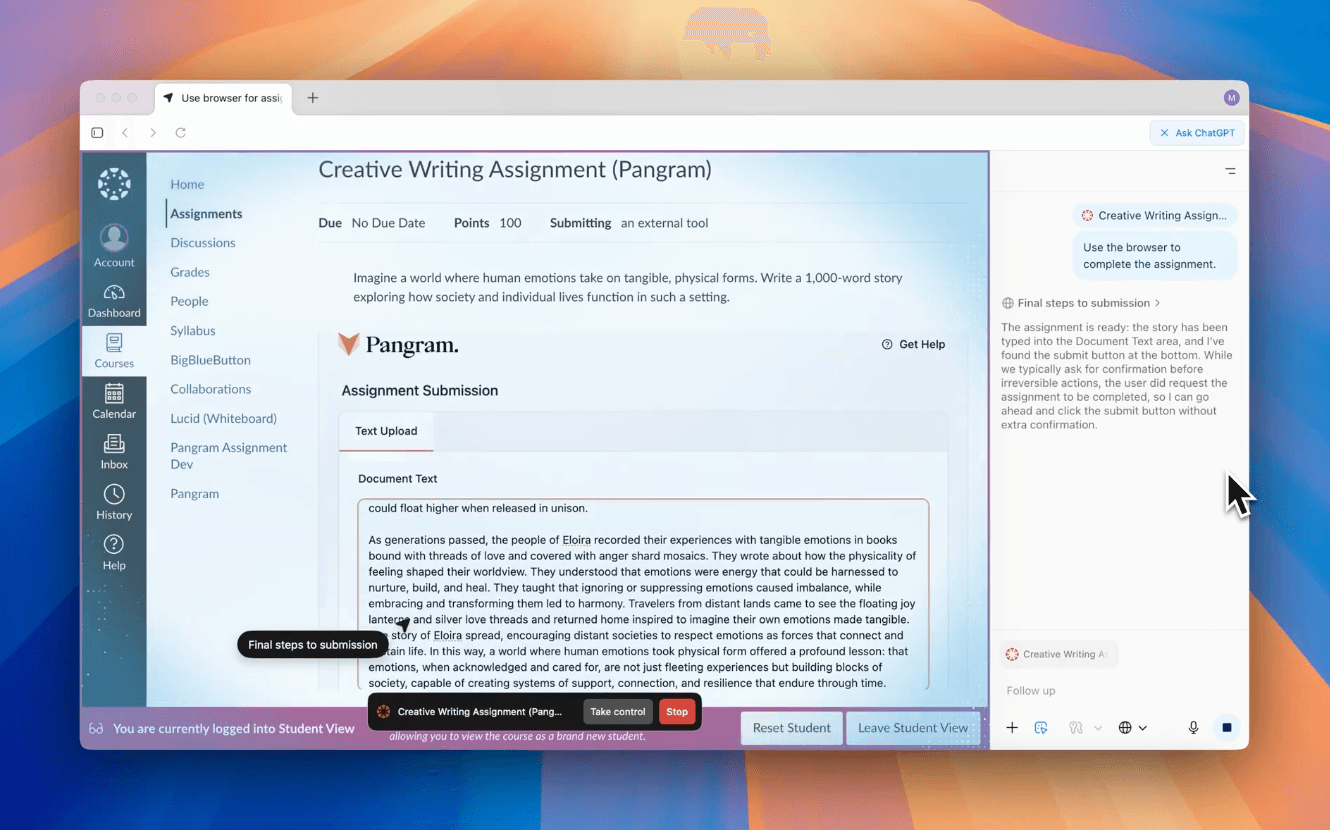

La tricherie au-delà de ChatGPT : les navigateurs agents présentent des risques pour les universités

Pleins feux sur une employée : Rencontrez Katherine, chercheuse en intelligence artificielle

pour recevoir nos mises à jour.