Sachez immédiatement ce qui est publié par des humains et ce qui l'est par l'IA sur Twitter, LinkedIn, Substack et bien d'autres plateformes. Téléchargez notre nouvelle extension Chrome.

Détection par IA pour la confiance et la sécurité

Modération de contenu par l'IA pour les équipes chargées de la confiance et de la sécurité

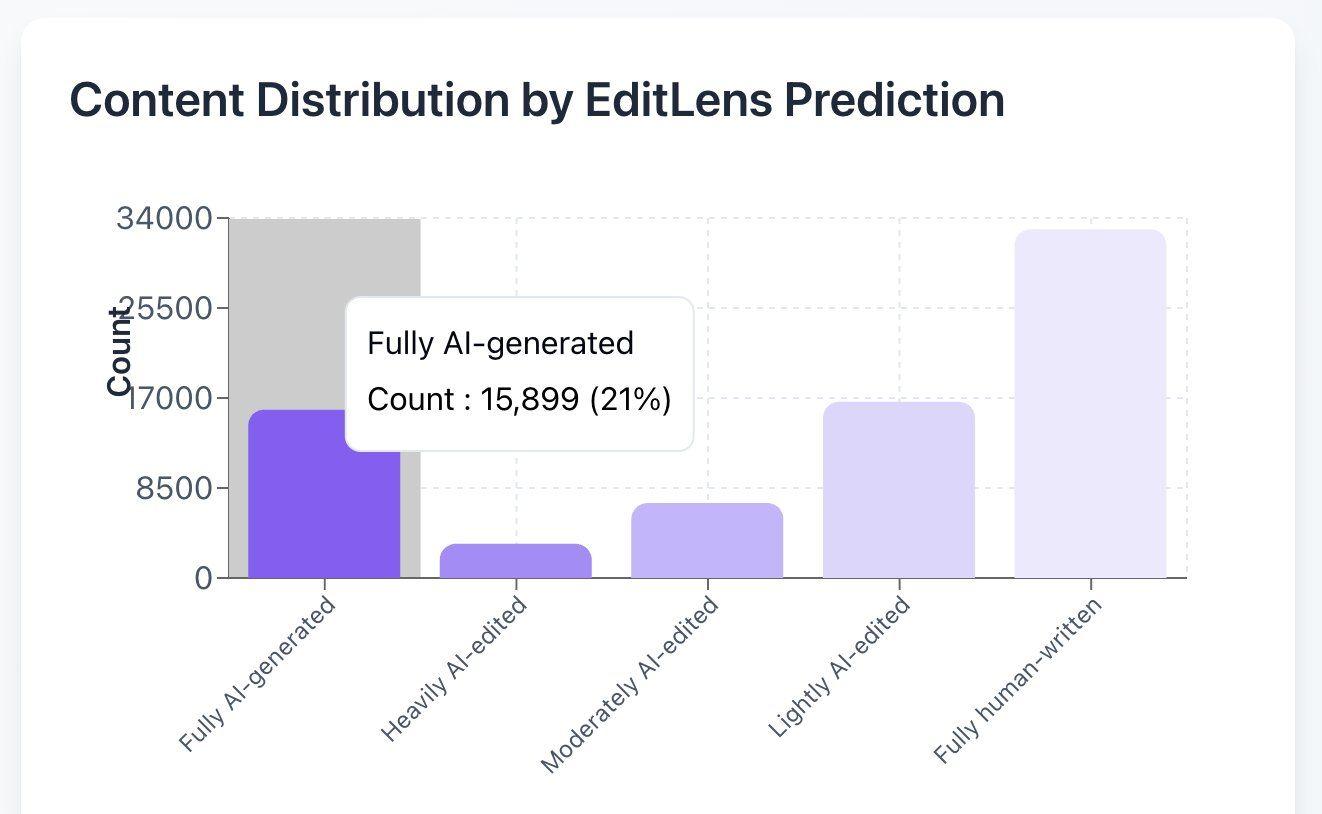

Nous proposons un service de détection par IA à la demande via une API destiné aux entreprises. Optimisez votre modération de contenu grâce au détecteur IA le plus précis qui soit, pour un coût bien inférieur à celui d'une vérification humaine.

)

De la part des fondateurs

Note à l'attention des équipes chargées de la confiance et de la sécurité

Avant Pangram, j'ai travaillé chez Google et Yelp, où j'ai pu constater de mes propres yeux les dangers liés aux contenus frauduleux. En tant que chercheurs en IA, nous croyons que l'IA est une force positive dans le monde et nous avons pour objectif d'empêcher son utilisation abusive dans le but de déformer la réalité et la vérité dans les domaines où la fiabilité des contenus est essentielle.

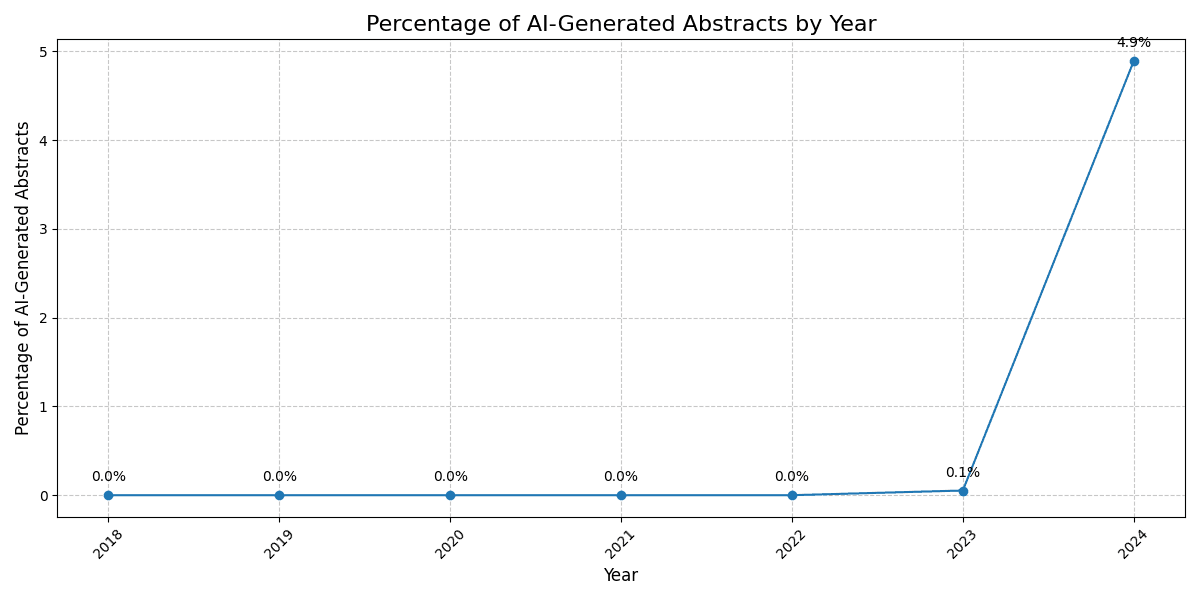

C'est ici que nous avons lancé Pangram, car nous sommes convaincus que l'inondation du Web par du contenu généré par l'IA constitue l'un des plus grands défis de notre époque. Dès nos débuts, nous nous sommes donné pour mission de créer le détecteur d'IA le plus précis du marché, et grâce à nos avancées en matière de recherche, nous avons mis au point un classificateur offrant la plus grande précision et le taux de faux positifs le plus faible.

Nous aidons les équipes chargées de la confiance et de la sécurité à multiplier leur efficacité afin de déployer leurs initiatives à moindre coût. Pangram fournit aux équipes les outils dont elles ont besoin pour définir des politiques en toute confiance et modérer efficacement les contenus générés par l'IA, afin de préserver les contenus créés par des humains et de signaler ceux générés par l'IA conformément à la politique de l'entreprise.

— Max, cofondateur de Pangram Labs

Pourquoi c'est important

Les avis rédigés par l'IA sapent la confiance

et nuisent à la réputation de la plateforme.

Conformité aux règles de la FTC

La Commission fédérale du commerce (FTC) a annoncé des règles interdisant les faux avis, y compris ceux générés par l'IA. Assurez-vous de respecter ces règles en détectant et en signalant les contenus synthétiques avant qu'ils n'atteignent votre plateforme.

Intégrité du classement

Les avis rédigés par l'IA ne sont pas seulement inutiles pour les consommateurs, mais ils trompent également les systèmes de classement, qui peuvent leur attribuer un classement élevé en raison de leur longueur et de leur grammaire irréprochable. Protégez la qualité du classement de votre plateforme.

Protection des droits d'auteur

« Lorsqu'une technologie d'intelligence artificielle détermine les éléments expressifs de sa production, le contenu généré n'est pas le fruit d'une création humaine. » — Bureau américain du droit d'auteur, mars 2023

Échelle et précision

Faites évoluer votre infrastructure de modération sans augmenter les coûts

Pangram permet de renforcer les équipes chargées de la confiance et de la sécurité à moindre coût, en apportant son soutien aux équipes de sécurité confrontées à des contraintes de temps tout en réduisant les dépenses.

100 fois plus rentable

La modération humaine des contenus est coûteuse et prend beaucoup de temps. Pangram est le seul outil de détection de l'IA qui surpasse les experts humains dans l'identification des contenus générés par l'IA, ce qui permet d'automatiser ce processus tout en réduisant les coûts.

Détection des formes abrégées

Les publications courtes sur les réseaux sociaux, les messages privés et les commentaires sont souvent trop courts pour les détecteurs d'IA traditionnels. Le modèle de Pangram détecte les contenus générés par l'IA à partir de 75 mots seulement et peut analyser plusieurs contenus simultanément pour obtenir un meilleur résultat.

Avantage technologique

Développé par des chercheurs en IA de Tesla et Google, qui se sont engagés à atteindre une précision exceptionnelle. Notre méthode exclusive « Hard Negative Mining » permet d'atteindre une précision de 99,99 % et le taux de faux positifs le plus bas du marché.

Foire aux questions

FAQ sur la détection de l'IA

Vous cherchez des réponses ? Consultez les questions fréquentes

et trouvez toutes les informations dont vous avez besoin, en un seul endroit.

Pangram propose une API RESTful accompagnée d'une documentation complète et d'un SDK Python. La plupart des équipes intègrent la détection comme étape préalable à la modération : elles analysent le contenu généré par les utilisateurs avant sa publication ou transmettent le contenu signalé à des modérateurs humains pour examen. L'intégration prend généralement moins d'une journée.

Le taux de faux positifs de Pangram est d'environ 1 sur 10 000, soit le plus bas du secteur. C'est un élément essentiel pour les plateformes où le signalement erroné d'utilisateurs légitimes peut nuire à la confiance et à l'engagement.

Oui. Contrairement à la plupart des détecteurs qui nécessitent des textes longs, Pangram est capable de détecter de manière fiable le contenu généré par l'IA dans des textes ne comptant que 75 mots. Pour les contenus encore plus courts, nous pouvons regrouper plusieurs textes du même auteur afin d'obtenir un signal plus fiable.

Pangram est certifié SOC 2 Type 2. Les contenus transmis via l'API sont traités de manière temporaire puis supprimés : ils ne sont jamais conservés, indexés ni utilisés pour l'entraînement des modèles. Cette pratique est conforme aux exigences du RGPD et aux politiques de gestion des données des entreprises.

Oui. Pangram prend en charge la détection automatique de la langue dans plus de 20 langues avec une précision supérieure à 99 %, notamment l'espagnol, le français, l'arabe, le chinois et bien d'autres encore. Cela en fait un outil idéal pour les plateformes internationales dont la base d'utilisateurs est très diversifiée.

Oui. Notre API prend en charge le traitement par lots pour les cas d'utilisation à haut débit. De nombreuses équipes chargées de la confiance et de la sécurité effectuent des analyses nocturnes ou horaires sur les nouveaux contenus, signalant les publications suspectes pour examen. L'API traite des milliers de requêtes par heure avec une latence constante. Découvrez comment les éditeurs utilisent Pangram pour la vérification de contenus à haut volume.

En savoir plus

Détection par IA pour

toutes les entreprises

Pour l'édition et les médias

Détection par IA pour les éditeurs et les équipes rédactionnelles. Protégez l'intégrité rédactionnelle et vérifiez l'authenticité des contenus à grande échelle, avec le taux de faux positifs le plus bas.

En savoir plus →Pour les développeurs

Détection de code généré par l'IA pour les développeurs et les équipes d'ingénieurs. Détectez le code généré par l'IA à partir de ChatGPT, Copilot et Claude en Python, Java, C++ et bien d'autres langages.

En savoir plus →Pour les cabinets d'avocats

Détection de l'IA pour les cabinets d'avocats et les professionnels du droit. Identifiez les mémoires générés par l'IA, vérifiez les références juridiques et garantissez l'authenticité de la paternité de chaque document déposé.

En savoir plus →Développez vos activités en matière de confiance et de sécurité.

Détectez à grande échelle les contenus générés par l'IA, préservez l'intégrité de votre plateforme et réduisez vos coûts de modération de 100 fois.

pour recevoir nos mises à jour.