Sachez immédiatement ce qui est publié par des humains et ce qui l'est par l'IA sur Twitter, LinkedIn, Substack et bien d'autres plateformes. Téléchargez notre nouvelle extension Chrome.

Détection de code par IA pour les équipes d'ingénieurs

Détecteur de code généré par IA pour les développeurs

Détectez le code généré par l'IA à partir de ChatGPT, Claude et GitHub Copilot en Python, Java, C++ et plus encore. Détection conservatrice optimisée pour réduire les faux positifs.

from pangram import Pangram

# Initialize the client

client = Pangram(api_key="your-api-key")

# Analyze a code snippet

result = client.predict(code_snippet)

print(f"AI fraction: {result['fraction_ai']}")

Cas d'utilisation

Sécurisez la chaîne d'approvisionnement de vos logiciels d'

Bénéficiez d'une visibilité sur le code généré par l'IA au sein de votre entreprise. Vérifiez la légitimité des recrutements, protégez votre propriété intellectuelle et réduisez les risques de sécurité grâce au moteur de détection de code généré par l'IA le plus précis qui soit.

Vérifier l'embauche technique

N'embauchez pas un ingénieur prompt pour un poste en backend. Détectez le code IA dans les devoirs à faire à la maison afin de vous assurer que les candidats comprennent la logique qu'ils soumettent.

Protéger la propriété intellectuelle

Dans de nombreuses juridictions, le code généré par l'IA ne peut pas être protégé par le droit d'auteur. Vérifiez vos référentiels afin de vous assurer que les logiciels propriétaires ne sont pas construits sur des bases synthétiques et non licencieuses.

Atténuer les risques liés à la sécurité

Les extraits générés par l'IA contiennent souvent des bogues logiques subtils ou des hallucinations de sécurité. Signalez les commits fortement influencés par l'IA afin qu'ils soient soumis à une révision humaine approfondie avant leur fusion.

Approche technique

s de détection prudentes pour le code

L'analyse de code de Pangram est spécialement conçue pour les logiciels — elle n'est pas dérivée de la détection de texte. Notre modèle comprend les contraintes syntaxiques, les modèles structurels et la différence entre les éléments standardisés et la logique originale.

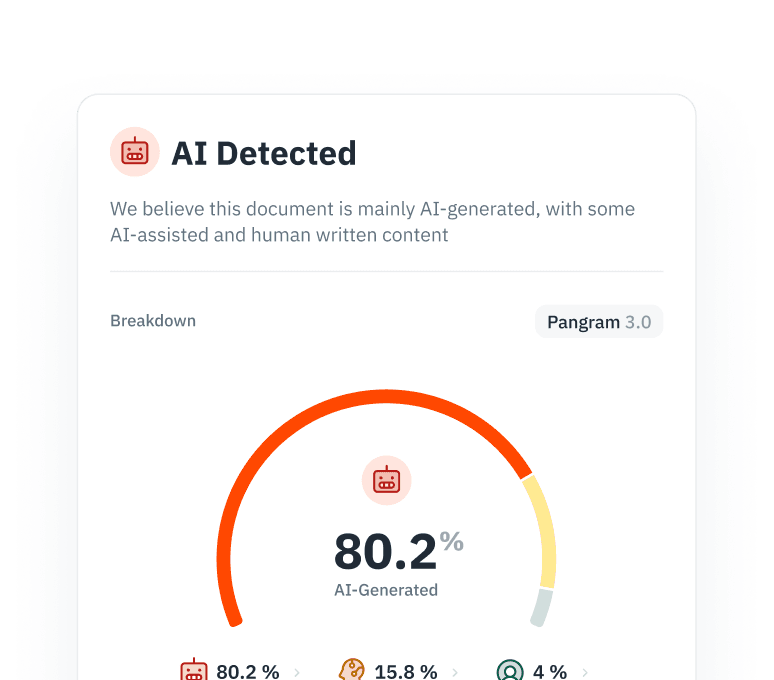

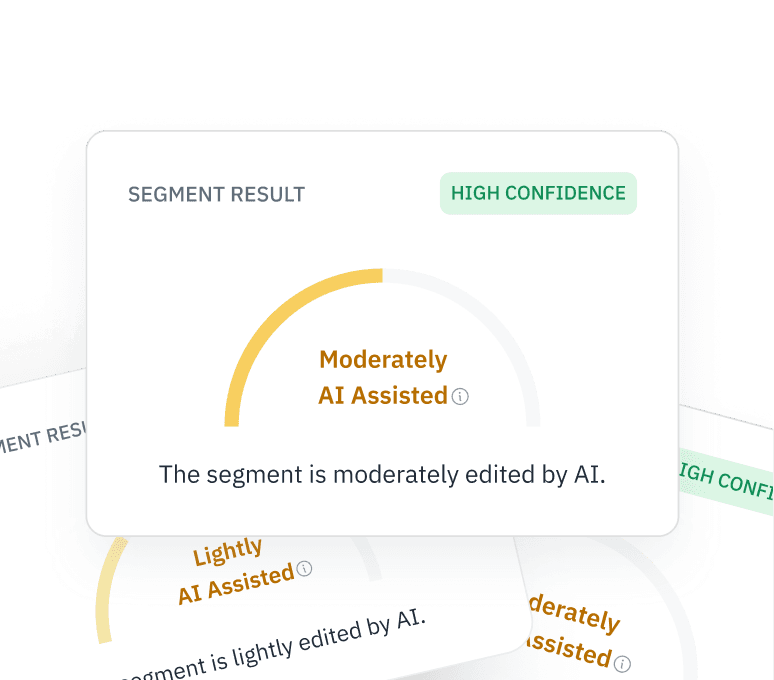

Faible taux de faux positifs

Pangram est réglé pour être conservateur : il signale rarement la logique écrite par l'homme comme étant de l'IA, ce qui vous évite d'accuser à tort les développeurs d'utiliser des modèles standard.

Analyse syntaxique

Contrairement au texte, le code est soumis à des contraintes syntaxiques strictes. Notre modèle analyse les modèles structurels sur plus de 40 lignes de code afin de distinguer la logique humaine de la prévisibilité du LLM.

Prise en charge multilingue

Détection précise dans les langages de haut niveau tels que Python et Java, ainsi que dans les langages de bas niveau tels que C++ et C. D'autres langages seront ajoutés à mesure que la couverture du modèle s'étendra.

Intégration

Détection automatisée de l'

e de code par l'IA via une API

01

SDK Python

Intégration facile pour vos pipelines backend. Installez pangram-sdk et commencez à noter des extraits de code en quelques minutes.

Afficher les documents →

02

Plateformes de recrutement

Intégrez des plateformes d'évaluation technique pour signaler automatiquement les soumissions suspectes dans les défis de codage.

En savoir plus →

03

Audits par lots

Analysez l'intégralité des référentiels ou des pull requests afin d'évaluer la densité de détection de code IA dans l'historique de votre projet.

Obtenir une clé API →

Foire aux questions

FAQ sur la détection de l'IA

Questions fréquentes sur l'

s de détection de code IA pour les développeurs et les équipes d'ingénierie.

Oui. Pangram propose une API à haut débit conçue pour l'analyse automatisée dans les pipelines d'intégration continue, les vérifications avant fusion, les audits internes et les flux de travail de recherche. De nombreuses équipes effectuent des analyses de détection sur les pull requests ou lors de scans nocturnes plutôt que de bloquer purement et simplement les commits.

La précision dépend de la langue, de la longueur du code et de sa complexité. Pangram est particulièrement fiable pour les codes longs et riches en logique, et évite délibérément de formuler des affirmations trop catégoriques sur les entrées à faible signal. Les résultats sont accompagnés de scores de confiance afin de faciliter la vérification humaine. Pour approfondir le sujet, consultez notre article consacré à la détection du code généré par l'IA.

Oui. Certaines équipes utilisent Pangram pour signaler les contributions générées par l'IA dans les projets open source ou pour faciliter les vérifications internes lorsque des exigences en matière de licence, d'attribution ou de divulgation s'appliquent. Découvrez comment les cabinets d'avocats utilisent Pangram pour vérifier la propriété intellectuelle et la conformité.

En savoir plus

Détection par IA pour

toutes les entreprises

Pour les cabinets d'avocats

Détection de l'IA pour les cabinets d'avocats et les professionnels du droit. Identifiez les mémoires générés par l'IA, vérifiez les références juridiques et garantissez l'authenticité de la paternité de chaque document déposé.

En savoir plus →Pour la modération du contenu

Modération de contenu par IA pour les équipes chargées de la confiance et de la sécurité. Détectez à grande échelle les avis générés par l'IA, les faux commentaires et le contenu synthétique via une API.

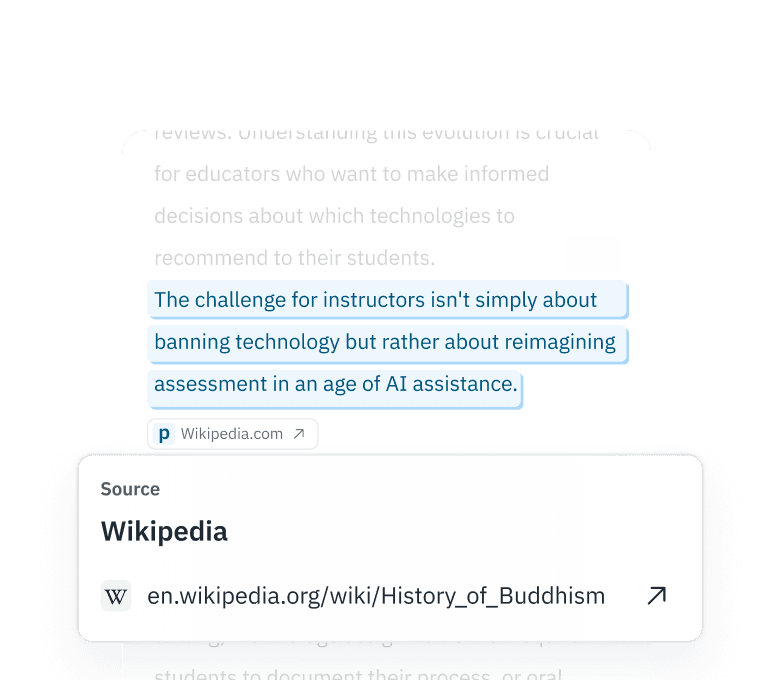

En savoir plus →Pour les universités

Détection de l'IA pour les universités et l'enseignement supérieur. Vérifiez les devoirs des étudiants, examinez les travaux de recherche et protégez la réputation de votre établissement.

En savoir plus →Commencez dès aujourd'hui à détecter le code généré par l'IA

Sécurisez votre base de code, validez vos recrutements et bénéficiez d'une visibilité totale sur l'utilisation de l'IA au sein de votre organisation technique.

pour recevoir nos mises à jour.