Sachez immédiatement ce qui est publié par des humains et ce qui l'est par l'IA sur Twitter, LinkedIn, Substack et bien d'autres plateformes. Téléchargez notre nouvelle extension Chrome.

Table des matières

- Les facultés de droit utilisent-elles des détecteurs d'IA pour les lettres de motivation ?

- Utilise-t-on des détecteurs d'IA pour les devoirs en faculté de droit ?

- Le problème du « jargon juridique » : vais-je obtenir un faux positif ?

- S'y retrouver dans les politiques relatives à l'IA dans l'enseignement du droit

- Bonnes pratiques pour protéger votre dossier scolaire

Faire des études de droit implique de nombreuses lectures et beaucoup de travaux écrits. Il est très tentant d'utiliser des outils d'IA générative comme ChatGPT, d'autant plus qu'ils permettent de rédiger des lettres de motivation, des résumés de jurisprudence et des notes de recherche.

Ce guide explique comment les politiques des différentes facultés de droit évoluent et pourquoi vous devez faire preuve d'une extrême prudence quant à la manière dont l'IA est intégrée dans votre formation juridique.

Les facultés de droit utilisent-elles des détecteurs d'IA pour les lettres de motivation ?

La réponse à cette question est « oui ». De nombreux services d'admission des facultés de droit, conseillers indépendants spécialisés dans la préparation aux études de droit et cabinets d'avocats utilisent activement des logiciels de détection par IA pour s'assurer que les lettres de motivation et les essais sur la diversité qui composent un dossier de candidature sont bien le fruit du travail authentique du candidat concerné.

Les facultés de droit souhaitent recruter des candidats dotés d'un point de vue original et d'une voix authentique, ainsi que de la force intellectuelle nécessaire pour réussir leurs programmes. Un essai généré par ChatGPT est par nature générique et va à l'encontre de l'objectif même d'une lettre de motivation.

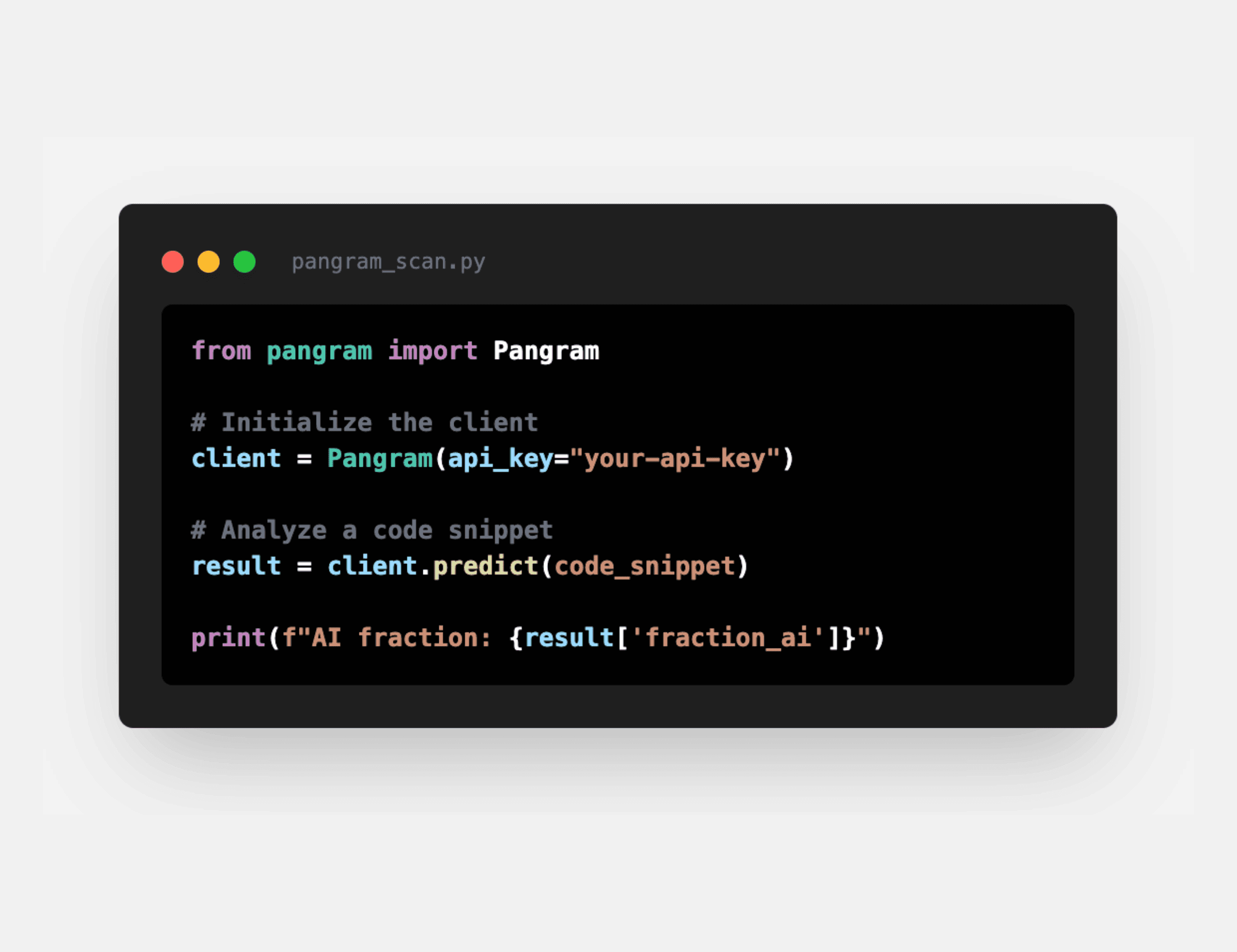

Les services d'admission des facultés de droit ont recours à des outils de détection de l'IA dès le tout début du processus. Les meilleurs consultants en admission – Gradpilot, par exemple – intègrent des outils tels que Pangram directement dans leur processus d'évaluation. Ils peuvent ainsi repérer le recours excessif d'un candidat à l'IA avant même que sa dissertation ne soit effectivement soumise au LSAC.

Utilise-t-on des détecteurs d'IA pour les devoirs en faculté de droit ?

Oui, les services chargés de l'intégrité académique et les professeurs de droit utilisent des détecteurs d'IA de niveau professionnel intégrés à leurs systèmes de gestion de l'apprentissage pour vérifier tous les types de devoirs des facultés de droit. Parmi les devoirs qu'ils vérifient figurent notamment les travaux de rédaction juridique, les notes de recherche et les examens à faire à domicile.

Dans tout type de rédaction juridique, la précision et l'authenticité sont indispensables. L'utilisation de modèles de langage génératifs (LLM) tels que ChatGPT pose problème, car ceux-ci ont tendance à inventer de la jurisprudence, des références et des « faits » juridiques. De ce fait, s'appuyer sur l'IA pour réaliser des travaux juridiques n'expose pas seulement à des accusations de plagiat, mais aussi à de lourdes sanctions académiques pour avoir inventé de faux précédents juridiques.

Les professeurs utilisent les scores générés par l'IA comme outil de diagnostic. Ils combinent le diagnostic fourni par un détecteur d'IA destiné aux facultés de droit avec leur propre connaissance des compétences rédactionnelles antérieures de l'étudiant afin d'enquêter sur les cas de fraude académique. Cette approche combinée, lorsqu'elle est mise en œuvre, facilite la détection de l'utilisation de l'IA.

Le problème du « jargon juridique » : vais-je obtenir un faux positif ?

Les détecteurs d'IA standard et gratuits sont connus pour signaler à tort des textes très formels et structurés – comme les notes juridiques, par exemple – comme étant générés par l'IA. Ce n'est toutefois pas le cas des outils professionnels utilisés par les universités pour vérifier la présence d'IA dans les documents juridiques ; ces outils sont conçus pour éviter ce problème et fournir des évaluations précises en matière d'IA.

La perplexité est ce que recherchent les détecteurs d'IA standard et gratuits. La perplexité est une mesure de la surprise statistique, ce qui signifie que les détecteurs d'IA basiques recherchent la prévisibilité et un niveau élevé de structure pour détecter l'utilisation de l'IA.

Les documents tels que la « Déclaration d'indépendance » sont très structurés et prévisibles, ce qui explique pourquoi de nombreux détecteurs d'IA basiques les identifient comme étant générés par l'IA. Les outils utilisés par les universités sont toutefois bien plus précis dans leurs évaluations.

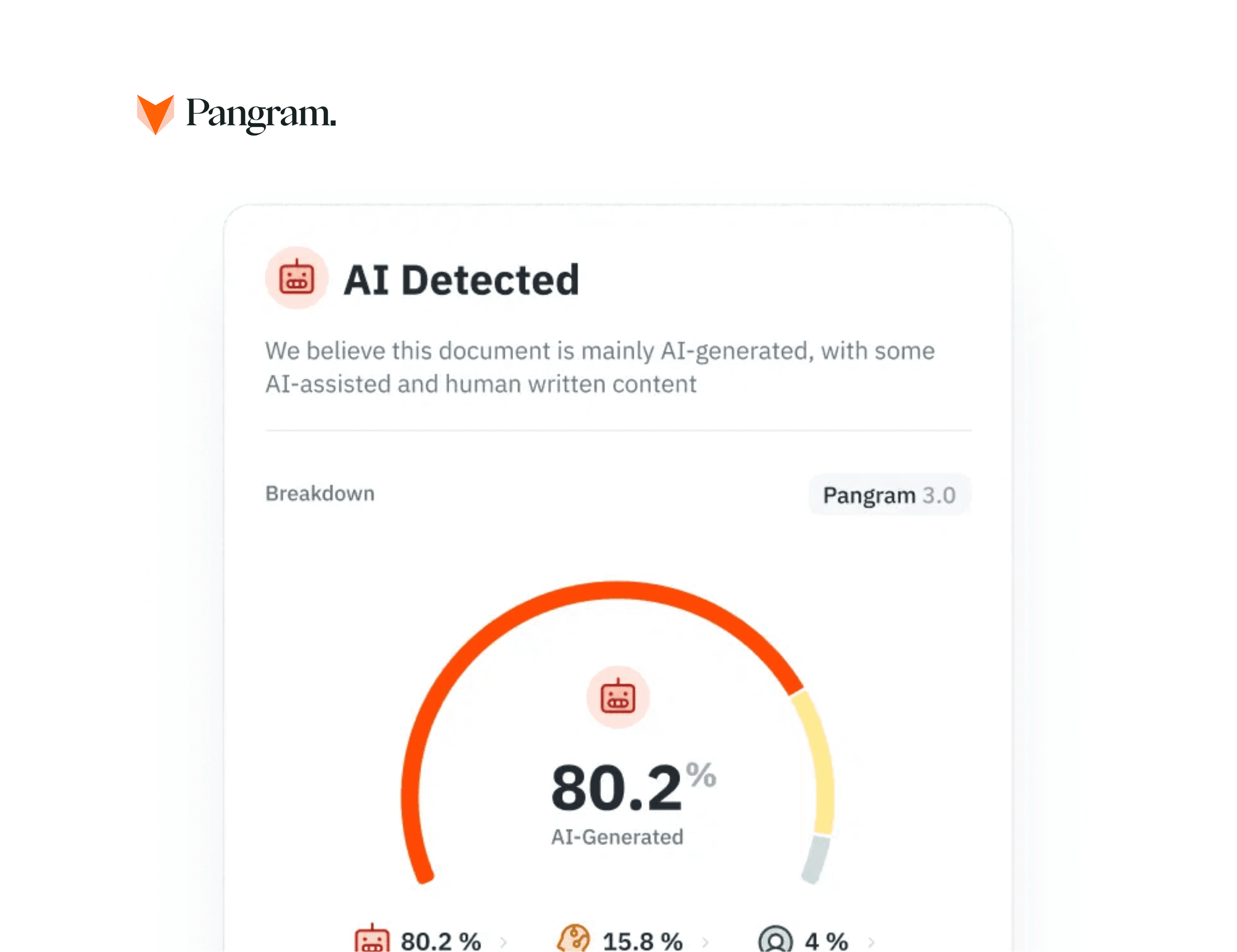

Si vous êtes un étudiant qui rédige ses propres travaux et n'utilise l'IA que dans les limites autorisées, vous n'avez aucune raison de vous inquiéter. Les outils universitaires haut de gamme, tels que Pangram, ont recours à la technique du « Hard Negative Mining » pour distinguer la syntaxe formelle et légale du texte généré par l'IA. Cela se traduit par un taux de faux positifs quasi nul, de l'ordre de 1 sur 10 000.

S'y retrouver dans les politiques relatives à l'IA dans l'enseignement du droit

Chaque faculté de droit a ses propres règles en matière d'IA. Certains professeurs sont stricts : l'IA y est totalement interdite. D'autres sont beaucoup plus ouverts à cette technologie et l'intègrent dans leurs programmes afin d'apprendre aux futurs juristes à utiliser les technologies juridiques de manière responsable.

À l'heure actuelle, le milieu juridique adopte l'IA générative pour les tâches courantes. Parmi ces tâches figurent notamment l'examen de documents et l'analyse de contrats. C'est pourquoi certains professeurs autorisent le recours à l'IA pour le brainstorming ou la rédaction d'un plan, mais uniquement si vous citez vos sources, dans la plupart des cas.

Si le programme d'une faculté de droit ou d'un professeur de droit ne précise pas explicitement que l'utilisation d'un modèle de langage artificiel (LLM) est autorisée pour un devoir, vous devez partir du principe que cette utilisation est strictement interdite. Si la faculté de droit a mis en place une politique relative à ChatGPT ou une série de directives concernant l'utilisation des modèles de langage artificiels (LLM), vous devez vous conformer à cette politique ou à ces directives.

La soumission de tout texte généré par l'IA sans en indiquer la source est généralement considérée comme une fraude académique. Si vous êtes reconnu coupable de fraude académique, vous vous exposez à de graves conséquences, dont l'expulsion est l'une des plus graves.

Bonnes pratiques pour protéger votre dossier scolaire

Les étudiants en droit et les candidats doivent suivre ces bonnes pratiques pour protéger leur dossier académique : rédigez toujours des travaux originaux, conservez l'historique de vos versions, gardez-le à portée de main après avoir rendu un devoir, et vérifiez au préalable vos documents pour vous assurer que vous n'avez pas utilisé l'IA pour de légères corrections grammaticales, pour trouver des idées ou pour toute autre tâche.

En plus d'appliquer ces bonnes pratiques, vous devriez relire votre texte pour rep érer les expressions typiques de l'IA. Les mots « delve », « tapestry » et « pivotal » font partie des expressions les plus courantes utilisées par l'IA. Une utilisation excessive de ces mots pourrait éveiller les soupçons de vos lecteurs et leur faire penser que vous avez eu recours à l'IA.

Si vous utilisez un outil d'IA pour la vérification orthographique, un vérificateur juridique avancé basé sur l'IA, tel que Pangram, est capable de faire la distinction entre les vérifications grammaticales « légèrement assistées par l'IA » et les textes « entièrement générés par l'IA ». Cette distinction peut vous aider à prouver que vous êtes bien l'auteur des arguments principaux d'un document donné.

Les facultés de droit surveillent de près l'utilisation de l'IA afin de préserver l'intégrité de la profession juridique et de ses membres.

Si l'IA est un outil puissant pour la synthèse, elle ne saurait remplacer le raisonnement juridique rigoureux et l'esprit critique indispensables à l'obtention d'un diplôme de droit.

Assurez-vous que votre lettre de motivation ou votre note juridique est bien de votre propre cru. Vérifiez l'authenticité de votre texte avant de l'envoyer.

Lectures complémentaires

Dans quelle mesure Pangram fonctionne-t-il sur le code IA ?

Que signifie votre score de détection d'IA ?

Détecteur de code IA : comment vérifier si un code a été écrit par ChatGPT, Copilot ou Claude

Est-ce l'IA qui a écrit ça ? 4 façons de vérifier si un texte a été généré

Une approche mosaïque de l'intégrité académique à l'ère de l'IA (avec Chris Ostro)

Présentation du détecteur de plagiat de Pangram

pour recevoir nos mises à jour.