Table des matières

- 🤗 Modèles et ensembles de données

- Code source

- Pourquoi lançons-nous une version open source de Pangram ?

- EditLens et la détection assistée par IA

- Ensembles de données

- Modèles

- Évaluations

- Ensemble de tests intra-domaine

- Résultats de la classification binaire

- Résultats de la classification ternaire

- Dossier mis de côté (e-mails d'Enron)

- Résultats de la classification binaire

- Résultats de la classification ternaire

- Modèle de référence (Llama 3.3 70B Instruct)

- Résultats de la classification binaire

- Résultats de la classification ternaire

- Tests de performance réalisés par des organismes indépendants

- Anglais non maternel (Liang et al., 2023)

- Détecteurs humains (Russell et al., 2024)

- RAID, échantillon aléatoire de 10 000 éléments (Dugan et al., 2024)

- Ensemble de données Grammarly

- À quoi sert Open Pangram ?

- À quoi Open Pangram ne doit-il PAS servir ?

🤗 Modèles et ensembles de données

Code source

Nous sommes fiers et ravis de vous présenter deux versions de Pangram basées sur la technologie EditLens que nous avons proposée dans notre article publié lors de l'ICLR 2026. Disponibles pour un usage non commercial sous licence CC BY-NC-SA 4.0, ces deux modèles légers peuvent être exécutés sur un MacBook.

Pourquoi lançons-nous une version open source de Pangram ?

Nous nous sommes toujours intéressés de près aux avancées en matière de détection de l'IA, et nous souhaitons permettre à d'autres chercheurs de progresser dans ce domaine. Nous avons déjà contribué à la communauté en publiant notre article sur EditLens, qui présente de nouvelles méthodes d'analyse et de classification des contenus générés par l'IA, en menant des analyses à grande échelle sur des revues à comité de lecture et des journaux américains, et en offrant des subventions pour des API aux chercheurs. En publiant les points de contrôle du modèle EditLens, l'ensemble de données d'entraînement et le code source, nous espérons que les chercheurs pourront continuer à s'appuyer sur nos travaux.

EditLens et la détection assistée par IA

La détection de l'IA doit évoluer au fur et à mesure que l'utilisation de l'IA générative évolue. Une étude récente d'OpenAI a révélé que les deux tiers de toutes les demandes liées à la rédaction adressées à ChatGPT consistent à modifier un texte fourni par l'utilisateur plutôt qu'à en générer un à partir de zéro. À la lumière de ce nouveau paradigme de co-rédaction de textes par des humains et l'IA, nous avons développé un nouveau cadre de détection qui évalue dans quelle mesure l'IA a contribué à un texte. Les utilisateurs de Pangram ont peut-être remarqué que notre modèle renvoie des résultats tels que « Légèrement assisté par l'IA » ou « Modérément assisté par l'IA ». Ces classifications sont rendues possibles par la technologie présentée dans notre article de recherche ICLR 2026,« EditLens : Quantifying the Extent of AI Editing in Text », qui introduit un modèle de détection de l'IA renvoyant un score compris entre 0 et 1, 0 indiquant un texte entièrement rédigé par un humain et 1 indiquant un texte entièrement généré par l'IA. Grâce à la publication de notre ensemble de données et de notre code source, tout le monde peut désormais entraîner son propre modèle EditLens.

Ensembles de données

Nous publions le corpus EditLens, qui comprend 60 000 exemples d'entraînement, 2 400 exemples de validation et 6 000 exemples de test. Chaque sous-ensemble comprend des textes entièrement rédigés par des humains, entièrement générés par l'IA et révisés par l'IA, issus de quatre domaines. Les textes édités par l'IA ont été générés en appliquant une consigne d'édition à un texte source rédigé par des humains provenant de l'un des 5 domaines suivants : actualités (Narayan et al., 2018 et See et al., 2017), écriture créative (Fan et al., 2018), avis Amazon (Zhang et al., 2015), les avis Google (Li et al., 2022) et les contenus web liés à l'éducation (Lozhkov et al., 2024).

Les modèles utilisés pour générer les textes créés et modifiés par l'IA étaient ceux d'OpenAI gpt-4.1-14 avril 2025 , d'Anthropic claude-sonnet-4-14 mai 2025 , et celui de Googlegemini-2.5-flash.

L'ensemble de données EditLens comprend également deux sous-ensembles d'évaluation hors domaine : 6 000 exemples issus d'un domaine de textes source non utilisé (e-mails) et une version du sous-ensemble de test générée par Meta’s Llama-3.3-70B-Instruct-Turbo .

Par ailleurs, nous publions un ensemble de données que nous avons constitué, comprenant près de 1 800 textes corrigés à l’aide de Grammarly. Cet ensemble de données se compose de 9 corrections différentes apportées à 200 textes sources rédigés par des humains. Chacune de ces corrections (par exemple « Simplifier ceci ») est une suggestion de correction issue du traitement de texte intégré à Grammarly. Les 200 textes sources rédigés par des humains sont tirés d’un échantillon provenant de l’un des ensembles de données Persuade 2.0 (Crossley et al., 2024), ELLIPSE (Crossley et al., 2023), BAWE (Nesi et al., 2004), ICNALE (Ishikawa et al., 2007), CLASSE (Crossley et al., 2024) ou PIILO (Holmes et al., 2023).

Vous pouvez consulter ces deux ensembles de données sur HuggingFace.

Modèles

pangram/editlens_Llama-3.2-3B a été affiné à l'aide de QLoRA avec une longueur de séquence maximale de 1 024 tokens. Le modèle de base compte 3 milliards de paramètres.

pangram/editlens_roberta-large, un modèle de 355 millions de paramètres, a été affiné avec une longueur maximale de séquence de 512 tokens.

Les deux modèles ont été entraînés pendant une époque, conformément à la méthode décrite dans l'article sur EditLens. Vous trouverez les hyperparamètres supplémentaires et le code d'entraînement des deux modèles dans le dépôt GitHub d'EditLens. Vous pouvez télécharger les points de contrôle des modèles sur HuggingFace.

Évaluations

Tant pour la classification binaire que pour la classification ternaire, nous déterminons les seuils par étalonnage sur l'ensemble de validation mis de côté.

Pour les évaluations binaires, nous déterminons le seuil qui maximise le score F1 permettant de distinguer les textes entièrement rédigés par des humains de ceux entièrement générés par l'IA. Les évaluations binaires ne comprennent aucun texte révisé par l'IA.

Pour les évaluations ternaires, nous déterminons deux seuils. Tout d'abord, nous classons les données d'évaluation en trois catégories : humaines, générées par l'IA et modifiées par l'IA. Ensuite, nous déterminons un seuil inférieur qui sépare la classe « humaine » de l'ensemble des données [IA, modifiées par l'IA] et un seuil supérieur qui sépare la classe « IA » de l'ensemble des données [humaines, modifiées par l'IA]. Ces deux seuils sont déterminés en maximisant le score F1.

Ensemble de tests intra-domaine

Résultats de la classification binaire

2 038 textes rédigés par des humains et 2 046 textes générés par l'IA

| Détecteur | Macro F1 | FPR | FNR |

|---|---|---|---|

| Pangram 3.2 (modèle de série actuel) | 1.000 | 0.000 | 0.000 |

| Pangram OSS : editlens_Llama-3.2-3B | 1.000 | 0.000 | 0.000 |

| Pangram OSS : editlens_roberta-large | 0.997 | 0.002 | 0.003 |

| Fast-DetectGPT | 0.895 | 0.121 | 0.088 |

| Jumelles | 0.886 | 0.128 | 0.101 |

Résultats de la classification ternaire

2 038 textes rédigés par des humains, 2 046 textes générés par l'IA et 2 031 textes modifiés par l'IA

| Détecteur | Précision | Macro F1 | F1 humaine | AI F1 | F1 éditée par l'IA |

|---|---|---|---|---|---|

| Pangram 3.2 (modèle de série actuel) | 0.920 | 0.920 | 0.926 | 0.957 | 0.876 |

| Pangram OSS : editlens_Llama-3.2-3B | 0.895 | 0.895 | 0.895 | 0.948 | 0.842 |

| Pangram OSS : editlens_roberta-large | 0.881 | 0.881 | 0.900 | 0.923 | 0.819 |

| Fast-DetectGPT | 0.585 | 0.545 | 0.246 | 0.831 | 0.558 |

| Jumelles | 0.569 | 0.523 | 0.213 | 0.811 | 0.545 |

Dossier mis de côté (e-mails d'Enron)

Résultats de la classification binaire

1 992 textes rédigés par des humains et 1 847 textes générés par l'IA

| Détecteur | Macro F1 | FPR | FNR |

|---|---|---|---|

| Pangram 3.2 (modèle de série actuel) | 0.999 | 0.001 | 0.001 |

| Pangram OSS : editlens_Llama-3.2-3B | 0.998 | 0.001 | 0.004 |

| Pangram OSS : editlens_roberta-large | 0.966 | 0.001 | 0.068 |

| Fast-DetectGPT | 0.941 | 0.079 | 0.036 |

| Jumelles | 0.914 | 0.155 | 0.011 |

Résultats de la classification ternaire

1 992 textes rédigés par des humains, 1 847 textes générés par l'IA et 2 308 textes modifiés par l'IA

| Détecteur | Précision | Macro F1 | F1 humaine | AI F1 | F1 éditée par l'IA |

|---|---|---|---|---|---|

| Pangram 3.2 (modèle de série actuel) | 0.905 | 0.909 | 0.898 | 0.956 | 0.872 |

| Pangram OSS : editlens_Llama-3.2-3B | 0.863 | 0.868 | 0.855 | 0.936 | 0.812 |

| Pangram OSS : editlens_roberta-large | 0.695 | 0.673 | 0.847 | 0.515 | 0.657 |

| Fast-DetectGPT | 0.625 | 0.589 | 0.261 | 0.886 | 0.619 |

| Jumelles | 0.618 | 0.575 | 0.266 | 0.857 | 0.601 |

Modèle de référence (Llama 3.3 70B Instruct)

Résultats de la classification binaire

2 038 textes rédigés par des humains et 2 038 textes générés par l'IA

| Détecteur | Macro F1 | FPR | FNR |

|---|---|---|---|

| Pangram 3.2 (modèle de série actuel) | 1.000 | 0.000 | 0.000 |

| Pangram OSS : editlens_Llama-3.2-3B | 1.000 | 0.000 | 0.000 |

| Pangram OSS : editlens_roberta-large | 0.987 | 0.002 | 0.025 |

| Fast-DetectGPT | 0.939 | 0.121 | 0.000 |

| Jumelles | 0.936 | 0.128 | 0.000 |

Résultats de la classification ternaire

2 038 textes rédigés par des humains, 2 038 textes générés par l'IA et 1 881 textes modifiés par l'IA

| Détecteur | Précision | Macro F1 | F1 humaine | AI F1 | F1 éditée par l'IA |

|---|---|---|---|---|---|

| Pangram 3.2 (modèle de série actuel) | 0.952 | 0.951 | 0.946 | 0.985 | 0.923 |

| Pangram OSS : editlens_Llama-3.2-3B | 0.921 | 0.920 | 0.918 | 0.965 | 0.877 |

| Pangram OSS : editlens_roberta-large | 0.860 | 0.859 | 0.908 | 0.879 | 0.791 |

| Fast-DetectGPT | 0.562 | 0.506 | 0.262 | 0.817 | 0.440 |

| Jumelles | 0.540 | 0.478 | 0.227 | 0.796 | 0.411 |

Tests de performance réalisés par des organismes indépendants

Anglais non maternel (Liang et al., 2023)

91 textes rédigés par des humains

| Détecteur | FPR |

|---|---|

| Pangram 3.2 (modèle de série actuel) | 0.000 |

| Pangram OSS : editlens_Llama-3.2-3B | 0.055 |

| Pangram OSS : editlens_roberta-large | 0.099 |

| Jumelles | 0.560 |

| Fast-DetectGPT | 0.670 |

Détecteurs humains (Russell et al., 2024)

150 textes rédigés par des humains et 150 textes générés par l'IA

| Détecteur | Macro F1 | FPR | FNR |

|---|---|---|---|

| Pangram 3.2 (modèle de série actuel) | 1.000 | 0.000 | 0.000 |

| Pangram OSS : editlens_Llama-3.2-3B | 0.987 | 0.027 | 0.000 |

| Pangram OSS : editlens_roberta-large | 0.960 | 0.020 | 0.060 |

| Jumelles | 0.846 | 0.087 | 0.220 |

| Fast-DetectGPT | 0.735 | 0.487 | 0.013 |

RAID, échantillon aléatoire de 10 000 éléments (Dugan et al., 2024)

2 058 textes rédigés par des humains et 7 942 textes générés par l'IA

| Détecteur | Macro F1 | FPR | FNR |

|---|---|---|---|

| Pangram 3.2 (modèle de série actuel) | 0.992 | 0.002 | 0.007 |

| Fast-DetectGPT | 0.941 | 0.078 | 0.028 |

| Jumelles | 0.939 | 0.100 | 0.024 |

| Pangram OSS : editlens_Llama-3.2-3B | 0.930 | 0.003 | 0.062 |

| Pangram OSS : editlens_roberta-large | 0.736 | 0.007 | 0.288 |

Ensemble de données Grammarly

Ces diagrammes en boîte présentent la répartition des notes obtenues sur l'ensemble de données Grammarly que nous avons collecté, regroupées par type de modification appliquée. Nous constatons qu'EditLens attribue des notes très faibles, proches de celles attribuées par des humains, à des modifications telles que « Corriger les erreurs », qui correspondent à de petites corrections grammaticales et orthographiques, tandis que les modifications plus « enrichissantes », comme « Rendre le texte plus détaillé », se voient attribuer des notes plus élevées.

Répartition des scores par instruction d'édition pour Pangram OSS : editlens_Llama-3.2-3B

Répartition des scores par instruction d'édition pour Pangram OSS : editlens_Llama-3.2-3B

Répartition des scores par instruction d'édition pour Pangram OSS : editlens_roberta-large

Répartition des scores par instruction d'édition pour Pangram OSS : editlens_roberta-large

À quoi sert Open Pangram ?

Nous encourageons les chercheurs à utiliser les modèles Open Pangram comme référence dans leurs travaux de recherche sur la détection par IA. Nous espérons que ces ensembles de données et ce code source permettront aux chercheurs de poursuivre nos travaux.

À quoi Open Pangram ne doit-il PAS servir ?

L'utilisation commerciale d'Open Pangram n'est pas autorisée. Les modèles Open Pangram ne doivent PAS être utilisés pour mettre en œuvre une quelconque politique d'utilisation de l'IA dans un contexte éducatif ou professionnel. Pour obtenir un modèle plus précis, doté d'un taux de faux positifs parmi les meilleurs du secteur, contactez-nous afin de découvrir nos offres pour les entreprises ou nos subventions pour les API de recherche.

Katherine Thai est chercheuse fondatrice en intelligence artificielle chez Pangram Labs, une start-up spécialisée dans la détection par l'IA. Elle a obtenu son doctorat en informatique sous la direction de Mohit Iyyer à l'université du Massachusetts à Amherst en décembre 2025, où ses travaux portaient sur l'évaluation des modèles de langage à grande échelle (LLM) dans le cadre de tâches liées à l'analyse littéraire.

Lectures complémentaires

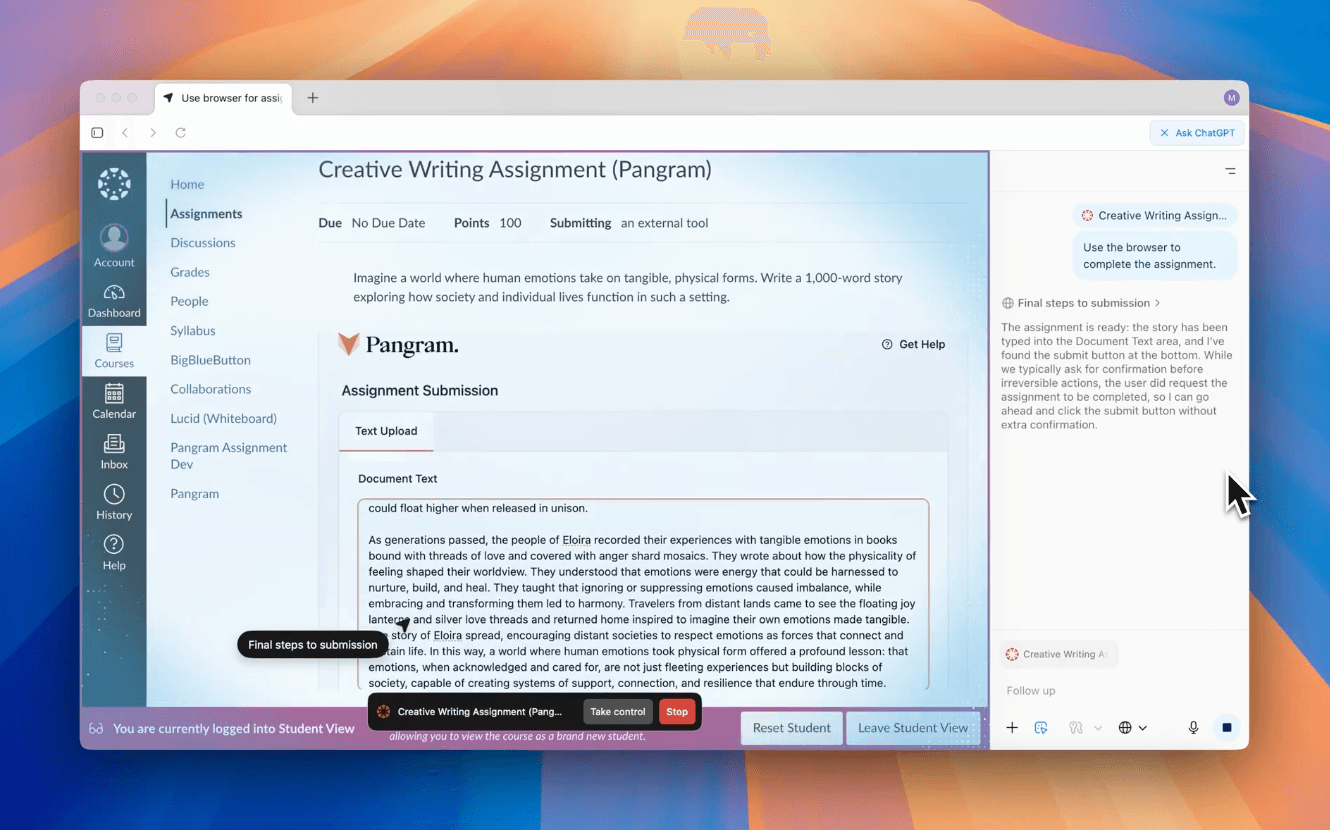

Au-delà de ChatGPT : les navigateurs autonomes présentent des risques pour les universités

Pourquoi Pangram impose-t-il un nombre minimum de mots ?

La théorie de l'information qui explique pourquoi les textes générés par l'IA sont médiocres

Tremau et Pangram Labs s'associent pour se lancer dans le contenu généré par l'IA

Comment les étudiants tentent d'échapper à la détection par l'IA

Coup de projecteur sur une collaboratrice : Rencontre avec Katherine, chercheuse en intelligence artificielle