Was ist ein Essay-Checker?

In der Vergangenheit bezeichnete der Begriff „Essay Checker“ Tools, die einen Text auf Rechtschreib-, Grammatik- und Wortwahlfehler analysieren. Sie konnten auch dazu dienen, Probleme bei Zitaten zu überprüfen, wie es bei Recite der Fall ist. Turnitin, ein beliebtes Tool im Bildungsbereich, hat sich bei der Plagiatsprüfung als große Hilfe erwiesen.

Der aktuelle KI-Boom hat Pädagogen dazu veranlasst, Programme in Betracht zu ziehen, die nach KI-generierten Inhalten suchen.

Sind KI-Plagiatsprüfprogramme zuverlässig?

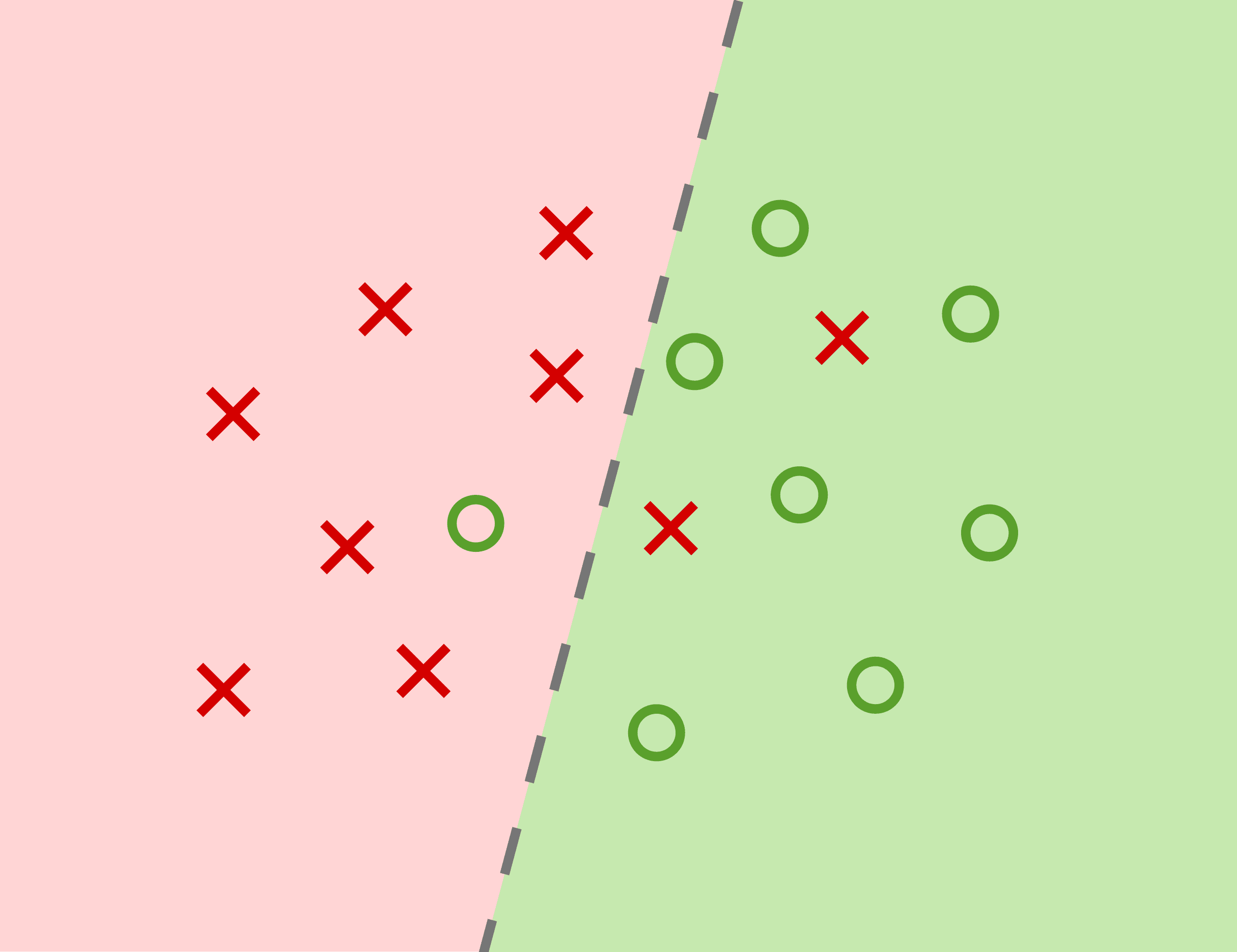

Hohe Falsch-Positiv-Raten (FPR) sind für Lehrkräfte ein großes Problem. Der Vorwurf akademischer Unredlichkeit kann riskant sein, da ein solcher Vorwurf, der auf einem Falsch-Positiv-Ergebnis beruht, das Verhältnis zwischen Lehrkraft und Schüler beeinträchtigen kann.

Mit einer FPR von 0,01 % ist Pangram jedoch ein zuverlässiger Plagiatsdetektor für den Einsatz im Hochschulbereich. Dies wurde auch von unabhängigen Dritten bestätigt, die zu dem Schluss kommen, dass Pangram der genaueste im Handel erhältliche KI-Plagiatsdetektor ist.

KI-Aufsatzprüfer vs. Plagiatsprüfer

Ein KI-Aufsatzprüfer erkennt den Einsatz von KI in einem bestimmten Text. Plagiatsprüfer ermitteln die Verwendung von fremdem Material in einem Text.

Pangram ist ein kommerzielles Tool, das sowohl KI-generierte als auch plagiierte Inhalte erkennen kann. Bei der Textanalyse behandelt Pangram beide Fälle separat.

Kann KI menschliche Werke plagiieren?

Ein Plagiatsprüfer vergleicht einen Aufsatz mit bereits vorhandenen Texten, um Ähnlichkeiten festzustellen. Ein KI-Aufsatzprüfer durchsucht einen Text nach Sprachmustern, die den aktuellen KI-Modellen ähneln.

Große Sprachmodelle wie ChatGPT generieren Texte anhand umfangreicher Datensätze und sind dafür bekannt, dass sie aus diesen Daten plagiieren. In einem Artikel von Amy B. Cyphert, außerordentliche Professorin am College of Law der West Virginia University, heißt es:

„Forschungsergebnisse deuten darauf hin, dass die Wahrscheinlichkeit, dass ein LLM eine Ausgabe erzeugt, die unveränderten Text aus diesem Werk enthält, umso größer ist, je häufiger urheberrechtlich geschütztes Material in einem Datensatz enthalten ist.“

Auswendiglernen findet statt, wenn ein LLM Formulierungen aus Texten des Trainingsdatensatzes wiedergibt. Ob beabsichtigt oder nicht, LLMs können dazu veranlasst werden, die Werke anderer in großen Teilen zu reproduzieren. Das bedeutet, dass das Endergebnis der Eingabeaufforderung teilweise oder vollständig ein Plagiat sein kann.

Während Forscher weiterhin über eine differenziertere Definition von Plagiaten diskutieren, legen die Richtlinien zur akademischen Integrität an Universitäten fest, dass ein Plagiat die Verwendung fremder Werke ohne Quellenangabe ist. Die University of Michigan weist darauf hin, dass Plagiate sowohl vorsätzlich als auch unbeabsichtigt sein können. Die Oxford University nennt verschiedene Formen von Plagiaten, darunter das wörtliche Zitieren ohne Quellenangabe, das Kopieren und Einfügen aus dem Internet, das Umschreiben von Texten, Absprachen sowie das Versäumnis, Hilfe anzuerkennen, usw.

Also an einer akademischen Einrichtung:

Wenn ein Schüler eine von einer KI erstellte Arbeit einreicht, reicht er möglicherweise auch eine von Menschen verfasste Arbeit ein, die ein Plagiat darstellt!

Können Menschen von KI generierte Werke plagiieren?

Nach manchen Maßstäben vielleicht!

Wenn ein Studierender eine von einer KI erstellte Arbeit einreicht, ohne die KI als Quelle anzugeben, liegt ein Fall von akademischer Unredlichkeit vor. In den Richtlinien der University of South Florida heißt es:

„Da KI-Chatbots und andere generative KI-Tools als Reaktion auf Eingabeaufforderungen neue Texte und Bilder erzeugen, könnte die Verwendung von Material aus generativer KI eher als Ghostwriting denn als Plagiat angesehen werden.“

Das Committee on Publication Ethics stellt fest, dass KI in einer wissenschaftlichen Arbeit nicht als Autor angesehen werden kann, da „KI-Tools die Anforderungen an die Urheberschaft nicht erfüllen können, da sie keine Verantwortung für die eingereichte Arbeit übernehmen können. Als nicht rechtsfähige Einheiten können sie weder das Vorliegen oder Nichtvorliegen von Interessenkonflikten geltend machen noch Urheberrechts- und Lizenzvereinbarungen verwalten.“

Einige akademische Einrichtungen sind der Ansicht, dass die Verwendung von KI-generierten Inhalten zweifellos ein Plagiat darstellt:

„Plagiat ist die Darstellung von Ideen, Forschungsergebnissen oder Texten, die nicht von einem selbst stammen, als eigene Arbeit. Beispiele für Plagiate sind: das Kopieren der wörtlichen Äußerungen oder Bilder einer anderen Person oder eines KI-Tools ohne Verwendung von Anführungszeichen und Quellenangaben, die die Äußerungen ihrer Quelle zuordnen. – City University of New York“

„Plagiat liegt vor, wenn man die Ideen anderer übernimmt und sie als seine eigenen ausgibt, auch wenn dies unbeabsichtigt geschieht. Wenn du KI nutzt, um eine Idee zusammenzufassen oder deine Arbeit zu verfassen, ist diese nicht zu 100 % dein eigenes Werk.“ – Ohio University

In anderen Fällen tragen Pädagogen zudem die Verantwortung für die Ausarbeitung von KI-Richtlinien, wie zum Beispiel:

„Klare Richtlinien für einzelne Kurse oder Aufgaben ermöglichen es den Studierenden, sich auf die Lernziele zu konzentrieren, die Sie mit ihnen erreichen möchten. Da Studierende oft unsicher sind, wann oder ob sie generative KI einsetzen dürfen, sind Richtlinien besonders hilfreich, wenn sie auf Ihren spezifischen Kurs und Ihre Aufgaben zugeschnitten sind, da manche Anwendungen der KI das Lernen der Studierenden zwar unterstützen können, andere jedoch wichtige Prozesse stören könnten, die die Studierenden selbstständig durcharbeiten müssen.“ – UPenn

„Die Festlegung klarer Richtlinien für den Einsatz von KI ist unerlässlich, um die akademische Integrität zu wahren und den Studierenden klare Erwartungen zu vermitteln. Diese Richtlinien sollten darlegen, wann und wie KI-Tools wie ChatGPT, Perplexity.ai oder Grammarly genutzt werden dürfen, und sicherstellen, dass die Studierenden die ethischen Implikationen des KI-Einsatzes in der akademischen Arbeit verstehen.“ – NYU

Anhand dieser kleinen Auswahl an Hochschulrichtlinien lässt sich erkennen, wie unterschiedlich die einzelnen Einrichtungen den Einsatz von KI und Plagiate bewerten. KI ist zwar ein Werkzeug und kein Autor, doch die Vorlage von KI-generierten Ergebnissen ohne Quellenangabe ist unehrlich. Lehrende sollten ihren Studierenden klare Erwartungen vorgeben. Um mehr über durchsetzbare Kursrichtlinien zu erfahren, hat Professor Christopher Ostro einen differenzierten Ansatz zur Bekämpfung von Betrug mittels KI vorgestellt.

Pangram verfolgt einen transparenzorientierten Ansatz beim Einsatz von KI und der Verwendung externer Inhalte, insbesondere im akademischen Bereich. Wenn Sie sich für unser Modell interessieren, testen Sie die KI- und Plagiatserkennungs-Tools von Pangram kostenlos!

Destiny ist Praktikantin im Bereich Marktforschung bei Pangram. Außerdem studiert sie an der NYC College of Technology Angewandte Mathematik und Chemie. Destinys Arbeit bei Pangram hat wesentlich zur Erforschung von KI-Müll im Internet beigetragen. Neben ihrer Arbeit und ihrem Studium widmet sich Destiny leidenschaftlich dem kreativen Schreiben und der Horrorliteratur.

Weiterführende Literatur

KI-Wasserzeichen: Warum die großen Tech-Konzerne auf KI-Herkunftsnachweise setzen – und dabei den Kürzeren ziehen

KI-Prüfprogramme für Lehrkräfte: Warum Schulen KI-Erkennungswerkzeuge brauchen

Wird Google im Jahr 2026 von KI generierte Inhalte abstrafen?

KI-Humanisierer: Das (Slop)^2-Problem

Ein Rundgang durch die am häufigsten verwendeten Ausdrücke im Bereich der KI

Alles über Fehlalarme bei KI-Detektoren