Sachez immédiatement ce qui est publié par des humains et ce qui l'est par l'IA sur Twitter, LinkedIn, Substack et bien d'autres plateformes. Téléchargez notre nouvelle extension Chrome.

Qu'est-ce qu'un vérificateur d'essais ?

Dans le passé, le terme « vérificateur d'essais » désignait les outils qui analysaient un texte à la recherche d'erreurs d'orthographe, de grammaire et de vocabulaire. Ils pouvaient également être utilisés pour vérifier les citations, comme dans Recite. Turnitin, un outil pédagogique très populaire, s'est révélé très utile pour détecter le plagiat.

Actuellement, l'essor de l'IA a poussé les enseignants à envisager l'utilisation de vérificateurs qui recherchent les contenus générés par l'IA.

Les correcteurs automatiques basés sur l'IA sont-ils précis ?

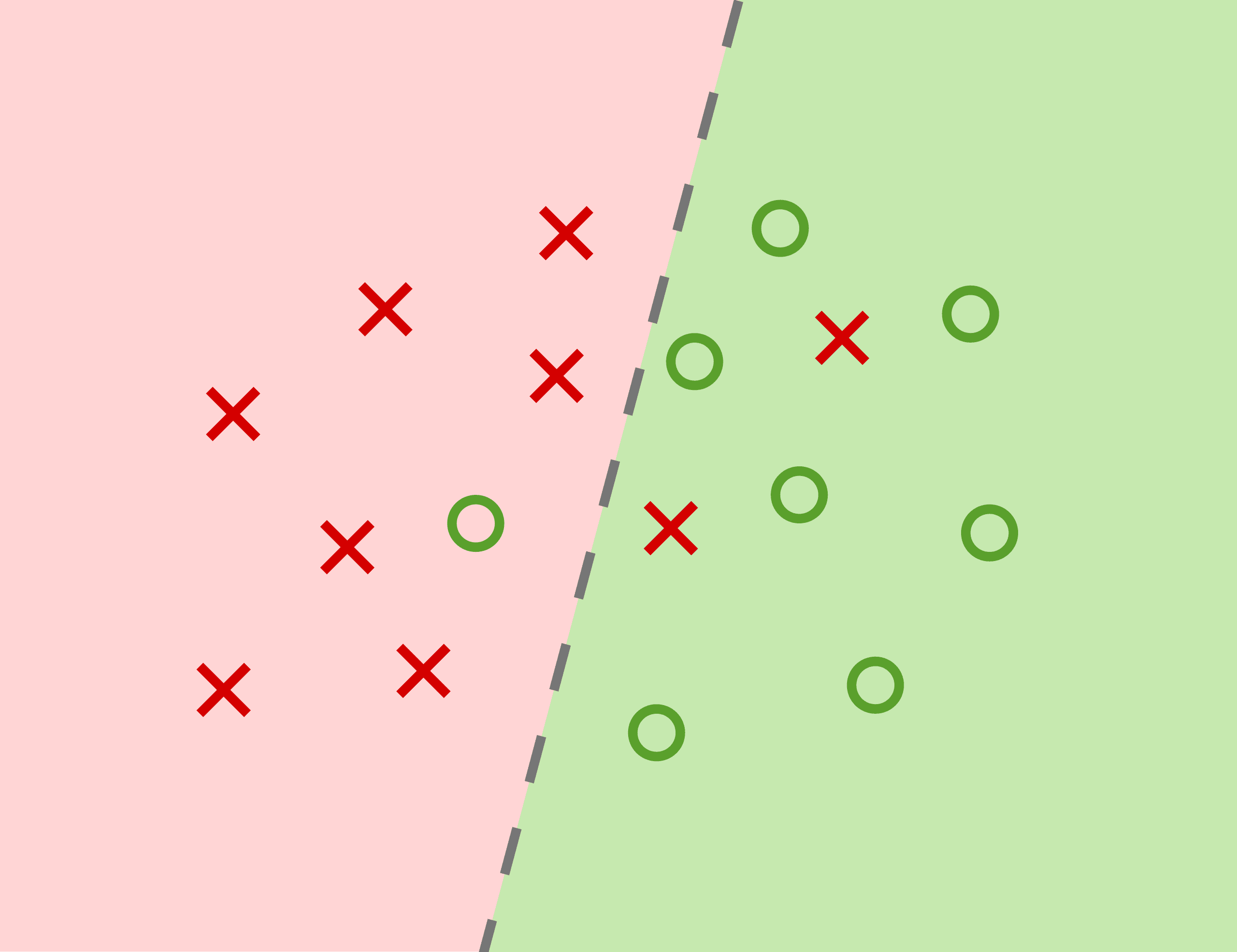

Les taux élevés de faux positifs (FPR) constituent une préoccupation majeure pour les enseignants. Il peut être risqué de dénoncer une fraude scolaire, car une accusation fondée sur un faux positif peut nuire à la relation enseignant-élève.

Cependant, le FPR de 0,01 % de Pangram en fait un détecteur fiable pour une utilisation dans l'enseignement supérieur. Cela a également été corroboré par des tiers, qui concluent que Pangram est le détecteur d'IA le plus précis disponible sur le marché.

Vérificateur d'essais IA vs vérificateur de plagiat

Un vérificateur d'essais IA note l'utilisation de l'IA dans un texte particulier. Les vérificateurs de plagiat déterminent l'utilisation de matériel externe dans un texte.

Pangram est un outil commercial capable de détecter à la fois les contenus générés par l'IA et les contenus plagiés. Pangram les signale comme deux cas distincts lors de l'analyse d'un texte.

L'IA peut-elle plagier le travail humain ?

Un vérificateur de plagiat compare un essai à des textes existants afin de détecter les similitudes. Un vérificateur d'essais basé sur l'IA analyse un texte à la recherche de schémas linguistiques similaires à ceux des modèles d'IA actuels.

Les modèles linguistiques à grande échelle (LLM) tels que ChatGPT génèrent du texte à partir de vastes ensembles de données et sont connus pour plagier ces données. Dans un article publié dans une revue, Amy B. Cyphert, professeure agrégée à la faculté de droit de l'université de Virginie-Occidentale, note que :

« Les recherches suggèrent que plus un ensemble de données contient de matériel protégé par le droit d'auteur, plus il est probable qu'un LLM produise un résultat incluant du texte inchangé provenant de cet ouvrage. »

La mémorisation se produit lorsqu'un LLM reproduit des phrases tirées du texte de l'ensemble d'entraînement. De manière intentionnelle ou non, les LLM peuvent être incités à reproduire en grande partie le travail d'autres personnes. Cela signifie que le résultat final de l'incitation peut être plagié en partie ou en totalité.

Alors que les chercheurs continuent de débattre d'une définition plus nuancée du plagiat, les politiques d'intégrité académique des universités stipulent que le plagiat consiste à utiliser le travail de quelqu'un d'autre sans le citer. L'université du Michigan note que le plagiat peut être intentionnel ou non. L'université d'Oxford détaille plusieurs formes de plagiat, notamment les citations textuelles non reconnues, le copier-coller à partir d'Internet, la paraphrase, la collusion, le fait de ne pas reconnaître l'aide apportée, etc.

Ainsi, dans un établissement universitaire :

Lorsqu'un étudiant soumet un travail généré par l'IA, il peut également remettre un travail plagié rédigé par un humain !

Les humains peuvent-ils plagier les œuvres générées par l'IA ?

Selon certains critères, peut-être !

Lorsqu'un étudiant soumet un travail généré par l'IA sans mentionner cette dernière, il commet une fraude académique. La politique de l'université de Floride du Sud stipule :

« Étant donné que les chatbots IA et autres outils IA génératifs produisent de nouveaux textes et images en réponse à des requêtes, l'utilisation de matériel issu de l'IA générative pourrait être considérée davantage comme de l'écriture fantôme que comme du plagiat. »

Le Comité sur l'éthique de la publication note que l'IA ne peut être considérée comme un auteur dans un article de recherche, car « les outils d'IA ne peuvent pas répondre aux exigences en matière de paternité, car ils ne peuvent pas assumer la responsabilité du travail soumis. En tant qu'entités non juridiques, ils ne peuvent pas affirmer la présence ou l'absence de conflits d'intérêts, ni gérer les accords de droits d'auteur et de licence. »

Certaines institutions universitaires considèrent que l'utilisation de contenus générés par l'IA constitue clairement un plagiat :

« Le plagiat consiste à présenter comme siennes des idées, des recherches ou des écrits qui ne vous appartiennent pas. Voici quelques exemples de plagiat : copier les mots ou les images d'une autre personne ou d'un outil d'IA sans utiliser de guillemets ni de citations attribuant les mots à leur source. - City University of New York

« Le plagiat consiste à s'approprier les idées d'autrui et à les présenter comme les siennes, même involontairement. Si vous utilisez l'IA pour résumer une idée ou rédiger votre travail, celui-ci n'est pas entièrement le vôtre. » - Université de l'Ohio

Dans d'autres cas, les éducateurs sont chargés d'élaborer des politiques en matière d'IA, telles que :

« Des directives claires pour chaque cours ou devoir permettent aux étudiants de se concentrer sur les objectifs d'apprentissage que vous souhaitez leur faire atteindre. Comme les étudiants ne savent souvent pas quand ni s'ils peuvent utiliser l'IA générative, les politiques peuvent être très utiles lorsqu'elles sont adaptées à votre cours et à vos devoirs spécifiques, car certaines utilisations de l'IA peuvent favoriser l'apprentissage des étudiants, tandis que d'autres peuvent perturber des processus importants que les étudiants doivent accomplir par eux-mêmes. » - UPenn

« Il est essentiel de définir des politiques claires concernant l'utilisation de l'IA afin de préserver l'intégrité académique et de fixer les attentes des étudiants. Ces politiques doivent préciser quand et comment les outils d'IA tels que ChatGPT, Perplexity.ai ou Grammarly peuvent être utilisés, et veiller à ce que les étudiants comprennent les implications éthiques de l'IA dans le cadre de leurs travaux universitaires. » - NYU

À partir de ce petit échantillon de politiques universitaires, nous pouvons comprendre les différentes façons dont les établissements perçoivent l'utilisation de l'IA et le plagiat. Bien que l'IA soit un outil et non un auteur, présenter des résultats générés par l'IA sans le mentionner est malhonnête. Les enseignants doivent définir des attentes claires pour leurs étudiants. Pour en savoir plus sur les politiques applicables aux cours, le professeur Christopher Ostro a proposé une approche nuancée pour lutter contre la tricherie liée à l'IA.

Pangram adopte une approche favorable à la transparence en matière d'utilisation de l'IA et de contenu externe, en particulier dans le milieu universitaire. Si notre modèle vous intéresse, essayez gratuitement les outils de détection de plagiat et d'IA de Pangram!

Destiny est stagiaire en analyse de recherche chez Pangram. Elle est également étudiante au NYC College of Technology, où elle suit des cours de mathématiques appliquées et de chimie. Le travail de Destiny chez Pangram a grandement contribué à l'étude des dérives de l'IA sur Internet. En dehors du travail et de ses études, Destiny se passionne pour l'écriture créative et la fiction d'horreur.

Lectures complémentaires

Le tatouage numérique par IA : pourquoi les géants de la tech misent sur la traçabilité par IA… et échouent

AI Checkers pour les enseignants : pourquoi les écoles ont besoin d'outils de détection de l'IA

Google va-t-il pénaliser les contenus générés par l'IA en 2026 ?

Les « humaniseurs » de l'IA : le problème (Slop)^2

Passage en revue des expressions les plus utilisées dans le domaine de l'IA

Tout savoir sur les faux positifs dans les détecteurs d'IA

pour recevoir nos mises à jour.