اعرف على الفور ما هو من صنع البشر وما هو من صنع الذكاء الاصطناعي على تويتر ولينكدإن وسوبستاك وغيرها. احصل على ملحق كروم الجديد الخاص بنا.

قدم برادلي إيمي، المدير التقني لشركة Pangram Labs، جلسة حول حالة الكشف عن الذكاء الاصطناعي في مؤتمر ICAI.

يستخدم الطلاب ChatGPT ويستغلونه بشكل مفرط. يستخدم معظم الطلاب أدوات الذكاء الاصطناعي بانتظام ويعتقدون أن أداءهم سيتحسن باستخدام هذه الأدوات. حتى مع وجود سياسات واضحة ضد استخدام الذكاء الاصطناعي، من المرجح أن يستمر الطلاب في استخدامه.

خلافاً للاعتقاد السائد: يمكن اكتشاف الذكاء الاصطناعي. يمكن تمييز اللغة والأسلوب والخيارات الدلالية من قبل البشر والبرامج الآلية (مع تدريب كافٍ).

لماذا يبدو صوت الذكاء الاصطناعي هكذا؟

LLMs هي توزيعات احتمالية تتعلم من خلال كميات كبيرة من البيانات. وهي ليست متوسط كل ما يكتبه البشر. ويرجع ذلك إلى طريقة تدريب النماذج.

يتم تدريب النماذج على ثلاث مراحل: التدريب المسبق، وضبط التعليمات، والمواءمة.

في مرحلة ما قبل التدريب، يحلل النموذج الأنماط الإحصائية من مجموعة بيانات كبيرة. تحتوي مجموعة بيانات التدريب على تحيزات تظهر في الأنماط الإحصائية. على سبيل المثال، البيانات التي تظهر بشكل متكرر على الإنترنت ممثلة بشكل زائد. في مقال نشرته صحيفة الغارديان، يشرح أليكس هيرن كيف تم استغلال العمال في كينيا ونيجيريا لتوفير بيانات تدريب لـ OpenAI. الكلمات التي يستخدمها هؤلاء العمال بشكل متكرر مثل "delve" و "tapestry" هي نفس الكلمات التي تظهر بشكل متكرر في النصوص التي تم إنشاؤها بواسطة الذكاء الاصطناعي.

في ضبط التعليمات، يتم تدريب النموذج على الاستجابة للمطالبات. يتعلم النموذج أنه من الأفضل اتباع التعليمات بدلاً من تقديم معلومات دقيقة وصحيحة. حتى عند تطبيق مرشحات الأمان، لا تزال المعلومات الخاطئة تعاني من الكتابة بالذكاء الاصطناعي في محاولتها لإرضاء المستخدم.

أثناء عملية المحاذاة، يتعلم النموذج الفرق بين الاستجابات الجيدة والسيئة للمطالبات. قد تكون بيانات التفضيلات متحيزة للغاية، لأنها تستند إلى وجهات نظر المدرب، وليس بالضرورة إلى الحقائق.

لقد قدمنا عينة من الكلمات والعبارات الأكثر شيوعًا المستخدمة في الكتابة بالذكاء الاصطناعي. هذه الكلمات والعبارات مستمدة من التحيزات التي تم إدخالها في مرحلة ما قبل التدريب.

تشتهر الذكاء الاصطناعي بلغة وتنسيق عاليي التنظيم. تنتشر العبارات الانتقالية والقوائم النقطية والكتابة الأنيقة في كتابات الذكاء الاصطناعي بسبب مرحلة المحاذاة.

غالبًا ما تكون الكتابة بالذكاء الاصطناعي رسمية لأن النصوص الرسمية ممثلة بشكل زائد على الإنترنت، وبالتالي ممثلة بشكل زائد في مجموعات بيانات تدريب الذكاء الاصطناعي. يتم تعزيز الإيجابية والفائدة أثناء عملية المحاذاة.

ملاحظة: لا يتنبأ Pangram باستخدام الذكاء الاصطناعي لمجرد أن النص يحتوي على لغة وتنسيق شائعين في الذكاء الاصطناعي.

الإنسانيون في الأوساط الأكاديمية

لقد درسنا 19 أداة مختلفة لتحويل النصوص إلى لغة بشرية وصنعنا أداة خاصة بنا. ووجدنا أن أدوات تحويل النصوص إلى لغة بشرية باستخدام الذكاء الاصطناعي تحافظ على المعنى الأصلي بدرجات متفاوتة (تتراوح بين تعديلات طفيفة ونصوص غير مفهومة). بعض أدوات تحويل النصوص إلى لغة بشرية تقوم بعمل جيد في إعادة صياغة النصوص ولكنها لا تتجنب الكشف. كلما كان النص المحول إلى لغة بشرية أكثر طلاقة، قل احتمال تجنبه للكشف. تستطيع أدوات إضفاء الطابع الإنساني إزالة علامة SynthID المائية من Google (التي تُستخدم لتمييز النصوص التي تم إنشاؤها بواسطة Gemini).

الكشف الآلي والبشري عن الذكاء الاصطناعي

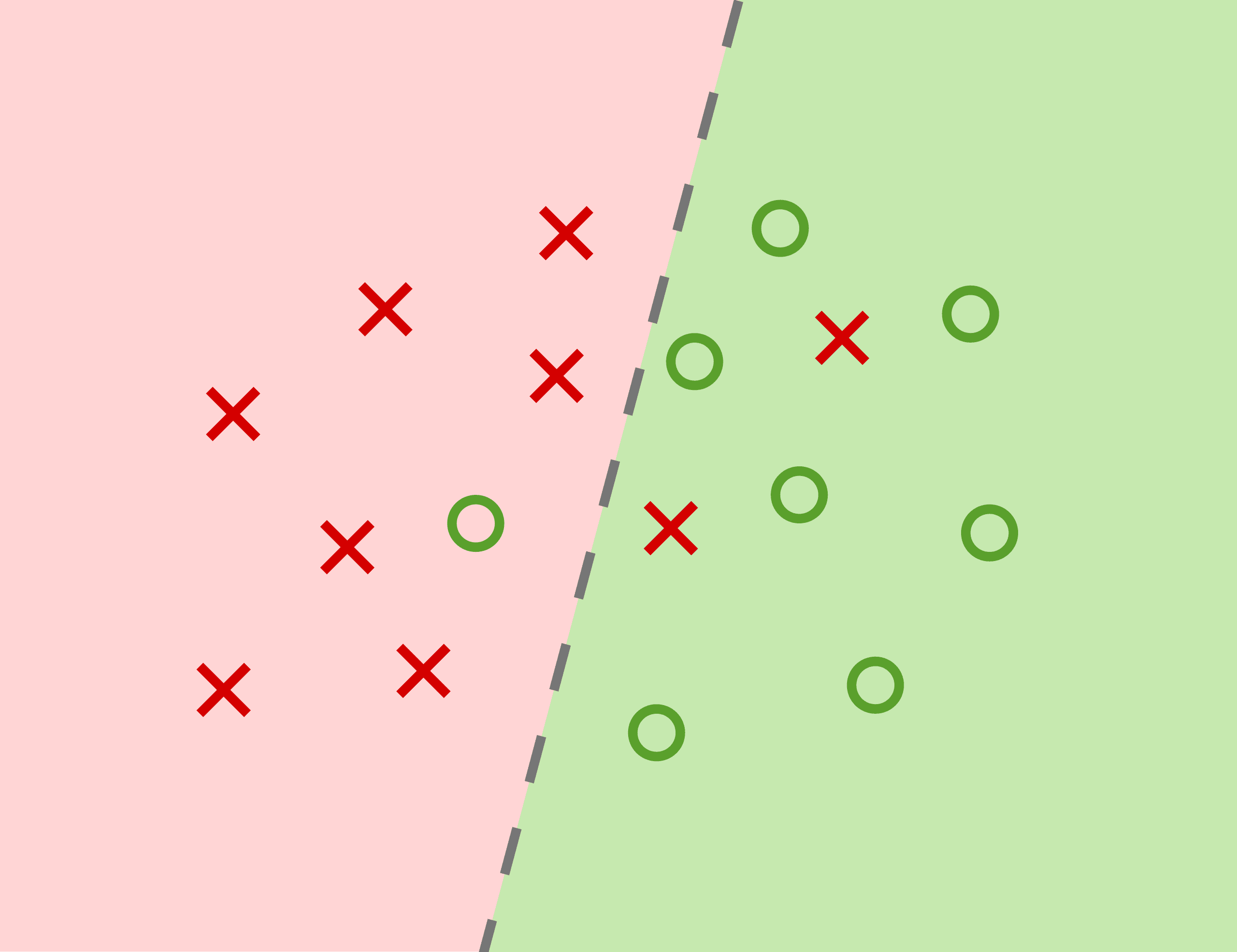

شكلت الجيل الأول من أدوات الكشف عن الذكاء الاصطناعي وعيوبها الطريقة التي ينظر بها الجمهور العام إلى الكشف عن الذكاء الاصطناعي. اعتمدت هذه الأدوات على الارتباطات باستخدام الذكاء الاصطناعي بدلاً من الإشارات السببية. وادعت هذه الأدوات دقة بنسبة 99٪، وهو ما لا يناسب الاستخدام الأكاديمي.

تتميز هذه الجيل الجديد من أدوات الكشف بدقة تزيد عن 99.9٪ ومعدلات إيجابية كاذبة منخفضة للغاية (FPRs)! كما أنها قوية في مواجهة برامج إعادة الصياغة والإنسانية.

ومع ذلك، فإن أجهزة الكشف عن الذكاء الاصطناعي ليست متشابهة! فهناك درجات متفاوتة من الدقة بسبب الاختلاف في طرق تدريب أجهزة الكشف.

تستخدم Pangram و TurnItIn و Ghostbusters الكشف القائم على التعلم. في الكشف القائم على التعلم، يتم تدريب النموذج من خلال تعلم ما هو وما ليس من إنتاج الذكاء الاصطناعي من عينة كبيرة. في حين أن

يمكن للخبراء البشريين الذين لديهم خبرة في استخدام LLMs في مهام الكتابة اكتشاف الذكاء الاصطناعي بدقة تصل إلى 92٪. لم يتمكن اللغويون من تحقيق نفس المستوى من الدقة دون خبرة في استخدام أدوات مثل ChatGPT. يمكن للكشف البشري توضيح سبب اختيارهم لتنبؤ معين فيما يتعلق بالنص. على الرغم من أن Pangram يتمتع بدقة أعلى ومعدلات إيجابية خاطئة، إلا أنه غير قادر على وضع النص في سياقه.

بناء عملية نزيهة للسلامة الأكاديمية في مجال الذكاء الاصطناعي

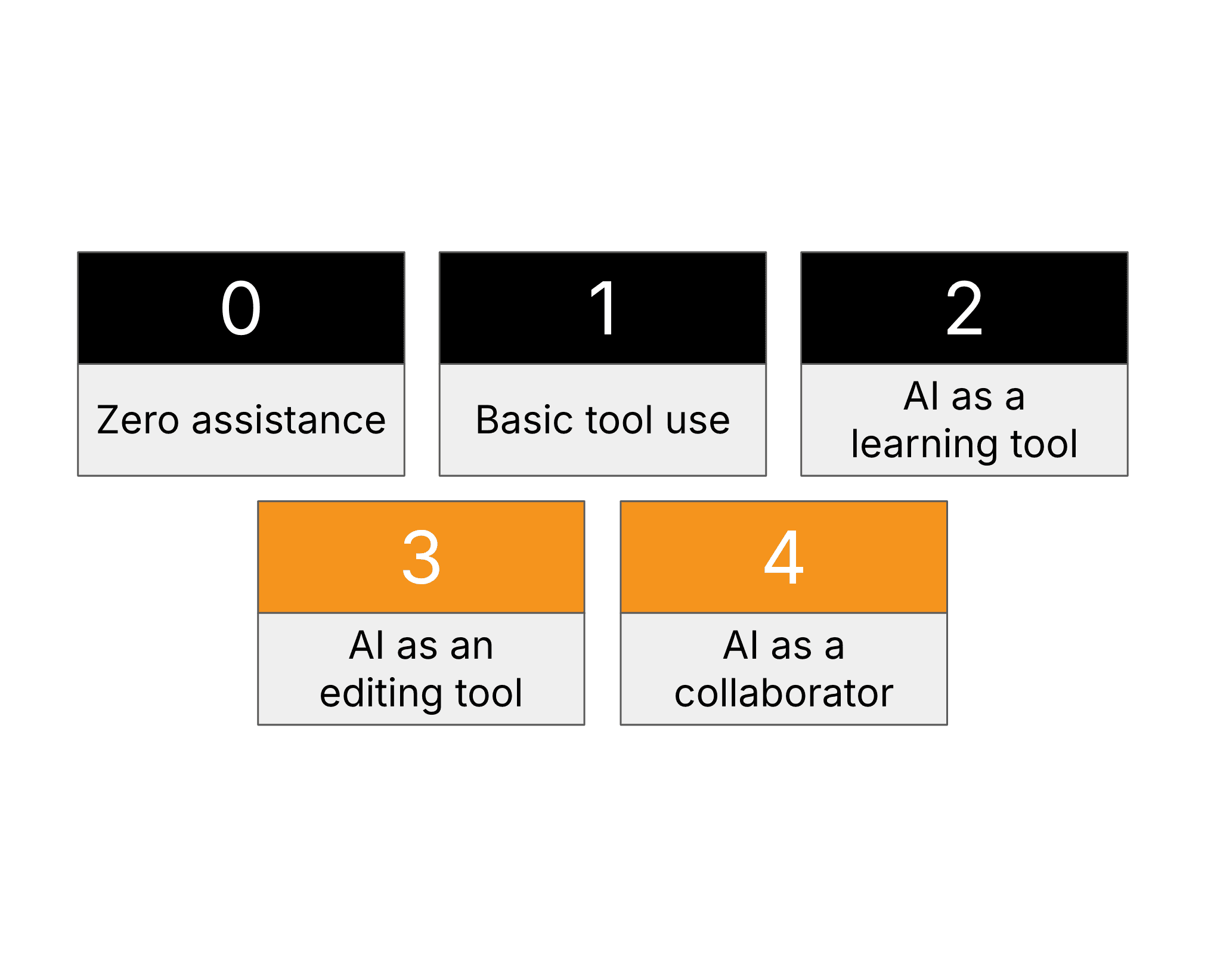

عند وضع سياسات أو معايير تتعلق باستخدام الذكاء الاصطناعي، يجب أن يكون التواصل واضحًا. يمكن استخدام الذكاء الاصطناعي لكتابة المخططات، وتوليد الأفكار، وتصحيح الأخطاء النحوية، والبحث، والصياغة، أو مهام الكتابة المهمة. يجب تنفيذ المبادئ التوجيهية المتعلقة بدرجات استخدام الذكاء الاصطناعي المسموح بها أو غير المسموح بها.

يجب على الطلاب والمعلمين فهم الطرق التي تتطور بها الأدوات الشائعة باستخدام الذكاء الاصطناعي. تحصل وظيفة "ساعدني في الكتابة" في Google Docs على نتائجها من Gemini. يتضمن Grammarly حاليًا إنشاء الذكاء الاصطناعي وإعادة الصياغة. قد تستخدم أدوات الترجمة نماذج اللغة الكبيرة (LLMs) لتعمل. كما أن أخذ أجزاء من الأبحاث أو العصف الذهني الناتج عن الذكاء الاصطناعي يؤدي إلى الكشف أيضًا.

نوصي باستخدام كل من التفكير البشري والكشف الآلي. من غير العدل على الإطلاق أن يتم استخدام الكشف الآلي فقط لتقييم عمل الطالب بسبب نسبة الخطأ الإيجابي البالغة 0.01٪ . بعد تلقي تنبؤ إيجابي، ستكون الخطوات التالية هي تقييم عملية الكتابة لدى الطالب ومقارنة النص الإيجابي بأعماله السابقة. تأكد من اختبار الكاشف باستخدام بعض النصوص ووضع في اعتبارك النتائج التي قد تحصل عليها عند استخدام LLM في المهمة.

إذا أصبح من الواضح بشكل متزايد أن الطالب قد سلم واجبًا مكتوبًا بواسطة الذكاء الاصطناعي، فقد تكون هذه فرصة تعليمية. من المهم معاملة الطلاب باحترام وتجنب الإفراط في العقاب. قد يستفيد الطلاب من إعادة الواجب وإجراء محادثة حول الأسباب التي دفعتهم إلى استخدام الذكاء الاصطناعي.

لمزيد من المعلومات حول هذا المقال، يرجى الاطلاع على الندوة الإلكترونية الكاملة: https://www.pangram.com/resources/the-state-of-ai-detection-in-2025.

ديستيني هي محللة أبحاث متدربة في شركة بانغرام. وهي أيضًا طالبة في كلية نيويورك للتكنولوجيا، حيث تدرس الرياضيات التطبيقية والكيمياء. وقد ساهم عمل ديستيني في بانغرام بشكل كبير في التحقيق في "الفضلات" الناتجة عن الذكاء الاصطناعي على الإنترنت. وخارج نطاق العمل والدراسة، تهوى ديستيني الكتابة الإبداعية وأدب الرعب الخيالي.

مقالات ذات صلة

تجول بين أكثر العبارات استخدامًا في مجال الذكاء الاصطناعي

سياسات مفيدة في مجال الذكاء الاصطناعي للمعلمين

كيف يمكن للمعلمين معرفة ما إذا كان شيء ما تم إنشاؤه بواسطة الذكاء الاصطناعي؟

كل ما يتعلق بالإيجابيات الخاطئة في أجهزة الكشف التي تعمل بالذكاء الاصطناعي

هل تستخدم كليات الحقوق أجهزة الكشف عن الكتابة الآلية؟

أفضل 5 أدوات ذكاء اصطناعي للمدارس

للحصول على آخر المستجدات