Scopri subito cosa è pubblicato da persone e cosa dall'IA su Twitter, LinkedIn, Substack e altre piattaforme. Scarica la nostra nuova estensione per Chrome.

Rilevamento del codice AI per i team di ingegneri

Strumento di rilevamento del codice generato dall'IA per sviluppatori

Rileva il codice generato dall'IA da ChatGPT, Claude e GitHub Copilot in Python, Java, C++ e altri linguaggi. Rilevamento prudente ottimizzato per ridurre al minimo i falsi positivi.

from pangram import Pangram

# Initialize the client

client = Pangram(api_key="your-api-key")

# Analyze a code snippet

result = client.predict(code_snippet)

print(f"AI fraction: {result['fraction_ai']}")

Casi d'uso

Rendi sicura la catena di fornitura del tuo software

Ottieni una visione completa del codice generato dall'intelligenza artificiale all'interno della tua organizzazione. Verifica le assunzioni, proteggi la proprietà intellettuale e riduci i rischi per la sicurezza grazie al motore di rilevamento del codice generato dall'intelligenza artificiale più accurato.

Verifica delle assunzioni nel settore tecnico

Non assumere un programmatore improvvisato per un ruolo nel backend. Verifica la presenza di codice generato dall'IA nei compiti assegnati a casa per assicurarti che i candidati comprendano la logica alla base di ciò che presentano.

Proteggere la proprietà intellettuale

In molte giurisdizioni, il codice generato dall'intelligenza artificiale non può essere protetto dal diritto d'autore. Controllate i vostri repository per assicurarvi che il software proprietario non sia basato su elementi sintetici non soggetti a licenza.

Ridurre i rischi per la sicurezza

I frammenti di codice generati dall'IA contengono spesso sottili errori logici o vulnerabilità di sicurezza. Segnalare i commit che fanno ampio ricorso all'IA affinché vengano sottoposti a una revisione del codice più approfondita da parte di un revisore umano prima del merge.

Approccio tecnico

e di rilevamento conservativo per il codice

L'analisi del codice di Pangram è stata sviluppata appositamente per il software, non è stata adattata da sistemi di rilevamento del testo. Il nostro modello comprende i vincoli sintattici, i modelli strutturali e la differenza tra codice standard e logica originale.

Basso numero di falsi positivi

Pangram è impostato in modo conservativo: raramente segnala come "AI" la logica scritta da esseri umani, garantendo così che non si accusino ingiustamente gli sviluppatori di utilizzare modelli standard.

Analisi sensibile alla sintassi

A differenza del testo, il codice è soggetto a rigidi vincoli sintattici. Il nostro modello analizza i modelli strutturali su oltre 40 righe di codice per distinguere tra la logica umana e la prevedibilità dei modelli di linguaggio di grandi dimensioni (LLM).

Supporto multilingue

Rilevamento accurato in linguaggi di alto livello come Python e Java, nonché in linguaggi di basso livello come C++ e C. Altri linguaggi verranno aggiunti man mano che la copertura del modello si amplierà.

Integrazione

Rilevamento automatico di codice AI (

) tramite API

01

SDK Python

Integrazione immediata nelle tue pipeline di backend. Installa pangram-sdk e inizia a valutare frammenti di codice in pochi minuti.

Visualizza documenti →

02

Piattaforme di reclutamento

Integrarsi con piattaforme di valutazione tecnica per segnalare automaticamente i contributi sospetti nelle sfide di programmazione.

Per saperne di più →

03

Verifiche in batch

Esegui la scansione di interi repository o pull request per valutare la frequenza con cui il codice AI viene rilevato nel corso della cronologia del tuo progetto.

Ottieni la chiave API →

Domande frequenti

Domande frequenti sul rilevamento dell'IA

Domande frequenti sul rilevamento del codice AI

per sviluppatori e team di ingegneri.

Sì. Pangram offre un'API ad alta produttività progettata per l'analisi automatizzata nelle pipeline di CI, i controlli pre-merge, gli audit interni e i flussi di lavoro di ricerca. Molti team eseguono il rilevamento sui pull request o tramite scansioni notturne, anziché bloccare direttamente i commit.

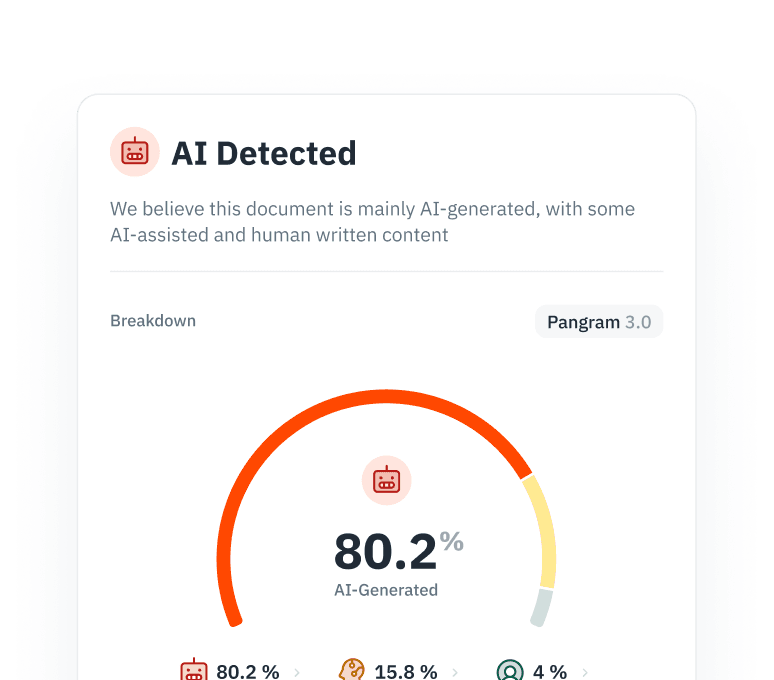

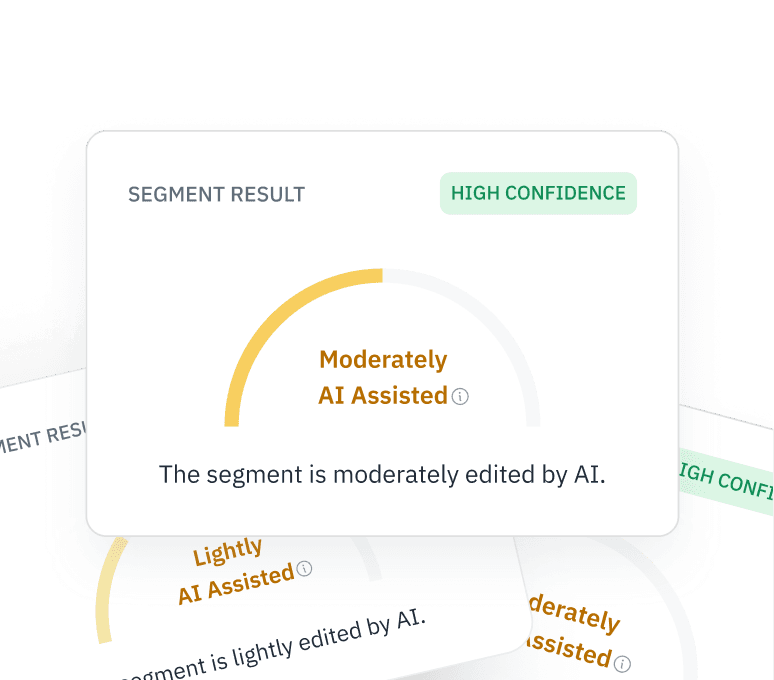

L'accuratezza dipende dal linguaggio, dalla lunghezza del codice e dalla sua complessità. Pangram offre i risultati più affidabili con codici più lunghi e ricchi di logica ed evita intenzionalmente di fornire indicazioni troppo categoriche in presenza di input con segnali deboli. I risultati vengono restituiti con punteggi di affidabilità a supporto della revisione umana. Per approfondire l'argomento, leggi il nostro articolo su come individuare il codice generato dall'intelligenza artificiale.

Sì. Alcuni team utilizzano Pangram per segnalare i contributi generati dall'intelligenza artificiale nei progetti open source o per supportare le revisioni interne nei casi in cui si applichino requisiti relativi alle licenze, all'attribuzione o alla divulgazione. Scopri come gli studi legali utilizzano Pangram per la verifica della proprietà intellettuale e della conformità.

Scopri di più

Rilevamento tramite IA per

ogni organizzazione

Per studi legali

Rilevamento dell'IA per studi legali e professionisti del settore. Individua le memorie generate dall'IA, verifica i riferimenti giuridici e garantisce l'autenticità della paternità in ogni atto depositato.

Scopri di più →Per la moderazione dei contenuti

Moderazione dei contenuti tramite IA per i team dedicati alla fiducia e alla sicurezza. Individua su larga scala recensioni generate dall'IA, commenti falsi e contenuti sintetici tramite API.

Scopri di più →Per le università

Rilevamento tramite IA per università e istituti di istruzione superiore. Verifica dei compiti degli studenti, controllo dei lavori di ricerca presentati e tutela della reputazione dell'istituto.

Scopri di più →Inizia oggi stesso a individuare il codice generato dall'intelligenza artificiale

Proteggi il tuo codice, verifica le competenze dei tuoi neoassunti e ottieni una visibilità completa sull'utilizzo dell'IA all'interno del tuo reparto di ingegneria.

per ricevere i nostri aggiornamenti