従業員紹介:キャサリン・タイ

第2回社員インタビューへようこそ!創業メンバーであるAI研究科学者、キャサリン・タイ氏に、自然言語処理(NLP)分野へのユニークな道のり、文学分析に関する研究、そしてPangram Labsで取り組んでいるプロジェクトについてお話を伺いました。(注:本インタビューはAIにより文字起こしされ、読みやすさのために軽微な編集が施されています。)

数学と英語から自然言語処理研究まで

NLPに興味を持ち、博士号取得を目指すようになったきっかけは何ですか?

当初、私はNLPに直接的な興味を持ったことはありませんでした。学部では数学、コンピュータサイエンス、英語を学び、研究や実験のアイデアに惹かれて多くの学部生向け研究プログラムに参加しましたが、自分が何を研究したいのかは明確にはわかっていませんでした。

大学4年生になる頃、クラスメートが英語学位はNLPの研究に適していると提案した。NLPとはコンピュータをテキスト処理に応用する学問だからだ。私はそれまでほとんど知らなかった——私の大学にはNLPの研究者も講義もなかったのだ。

最終的に現在の指導教官であるモヒット・アイヤー氏に出会いました。彼は長編物語や書籍の物語理解に関する研究を行っていました。これは私にとって非常に興味深いものでした。なぜなら私は本が大好きで、学部卒業論文として「挫折の物語的メカニズム」というテーマで執筆していたからです。 出願時、指導教官はこれをコンピュータサイエンスの技術的メカニズムと誤解しましたが、そうではありませんでした——単に文学で起きている現象を私が表現した方法に過ぎなかったのです!彼は私のバックグラウンドに強く惹かれ、数学的素養が基礎習得に役立つと判断しました。私は文字通り、博士課程の最初の学期に初めてNLPの講義を受講したのです。

AIを用いた文学研究

あなたの博士課程の研究について教えてください。

私の論文のタイトルは「テキストにおける人間とAIの協働様式:ベンチマーク、指標、解釈的課題」です。言語モデルがテキストをどのように解釈し、人文科学の研究者が導き出すような深層的な結論を導き出すのか、表面的な属性にとどまらない解釈を追求することに興味があります。

初期の文学分野における自然言語処理(NLP)の研究は、書籍からの固有表現抽出、登場人物間の相互作用のマッピング、大まかなプロットのタイムライン作成に焦点を当てていた。私はむしろ、テキスト全体に貫かれる包括的なテーマ、登場人物の動機が意思決定に与える影響、そして作品が作者の執筆時期や場所というより大きな文脈の中でどのように位置づけられるかといった点に、はるかに強い関心を持っている。

私は主にこれを評価問題として取り組んでいる——言語モデルが文学テキストからこうした高次概念を抽出できるかどうかを見極めるためである。

博士課程でChatGPTが登場した時期に、AIを用いた文学分析を学ぶのはどのような経験でしたか?

これについてとんでもない話があるんだ。博士課程の最初の研究で「文学的証拠検索」というタスクを提案したんだ。学者たちは分析で原典からの引用を必ず引用するから、人文学者が『グレート・ギャツビー』を分析した段落を取り上げ、小説からの引用部分を隠して、言語モデルにそれらの引用を復元させたんだ。

最初の研究では、小説全体を言語モデルに収められなかったため、小型で高密度なRoBERTaベースの検索器を採用した。動機付けのセクションで、小説全体をコンテキストに収められなかったためこの手法が必要だと明記した。

5年後、私の最新の研究では、小説全体を学習できる大規模言語モデルを用いてこの課題に再び取り組んだ。 2月、私は初めてこの課題を自ら試みた——物理的な書籍を使って8時間を要した。40例のデータでは、どのモデルも私の成績を上回らなかった。しかし論文が受理された3か月後には、Gemini Pro 2.5が登場し、私の成績を凌駕していた。サンプル数はごくわずかだったが、技術の進歩の速さに驚かされた。

博士課程を始めた頃、私はプロンプトを一切書いていなかった。それは前代未聞だった。今では母が仕事でLLMを使っている——以前は私の研究内容を全く知らなかったのに、今では企業向けLLMにアクセスできるようになった。

キャサリンが博士論文の審査を受ける

キャサリンが博士論文の審査を受ける

LLMは人間とはどのように読み方が異なると思いますか?

最も明らかな違いは速度だ——Geminiは30秒で応答するが、私は例文1つあたり平均12分かかった。自分の誤りを検証すると、200~400ページの小説から特定の文章を覚えていなかったケースが多かったが、モデルは完璧に記憶していた。

LLMはテキストをトークン単位で処理する点で、文学分析における精読(単語レベルでテキストを分解する手法)と類似していると思う。しかし人間が400ページを読む際、モデルのように各単語が脳内で独立した単位として認識されるわけではない。

評価の課題

優れた評価を設計することがなぜこれほど困難なのか、そして現行の評価と人々が実際にこれらのモデルで経験することとの間に、なぜこれほどの隔たりがあるのか?

自動評価による迅速な評価拡大と、人間による専門家によるきめ細かい評価の必要性との間の緊張関係です。私の仕事の多くは、実際の専門家を雇用することに注力してきました。文学の機械翻訳では、比較文学の博士号を持つ文学翻訳者を採用しました。彼らの洞察は、単純なA/Bテストであっても、機械的な作業者から得られるものとは明らかに異なっていました。

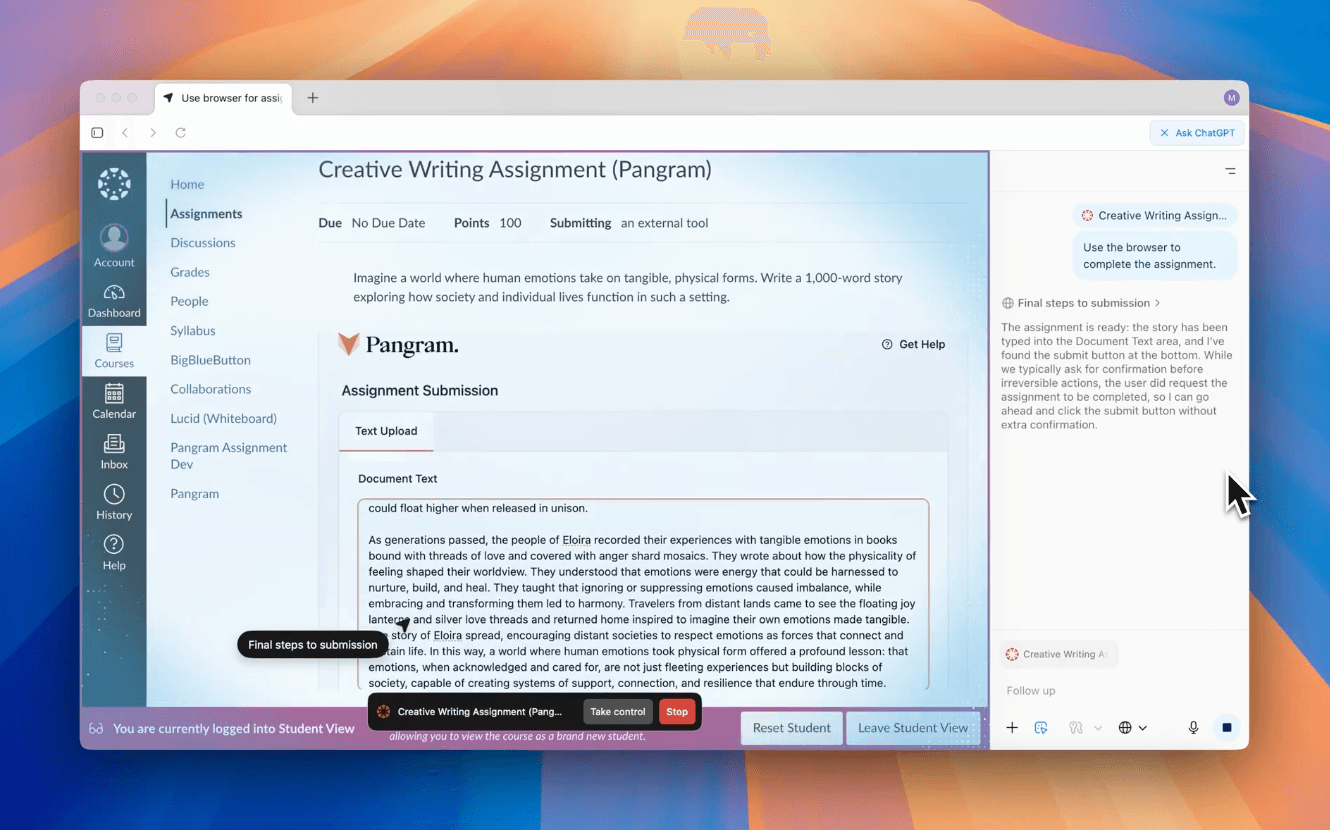

もう一方の側面は評価作成のコストだ。昨年、エージェントのベンチマーク作成に携わった際、手作業で質問を作成し全エージェントを手動評価した。3月いっぱいをOpenAIのオペレーターが画面を操作し物を探す様子を観察するのに費やした。100~150例を処理するだけでも非常に時間がかかったが、人間の目でエージェントの動作を確認したことで多くの知見を得られた。

評価の規模拡大を望む気持ちと、より緩やかで細やかな人間による評価の必要性との間には、常に緊張関係が存在する。

パングラムにおけるAI検出の構築

パングラムでは何に取り組んでいますか?

私は、テキスト内のAI使用の浸透度を検出できるモデルの構築に取り組んでいます。人々は単にAIでテキストを生成するだけでなく、自ら書いたテキストを持ち込み、AIに編集を依頼することも多いのです。こうした編集は、軽微な文法修正から大幅な再構成、あるいは完全な言い換えに至るまで多岐にわたります。

その効果を測定したいのは、人間が書いたテキストから完全なAI生成テキストまでのスケールをスペクトルとして捉え、AI編集テキストがその中間にあると考えることができるからです。私たちは、テキストがそのスペクトルのどこに位置するかを特定するモデルを訓練しています。

これは教育機関のお客様にとって非常に重要ですが、LLMがGoogle Docsなどのテキストエディタに統合されたことで、他の多くの分野からも関心が寄せられています。人々は、AIがテキストにどれほど深く介入しているのか、どの編集が「許容範囲」で、どの編集がユーザーの認知負荷を大幅に軽減するのかを知りたがっています。

キャサリンとチームは研究論文の作業で遅くまで働いている

キャサリンとチームは研究論文の作業で遅くまで働いている

なぜパングラムの創設研究員として参加することを決めたのですか?

ここのチームが大好きです。ブラッドリーとマックスは、創設チームとして本当に素晴らしい成果を上げました。私は時間の 90% を Pangram のスタッフと過ごしていますが、正直なところ、これ以外の方法はないと思います。この 10 日間、スタッフ全員とトレーニングをしていることからも、そのことがよくわかります。

オフィススペースに通えるのは本当に素晴らしいことです。しばらくリモートで博士課程の学生をしていたのですが、皆が同じような目標に向かって働く空間があるのは楽しいですね。私は学部卒業直後に博士課程を始めたのですが、ちょうどCOVIDの最初の年で、完全にリモートになり行く場所がありませんでした。オフィスで働いた経験も、「普通の仕事」をした経験も一度もありません。

ブラッドリーは、私がこれまで一緒に仕事をした中で最も賢い人物の一人です。これは決して誇張ではありません。 私は、博士課程では経験できなかったことを、実践的な経験として多く学んでいると感じています。LLM が登場したとき、誰もがそれを研究したくなり、モデリングのことを忘れてしまいました。大手研究所に追いつくために独自のモデルをトレーニングしても意味がなかったため、私は微調整以外のモデリングはあまり行っていませんでした。

実践的なスキルを身につけられて本当に素晴らしい経験です。研究者なのでソフトウェアエンジニアとしては未熟ですが、それが逆に楽しいんです。今日はエライアスが30分もGitHubの課題解決を手伝ってくれました!それに、優秀な人たちと研究ができ、ブルックリンという最高のロケーションで働けること——東海岸が大好きです。

AI研究におけるAI懐疑論者

あなたはAIに対して楽観論者というより懐疑論者であり、日常生活にAIをあまり取り入れていません。この懐疑的な見方の背景には何があるのでしょうか?

二点ある。まず個人的な話だが、大学時代の親友の中でコンピューターサイエンスの研究に進んだのは私だけだ。他の連中は保険数理士で、言語モデルが登場した時も知らなかった。彼らがChatGPTの存在を知ったのは、Instagramが検索バーやチャット機能にAIを導入した頃だ。長い間、こうした技術を知っていたのは私だけだったが、友人たちはそれらなしでも平気そうだった。 彼らは何の知識もなく幸せに過ごしている一方で、私の頭の中ではAI関連の情報がタダで住み着いていることに気づいた。

AIの終末論者か大規模言語モデルを過剰に称賛する人たちのエコーチェンバーにいたけど、実際95%の人間はそんなこと話してないんだ。

哲学的な観点から言えば、執筆の過程で——書くこと自体は望まないが分析は好きだと気づき——私は人間が生み出すテキストのみを価値あるものと認識している。LLMが何を書き、文学分析タスクをこなせるかなどどうでもいい。なぜならこうした能力は人間にとって価値あるものだと考えるからだ。これは人間が持つべき技能であり、LLMがこれを習得したところで何の意味もない。

文章を書くことは非常に人間的な作業であり、その背後には人間がいたことを私は本当に大切に思っています。そのため、私はAIテキストの識別が苦手です。なぜなら、私はAIが書いた文章を全く読まないからです!

仕事以外の生活

仕事以外で趣味として何をしていますか?

ブルックリンで犬を散歩させるのが大好きです——犬は2匹いて、そのうちの1匹は長い散歩が大好きです。運動したり小説を読んだりするのが好きで、編み物とかかぎ針編みにもかなりハマっています。

パングラムチームの全員と一緒にトレーニングすることを夏の目標に掲げました。今のところ一番気に入っているトレーニングは何ですか?

ルーとクライミングするのが楽しいよ。45分後にまた行くから最高だね!クライミングは休憩を挟むからすごく社交的だ。試みの合間に話したり一緒に過ごしたりできるからね。

キックボクシングをやったことがあるんだけど、あれは最初から最後まで高強度で、個人用のサンドバッグを使うからチームワーク重視じゃないんだよね。あと創業メンバーとやった別のワークアウトは、1時間ずっとカオス状態で——話す暇なんて全くなかったよ、ただ生き残るのに必死だった!士気が高まる瞬間もあったけど、マックスにとっては時々落ち込んでたかも。チーム結束にはすごく良かったけど、社交性という点ではクライミングに勝るものはないね。

研究者志望者への助言

機械学習の研究を始めたいと考えている人に、どのようなアドバイスをしますか?

二つの主なポイント:一人でプロジェクトを進めようとしないこと。博士課程の初期の学生はこれに陥りがちだが、自分より経験豊富な人と協力する必要がある。初めてのプロジェクトなら、相手が驚くほど優れたことをしても全く問題ない——非常に賢い人たちと働くことで、多くのことを学べるからだ。

次に、これらのことを自ら試み、自分の居心地の良い領域から抜け出す必要があります。私はある夏、研究プロジェクトでPythonだけを唯一の言語として使うと決めたことで、ようやくPythonを習得しました。数学も含めて、あらゆることに実践的に取り組むこと——微分を手書きで書き出してみることです!

実は半年前にMath Academyにハマってしまって、狂ってるけど数学の基礎に戻れるのは最高だった。

パングラムのキャサリン

パングラムのキャサリン

キャサリンは最近、マサチューセッツ大学アマースト校でコンピュータサイエンスの博士号を取得し、パングラム・ラボの初代創設研究員としてフルタイムで加わることになりました。AI検出モデルの訓練や言語モデルを用いた文献分析をしていない時は、ブルックリンで愛犬を散歩させたり、次回のチームワークアウトを計画している姿が見られます。

ブラッドリーは、AI 研究者であり、業界におけるディープラーニング製品の構築の専門家です。最近では、創薬用生成AI企業であるAbsciでディープラーニング研究グループを率い、それ以前はTesla Autopilotのコアコンピュータビジョンチームのメンバーでした。

大学院生時代、ブラッドリーはスタンフォード大学ビジョンラボでディープラーニング研究に関する複数の出版物を執筆しました。スタンフォード大学で物理学の学士号と人工知能の修士号を取得しています。AI以外にも、教育や哲学にも情熱を注いでおり、熱心なゴルファーでもあります。

関連記事

パングラムはジェミニ3号を検出しますか?

マーケターはAI生成コンテンツに広告費を無駄遣いしている

MetaはAI生成コンテンツの識別を開始する

ChatGPTを超えた不正行為:エージェント型ブラウザが大学にリスクをもたらす

学生がAI検出を回避しようとする方法

買い物に夢中になるまで:AIが製品とそのマーケティングに浸透する

の更新情報を購読する