Come sviluppare quadri etici per l'intelligenza artificiale nel giornalismo

Indice

- Un panorama caratterizzato da linee guida frammentarie e vaghe

- E ora? I principi fondamentali di una politica etica sull'intelligenza artificiale nel giornalismo

- La minaccia della parzialità algoritmica e della «poltiglia rosa»

- Casi di studio: quali testate giornalistiche stanno aprendo la strada?

- Attuazione: come le redazioni possono garantire il rispetto dei principi etici

Non c'è settore che non sia stato toccato dall'intelligenza artificiale.

Ogni professione, dai medici agli avvocati, dai professionisti del marketing agli influencer dei social media, è stata contaminata dai contenuti generati dall'IA. Ma i giornalisti? La professione si basa sulla fiducia dei lettori; tuttavia, recenti ricerche hanno rilevato un boom nell'uso non regolamentato dell'IA nel settore, con articoli generati dall'IA che si fanno strada persino nelle pagine di quotidiani molto letti e affidabili. Mentre altri settori fanno il punto sui propri valori etici per determinare un uso appropriato dell'IA, il giornalismo deve fare lo stesso. Gli strumenti di IA possono automatizzare compiti ripetitivi e supportare la narrazione basata sui dati, ma la tecnologia vacilla a causa di pregiudizi e allucinazioni. La mancanza di uno standard giuridicamente vincolante a livello di settore per un uso appropriato dell'IA lascia le redazioni a navigare da sole in queste acque inesplorate. Di seguito, esploreremo gli attuali quadri di riferimento per valutare l'uso etico dell'IA in redazione, analizzeremo le lacune e proporremo un approccio etico consolidato incentrato sulla trasparenza e sulla supervisione umana.

Un panorama caratterizzato da linee guida frammentarie e vaghe

Mentre la tecnologia dell'intelligenza artificiale avanza a passi da gigante, la governance etica resta indietro. Tuttavia, diverse organizzazioni globali di chiara fama hanno assunto un ruolo di primo piano nel tentativo di colmare questo divario. Queste organizzazioni stanno cercando di aiutare le redazioni a riconquistare il controllo editoriale e la fiducia dei lettori, pur continuando a lottare per affrontare l'intera gamma di dilemmi che redattori, editori e i loro autori si trovano ad affrontare al giorno d'oggi.

Nel 2021 l'Organizzazione delle Nazioni Unite per l'Educazione, la Scienza e la Cultura (UNESCO) ha adottato una serie di raccomandazioni sull'etica dell'intelligenza artificiale, incentrate sul controllo umano. La sezione che delinea le raccomandazioni per il settore della comunicazione e dell'informazione fornisce alcune linee guida per i giornalisti. La politica stabilisce che i sistemi di IA dovrebbero promuovere la libertà di informazione, la libertà di espressione, la trasparenza e la divulgazione dei dati ufficiali. Incoraggia chiunque nel settore dei media a integrare l'IA nel proprio lavoro in modo etico. Il quadro chiede inoltre ai paesi di promuovere ambienti trasparenti ed educativi in cui i media possano riferire sui danni e sui benefici dell'IA e i consumatori possano sviluppare competenze di alfabetizzazione digitale e mediatica per combattere la disinformazione e l'incitamento all'odio.

Tuttavia, il quadro normativo dedicato ai media occupa solo quattro paragrafi delle 44 pagine che delineano le politiche etiche dell’UNESCO in materia di IA. Non vi è quasi alcun riferimento specifico al giornalismo e ai giornalisti, e la politica si configura piuttosto come una dichiarazione di valori e un invito generale a elaborare in futuro politiche più complete. Non c’è molto su cui i media possano basarsi.

L'Institute of Electrical and Electronics Engineers (IEEE) ha adottato un approccio simile. Il loro quadro di riferimento "Ethically Aligned Design" valorizza la libertà dei giornalisti di informare il pubblico sulle questioni relative all'intelligenza artificiale e sulla sacralità del giudizio e del controllo umani. Tuttavia, la politica rappresenta una dichiarazione di ideali e valori e non una guida concreta per affrontare i dilemmi legati all'IA in una redazione. In che modo i media dovrebbero gestire la divulgazione dell'uso dell'IA? O affrontare gli usi inappropriati? Cosa definisce un uso inappropriato? Tutta questa incertezza sconvolge le redazioni e lascia la fiducia del pubblico in un limbo, ma una politica solida può fornire una mappa per questo terreno inesplorato.

E ora? I principi fondamentali di una politica etica sull'intelligenza artificiale nel giornalismo

Editori, redattori e giornalisti hanno un disperato bisogno di linee guida concrete, complete ed eticamente corrette per regolamentare, informare e giustificare adeguatamente i casi d'uso dell'IA nelle redazioni. Nel definire una politica rigorosa e consapevole in materia di IA, le redazioni dovrebbero basare le proprie linee guida su quattro principi imprescindibili: trasparenza, responsabilità, inclusività ed equità.

Di seguito è riportato un punto di partenza per applicare questi principi all'uso dell'intelligenza artificiale nelle redazioni:

- La trasparenza implica che l'uso dell'intelligenza artificiale sia comunicato ai lettori in modo chiaro, onesto ed evidente. Che i giornalisti utilizzino l'intelligenza artificiale per individuare spunti, svolgere ricerche o creare contenuti visivi, il loro pubblico ha sempre il diritto di saperlo.

- La responsabilità implica l'attribuzione della colpa per gli errori nei contenuti generati dall'intelligenza artificiale e nella ricerca. Le redazioni dovrebbero definire chiaramente chi è responsabile quando l'uso dell'IA va storto: è lo sviluppatore del programma di IA? Il giornalista? L'algoritmo stesso? Una corretta attribuzione delle responsabilità significa ammettere gli errori e sanzionare la parte in torto. Spetta quindi alle redazioni decidere chi è responsabile e come gestire la situazione.

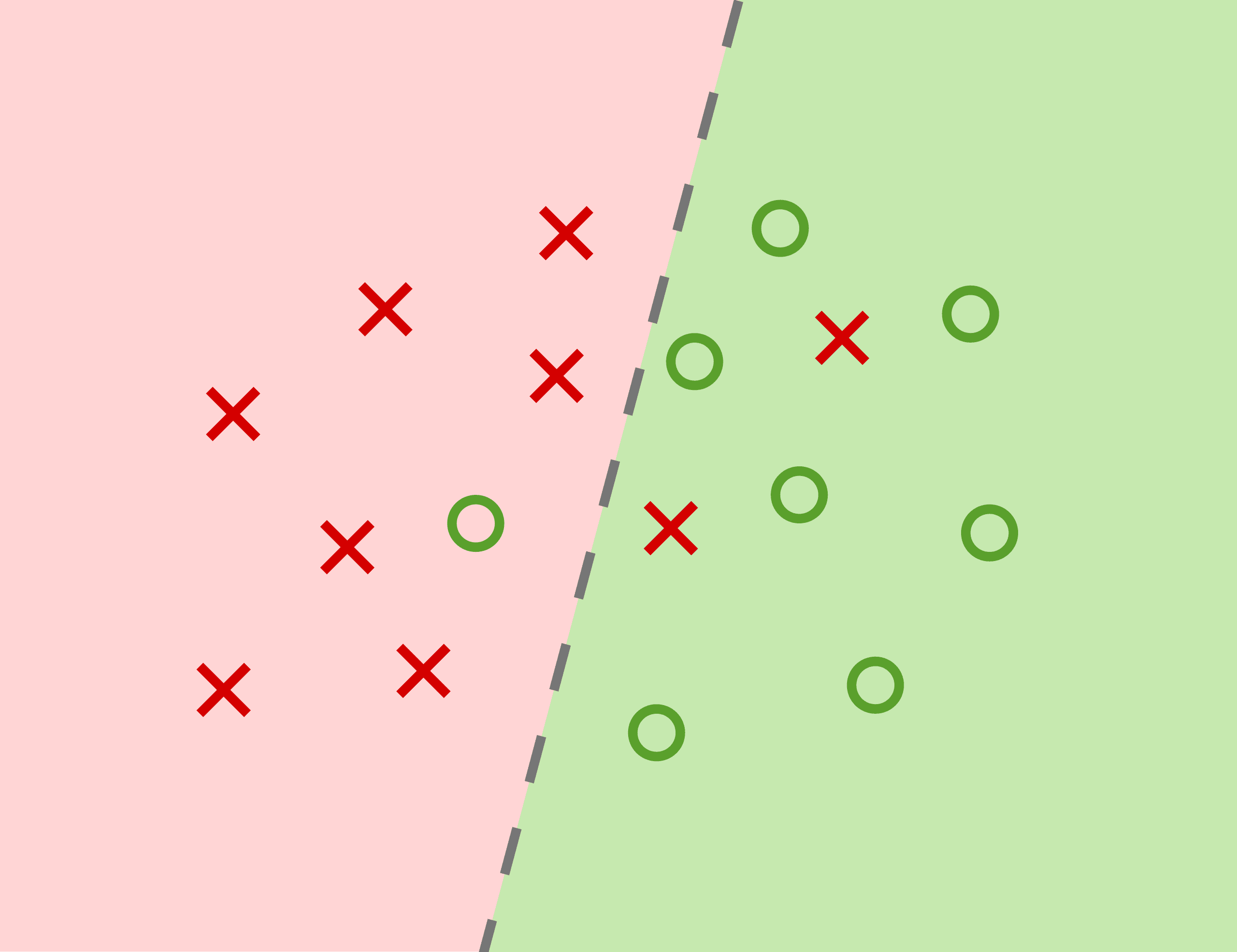

- Inclusività significa promuovere la consapevolezza dei pregiudizi insiti negli strumenti di IA e mitigarli. I dati di addestramento degli algoritmi di IA contribuiscono a definire i risultati dell'algoritmo, il che significa che gli strumenti di IA rischiano di amplificare i pregiudizi della società in cui sono stati sviluppati. Questo aspetto dovrebbe sempre essere tenuto in considerazione nell'uso dell'IA nelle redazioni, e le linee guida dovrebbero prevedere strategie volte ad analizzare e ridurre al minimo tali pregiudizi.

- L'equità implica un'applicazione imparziale della presente politica. I team delle redazioni devono attenersi rigorosamente alla politica stabilita e apportare gli aggiornamenti necessari. L'applicazione deve essere uniforme e qualsiasi deroga alla politica deve comportare conseguenze e una chiara comunicazione delle violazioni al pubblico.

La minaccia della parzialità algoritmica e della «poltiglia rosa»

I modelli di IA implementati senza adeguati criteri etici rischiano di accentuare le disuguaglianze sociali e gli stereotipi sui gruppi emarginati, rafforzando al contempo le convinzioni preesistenti degli utenti e aggravando la polarizzazione. L’UNESCO, nella sua ricerca sugli stereotipi generati dall’IA, ha rilevato che i grandi modelli linguistici attribuivano ruoli domestici alle donne con una frequenza molto maggiore rispetto agli uomini, generando al contempo contenuti negativi sulle persone omosessuali e su determinati gruppi etnici. I ricercatori della Stanford University hanno scoperto che i modelli di IA perpetuavano stereotipi razzisti estremi legati all'era pre-diritti civili dopo essere stati sollecitati a descrivere persone che parlavano l'inglese afroamericano. Il rischio di perpetuare pregiudizi utilizzando sistemi di IA inevitabilmente imperfetti può insinuarsi nella traduzione, nell'analisi dei dati, nella generazione di idee per articoli e in altri lavori che le redazioni affidano a questi strumenti. Inoltre, i sistemi di raccomandazione basati sull'IA progettati per fornire contenuti personalizzati, comprese le notizie, possono continuare a mostrare ai lettori contenuti con cui sono d'accordo, rafforzando le loro nozioni preconcette sul mondo e chiudendoli a punti di vista alternativi o a informazioni che ampliano la loro prospettiva.

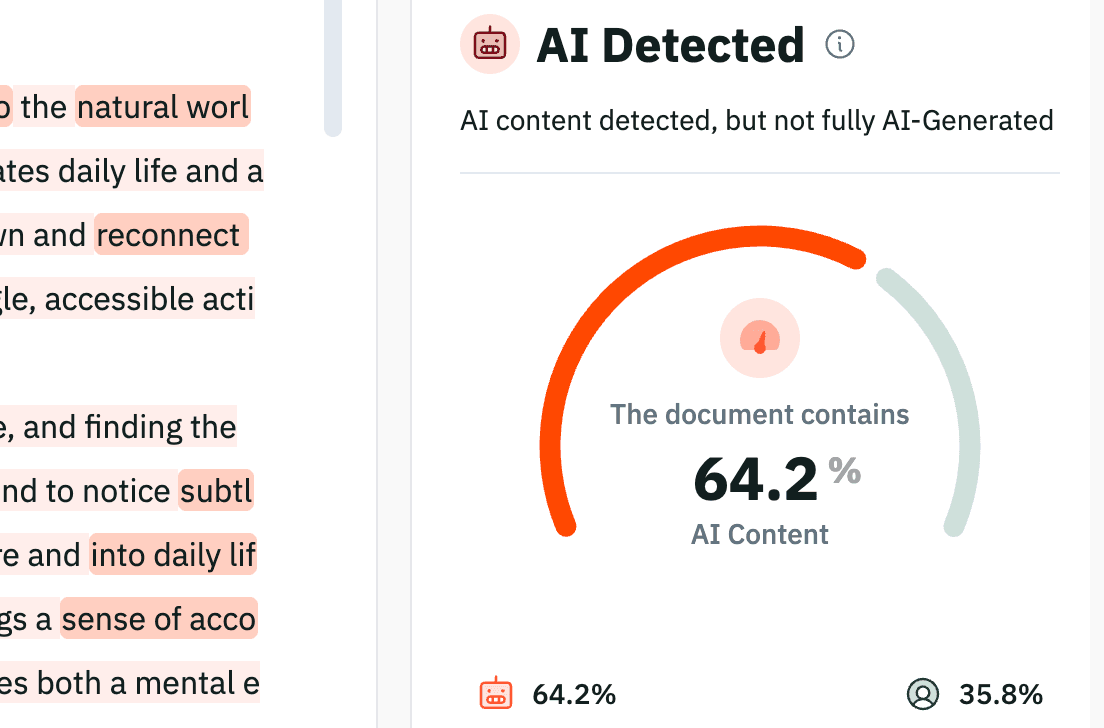

L'infinita mole di contenuti generati dall'intelligenza artificiale su Internet può inoltre confondere i lettori e minacciare la loro fiducia nei confronti dei media tradizionali. Una ricerca condotta dalla società di rilevamento dell'IA Pangram ha rilevato che ogni giorno vengono pubblicati 60.000 articoli generati dall'intelligenza artificiale, soprattutto nei settori della tecnologia, della bellezza e dell'economia. I siti di notizie di bassa qualità e i malintenzionati utilizzano l'IA per sfornare costantemente grandi quantità di contenuti di scarsa qualità (noti come "pink slime") a un costo quasi nullo, con l'obiettivo di incassare introiti pubblicitari. Queste "fabbriche di contenuti" offuscano il panorama dell'informazione e rendono ancora più essenziale che i siti di notizie affidabili e professionali creino solide politiche sull'IA da rendere note ai propri lettori.

Casi di studio: quali testate giornalistiche stanno aprendo la strada?

Le principali testate giornalistiche, come il *New York Times*, la BBC e ProPublica, stanno riuscendo a conciliare innovazione ed etica mantenendo il controllo umano al centro delle loro politiche, sottraendo il comando agli algoritmi e affidandolo nuovamente a redattori di fiducia. La BBC, ad esempio, impone al proprio personale di rendere chiaro l'uso dell'IA nella creazione, presentazione e distribuzione dei propri contenuti. Le sue linee guida promuovono inoltre la considerazione e il monitoraggio di pregiudizi intrinseci, allucinazioni e plagio nei risultati degli strumenti di IA. Tutto il personale e i freelance devono sottoporre una proposta per l'uso dell'IA a un funzionario editoriale senior per l'approvazione. Le linee guida della BBC delineano anche casi d’uso appropriati dell’IA, tra cui la dimostrazione dei risultati dell’IA in articoli di cronaca sull’argomento o l’alterazione delle voci di fonti che desiderano rimanere anonime. ProPublica utilizza esplicitamente l’IA per setacciare grandi database in indagini cruciali e identificare modelli per smascherare i pregiudizi in altri sistemi. Il New York Times ha chiarito il proprio uso dell’IA nell’assistenza alla creazione di titoli e riassunti, nella generazione di versioni audio degli articoli e nell’analisi dei dati.

Attuazione: come le redazioni possono garantire il rispetto dei principi etici

Per definire linee guida adeguate ed esaurienti in materia di IA, in linea con il Codice Etico della Society of Professional Journalists, le redazioni dovrebbero costituire team multidisciplinari che riuniscano competenze sia tecnologiche che etiche, in modo da coprire ogni aspetto di questo nuovo mondo sconvolto dall'IA. Il controllo umano dovrebbe rimanere al centro dell'utilizzo dell'IA. L'accuratezza dei risultati generati dall'IA utilizzati nei servizi giornalistici dovrebbe essere costantemente verificata.

L'intelligenza artificiale dovrebbe essere un complemento alle capacità umane, non un sostituto di un giornalismo ben documentato e affidabile. Per applicare le linee guida e garantirne il rispetto, le redazioni dovrebbero utilizzare strumenti di verifica come Pangram per individuare casi non dichiarati e inappropriati di contenuti generati dall'intelligenza artificiale. Sebbene gli strumenti di intelligenza artificiale offrano un'efficienza allettante, non garantiscono la stessa credibilità e gli stessi ideali etici delle redazioni di qualità. Adottando un quadro di riferimento basato sulla trasparenza e sulla responsabilità, le redazioni possono sfruttare gli strumenti di intelligenza artificiale senza compromettere la funzione democratica della stampa.

Assicurati che la tua testata mantenga i più elevati standard di integrità nell'era dell'intelligenza artificiale. Verifica oggi stesso l'autenticità dei tuoi contenuti.

Altre letture

Sì, il rilevamento tramite intelligenza artificiale può essere accurato

Il rilevamento basato sull'intelligenza artificiale è in grado di individuare lo stile di scrittura di Claude?

Tutto sui falsi positivi nei sistemi di rilevamento basati sull'intelligenza artificiale

Filigrana AI: perché le grandi aziende tecnologiche puntano sulla provenienza AI e stanno perdendo

Verificatore di lettere di presentazione basato sull'intelligenza artificiale: come i team delle risorse umane filtrano le informazioni superflue

Un viaggio tra le espressioni più abusate nel campo dell'IA

per ricevere i nostri aggiornamenti