Scopri subito cosa è pubblicato da persone e cosa dall'IA su Twitter, LinkedIn, Substack e altre piattaforme. Scarica la nostra nuova estensione per Chrome.

Filigrana AI: perché le grandi aziende tecnologiche puntano sulla provenienza AI e stanno perdendo

Ovunque si rivolgano gli utenti di Internet, vengono sommersi da testi, video e immagini generati dall’IA, molti dei quali non sono individuabili. L’integrità e la fiducia negli spazi online stanno crollando sotto il peso dei contenuti generati dall’IA. Il decreto presidenziale di Biden sulla sicurezza dell’IA e l’AI Act dell’Unione Europea sostenevano un’adeguata etichettatura dei risultati generati dall’IA, nota anche come “watermarking”, ma queste normative sono state abrogate nel 2025. Nonostante l'assenza di una strategia nazionale o internazionale, molte aziende che si occupano di IA continuano a sviluppare e implementare segnali di "watermarking" nei propri contenuti. Sebbene si tratti di un passo nella giusta direzione per riconquistare la fiducia del pubblico e proteggere i consumatori, il watermarking è un metodo imperfetto che può essere facilmente aggirato.

Di seguito vedremo come funzionano le filigrane, perché falliscono e perché i metodi efficaci di rilevamento basati sull'intelligenza artificiale devono fare affidamento su un tipo specifico di riconoscimento dei modelli.

È stata rilevata la presenza di una filigrana generata dall'intelligenza artificiale, ma non è visibile

Per gli esseri umani, la filigranatura basata sull'intelligenza artificiale è invisibile. A differenza delle filigrane tradizionali, che riportano il nome o il logo di un'azienda, le filigrane basate sull'intelligenza artificiale vengono incorporate in modo impercettibile nei testi, nelle immagini e nei video generati da un modello di intelligenza artificiale.

Google utilizza SynthID, una tecnologia che inserisce sottili variazioni nei risultati generati da Gemini, rilevabili dalla tecnologia proprietaria di Google. Per quanto riguarda il testo, SynthID modifica i punteggi di prevedibilità di determinate parole secondo una funzione pseudocasuale, inducendo Gemini a privilegiare l'uso di determinate parole. In questo modo, quando il testo viene reinserito nel modello, quest'ultimo è in grado di riconoscere il proprio lavoro sulla base dell'analisi della frequenza delle parole.

I contenuti generati interamente dall'intelligenza artificiale non possono essere protetti dal diritto d'autore secondo la legislazione statunitense; è quindi nell'interesse delle aziende che si occupano di IA sviluppare un metodo per determinare la provenienza dei contenuti generati dai propri modelli. In questo modo, una volta che il testo, l'immagine o il video generato dall'IA viene diffuso sul web, è presente una firma che ne identifica l'origine.

Rivendicare la paternità delle creazioni dei propri modelli non è l’unico motivo per cui le grandi aziende tecnologiche sono così interessate alla tracciabilità. Mentre gli utenti di Internet assistono sbalorditi alla marea infinita di contenuti generati dall’IA che ogni giorno viene loro propinata, i principali sviluppatori di IA temono i rischi legali, reputazionali e di sicurezza che potrebbero presentarsi. I malintenzionati utilizzano gli strumenti di IA per creare deepfake o diffondere disinformazione, minacciando la sicurezza globale. Per evitare un potenziale giro di vite sotto forma di rigidi mandati governativi, le grandi aziende tecnologiche mirano a giocare d'anticipo creando strumenti di autoregolamentazione. Se i loro modelli sono in grado di decodificare i contenuti con la stessa facilità con cui li generano, perché un ente governativo dovrebbe monitorarne lo sviluppo?

Cattive notizie: la filigranatura non è infallibile

Se tutti nel mondo promettessero di non alterare mai i contenuti generati dall'IA, forse l'uso dei filigrani funzionerebbe. Ma in questo mondo, i malintenzionati possono facilmente modificare i contenuti generati dall'IA in modo da nasconderne l'origine. Strumenti di parafrasi secondari, come gli "humanizer", possono facilmente cambiare le parole o la struttura delle frasi, inserendo errori o frasi senza senso nel tentativo di mascherare i contenuti generati dall'IA. Purtroppo, a volte questo travestimento approssimativo funziona. Pangram Labs ha testato 19 diversi "humanizer" basati sull'IA e ha scoperto che molti sono riusciti a rimuovere con successo la filigrana dal testo.

I malintenzionati possono anche "ripulire" un testo sottoponendolo a diverse traduzioni prima di ritradurlo in inglese, rimuovendo così le tracce e creando un testo pulito che non verrà segnalato dai sistemi di decodifica delle aziende che utilizzano l'intelligenza artificiale.

Le filigrane sono fragili e facilmente alterabili, il che le rende inutili. Per individuarle occorrono altri strumenti.

Riconoscimento statistico dei modelli

Le aziende responsabili dei contenuti di scarsa qualità generati dall'intelligenza artificiale non possono essere le sole a dover individuare i propri contenuti. L'inserimento di filigrane richiede la collaborazione degli sviluppatori di IA e può essere rimosso in un batter d'occhio.

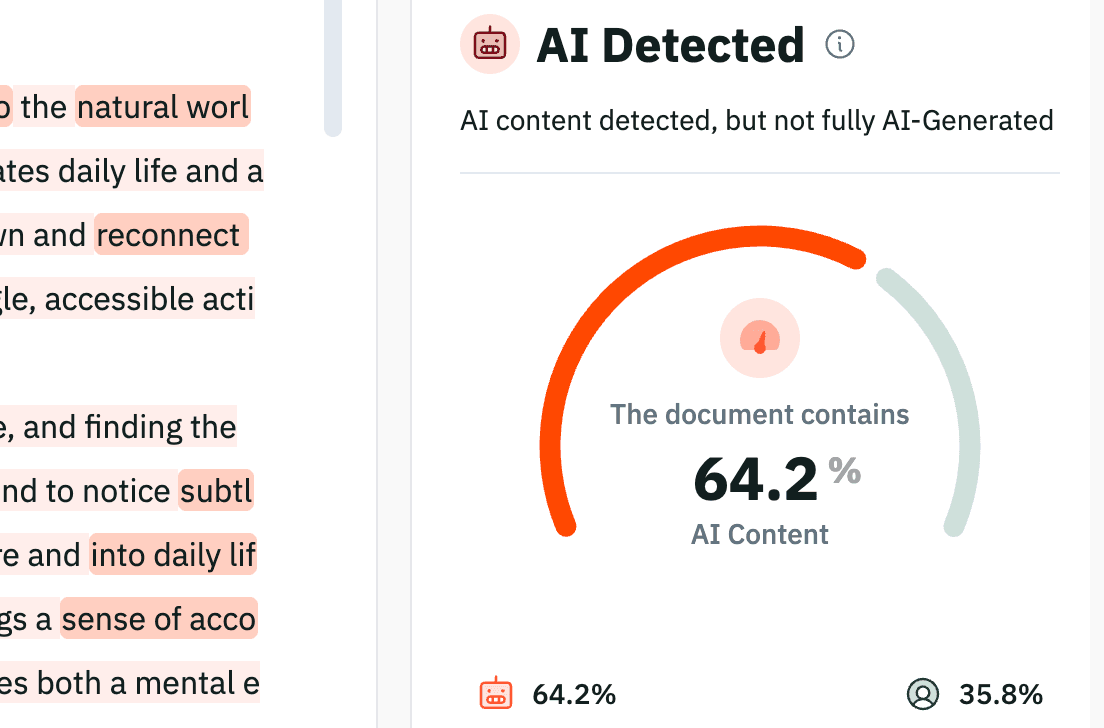

Ma quando un metodo fallisce, un altro prende il sopravvento. Un metodo chiamato "riconoscimento statistico indipendente dei modelli" è molto più solido e affidabile nell’identificare i contenuti generati dall’IA, ed è per questo che lo utilizziamo qui a Pangram. Non cerchiamo un codice nascosto incorporato nel testo generato dall’IA. Al contrario, i modelli di Pangram analizzano il DNA linguistico fondamentale, la prevedibilità strutturale e i modelli sintattici di un dato testo per garantire un rilevamento dell’IA accurato al 99,98%. I rilevatori avanzati come Pangram non hanno bisogno di filigrane per funzionare. Sono addestrati su diversi set di dati attraverso un metodo chiamato "hard negative mining", in cui ai rilevatori vengono forniti esempi difficili da individuare. Pangram è in grado di segnalare i contenuti generati dall'IA provenienti da modelli open-source o non ancora rilasciati, identificare testi modificati in modo doloso e offrire un'analisi riga per riga su testi misti generati dall'IA e scritti da esseri umani.

Dall'autocontrollo alla rilevazione indipendente

Le aziende che si occupano di intelligenza artificiale non diventeranno le paladine dell'autenticità su Internet. La filigranatura è una strategia che non regge di fronte ai malintenzionati, e l'unico vero rimedio è il rilevamento indipendente.

I nostri modelli sono già in uso nella pratica. Piattaforme che si basano sulla fiducia degli utenti, come Quora, hanno integrato nel proprio servizio un sistema di rilevamento a livello di API, utilizzando Pangram per moderare milioni di post e segnalare i contenuti generati dall'intelligenza artificiale.

La vera autenticità e trasparenza su Internet possono essere garantite solo attraverso un sistema basato sul rilevamento. Rilevatori affidabili, indipendenti e all'avanguardia come Pangram contribuiscono a creare un sistema di controlli e contrappesi per l'intero Internet.

Che tu sia un docente universitario, un professionista o uno sviluppatore informatico, la filigranatura non è la soluzione miracolosa. Per proteggersi dalla disonestà accademica o dai contenuti spam generati dall'intelligenza artificiale è necessario ricorrere a sistemi di rilevamento. Per verificare con precisione la provenienza di saggi, e-mail e post sui social media, le organizzazioni devono utilizzare strumenti di rilevamento che analizzino il testo, anziché ricorrere alla filigranatura.

Non affidarti alle filigrane per proteggere la tua piattaforma. Individua immediatamente i contenuti generati dall'IA che sono stati modificati con Pangram.

Altre letture

La sfida della valutazione

Come sviluppare quadri etici per l'intelligenza artificiale nel giornalismo

Gli uffici di ammissione delle università verificano l'uso dell'IA?

Politiche utili sull'intelligenza artificiale per gli educatori

Sì, il rilevamento dell'IA può essere accurato.

Controllo dei saggi, IA e plagio

per ricevere i nostri aggiornamenti