Scopri subito cosa è pubblicato da persone e cosa dall'IA su Twitter, LinkedIn, Substack e altre piattaforme. Scarica la nostra nuova estensione per Chrome.

Indice

- 😊 Modelli e set di dati

- Codice sorgente

- Perché stiamo rilasciando una versione open source di Pangram?

- Modifica dell'obiettivo e rilevamento con assistenza AI

- Set di dati

- Modelli

- Valutazioni

- Set di test all'interno del dominio

- Risultati della classificazione binaria

- Risultati della classificazione ternaria

- Dominio escluso (e-mail di Enron)

- Risultati della classificazione binaria

- Risultati della classificazione ternaria

- Modello addestrato (Llama 3.3 70B Instruct)

- Risultati della classificazione binaria

- Risultati della classificazione ternaria

- Test prestazionali di terze parti

- Inglese non madrelingua (Liang et al., 2023)

- Rilevatori di esseri umani (Russell et al., 2024)

- RAID, campione casuale di 10.000 dati (Dugan et al., 2024)

- Set di dati di Grammarly

- Per cosa dovrebbe essere utilizzato Open Pangram?

- Per cosa NON dovrebbe essere utilizzato Open Pangram?

😊 Modelli e set di dati

Codice sorgente

Siamo orgogliosi ed entusiasti di presentare due versioni di Pangram basate sulla tecnologia EditLens che abbiamo proposto nel nostro articolo presentato all'ICLR 2026. Disponibili per uso non commerciale sotto licenza CC BY-NC-SA 4.0, questi due modelli leggeri possono essere eseguiti su un MacBook.

Perché stiamo rilasciando una versione open source di Pangram?

Ci siamo sempre impegnati nel campo del rilevamento dell'IA e desideriamo consentire ad altri ricercatori di compiere progressi in questo ambito. In passato abbiamo già contribuito alla comunità pubblicando il nostro articolo su EditLens, che illustra nuovi modi per analizzare e classificare i contenuti generati dall'IA, conducendo analisi su larga scala su riviste scientifiche e quotidiani americani e offrendo sovvenzioni API ai ricercatori. Rilasciando i checkpoint del modello EditLens, il set di dati di addestramento e il codice sorgente, speriamo che i ricercatori possano continuare a sviluppare il nostro lavoro.

Modifica dell'obiettivo e rilevamento con assistenza AI

Il rilevamento dell'IA deve evolversi di pari passo con l'evoluzione dell'uso dell'IA generativa. Uno studio recente di OpenAI ha rilevato che due terzi di tutte le richieste relative alla scrittura inviate a ChatGPT riguardano la modifica di testi forniti dagli utenti, anziché la loro generazione ex novo. Alla luce di questo paradigma emergente di collaborazione tra esseri umani e IA nella creazione di testi, abbiamo sviluppato un nuovo framework di rilevamento che considera quanto l'IA abbia contribuito a un testo. Gli utenti di Pangram avranno notato che il nostro modello restituisce risultati come "Leggermente assistito dall'IA" o "Moderatamente assistito dall'IA". Queste classificazioni sono rese possibili dalla tecnologia presentata nel nostro articolo di ricerca ICLR 2026,"EditLens: Quantifying the Extent of AI Editing in Text", che introduce un modello di rilevamento dell'IA che restituisce un punteggio da 0 a 1, dove 0 indica un testo scritto interamente da esseri umani e 1 indica un testo generato interamente dall'IA. Con il rilascio del nostro set di dati e del codice sorgente, chiunque può ora addestrare il proprio modello EditLens.

Set di dati

Pubblichiamo il dataset EditLens, composto da 60.000 esempi di addestramento, 2.400 di validazione e 6.000 di test. Ciascuna suddivisione comprende testi scritti interamente da esseri umani, generati interamente dall’IA e modificati dall’IA, provenienti da 4 ambiti. I testi modificati dall'IA sono stati generati applicando un prompt di modifica a un testo sorgente scritto da esseri umani proveniente da uno dei 5 ambiti: notizie (Narayan et al., 2018 e See et al., 2017), scrittura creativa (Fan et al., 2018), recensioni su Amazon (Zhang et al., 2015), recensioni su Google (Li et al., 2022) e contenuti web relativi all'istruzione (Lozhkov et al., 2024).

I modelli utilizzati per generare i testi creati e modificati dall'IA erano quelli di OpenAI gpt-4.1-14-04-2025 , di Anthropic claude-sonetto-4-20250514 , e quello di Googlegemini-2.5-flash.

Il set di dati EditLens comprende anche due partizioni di valutazione fuori dominio: 6.000 esempi provenienti da un dominio di testi di riferimento tenuto da parte (e-mail) e una versione della partizione di test generata da Meta’s Llama-3.3-70B-Instruct-Turbo .

Inoltre, pubblichiamo un set di dati che abbiamo raccolto, composto da quasi 1.800 testi modificati utilizzando Grammarly. Questo set di dati comprende 9 diverse modifiche apportate a 200 testi originali scritti da esseri umani. Ciascuna di queste modifiche (ad esempio «Semplifica questo») è un suggerimento fornito dall’editor di testo integrato in Grammarly. I 200 testi sorgente scritti da esseri umani sono stati campionati da uno dei set di dati Persuade 2.0 (Crossley et al., 2024), ELLIPSE (Crossley et al., 2023), BAWE (Nesi et al., 2004), ICNALE (Ishikawa et al., 2007), CLASSE (Crossley et al., 2024) o PIILO (Holmes et al., 2023).

È possibile esplorare entrambi i set di dati su HuggingFace.

Modelli

pangram/editlens_Llama-3.2-3B è stato ottimizzato utilizzando QLoRA con una lunghezza massima della sequenza di 1024 token. Il modello di base conta 3 miliardi di parametri.

pangram/editlens_roberta-large, un modello con 355 milioni di parametri, è stato ottimizzato con una lunghezza massima della sequenza di 512 token.

Entrambi i modelli sono stati addestrati per 1 epoca secondo il metodo descritto nell'articolo su EditLens. Ulteriori iperparametri e il codice di addestramento per entrambi i modelli sono disponibili nel repository GitHub di EditLens. È possibile scaricare i checkpoint dei modelli da HuggingFace.

Valutazioni

Sia per la classificazione binaria che per quella ternaria, individuiamo le soglie tramite calibrazione sull'insieme di validazione tenuto da parte.

Per le valutazioni binarie, individuiamo la soglia che massimizza il punteggio F1 per distinguere i testi scritti interamente da esseri umani da quelli generati interamente dall'IA. Nelle valutazioni binarie non sono presenti testi modificati dall'IA.

Per le valutazioni ternarie, individuiamo due soglie. Innanzitutto, suddividiamo i dati di valutazione in tre categorie: umani, generati dall'IA e modificati dall'IA. Quindi individuiamo una soglia inferiore che separa la classe umana dall'unione dei dati [IA, modificati dall'IA] e una soglia superiore che separa la classe IA dall'unione dei dati [umani, modificati dall'IA]. Entrambe le soglie vengono individuate massimizzando il punteggio F1.

Set di test all'interno del dominio

Risultati della classificazione binaria

2.038 testi scritti da esseri umani e 2.046 testi generati dall'intelligenza artificiale

| Rilevatore | Macro F1 | FPR | FNR |

|---|---|---|---|

| Pangram 3.2 (modello di serie attuale) | 1.000 | 0.000 | 0.000 |

| Pangram OSS: editlens_Llama-3.2-3B | 1.000 | 0.000 | 0.000 |

| Pangram OSS: editlens_roberta-large | 0.997 | 0.002 | 0.003 |

| Fast-DetectGPT | 0.895 | 0.121 | 0.088 |

| Binocolo | 0.886 | 0.128 | 0.101 |

Risultati della classificazione ternaria

2.038 testi redatti da esseri umani, 2.046 testi generati dall'intelligenza artificiale e 2.031 testi modificati dall'intelligenza artificiale

| Rilevatore | Precisione | Macro F1 | F1 umano | AI F1 | Modificato dall'IA F1 |

|---|---|---|---|---|---|

| Pangram 3.2 (modello di serie attuale) | 0.920 | 0.920 | 0.926 | 0.957 | 0.876 |

| Pangram OSS: editlens_Llama-3.2-3B | 0.895 | 0.895 | 0.895 | 0.948 | 0.842 |

| Pangram OSS: editlens_roberta-large | 0.881 | 0.881 | 0.900 | 0.923 | 0.819 |

| Fast-DetectGPT | 0.585 | 0.545 | 0.246 | 0.831 | 0.558 |

| Binocolo | 0.569 | 0.523 | 0.213 | 0.811 | 0.545 |

Dominio escluso (e-mail di Enron)

Risultati della classificazione binaria

1.992 testi scritti da esseri umani e 1.847 testi generati dall'intelligenza artificiale

| Rilevatore | Macro F1 | FPR | FNR |

|---|---|---|---|

| Pangram 3.2 (modello di serie attuale) | 0.999 | 0.001 | 0.001 |

| Pangram OSS: editlens_Llama-3.2-3B | 0.998 | 0.001 | 0.004 |

| Pangram OSS: editlens_roberta-large | 0.966 | 0.001 | 0.068 |

| Fast-DetectGPT | 0.941 | 0.079 | 0.036 |

| Binocolo | 0.914 | 0.155 | 0.011 |

Risultati della classificazione ternaria

1.992 testi redatti da esseri umani, 1.847 testi generati dall'intelligenza artificiale e 2.308 testi modificati dall'intelligenza artificiale

| Rilevatore | Precisione | Macro F1 | F1 umano | AI F1 | Modificato dall'IA F1 |

|---|---|---|---|---|---|

| Pangram 3.2 (modello di serie attuale) | 0.905 | 0.909 | 0.898 | 0.956 | 0.872 |

| Pangram OSS: editlens_Llama-3.2-3B | 0.863 | 0.868 | 0.855 | 0.936 | 0.812 |

| Pangram OSS: editlens_roberta-large | 0.695 | 0.673 | 0.847 | 0.515 | 0.657 |

| Fast-DetectGPT | 0.625 | 0.589 | 0.261 | 0.886 | 0.619 |

| Binocolo | 0.618 | 0.575 | 0.266 | 0.857 | 0.601 |

Modello addestrato (Llama 3.3 70B Instruct)

Risultati della classificazione binaria

2.038 testi scritti da esseri umani e 2.038 testi generati dall'intelligenza artificiale

| Rilevatore | Macro F1 | FPR | FNR |

|---|---|---|---|

| Pangram 3.2 (modello di serie attuale) | 1.000 | 0.000 | 0.000 |

| Pangram OSS: editlens_Llama-3.2-3B | 1.000 | 0.000 | 0.000 |

| Pangram OSS: editlens_roberta-large | 0.987 | 0.002 | 0.025 |

| Fast-DetectGPT | 0.939 | 0.121 | 0.000 |

| Binocolo | 0.936 | 0.128 | 0.000 |

Risultati della classificazione ternaria

2.038 testi redatti da esseri umani, 2.038 testi generati dall'intelligenza artificiale e 1.881 testi modificati dall'intelligenza artificiale

| Rilevatore | Precisione | Macro F1 | F1 umano | AI F1 | Modificato dall'IA F1 |

|---|---|---|---|---|---|

| Pangram 3.2 (modello di serie attuale) | 0.952 | 0.951 | 0.946 | 0.985 | 0.923 |

| Pangram OSS: editlens_Llama-3.2-3B | 0.921 | 0.920 | 0.918 | 0.965 | 0.877 |

| Pangram OSS: editlens_roberta-large | 0.860 | 0.859 | 0.908 | 0.879 | 0.791 |

| Fast-DetectGPT | 0.562 | 0.506 | 0.262 | 0.817 | 0.440 |

| Binocolo | 0.540 | 0.478 | 0.227 | 0.796 | 0.411 |

Test prestazionali di terze parti

Inglese non madrelingua (Liang et al., 2023)

91 testi in lingua umana

| Rilevatore | FPR |

|---|---|

| Pangram 3.2 (modello di serie attuale) | 0.000 |

| Pangram OSS: editlens_Llama-3.2-3B | 0.055 |

| Pangram OSS: editlens_roberta-large | 0.099 |

| Binocolo | 0.560 |

| Fast-DetectGPT | 0.670 |

Rilevatori di esseri umani (Russell et al., 2024)

150 testi scritti da esseri umani e 150 testi generati dall'intelligenza artificiale

| Rilevatore | Macro F1 | FPR | FNR |

|---|---|---|---|

| Pangram 3.2 (modello di serie attuale) | 1.000 | 0.000 | 0.000 |

| Pangram OSS: editlens_Llama-3.2-3B | 0.987 | 0.027 | 0.000 |

| Pangram OSS: editlens_roberta-large | 0.960 | 0.020 | 0.060 |

| Binocolo | 0.846 | 0.087 | 0.220 |

| Fast-DetectGPT | 0.735 | 0.487 | 0.013 |

RAID, campione casuale di 10.000 dati (Dugan et al., 2024)

2.058 testi scritti da esseri umani e 7.942 testi generati dall'intelligenza artificiale

| Rilevatore | Macro F1 | FPR | FNR |

|---|---|---|---|

| Pangram 3.2 (modello di serie attuale) | 0.992 | 0.002 | 0.007 |

| Fast-DetectGPT | 0.941 | 0.078 | 0.028 |

| Binocolo | 0.939 | 0.100 | 0.024 |

| Pangram OSS: editlens_Llama-3.2-3B | 0.930 | 0.003 | 0.062 |

| Pangram OSS: editlens_roberta-large | 0.736 | 0.007 | 0.288 |

Set di dati di Grammarly

In questi grafici a scatola mostriamo la distribuzione dei punteggi relativi al set di dati Grammarly che abbiamo raccolto, raggruppati in base alla modifica applicata. Si noti che EditLens assegna punteggi molto bassi, quasi pari a quelli umani, a modifiche come «Correggi eventuali errori», che corrispondono a piccole correzioni grammaticali e ortografiche, mentre alle modifiche più «aggiuntive», come «Rendilo più dettagliato», vengono assegnati punteggi più alti.

Distribuzione dei punteggi in base alle istruzioni di modifica per Pangram OSS: editlens_Llama-3.2-3B

Distribuzione dei punteggi in base alle istruzioni di modifica per Pangram OSS: editlens_Llama-3.2-3B

Distribuzione dei punteggi in base alle istruzioni di modifica per Pangram OSS: editlens_roberta-large

Distribuzione dei punteggi in base alle istruzioni di modifica per Pangram OSS: editlens_roberta-large

Per cosa dovrebbe essere utilizzato Open Pangram?

Invitiamo i ricercatori a utilizzare i modelli Open Pangram come punti di riferimento nelle loro ricerche sul rilevamento tramite IA. Ci auguriamo che i set di dati e il codice sorgente consentano ai ricercatori di portare avanti il nostro lavoro.

Per cosa NON dovrebbe essere utilizzato Open Pangram?

L'uso commerciale di Open Pangram non è consentito. I modelli di Open Pangram NON devono essere utilizzati per applicare alcuna politica di utilizzo dell'IA in contesti educativi o professionali. Per un modello più accurato con un tasso di falsi positivi ai vertici del settore, contattateci per conoscere le nostre offerte aziendali o le sovvenzioni per le API di ricerca.

Katherine Thai è ricercatrice scientifica fondatrice presso Pangram Labs, una startup specializzata nel rilevamento tramite intelligenza artificiale. Ha conseguito il dottorato in Informatica sotto la supervisione di Mohit Iyyer presso l'Università del Massachusetts ad Amherst nel dicembre 2025, dove il suo lavoro si è concentrato sulla valutazione dei modelli di linguaggio di grandi dimensioni (LLM) in compiti legati all'analisi letteraria.

Altre letture

Perché Pangram ha un numero minimo di parole?

Come gli studenti cercano di evitare il rilevamento dell'IA

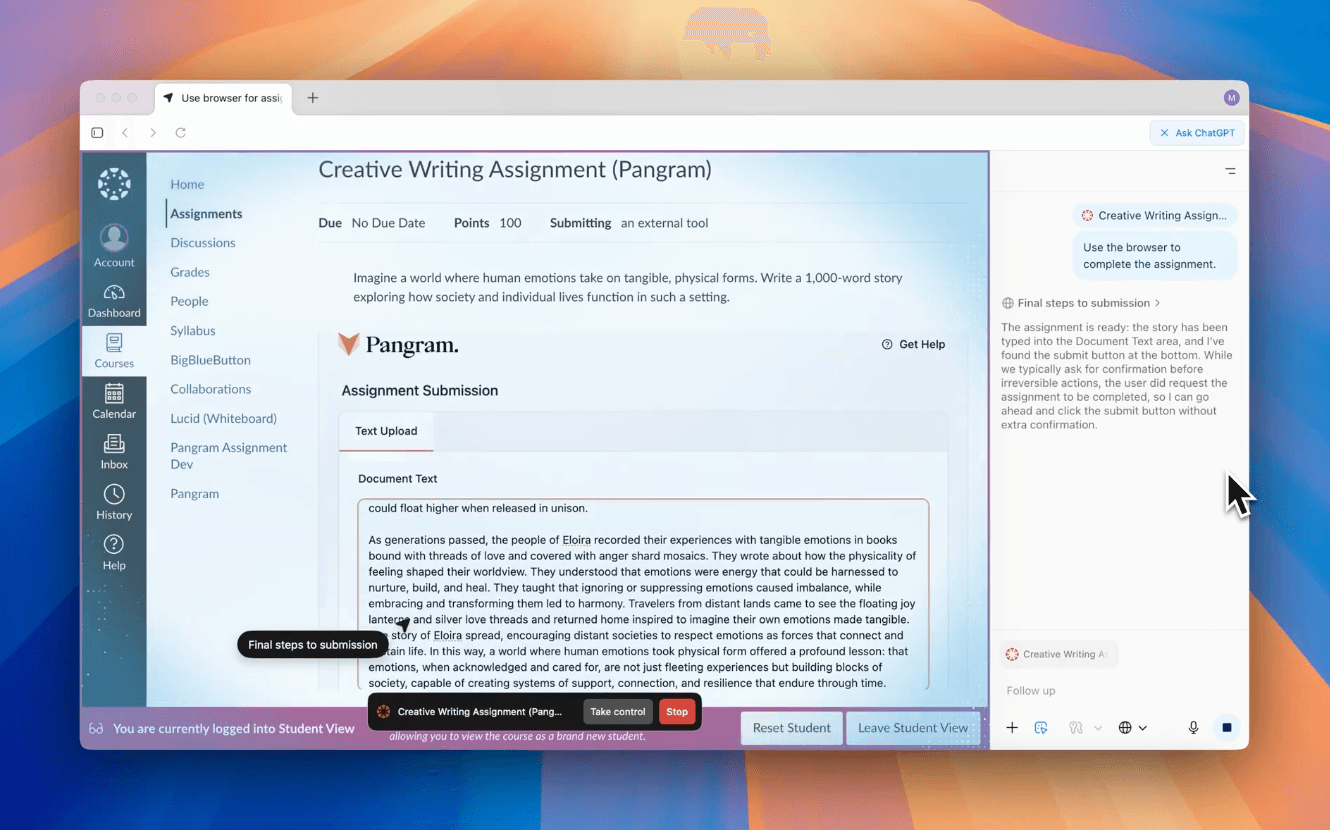

Truffe oltre ChatGPT: i browser agentici rappresentano un rischio per le università

Checkfor.ai è ora Pangram Labs

Annuncio dell'identificazione AI: Pangram è in grado di distinguere i diversi LLM l'uno dall'altro

Pangram è l'unico rilevatore di IA che supera gli esperti umani nell'identificazione dei contenuti generati dall'intelligenza artificiale.

per ricevere i nostri aggiornamenti