Scopri subito cosa è pubblicato da persone e cosa dall'IA su Twitter, LinkedIn, Substack e altre piattaforme. Scarica la nostra nuova estensione per Chrome.

Relazione tecnica sul rilevamento di testi generati dall'intelligenza artificiale con elevata precisione

Indice

- Introduzione

- TL;DR

- Introduzione ai testi generati dall'intelligenza artificiale

- Perché Pangram Labs è ossessionata dalla precisione

- Confronto tra strumenti di rilevamento basati sull'intelligenza artificiale

- Analisi approfondita dei risultati

- Robustezza

- L'inglese come seconda lingua

- L'approccio di Pangram Labs al rilevamento dell'intelligenza artificiale

- Specchi sintetici

- Estrazione mineraria negativa difficile

- Quali sono i prossimi passi per Pangram Labs?

Processo di addestramento del classificatore di testi generati dall'intelligenza artificiale di Pangram Labs

Processo di addestramento del classificatore di testi generati dall'intelligenza artificiale di Pangram Labs

Introduzione

Noi di Pangram Labs stiamo sviluppando il miglior modello di rilevamento di testi basato sull'intelligenza artificiale per proteggere Internet dall'invasione di contenuti inautentici, ingannevoli e di scarsa qualità. Crediamo che, in un mondo guidato dai modelli di linguaggio di grandi dimensioni (LLM), gli esseri umani dovranno disporre degli strumenti migliori per individuare la verità, e vogliamo fornire la tecnologia adeguata a soddisfare questa esigenza.

Pangram Labs ha sviluppato un classificatore avanzato in grado di individuare i testi generati dall'intelligenza artificiale che potrebbero essere utilizzati per diffondere spam o contenuti fraudolenti. Quanto è superiore il nostro modello rispetto alle alternative disponibili sul mercato? In questo articolo del blog presentiamo un'analisi approfondita delle prestazioni del nostro modello, accompagnata dal nostro primo white paper tecnico pubblicato.

Questo articolo del blog tratterà diversi argomenti:

- Perché il rilevamento dei testi generati dall'intelligenza artificiale è una questione importante?

- Qual è il miglior strumento per individuare i contenuti generati dall'intelligenza artificiale?

- Perché è importante un'elevata precisione?

- Quali tipi di contenuti è in grado di rilevare Pangram Labs?

- In che modo Pangram Labs ha affrontato la risoluzione di questo problema?

Per un'analisi più approfondita dal punto di vista tecnico, compresa la metodologia, consulta il nostro rapporto tecnico sul classificatore di testi generati dall'IA Pangram.

TL;DR

Abbiamo effettuato un'analisi comparativa competitiva utilizzando quasi 2000 documenti per determinare i principali indicatori di accuratezza, tra cui l'accuratezza complessiva, i casi di falsi positivi e i casi di falsi negativi.

Our text classifier outperforms academic methods and shows significantly lower error rates in a comprehensive benchmark against other available AI text detection methods. Our model demonstrates 99.85% accuracy with 0.19% false positive rate across thousands of examples across ten different categories of writing and eight commonly used large language models. Other methods fail on more capable LLMs such as GPT-4 (<=75% accuracy) while Pangram Labs sustains 99-100% accuracy across all language models tested.

Confronto della precisione complessiva

Confronto della precisione complessiva

Introduzione ai testi generati dall'intelligenza artificiale

I modelli linguistici di grandi dimensioni (LLM), come ChatGPT, hanno visto esplodere la loro popolarità nel 2023, quando le capacità dell’IA hanno raggiunto un punto di svolta. Gli LLM alla base degli assistenti IA erano in grado di rispondere a domande, proporre idee e scrivere contenuti, il tutto con un tono convincente e quasi umano. Ciò ha portato alcuni risultati positivi: le informazioni sono più accessibili che mai e gli assistenti ci fanno risparmiare tempo nelle attività di routine. Tuttavia, chiunque è in grado di produrre testi convincenti e simili a quelli umani praticamente senza alcuno sforzo, il che presenta una serie di svantaggi. Gli spammer possono scrivere e-mail più difficili da filtrare. I venditori sui mercati online possono produrre migliaia di recensioni dall'aspetto autentico in pochi minuti. I malintenzionati possono ricorrere ai social media e influenzare l'opinione pubblica con migliaia di bot alimentati da LLM.

Purtroppo questi rischi sociali non possono essere mitigati a livello dei modelli linguistici (LLM): tali modelli non sono in grado di distinguere se una richiesta sia legittima o se sia una delle migliaia generate da uno spammer. Per questo motivo, abbiamo bisogno di filtri dei contenuti a livello di applicazione, per garantire che gli spazi dedicati alle persone rimangano tali.

Perché Pangram Labs è ossessionata dalla precisione

Abbiamo sentito molte voci scettiche riguardo a questo settore. Si dice che il problema sia irrisolvibile, che sia stato dimostrato che i rilevatori di IA «non funzionano», o che basti aggirarli con le istruzioni. O ancora che, anche se oggi è possibile, l'anno prossimo sarà più difficile e impossibile quando arriverà l'AGI.

La nostra posizione è leggermente diversa. Crediamo fermamente che questo problema non solo sia possibile risolvere, ma sia anche necessario farlo. Non importa quanto sia difficile, né quante ore dovremo dedicarci per creare qualcosa che gli utenti possano utilizzare e di cui possano fidarsi. Senza il nostro lavoro, è solo questione di anni prima che Internet venga invasa dagli spammer basati sull'intelligenza artificiale. Le voci umane saranno soffocate dal rumore di fondo.

Per noi, garantire che il problema sia risolto significa continuare ad aumentare la difficoltà dei nostri set di valutazione. All’inizio era facile raggiungere il 100% di accuratezza, ma è diventato subito evidente che ciò non rispecchiava l’accuratezza nel mondo reale. Creando valutazioni più complesse, siamo in grado di misurare i nostri progressi in modo oggettivo. Riteniamo già che il nostro attuale benchmark sia leggermente più difficile di quello che gli spammer del mondo reale mettono in circolazione, e questo benchmark è vicino al massimo. Quando torneremo con nuovi numeri, potrebbe sembrare che altri metodi siano peggiorati ulteriormente, ma la realtà è che torneremo con un set di valutazione più difficile, in cui le IA più capaci saranno spinte al limite per creare testi che sembrino autentici, e il nostro obiettivo è quello di riuscire comunque a individuarli con un'accuratezza del 99%.

Il problema non sarà mai risolto del tutto, ma dobbiamo compiere progressi costanti per evitare di restare indietro man mano che i modelli di linguaggio di grandi dimensioni diventano sempre più potenti. È questo l’impegno che abbiamo assunto e che continueremo a perseguire fino alla fine.

Confronto tra strumenti di rilevamento basati sull'intelligenza artificiale

Nel nostro rapporto tecnico abbiamo messo a confronto Pangram Labs con i due principali strumenti di rilevamento dell'IA, oltre che con un metodo accademico all'avanguardia del 2023 per il rilevamento dell'IA.

Confrontiamo:

- Pangram Labs

- GPTZero

- Originalità.ai

- DetectGPT

Il nostro benchmark comprende 1.976 documenti: metà di essi sono stati redatti da esseri umani, mentre l'altra metà è stata generata da otto dei modelli di linguaggio generativo (LLM) più diffusi, tra cui ChatGPT e GPT-4.

Confronto della precisione complessiva

Confronto della precisione complessiva

Una breve spiegazione del significato di questi numeri:

- Accuratezza: quale percentuale del totale dei documenti è stata classificata correttamente dallo strumento?

- Tasso di falsi positivi: su tutti i documenti redatti da esseri umani, quanti sono stati erroneamente classificati come generati dall'IA?

- Tasso di falsi negativi: su tutti i documenti generati dall'IA, quanti sono stati erroneamente classificati come creati dall'uomo?

Per illustrare concretamente il tasso di falsi positivi: un 9% significa che un documento redatto da un essere umano su 11 verrà segnalato come generato dall'IA. Un tasso di falsi positivi del 2% significa che un documento redatto da un essere umano su 50 verrà segnalato come generato dall'IA. E uno dello 0,67% significa che un documento redatto da un essere umano su 150 verrà segnalato come generato dall'IA.

Allo stesso modo, un tasso di falsi negativi del 10% significa che un documento generato dall'IA su dieci sfugge al rilevamento, mentre un tasso di falsi negativi dell'1,4% significa che un documento generato dall'IA su settanta sfugge al rilevamento.

Consideriamo le implicazioni di questi risultati. Non ci si può fidare di un modello di rilevamento con un tasso di falsi positivi del 9%: altrimenti le accuse infondate sarebbero all’ordine del giorno. E un modello di rilevamento con un tasso di falsi negativi del 10% lascerebbe passare così tanto spam generato dall’IA che, in caso di attacco, gli utenti sarebbero comunque sommersi da messaggi indesiderati.

Analisi approfondita dei risultati

Il nostro parametro di riferimento si articola su due assi distinti: il dominio testuale e l'LLM di origine. Il termine «dominio testuale», o semplicemente «dominio», indica una specifica categoria di testi. Ad esempio, un tema scritto da uno studente delle scuole medie si presenta in modo molto diverso da un articolo scientifico, che a sua volta è molto diverso da un'e-mail. Suddividendo i risultati in diversi domini, possiamo ottenere una visione più completa dei nostri punti di forza e delle aree su cui concentrare i nostri sforzi per migliorare.

Precisione per ambito testuale

Precisione per ambito testuale

I risultati dimostrano che Pangram Labs supera GPTZero e Originality in tutti e dieci i criteri valutati.

Uno dei settori, quello delle e-mail, registra risultati particolarmente positivi poiché Pangram Labs non include alcuna e-mail nei propri dati di addestramento. Le nostre prestazioni in questo ambito derivano interamente dall'addestramento di un modello solido, in grado di generalizzare alla maggior parte delle categorie di testi che un modello di linguaggio di grandi dimensioni (LLM) può generare.

Documenti AI classificati correttamente, in base all'origine LLM

Documenti AI classificati correttamente, in base all'origine LLM

Se si analizzano i risultati in base all'origine dei modelli LLM, emerge un quadro diverso: i modelli concorrenti di rilevamento dell'IA ottengono risultati migliori sui modelli open source meno potenti, ma peggiori su ChatGPT (gpt-3.5-turbo) e incontrano notevoli difficoltà con GPT-4, il modello LLM più potente di OpenAI. Abbiamo valutato diverse versioni dei modelli GPT 3.5 Turbo e GPT-4, poiché sono quelli più comunemente utilizzati in ambito pratico.

Abbiamo riscontrato che il nostro è l'unico modello in grado di rilevare in modo affidabile i testi generati da GPT-4 e che, inoltre, supera in prestazioni tutti gli altri modelli che abbiamo testato.

Un'osservazione interessante è che il nostro sistema ottiene risultati nettamente migliori sui modelli open source rispetto ai modelli GPT e Gemini closed-source. Ipotizziamo che ciò sia dovuto a un eccessivo affidamento sulle caratteristiche di perplessità e burstiness: sebbene queste caratteristiche siano preziose, è possibile calcolare con precisione la perplessità e la burstiness solo su un modello open source; sui modelli closed-source, si può solo effettuare una stima approssimativa. Ciò dimostra il valore del nostro approccio basato sul deep learning: non si affida a caratteristiche fragili come la perplessità e può apprendere modelli sottostanti più sottili.

Robustezza

Una domanda che ci viene spesso posta è: cosa succede quando viene rilasciato un nuovo modello linguistico? È necessario addestrare il modello su ogni nuova versione per rilevarne i risultati? In breve, no. Nelle settimane scorse OpenAI ha rilasciato due nuove versioni dei propri modelli linguistici (LLM). Senza aver effettuato alcun addestramento su questi nuovi modelli, abbiamo valutato il nostro modello e abbiamo scoperto che ha comunque ottenuto ottimi risultati!

- GPT-3.5-Turbo-0125: precisione del 99,66%

- GPT-4-0125-Anteprima: precisione del 99,18%

Queste nuove versioni sono simili a quelle precedenti rilasciate da OpenAI. La domanda che ci poniamo quindi è: come se la caviamo con famiglie di modelli completamente diverse? Per rispondere a questa domanda, abbiamo valutato il nostro modello su una serie di modelli open source che il nostro classificatore non aveva mai visto prima.

Risultato ottenuto da un modello di linguaggio di grandi dimensioni (LLM) open source, che Pangram Labs non ha mai visto durante l'addestramento.

Risultato ottenuto da un modello di linguaggio di grandi dimensioni (LLM) open source, che Pangram Labs non ha mai visto durante l'addestramento.

Davvero fantastico! Ciò è in gran parte dovuto al fatto che molti modelli open source derivano dalla famiglia Llama oppure utilizzano set di addestramento open source simili, ma questo ci aiuta ad avere fiducia nella nostra capacità di generalizzare senza dover addestrare ogni singolo modello open source.

Detto questo, la nostra pipeline di dati è strutturata in modo tale da consentirci di generare un nuovo set di addestramento entro poche ore dal rilascio di un'API LLM, con l'unico limite rappresentato dal limite di velocità dell'API. Siamo ben consapevoli che i modelli LLM continuano a migliorare e, man mano che ci avviciniamo all'AGI, sarà sempre più importante rimanere aggiornati e assicurarci di poter stare al passo anche con gli agenti di IA più avanzati.

L'inglese come seconda lingua

Ricerche precedenti hanno evidenziato che i sistemi di rilevamento LLM disponibili in commercio presentano un sistematico pregiudizio nei confronti dei parlanti non madrelingua (ESL, ovvero inglese come seconda lingua). Per verificare questa ipotesi, i ricercatori hanno utilizzato un campione di riferimento composto da 91 saggi tratti dal TOEFL (Test of English as a Foreign Language) per testare diversi sistemi di rilevamento.

Abbiamo selezionato i 91 saggi TOEFL dal nostro set di addestramento e abbiamo valutato Pangram Labs sul benchmark. Grazie al nostro lavoro volto a ridurre al minimo i tassi di falsi positivi per gli studenti ESL, registriamo un tasso di falsi positivi pari allo 0% sul benchmark TOEFL: ciò significa che nessuno dei saggi scritti da esseri umani presenti in questo benchmark è stato erroneamente classificato come prodotto dall'IA.

Confronto con i valori di riferimento del TOEFL

Confronto con i valori di riferimento del TOEFL

L'approccio di Pangram Labs al rilevamento dell'intelligenza artificiale

Individuare i contenuti generati dall'intelligenza artificiale non è un compito facile. Addestriamo un modello di deep learning basato su un'architettura Transformer, utilizzando due metodi chiave per portare la precisione del nostro modello a un livello superiore.

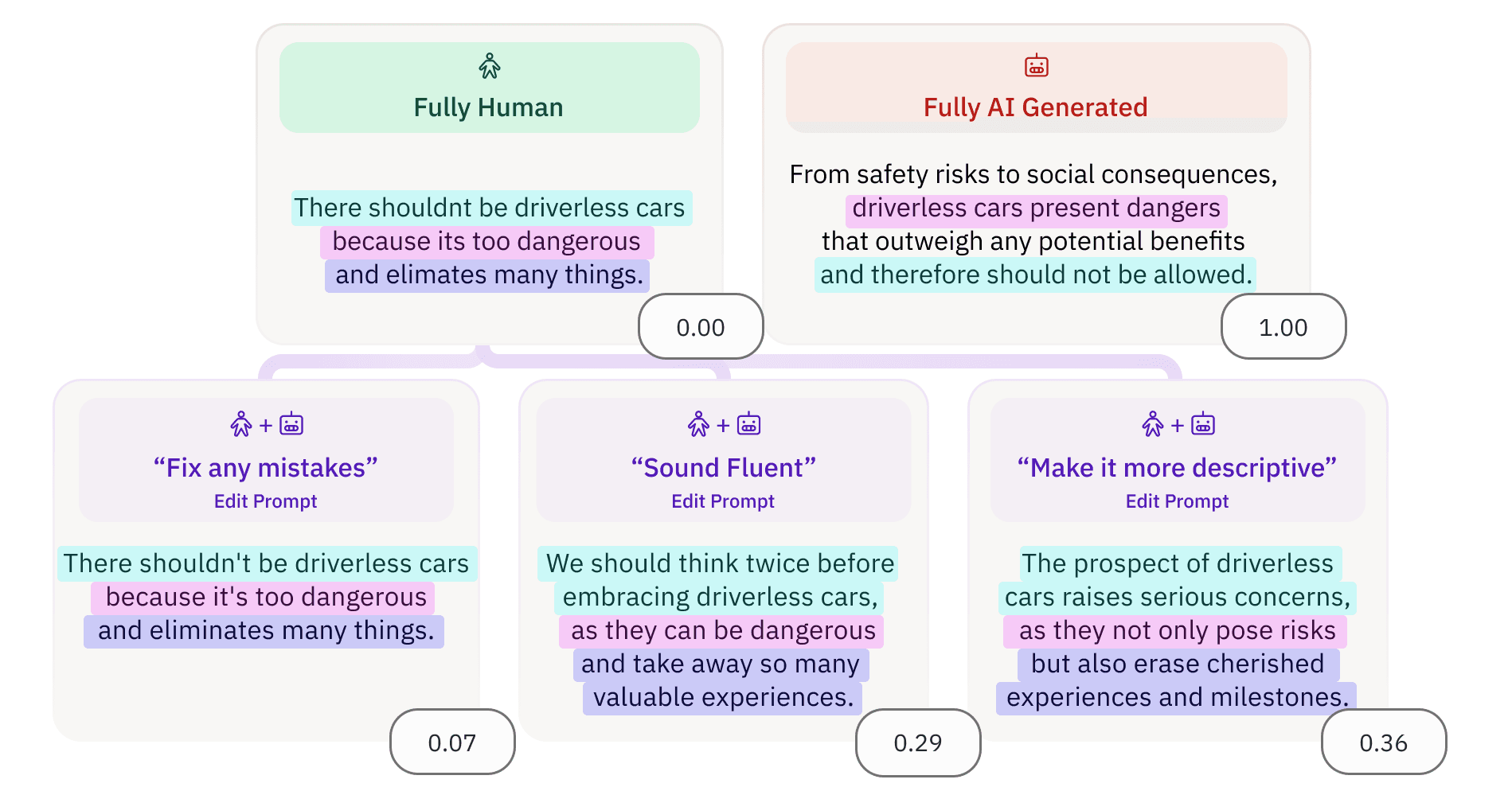

Specchi sintetici

Ogni documento del nostro set di addestramento è contrassegnato come "Umano" o "IA". Nell'apprendimento automatico, questi documenti vengono chiamati "esempi".

Abbiamo a disposizione milioni di esempi umani provenienti da set di dati pubblici su cui addestrare i modelli, ma non esistono set di dati equivalenti per l'IA. Risolviamo questo problema abbinando ogni esempio umano a uno "specchio sintetico" - un termine che usiamo per descrivere un documento generato dall'IA basato su un documento umano. Stimoliamo un LLM richiedendo un documento sullo stesso argomento e della stessa lunghezza. Per una piccola parte degli esempi, facciamo in modo che l'LLM inizi dalla prima frase del documento umano, per rendere i documenti generati dall'IA più vari.

Estrazione mineraria negativa difficile

Fin dall'inizio abbiamo raggiunto un limite nell'addestramento del nostro modello. Abbiamo provato ad aggiungere altri esempi, ma alla fine abbiamo scoperto che il modello era "saturato": l'aggiunta di ulteriori esempi non ne migliorava ulteriormente le prestazioni.

Esperimento sulle leggi di scala

Esperimento sulle leggi di scala

Le prestazioni di questo modello iniziale erano insoddisfacenti: presentava ancora un tasso di falsi positivi superiore all'1% in molti ambiti. Abbiamo scoperto che non servivano solo più esempi, ma esempi più complessi.

Abbiamo individuato esempi più complessi prendendo il nostro modello iniziale e analizzando decine di milioni di esempi reali presenti in dataset aperti, alla ricerca dei documenti più difficili che il nostro modello aveva classificato in modo errato. Abbiamo quindi generato copie sintetiche di questi documenti e le abbiamo aggiunte al nostro set di addestramento. Infine, abbiamo riaddestrato il modello e ripetuto il processo.

Processo di addestramento del classificatore di testi generati dall'intelligenza artificiale di Pangram Labs

Processo di addestramento del classificatore di testi generati dall'intelligenza artificiale di Pangram Labs

Grazie a questo metodo di addestramento, siamo riusciti a ridurre i nostri tassi di falsi positivi di 100 volte e a lanciare un modello di cui siamo orgogliosi.

Tabella dei tassi di falsi positivi per dominio

Tabella dei tassi di falsi positivi per dominio

Questo metodo è denominato «hard negative mining con specchi sintetici»; ne illustriamo il processo in modo più dettagliato nel nostro rapporto tecnico.

Quali sono i prossimi passi per Pangram Labs?

Ovviamente, questo non è il punto di arrivo del nostro percorso. Abbiamo tantissime nuove idee su come portare le prestazioni a un livello superiore. Continueremo a migliorare i nostri set di valutazione per poter monitorare con maggiore precisione il tasso di falsi positivi, fino ai centesimi di punto percentuale. Abbiamo in programma di estendere il nostro modello alle lingue diverse dall'inglese e stiamo lavorando per comprendere e individuare i casi di errore. Restate sintonizzati per scoprire quali saranno i nostri prossimi passi!

Hai domande o commenti? Contattaci all'indirizzo info@pangram.com!

Bradley è un ricercatore nel campo dell'intelligenza artificiale ed esperto nella creazione di prodotti di deep learning nel settore industriale. Recentemente ha guidato il gruppo di ricerca sul deep learning presso Absci, un'azienda che si occupa di scoperta di farmaci tramite intelligenza artificiale generativa, e in precedenza è stato membro del team principale di visione artificiale presso Tesla Autopilot.

Durante gli studi universitari, Bradley ha pubblicato diversi articoli sulla ricerca nel campo del deep learning con lo Stanford Vision Lab. Ha conseguito una laurea in fisica e un master in intelligenza artificiale presso la Stanford University. Oltre all'intelligenza artificiale, è appassionato di educazione e filosofia ed è un avido giocatore di golf.

Max è un ingegnere esperto nel campo dell'apprendimento automatico. Recentemente ha lavorato sui veicoli autonomi presso Nuro, guidando il loro progetto di apprendimento attivo. Ha una lunga esperienza nell'implementazione di prodotti di apprendimento automatico di successo presso Google, Two Sigma e Yelp.

Max ha conseguito una laurea in informatica teorica e un master in intelligenza artificiale presso la Stanford University. Oltre alla sua passione per la costruzione, è anche un membro attivo della comunità Magic: the Gathering cube.

Altre letture

Pangram rileva Llama 4 di Meta?

Pangram 3.0: quantificare l'entità della modifica dell'IA nel testo

Introduzione ai tag e ai gruppi

Il rilevatore di IA di Pangram dimostra ottime prestazioni in oltre 20 lingue

Presentazione delle frasi AI di Pangram

Pangram ora è in grado di rilevare gli umanizzatori AI

per ricevere i nostri aggiornamenti