Scopri subito cosa è pubblicato da persone e cosa dall'IA su Twitter, LinkedIn, Substack e altre piattaforme. Scarica la nostra nuova estensione per Chrome.

I marketer stanno sprecando la spesa pubblicitaria sui contenuti generati dall'intelligenza artificiale

Foto di Tima Miroshnichenko.

Foto di Tima Miroshnichenko.

TL;DR

Man mano che gli LLM diventano più sofisticati, i truffatori e gli spammer si renderanno conto dell'opportunità di utilizzare l'IA generativa per diffondere contenuti non autentici sul web con l'intenzione di sottrarre fondi pubblicitari.

Google ha già adottato misure per ridurre il posizionamento delle pubblicazioni generate dall'intelligenza artificiale nel proprio algoritmo di ricerca, ma i marchi e le agenzie pubblicitarie devono sviluppare soluzioni per identificare e filtrare i contenuti generati dall'intelligenza artificiale prima che i loro annunci vengano inseriti in modo inappropriato in contenuti creati appositamente per la pubblicità.

Contesto

Già a marzo, Google aveva annunciato che avrebbe intrapreso misure significative contro l'aumento dei contenuti generati dall'intelligenza artificiale che comparivano nei risultati di ricerca degli utenti. Dopo l'adozione su larga scala dei modelli di linguaggio (LLM) nel 2023, i malintenzionati si sono resi conto di poter produrre grandi volumi di contenuti di bassa qualità, pieni di parole chiave, per ingannare gli algoritmi di ranking e migliorare il posizionamento dei propri siti web. Google ha classificato questo tipo di hacking SEO come"abuso di contenuti su larga scala"e ha modificato le proprie politiche per ridurre la visibilità di questi siti nei risultati, o almeno del 40% secondo quanto afferma Google.

I marchi si affidano solitamente ad agenzie digitali per gestire le proprie campagne pubblicitarie online. I contenuti pubblicitari vengono venduti e distribuiti in modo più efficace attraverso la pubblicità programmatica, che consente agli inserzionisti di rivolgersi a un pubblico mirato posizionando gli annunci accanto a contenuti pertinenti (operazione nota come "acquisto di spazio pubblicitario" sul sito di un editore). Questo processo permette, ad esempio, a un'azienda produttrice di integratori di posizionare automaticamente i propri contenuti pubblicitari accanto a un post di un blog dedicato al fitness o su un forum dedicato allo yoga.

Perché dovrebbe interessare agli inserzionisti?

La spesa programmatica, che nel 2023 ha superato i 150 miliardi di dollari solo negli Stati Uniti, è un sistema vulnerabile alle manipolazioni. Gli inserzionisti hanno già dovuto affrontare casi di frode pubblicitaria legati ai siti creati appositamente per la pubblicità (MFA), ovvero siti realizzati, solitamente con contenuti di scarsa qualità o plagiati, con l'intento di vendere il maggior numero possibile di spazi pubblicitari.

Esempio di MFA (fonte: nonstopnostalgia.com)

I marchi di fascia alta noteranno che i loro annunci pubblicitari compaiono talvolta su questi siti. Proprio lo scorso anno, il 21% delle impressioni pubblicitarie in un campione è stato attribuito ai siti MFA e il 15% della spesa pubblicitaria, pari a circa 13 miliardi di dollari, è stato destinato a questi siti.

I siti MFA non sono certo una novità, ma l'intelligenza artificiale sta diventando uno strumento facile e accessibile che consente agli spammer di avviare operazioni di produzione di contenuti con il minimo sforzo. Sebbene i modelli di linguaggio di grandi dimensioni (LLM) non ridurranno in modo significativo i costi della generazione artificiale di contenuti, ne aumenteranno sicuramente il volume, come si evince dalle recenti reazioni di Google.

I truffatori dispongono ora degli strumenti necessari per espandere rapidamente siti di scarsa qualità nel giro di poche ore e trarre profitto da una spesa pubblicitaria mal indirizzata. In uno studio condotto lo scorso anno, oltre 140 grandi marchi hanno finito per pagare spazi pubblicitari su questi siti di "content farm" generati dall'intelligenza artificiale. Con il miglioramento dei modelli e degli strumenti nel corso dell'ultimo anno, la creazione e la pubblicazione di siti MFA generati dall'intelligenza artificiale diventerà sempre più facile.

Come dovrebbero reagire gli inserzionisti?

Il punto fondamentale per gli inserzionisti è riconoscere la differenza di valore tra i contenuti generati dall'uomo e quelli generati artificialmente. Non tutti i contenuti generati dall'intelligenza artificiale sono intrinsecamente negativi o devono essere considerati un rischio per la sicurezza del marchio, ma il loro valore è sicuramente inferiore agli occhi del consumatore. È stato dimostrato che , ai fini della SEO, le pagine con il posizionamento più alto non sono quelle che contengono contenuti generati dall'intelligenza artificiale.

- Secondo un rapporto dell'Edelman Trust Institute, la fiducia dei consumatori statunitensi nell'intelligenza artificiale è diminuita del 15% negli ultimi cinque anni

- Da un sondaggio condotto da Bynder nel 2024 è emerso che il 52% dei consumatori tendeva a disinteressarsi dei contenuti generati dall'intelligenza artificiale e che i millennial erano più propensi a preferire i contenuti creati da esseri umani.

Ciò significa semplicemente che gli inserzionisti hanno bisogno di maggiore visibilità sui luoghi in cui vengono pubblicati i loro annunci e di maggiore trasparenza sull'autenticità dei contenuti che sponsorizzano. Le agenzie e i marchi potrebbero inoltre trovarsi, a un certo punto, nella necessità di creare o adottare team e soluzioni specifici per gestire i contenuti non autentici, al fine di proteggere i propri investimenti. Gartner prevede che entro il 2027 l'80% dei professionisti del marketing avrà creato dei "team dedicati all'autenticità dei contenuti" proprio a questo scopo.

Fortunatamente, Pangram Labs sta sviluppando le soluzioni di rilevamento più accurate per identificare i testi generati dall'intelligenza artificiale quasi in tempo reale. Prevediamo un futuro in cui la maggior parte dei professionisti del marketing digitale dovrà reagire in tempo reale per bloccare i siti che generano spam tramite l'intelligenza artificiale. A tal fine, Pangram Labs sta lavorando allo sviluppo di una lista di blocco MFA aggiornata frequentemente e non vede l'ora di aiutare i marchi e gli inserzionisti a recuperare gli investimenti persi a causa dei contenuti generati dall'intelligenza artificiale.

Per saperne di più, contattaci all'indirizzo info@pangram.com!

Altre letture

Pangram collabora con Proofig AI per integrare il rilevamento della scrittura AI in PubShield

Dipendente in primo piano: vi presentiamo Elyas, ingegnere fondatore di Pangram!

Vi presentiamo Open Pangram

Pangram è l'unico rilevatore di IA che supera gli esperti umani nell'identificazione dei contenuti generati dall'intelligenza artificiale.

La teoria dell'informazione alla base del motivo per cui i testi generati dall'IA fanno schifo

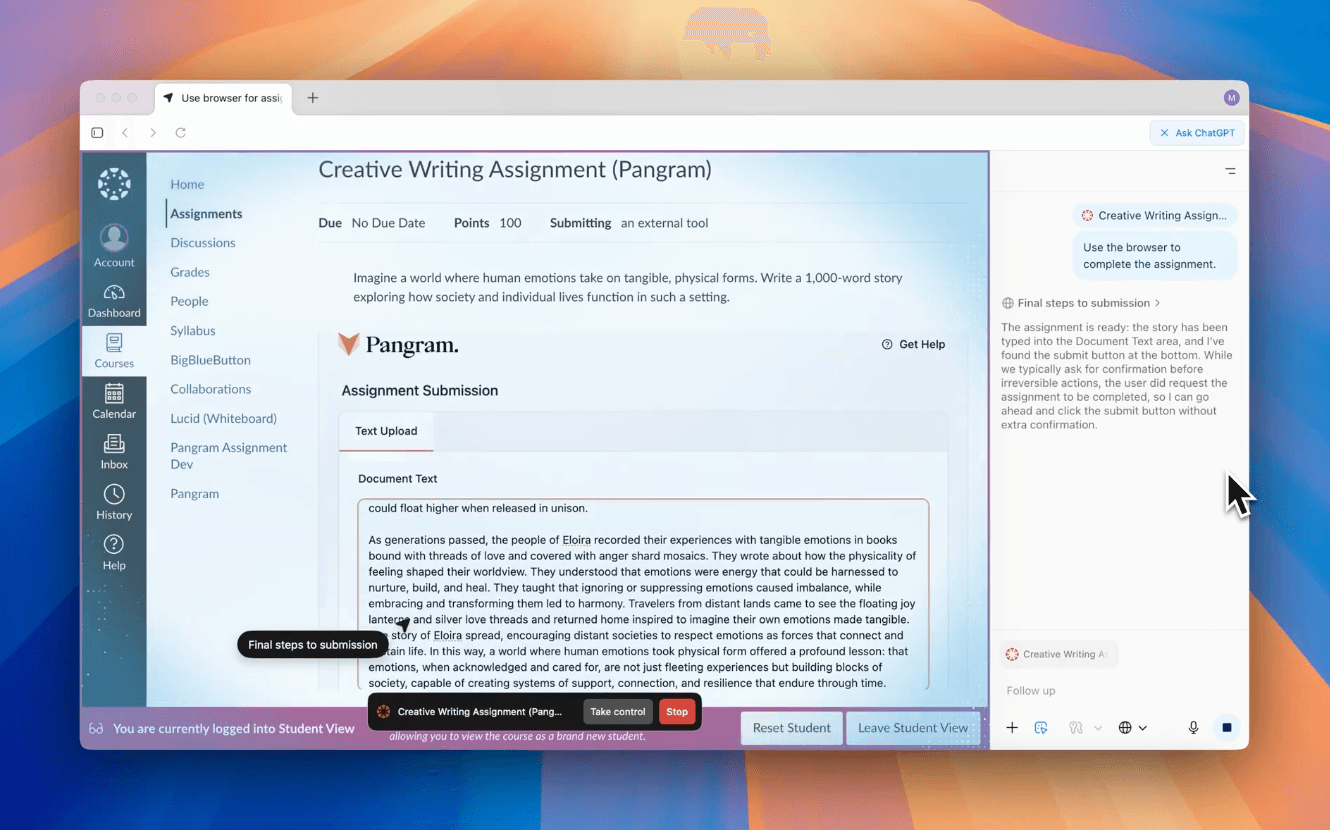

Truffe oltre ChatGPT: i browser agentici rappresentano un rischio per le università

per ricevere i nostri aggiornamenti