エッセイチェッカーとは何ですか?

過去において、「エッセイチェッカー」とは、テキストのスペル、文法、語彙の誤りを分析するツールを指す用語でした。また、Reciteに見られるように、引用に関する問題をチェックするためにも使用されることがありました。人気の教育ツールであるTurnitinは、剽窃のチェックに非常に役立っています。

現在、AIブームにより教育関係者はAI生成コンテンツを検出するチェックツールの導入を検討せざるを得なくなっている。

AI論文チェッカーは正確か?

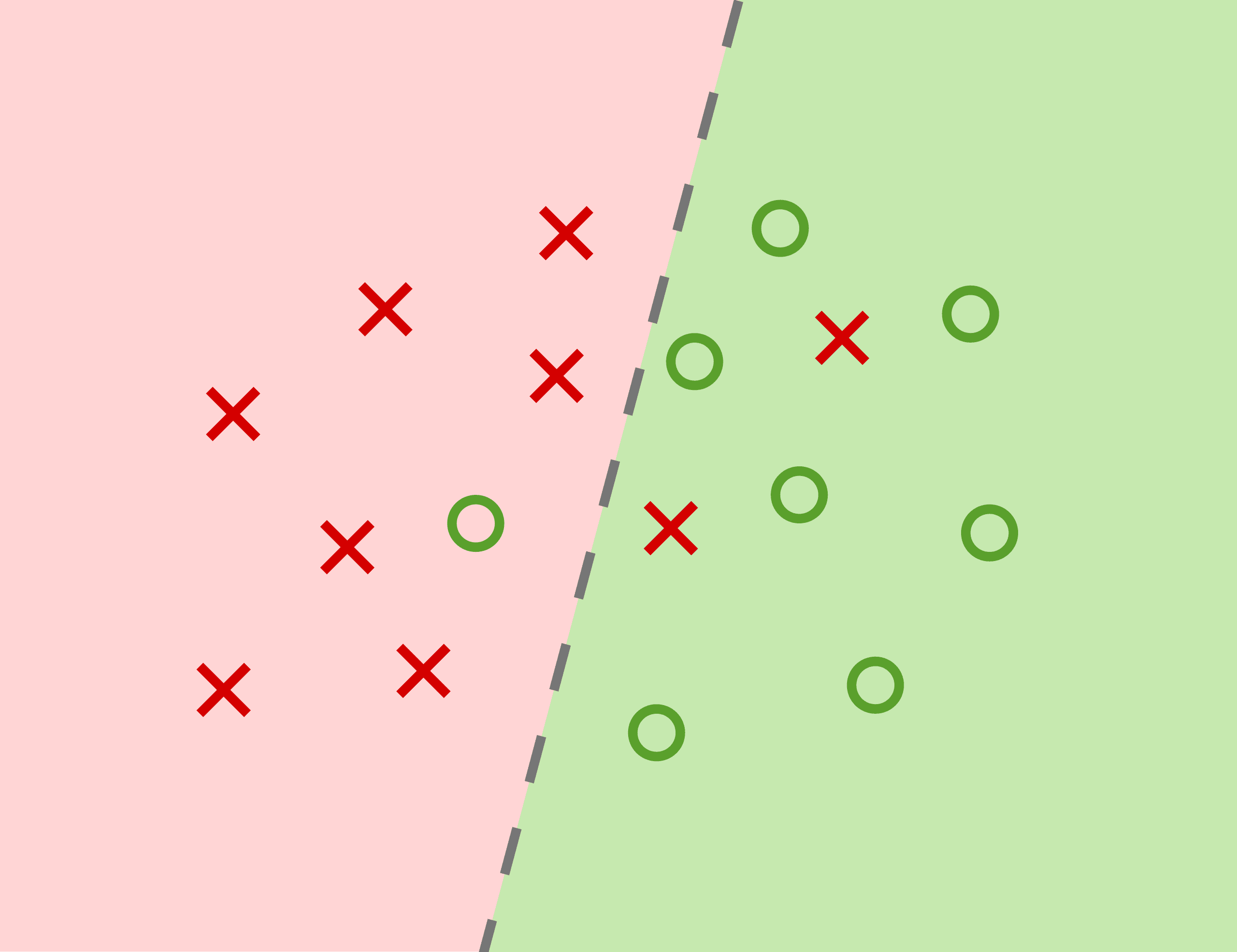

高い偽陽性率(FPR)は教育者にとって重大な懸念事項である。誤った陽性判定に基づいて不正行為の申し立てを行うことは、教師と生徒の関係を損なう恐れがあるため、その申し立てを行うことはリスクを伴う。

しかし、パングラムのFPRが0.01%であることから、高等教育機関での使用に信頼できる検出器である。この点は第三者機関によっても裏付けられており、パングラムが市販されているAI検出器の中で最も正確であると結論づけられている。

AIエッセイチェッカー vs 剽窃チェッカー

AIエッセイチェッカーは、特定のテキストにおけるAIの使用を指摘します。剽窃チェッカーは、テキストにおける外部素材の使用を判定します。

Pangramは、AI生成コンテンツと盗作コンテンツの両方を検出できる商用ツールです。Pangramはテキスト分析時に、これらを別個のケースとして認識します。

人工知能は人間の作品を盗用できるのか?

剽窃チェックツールは、既存のテキストと論文を比較して類似点を検出します。AI論文チェックツールは、現在のAIモデルと類似した言語パターンをテキスト内でスキャンします。

ChatGPTのような大規模言語モデル(LLM)は、膨大なデータセットを用いてテキストを生成し、このデータから盗用することが知られている。ウェストバージニア大学ロースクールのエイミー・B・サイファート准教授による論文では、次のように指摘している:

研究によれば、著作権保護された素材がデータセットに頻繁に含まれるほど、大規模言語モデル(LLM)がその作品からの未変更テキストを含む出力を生成する可能性が高まる。

LLMが訓練セット内のテキストからフレーズを再現する際に暗記が発生する。意図的か否かを問わず、LLMは他者の作品を大規模に再現するよう促される可能性がある。これはプロンプト操作の最終結果が、部分的あるいは完全に剽窃される可能性があることを意味する。

研究者たちが剽窃のより微妙な定義について議論を続ける一方で、大学の学術的誠実性に関する方針では、剽窃とは他者の著作を引用元を明記せずに使用することを指すと規定されている。ミシガン大学は、剽窃には意図的なものと意図しないものがあると指摘している。オックスフォード大学は、無断での逐語的引用、インターネットからのコピペ、言い換え、共謀、援助の未明示など、剽窃のいくつかの形態を詳細に説明している。

では、学術機関においては:

学生がAI生成の作品を提出する場合、人間が書いた盗作作品も同時に提出している可能性がある!

人間はAIが生成した作品を盗用できるのか?

ある基準では、そうかもしれない!

学生がAIによって生成された作品をAIのクレジットを明記せずに提出した場合、学術的不正行為が発生します。サウスフロリダ大学の方針では次のように定めています:

AIチャットボットやその他の生成AIツールはプロンプトに応じて新たなテキストや画像を生成するため、生成AIの素材を使用することは剽窃というよりゴーストライティングに近いと考えられる。

出版倫理委員会は、AIを研究論文の著者とは見なせないことを指摘している。その理由は「AIツールは提出された研究成果に対する責任を負えないため、著作者としての要件を満たせない。非法人格であるため、利益相反の有無を主張できず、著作権やライセンス契約を管理することもできない」からである。

一部の学術機関は、AI生成コンテンツの使用は明らかに剽窃に該当すると考えている:

剽窃とは、他人のアイデア、研究、文章を自分のものとして提示する行為です。剽窃の例には以下が含まれます:引用符や出典明示を用いずに、他人やAIツールの実際の言葉や画像をそのままコピーすること。 -ニューヨーク市立大学

「盗作とは、たとえ意図的でない場合でも、他人のアイデアを自分のものとして表現することです。AIを使ってアイデアを要約したり、自分の作品を執筆したりする場合、それは100%自分の作品とは言えません。」 -オハイオ大学

また他のケースでは、教育関係者が次のようなAI政策の策定責任を背負わされることもある:

個々の授業や課題に対する明確なガイドラインは、学生が達成すべき学習目標に集中することを可能にします。学生は生成AIをいつ、あるいは使用できるかどうかをしばしば確信していないため、ポリシーは特定の授業や課題に合わせて調整された場合に最も効果的です。AIの特定の用途は学生の学習を支援する可能性がありますが、他の用途は学生が自ら取り組むべき重要なプロセスを妨げる可能性があるからです。 -UPenn

「AI利用に関する明確な方針の策定は、学術的誠実性を維持し、学生の期待値を設定するために不可欠である。これらの方針では、ChatGPT、Perplexity.ai、GrammarlyなどのAIツールをいつ、どのように使用できるかを明示し、学生が学術活動におけるAIの倫理的課題を確実に理解できるようにすべきである。」 -NYU

この少数の大学方針の例から、各機関がAIの使用と剽窃をどのように捉えているか、その多様な見解が理解できる。AIはツールであって作者ではないが、AI生成の出力を出典明記なしに提示することは不正行為である。教育者は学生に対して明確な期待値を設定すべきだ。実行可能な授業方針についてさらに学ぶため、クリストファー・オストロ教授はAI不正行為に対処する微妙なアプローチを提示した。

パングラムは、AIの使用および外部コンテンツの利用、特に学術分野において透明性を重視する方針を取っています。当社のモデルにご興味をお持ちの方は、パングラムのAIおよび剽窃検出チェッカーを無料で試してみてください!

デスティニーは、パングラム社のリサーチアナリストインターンです。また、NYCカレッジ・オブ・テクノロジーで応用数学と化学を専攻しています。パングラム社でのデスティニーの仕事は、インターネット上のAIスロープの調査に大きく貢献しています。仕事や学業以外では、創作活動やホラー小説に情熱を注いでいます。

関連記事

AIによる透かし技術:大手テック企業がAIの来歴追跡に注力する理由、そしてその失敗

教師のためのAI検出ツール:学校がAI検出ツールを必要とする理由

Googleは2026年にAI生成コンテンツをペナルティ対象とするのか?

AIヒューマナイザー:「(スロープ)²」問題

AIで最も使い古されたフレーズを歩みながら

AI検出器における偽陽性に関するすべて

の更新情報を購読する