اعرف على الفور ما هو من صنع البشر وما هو من صنع الذكاء الاصطناعي على تويتر ولينكدإن وسوبستاك وغيرها. احصل على ملحق كروم الجديد الخاص بنا.

الكشف عن الذكاء الاصطناعي لفرق التعلم الآلي والبيانات

أداة الكشف عن الذكاء الاصطناعي لمهندسي التعلم الآلي وعلماء البيانات

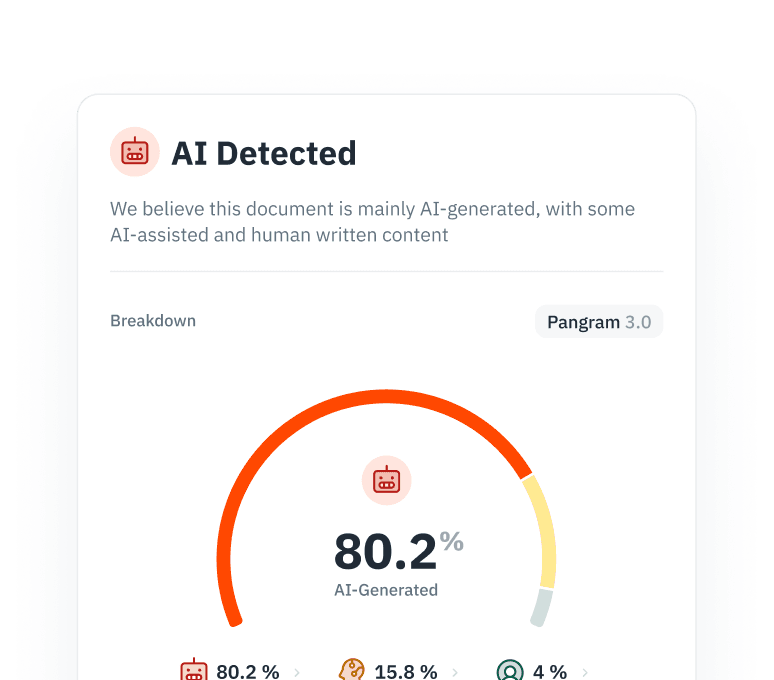

حسّن تدريب النماذج اللغوية الكبيرة (LLM) واختيار البيانات. تجنب انهيار النموذج من خلال تصفية النصوص الاصطناعية من مجموعات بيانات التدريب المسبق أو الضبط الدقيق بدقة تصل إلى 99.98٪ وأداء واجهة برمجة التطبيقات (API) عالي الإنتاجية.

صممه باحثون من Google وTesla وجامعة ستانفورد. تم التحقق من صحته من قبل ICLR وجامعة ماريلاند.

from pangram import Pangram

# Filter synthetic data from corpus

client = Pangram(api_key="your-api-key")

clean_corpus = []

for doc in training_corpus:

result = client.predict(doc.text)

if result['fraction_ai'] < 0.3:

clean_corpus.append(doc)

print(f"Corpus: {len(clean_corpus)} clean docs")العلامات التجارية العالمية

حالات الاستخدام

لا تقم بتدريب نماذجك

باستخدام بيانات غير صحيحة.

النصوص الاصطناعية تلوث قواعد البيانات العامة. قم بتصفية المحتوى الذي تم إنشاؤه بواسطة الذكاء الاصطناعي من مسارات التدريب الخاصة بك باستخدام محرك الكشف الأكثر دقة للحفاظ على نقاء المجموعة النصية.

منع انهيار النموذج

يؤدي التدريب التكراري على المحتوى الذي تولده الذكاء الاصطناعي إلى تدهور أداء النموذج وتقليص التنوع. حدد المحتوى الذي كتبته الذكاء الاصطناعي وقم بتصفيته من مسارات استخراج البيانات لديك لضمان نقاء المجموعة النصية.

التحقق من مدخلات RLHF

تأكد من أن بيانات "التعليقات البشرية" (RLHF) الخاصة بك هي بالفعل من صنع البشر. اكتشف ما إذا كان العاملون في منصات العمل الجماعي يستخدمون ChatGPT لإنشاء ردود لمهام الضبط الدقيق الخاصة بك.

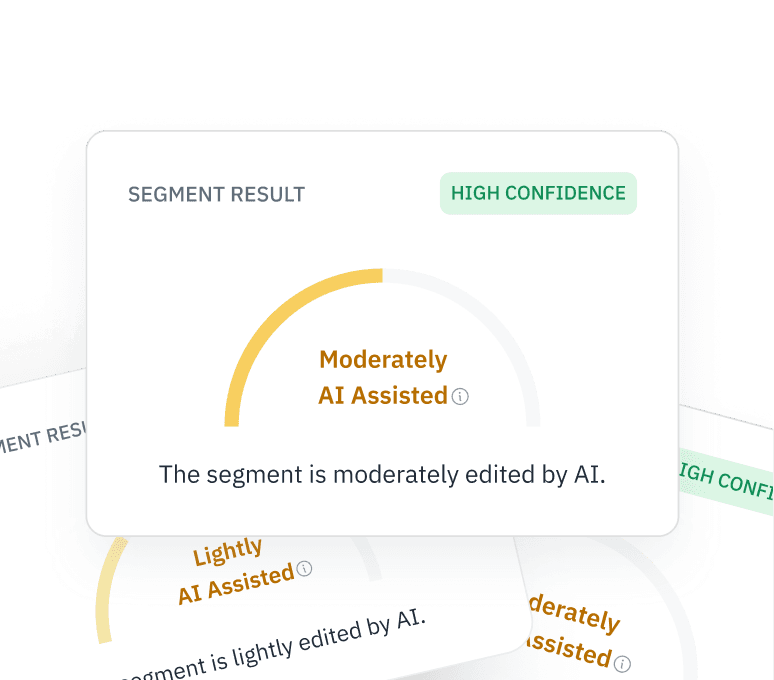

قابلية التفسير على المستوى الجزئي

لا تكتفِ بتصنيف ثنائي. توفر واجهة برمجة التطبيقات (API) المتميزة الخاصة بنا احتمالات على مستوى الرموز، مما يتيح لك الاحتفاظ بالشرائح التي تم تحريرها يدويًا مع تجاهل "النتائج غير الدقيقة" التي تم توليدها آليًا بالكامل.

النهج الفني

نموذج يمكنك الوثوق به

صُمم هذا النموذج للمهندسين الذين يحتاجون إلى الثقة في عمليات تصفية البيانات التي يقومون بها. ويتناول نموذجنا حالات الإيجابيات الكاذبة، والمتانة في مواجهة الهجمات الخبيثة، ومخرجات الذكاء الاصطناعي المتغيرة.

التعدين السلبي الصعب

نقوم بالتدريب على "البيانات السلبية المؤكدة" — أي النصوص البشرية التي تتسم بأسلوب رسمي أو متكرر — لتقليل حالات الإيجابية الكاذبة إلى أدنى حد وضمان عدم استبعاد البيانات البشرية القيمة.

المقاومة في بيئة تنافسية

تتعامل Pangram مع المحتوى الذي تمت إعادة صياغته أو تعديله بواسطة الذكاء الاصطناعي. وقد تم تدريب نماذجنا على التعامل مع "أدوات إضفاء الطابع البشري" والهجمات التنافسية من أجل الكشف عن النصوص الاصطناعية المُشوشة.

التأهب للمستقبل

يكتشف النصوص الصادرة عن أحدث النماذج، بما في ذلك GPT-5 وClaude 3.5 وLlama 3، مما يضمن أن تظل مرشحاتك في صدارة أحدث التقنيات المتاحة حالياً.

التكامل

مصمم خصيصًا لمسار بيانات "

" الخاص بك

01

مجموعة أدوات تطوير البرامج Python

قم بتثبيت pangram-sdk ودمج ميزة الكشف في مسارات Airflow أو Databricks الخاصة بك باستخدام بضع أسطر من التعليمات البرمجية فقط. تم تحسينه لتجميع الاتصالات ومعالجة الأخطاء.

عرض المستندات →

02

واجهة برمجة تطبيقات (API) لـ «

» عالية الإنتاجية

معالجة مجموعات البيانات الضخمة بزمن انتقال منخفض. تدعم بنيتنا التحتية المعالجة المجمعة وتضمن معدل نقل البيانات، حيث تتعامل مع ملايين الطلبات لعمليات استخراج البيانات على مستوى المؤسسات.

الحصول على مفتاح API →

03

الأمن والامتثال لمعايير «

»

حاصلون على شهادة SOC 2 من النوع 2 بالكامل. نقدم نقاط نهاية خاصة وسياسات صارمة للاحتفاظ بالبيانات — ولا نستخدم أبدًا مدخلاتك الخاصة في التدريب.

تعرف على المزيد →

الأسئلة الشائعة

الأسئلة الشائعة حول الكشف عن الذكاء الاصطناعي

أسئلة شائعة حول الكشف عن الذكاء الاصطناعي موجهة لمهندسي التعلم الآلي

وعلماء البيانات.

نعم. يمكنك تثبيت pangram-sdk لدمج ميزة الكشف في مسارات Airflow أو Databricks باستخدام بضع أسطر من التعليمات البرمجية فقط. تم تحسين واجهة برمجة التطبيقات (API) الخاصة بنا لتناسب عمليات استخراج البيانات المؤسسية عالية الإنتاجية، حيث تدعم ملايين الطلبات بزمن انتقال منخفض.

اكتشف المزيد

الكشف عن الذكاء الاصطناعي لـ

لكل مؤسسة

للمطورين

كشف الشفرات البرمجية التي تم إنشاؤها بواسطة الذكاء الاصطناعي للمطورين وفرق الهندسة. اكتشف الشفرات البرمجية التي تم إنشاؤها بواسطة الذكاء الاصطناعي من ChatGPT وCopilot وClaude في لغات Python وJava وC++ وغيرها.

اعرف المزيد →لإدارة المحتوى

الإشراف على المحتوى باستخدام الذكاء الاصطناعي لفرق الثقة والأمان. اكتشاف التقييمات التي تم إنشاؤها بواسطة الذكاء الاصطناعي والتعليقات المزيفة والمحتوى المصطنع على نطاق واسع عبر واجهة برمجة التطبيقات (API).

اعرف المزيد →للجامعات

الكشف عن المحتوى المكتوب بواسطة الذكاء الاصطناعي للجامعات ومؤسسات التعليم العالي. التحقق من واجبات الطلاب، وفحص الأبحاث المقدمة، وحماية سمعة المؤسسة.

اعرف المزيد →نظف بيانات التدريب الخاصة بك اليوم

تجنب انهيار النموذج، وتحقق من مدخلات RLHF، وقم بتصفية المحتوى الاصطناعي من مجموعات البيانات الخاصة بك بدقة تصل إلى 99.98%.

للحصول على آخر المستجدات