Scopri subito cosa è pubblicato da persone e cosa dall'IA su Twitter, LinkedIn, Substack e altre piattaforme. Scarica la nostra nuova estensione per Chrome.

AI Code Detector: come verificare se il codice è stato scritto da ChatGPT, Copilot o Claude

Indice

- Perché è così difficile individuare il codice generato dall'IA? (Il problema dei «gradi di libertà»)

- Caso d'uso 1: Sicurezza del software e governance della proprietà intellettuale

- Caso d'uso 2: Assunzioni nel settore tecnico e valutazioni degli sviluppatori

- Segnali da tenere d’occhio: come individuare manualmente il codice generato dall’IA

- Come funziona il rilevatore di codice AI di Pangram

GitHub, Copilot, ChatGPT e Claude sono assistenti di programmazione basati sull'intelligenza artificiale. Consentono agli sviluppatori di software di produrre codice a un ritmo più sostenuto. Ciò ha rivoluzionato la produttività degli sviluppatori. Detto questo, questa maggiore velocità comporta dei rischi nascosti. Ne risentono la sicurezza della catena di approvvigionamento del software, le questioni relative al diritto d'autore e l'integrità delle assunzioni.

Il sistema MOSS di Stanford è in genere in grado di stabilire se uno script sia stato generato dall'intelligenza artificiale, ma uno sviluppatore esperto può modificare l'ordine delle funzioni e alterare le variabili per eludere il rilevamento. Inoltre, è disponibile solo per uso non commerciale. Per stabilire con certezza se un codice sia stato generato dall'intelligenza artificiale è necessaria un'infrastruttura specializzata. Piattaforme aziendali come Pangram stanno ora entrando in scena per fornire strumenti dedicati al rilevamento del codice generato dall'intelligenza artificiale.

Se vi state chiedendo:«È possibile individuare il codice generato dall'IA?», la risposta è «Sì». Individuare il codice generato dall'IA è fondamentalmente diverso – e più difficile – rispetto all'individuazione di testi generati dall'IA. Questa guida approfondisce i seguenti punti:

- I modelli del codice generato automaticamente.

- Casi d'uso aziendali per il rilevamento.

- Come implementare una strategia di governance "Human-in-the-Loop" per individuare il codice generato dall'intelligenza artificiale.

Rilevamento dei pangrammi tramite IA per sviluppatori

Rilevamento dei pangrammi tramite IA per sviluppatoriPerché è così difficile individuare il codice generato dall'IA? (Il problema dei «gradi di libertà»)

Il codice generato dall'intelligenza artificiale è più difficile da individuare rispetto a quello scritto da un essere umano, poiché i linguaggi di programmazione offrono meno «gradi di libertà». Gli sviluppatori hanno a disposizione un numero minore di scelte stilistiche e strutturali. Ciò è particolarmente vero se si considera la vasta gamma di scelte stilistiche e strutturali a disposizione di un autore.

Linguaggi come il C e l'Assembly hanno requisiti sintattici molto rigidi. Se un essere umano cerca di risolvere un problema, potrebbe sviluppare la funzione più efficiente per quel problema. Anche un'intelligenza artificiale potrebbe sviluppare lo stesso codice, poiché si tratta della funzione più efficiente. Sia un essere umano che un'intelligenza artificiale possono produrre un codice matematicamente identico.

Il codice standard predefinito non contiene molti indizi statistici. Un rilevatore di IA non sarà in grado di classificare con certezza questo tipo di codice come generato dall'IA o scritto da un essere umano. Lo stesso vale anche per i semplici file di configurazione.

Caso d'uso 1: Sicurezza del software e governance della proprietà intellettuale

I direttori tecnici (CTO) e i team delle operazioni legali utilizzano strumenti di rilevamento del codice generato dall'IA per verificare l'origine del proprio codice sorgente. Lo fanno per garantire che i propri sviluppatori non pubblichino proprietà intellettuale generata dall'IA non tutelabile dal diritto d'autore, né logica generata in modo errato o vulnerabile.

Negli Stati Uniti, i contenuti generati interamente dall'intelligenza artificiale non possono essere protetti dal diritto d'autore. Se il prodotto principale di una startup fosse stato generato interamente da Copilot senza alcun controllo umano, tale startup potrebbe non essere in grado di proteggere questo prodotto con il diritto d'autore.

Un rilevatore di codice generato dall'IA rappresenta un primo passo fondamentale nei flussi di lavoro relativi alla sicurezza. Se un frammento di codice viene segnalato come generato al 100% dall'IA, è necessario sottoporlo a una rigorosa revisione manuale dal punto di vista della sicurezza. Tale revisione deve avvenire prima che il codice venga integrato.

Caso d'uso 2: Assunzioni nel settore tecnico e valutazioni degli sviluppatori

I responsabili delle assunzioni utilizzano un rilevatore di codice basato sull'intelligenza artificiale per i compiti tecnici da svolgere a casa. Lo utilizzano per assicurarsi che i candidati comprendano la logica alla base del codice che presentano. I responsabili delle assunzioni non vogliono candidati che si limitino a copiare e incollare i risultati generati da ChatGPT. Vogliono candidati che comprendano la logica alla base di tali risultati.

Uno sviluppatore che si affida interamente a un modello di linguaggio di grandi dimensioni (LLM) per superare un test di programmazione rischia di fallire quando gli viene chiesto di eseguire il debug di sistemi legacy complessi e privi di documentazione. Il codice è complesso. Uno sviluppatore incapace di districarsi in queste complessità senza ChatGPT potrebbe non essere in grado di svolgere il proprio ruolo.

Anziché vietare categoricamente l'uso dell'IA, i reclutatori utilizzano strumenti di rilevamento per formulare domande durante i colloqui. Ecco un esempio: «Vedo che questa funzione si basa in larga misura sull'assistenza dell'IA. Potresti spiegarmi perché il modello ha scelto proprio questa struttura a ciclo?»

Segnali da tenere d’occhio: come individuare manualmente il codice generato dall’IA

Per garantire un'elevata precisione nel rilevamento dell'IA su grandi volumi è necessario ricorrere a un software. Tuttavia, per volumi più ridotti, i revisori manuali possono individuare il codice generato dall'IA prestando attenzione a:

- Stili di commento estremamente specifici.

- Eccesso di documentazione.

- Somiglianza interna estrema.

I modelli di IA, come Claude/ChatGPT, sono addestrati per essere d'aiuto. Di conseguenza, inseriscono commenti esaustivi e innaturali per ogni riga di codice. Gli sviluppatori umani lo fanno raramente, il che rende i commenti di questo tipo un indizio rivelatore dell'IA.

In ambito accademico o di selezione del personale, il codice generato dall'IA spesso appare identico in più contributi. MOSS è in grado di evidenziare questa somiglianza. Ciò consente a MOSS di fungere da indicatore secondario della generazione tramite IA. Anche altri strumenti sono in grado di farlo.

Come funziona il rilevatore di codice AI di Pangram

Per verificare se un codice è stato generato dall'intelligenza artificiale, Pangram ricorre al deep learning. Il deep learning viene utilizzato per identificare l'impronta statistica dei modelli di intelligenza artificiale.

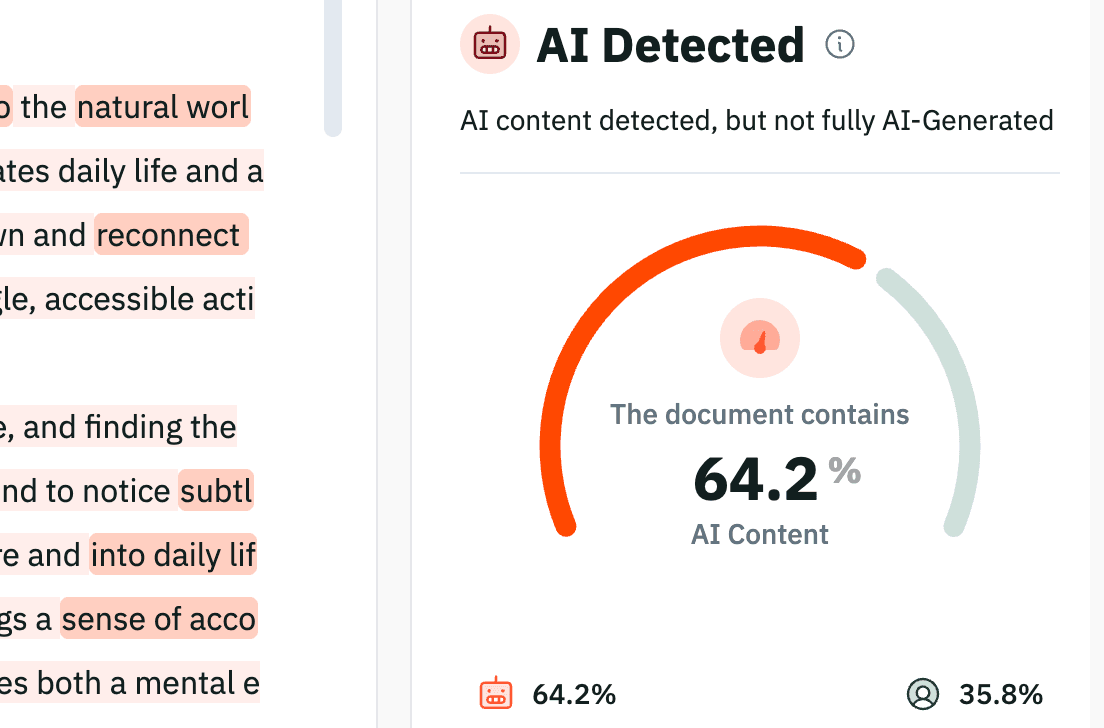

Pangram ha un tasso di accuratezza del 96,2%. Presenta inoltre un tasso di falsi positivi quasi nullo, pari allo 0,3%. Ciò è dovuto in gran parte al deep learning.

L'accuratezza di Pangram nei codici di oltre 40 righe

L'accuratezza di Pangram nei codici di oltre 40 righeA differenza di altri strumenti di rilevamento del codice generato dall'IA, Pangram adotta un approccio volutamente prudente. È progettato per non rilevare alcuni modelli standard generati dall'IA: Pangram presenta un tasso di falsi negativi dell'8,5% sui frammenti di codice più lunghi. Ciò al fine di garantire che non accusi mai ingiustamente uno sviluppatore umano.

I team di sviluppo e reclutamento possono integrare Pangram senza soluzione di continuità nel loro flusso di lavoro aziendale. Possono farlo tramite l'SDK Python di Pangram per il rilevamento del codice tramite IA. In alternativa, possono utilizzare l'API di Pangram. Entrambe queste opzioni consentono il controllo automatico del codice tramite IA all'interno dei flussi di lavoro Git o ATS esistenti.

Verifica dell'integrità del codice

Gli assistenti di programmazione basati sull'intelligenza artificiale sono strumenti potenti che accelerano lo sviluppo di software di ogni tipo. Tuttavia, non ci si può affidare ciecamente a loro per la creazione di infrastrutture proprietarie sicure.

Integrando nel proprio flusso di lavoro un accurato strumento di rilevamento del codice basato sull'intelligenza artificiale, i team di ingegneri e di reclutamento possono:

- Rendere sicura la loro catena di approvvigionamento del software.

- Proteggere la loro proprietà intellettuale.

- Assicurarsi che assumano personale di altissimo livello.

Verifica la provenienza e l'originalità del tuo codice con la piattaforma di rilevamento basata sull'intelligenza artificiale più accurata del settore.

Alex Roitman è responsabile della crescita presso Pangram Labs, un'azienda specializzata nel rilevamento di contenuti generati dall'intelligenza artificiale. Il suo lavoro verte su come i testi generati dall'intelligenza artificiale stiano trasformando la scrittura, l'istruzione e la fiducia nel web aperto.

Altre letture

Quanto è efficace Pangram sul codice AI?

Sì, il rilevamento dell'IA può essere accurato.

Google penalizzerà i contenuti generati dall'intelligenza artificiale nel 2026?

È stata l'intelligenza artificiale a scriverlo? 4 modi per verificare se un testo è stato generato

L'integrità accademica non consiste solo nell'individuare gli studenti che imbrogliano, ma anche nell'insegnare loro ad assumersi la responsabilità dei propri errori.

Gli uffici di ammissione delle università verificano l'uso dell'IA?

per ricevere i nostri aggiornamenti