Índice

- Um panorama marcado por orientações fragmentadas e vagas

- Para onde vamos a partir daqui: princípios fundamentais de uma política ética de IA no jornalismo

- A ameaça do preconceito algorítmico e da «pasta rosa»

- Estudos de caso: Que organizações noticiosas estão a abrir caminho?

- Aplicação: Como as redacções podem garantir o cumprimento dos princípios éticos

Não há setor que não tenha sido afetado pela inteligência artificial.

Todas as profissões, desde médicos e advogados a profissionais de marketing e influenciadores nas redes sociais, foram afetadas por conteúdos gerados por IA. Mas e os jornalistas? A profissão depende da confiança dos leitores; no entanto, estudos recentes revelaram um boom no uso não regulamentado da IA no setor, com artigos gerados por IA a chegarem até às páginas de jornais de grande tiragem e credibilidade. Enquanto outros setores reavaliam os seus valores éticos para determinar o uso adequado da IA, o jornalismo precisa de fazer o mesmo. As ferramentas de IA podem automatizar tarefas repetitivas e apoiar a narrativa baseada em dados, mas a tecnologia falha devido a preconceitos e alucinações. A falta de uma norma juridicamente vinculativa e aplicável a todo o setor para o uso adequado da IA deixa as redacções a navegar sozinhas por estas águas inexploradas. Abaixo, exploraremos os quadros actuais para avaliar o uso ético da IA na redacção, analisaremos as lacunas e proporemos uma abordagem ética consolidada centrada na transparência e na supervisão humana.

Um panorama marcado por orientações fragmentadas e vagas

À medida que a tecnologia de IA avança a passos largos, a governança ética fica para trás. No entanto, várias organizações globais de renome assumiram a liderança nos esforços para colmatar esse atraso. Estas organizações procuram ajudar as redacções a recuperar o controlo editorial e a confiança dos leitores, embora continuem a debater-se com a complexidade dos dilemas que os editores, os responsáveis editoriais e os seus redatores enfrentam nos dias de hoje.

A Organização das Nações Unidas para a Educação, a Ciência e a Cultura (UNESCO) adotou recomendações sobre a ética da IA em 2021, centradas na supervisão humana. A secção que descreve as recomendações para o setor da comunicação e da informação fornece algumas orientações para os jornalistas. A política determina que os sistemas de IA devem promover a liberdade de informação, a liberdade de expressão, a transparência e a divulgação de dados oficiais. Incentiva todos os profissionais do setor dos meios de comunicação social a incorporarem a IA no seu trabalho de forma ética. O quadro solicita também aos países que promovam ambientes transparentes e educativos, onde os meios de comunicação social possam reportar os malefícios e benefícios da IA, e os consumidores possam desenvolver competências de literacia digital e mediática para combater a desinformação e o discurso de ódio.

No entanto, o quadro relativo aos meios de comunicação social ocupa apenas quatro parágrafos das 44 páginas que descrevem as políticas éticas da UNESCO em matéria de IA. Quase não há referências específicas ao jornalismo e aos jornalistas, e a política funciona mais como uma declaração de valores e um apelo geral à elaboração de políticas mais abrangentes no futuro. Não é muito em que os meios de comunicação social se possam basear.

O Instituto de Engenheiros Elétricos e Eletrónicos (IEEE) adotou uma abordagem semelhante. O seu quadro de «Design Alinhado com a Ética» reforça a liberdade dos jornalistas para informar o público sobre questões relacionadas com a inteligência artificial e a importância do julgamento e da supervisão humanos. No entanto, a política é mais uma declaração de ideais e valores do que um guia detalhado para lidar com os dilemas da IA numa redação. Como devem os meios de comunicação social lidar com a divulgação da utilização da IA? Ou lidar com utilizações inadequadas? O que define um uso inadequado? Toda esta incerteza perturba as redacções e deixa a confiança do público num limbo, mas uma política robusta pode fornecer um mapa para este terreno inexplorado.

Para onde vamos a partir daqui: princípios fundamentais de uma política ética de IA no jornalismo

Os editores, redatores e jornalistas necessitam urgentemente de orientações concretas, exaustivas e eticamente sólidas para regulamentar, informar e justificar adequadamente os casos de utilização da IA nas redacções. Ao elaborarem uma política de IA rigorosa e fundamentada, as redacções devem basear as suas orientações em quatro princípios inegociáveis: transparência, responsabilização, inclusão e equidade.

Segue-se um ponto de partida para aplicar estes princípios à utilização da IA na redacção:

- A transparência significa que a utilização da IA é divulgada aos leitores de forma clara, honesta e evidente. Quer os jornalistas utilizem a IA para gerar pistas, realizar pesquisas ou criar elementos visuais, o seu público merece sempre saber.

- A responsabilização implica atribuir a responsabilidade por erros em conteúdos e investigações gerados por IA. As redacções devem definir claramente quem é o responsável quando a utilização da IA corre mal – será o criador do programa de IA? O jornalista? O próprio algoritmo? Uma responsabilização adequada implica admitir os erros e penalizar a parte culpada. Cabe, portanto, às redacções decidir quem é o responsável e como a situação deve ser tratada.

- A inclusão significa promover a sensibilização para os preconceitos das ferramentas de IA e mitigá-los. Os dados de treino dos algoritmos de IA ajudam a definir o resultado do algoritmo, o que significa que as ferramentas de IA correm o risco de amplificar os preconceitos da sociedade em que foram criadas. Este aspeto deve ser sempre tido em conta na utilização da IA nas redacções, e as políticas devem prever estratégias para investigar e minimizar esses preconceitos.

- A equidade implica a aplicação justa desta política. As equipas da redacção devem cumprir rigorosamente a política estabelecida e implementar atualizações sempre que necessário. A aplicação deve ser generalizada, e qualquer desvio da política não deve ficar sem consequências, devendo as violações ser claramente comunicadas ao público.

A ameaça do preconceito algorítmico e da «pasta rosa»

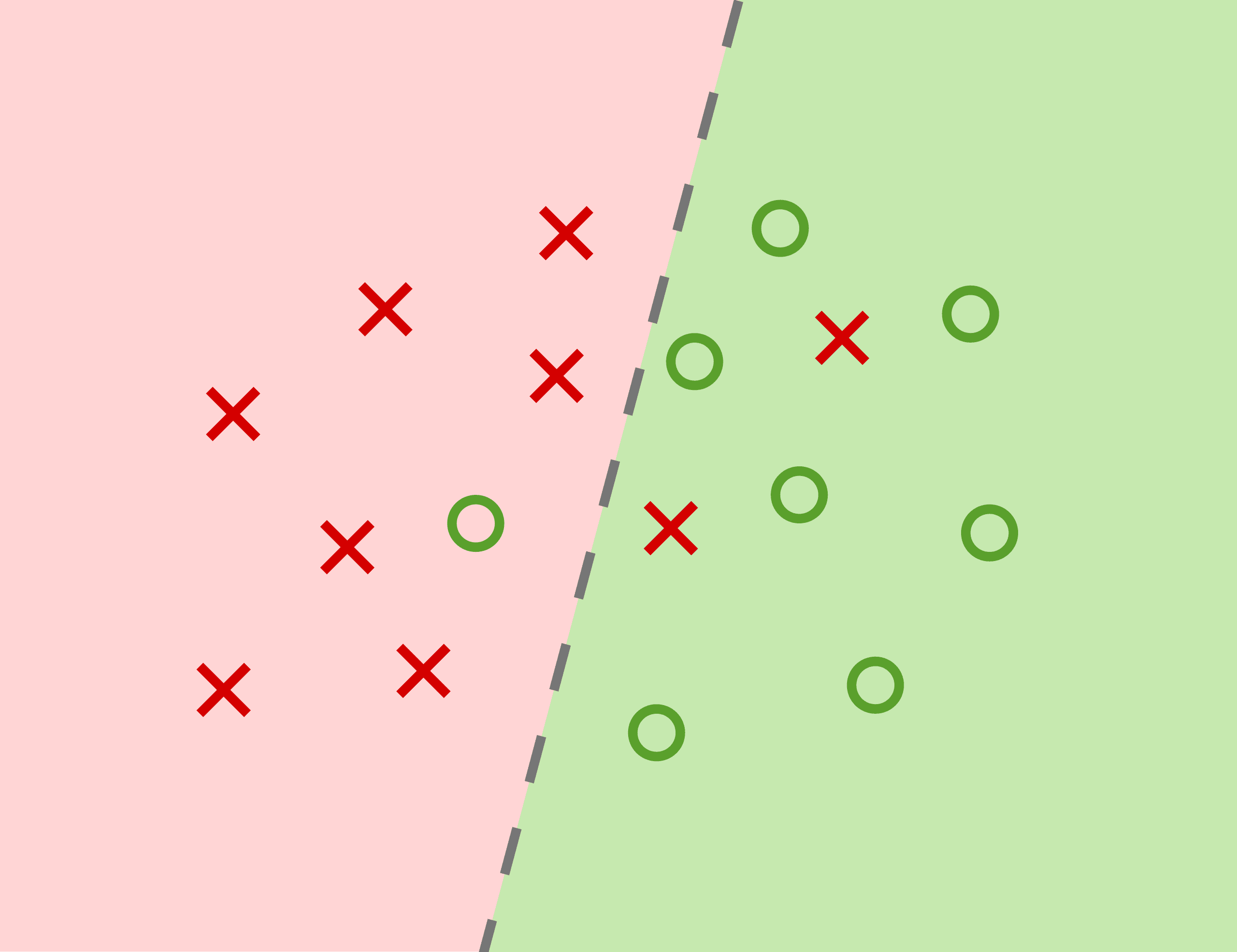

Os modelos de IA implementados sem salvaguardas éticas correm o risco de reforçar as desigualdades sociais e os estereótipos sobre grupos marginalizados, ao mesmo tempo que reforçam as crenças pré-existentes dos utilizadores e aprofundam a polarização. A UNESCO, na sua investigação sobre os estereótipos gerados pela IA, constatou que os grandes modelos linguísticos atribuíam tarefas domésticas às mulheres com uma frequência muito superior à dos homens, ao mesmo tempo que produziam conteúdos negativos sobre indivíduos homossexuais e determinados grupos étnicos. Investigadores da Universidade de Stanford descobriram que os modelos de IA perpetuavam estereótipos racistas extremos ligados à era pré-Direitos Civis, após terem sido solicitados a descrever pessoas que falavam inglês afro-americano. O risco de perpetuar preconceitos através da utilização de sistemas de IA inevitavelmente imperfeitos pode infiltrar-se na tradução, na análise de dados, na geração de ideias para reportagens e noutros trabalhos que as redacções delegam a estas ferramentas. Além disso, os sistemas de recomendação de IA concebidos para fornecer conteúdos personalizados, incluindo notícias, podem continuar a mostrar aos leitores conteúdos com os quais concordam, reforçando as suas noções preconcebidas sobre o mundo e isolando-os de pontos de vista alternativos ou de informações que alarguem a sua perspetiva.

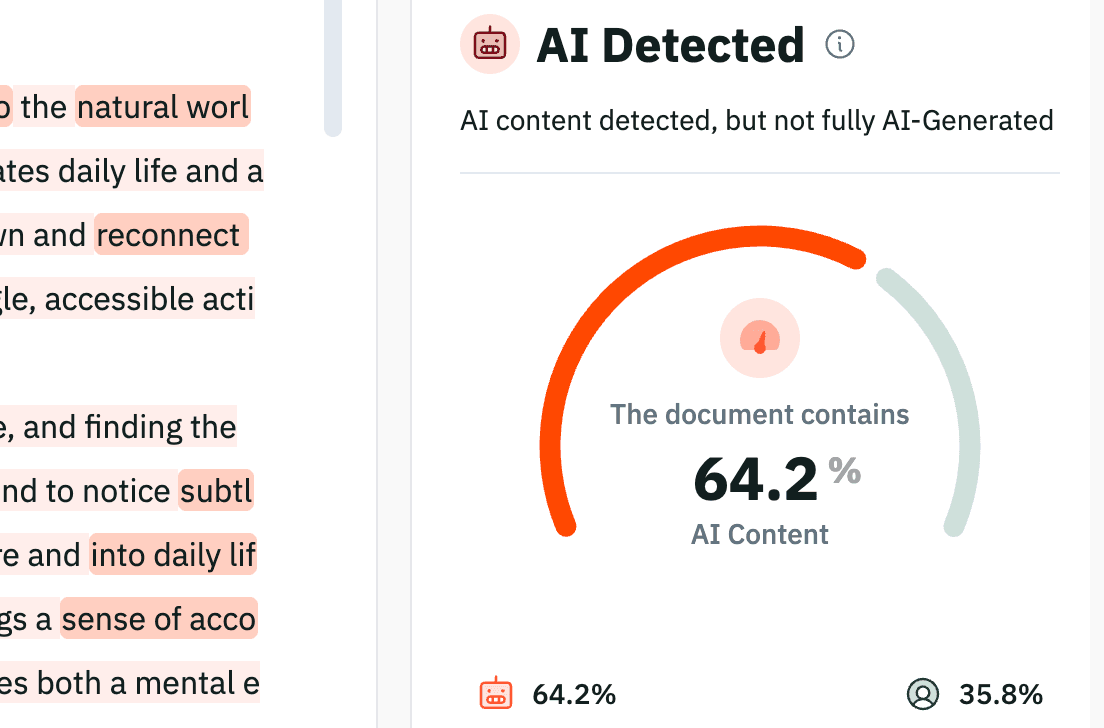

A infinidade de conteúdos gerados por IA na Internet também pode confundir os leitores e comprometer a sua confiança nos meios de comunicação tradicionais. Uma investigação da empresa de deteção de IA Pangram revelou que são publicados diariamente 60 000 artigos noticiosos gerados por IA, sobretudo nas áreas da tecnologia, beleza e negócios. Sites de notícias de baixa qualidade e agentes mal-intencionados utilizam a IA para produzir constantemente grandes quantidades de conteúdo de baixa qualidade (conhecido como «pink slime») a um custo quase nulo, com o objetivo de gerar receitas publicitárias. Estas «fábricas de conteúdo» obscurecem o panorama noticioso e tornam ainda mais essencial que os sites de notícias fiáveis e profissionais criem políticas sólidas em matéria de IA, que divulguem aos seus leitores.

Estudos de caso: Que organizações noticiosas estão a abrir caminho?

Organizações noticiosas de renome, como o The New York Times, a BBC e a ProPublica, estão a conseguir equilibrar a inovação com a ética, mantendo a supervisão humana na vanguarda das suas políticas, retirando o controlo aos algoritmos e devolvendo-o a editores de confiança. A BBC – por exemplo – exige que os seus colaboradores deixem claro o uso da IA na criação, apresentação e distribuição dos seus conteúdos. As suas diretrizes também promovem a consideração e o monitoramento de preconceitos inerentes, alucinações e plágio nos resultados das ferramentas de IA. Todos os colaboradores e freelancers devem submeter uma proposta para o uso da IA a um responsável editorial sénior para aprovação. As diretrizes da BBC também descrevem casos de utilização adequada da IA, incluindo a demonstração dos resultados da IA em notícias sobre o assunto ou a alteração das vozes de fontes que desejam permanecer anónimas. A ProPublica utiliza explicitamente a IA para analisar grandes bases de dados em investigações cruciais e identificar padrões para expor preconceitos noutros sistemas. O New York Times deixou clara a sua utilização da IA para auxiliar na criação de títulos e resumos, na geração de versões áudio de artigos e na análise de dados.

Aplicação: Como as redacções podem garantir o cumprimento dos princípios éticos

Para estabelecer diretrizes adequadas e exaustivas em matéria de IA, compatíveis com o Código de Ética da Sociedade de Jornalistas Profissionais, as redacções devem criar equipas multidisciplinares que reúnam conhecimentos especializados tanto na área tecnológica como na ética, de modo a cobrir todos os aspetos deste novo mundo marcado pela IA. A supervisão humana deve continuar a estar no centro da utilização da IA. Os resultados da IA utilizados em reportagens devem ser continuamente verificados quanto à sua exatidão.

A IA deve ser um complemento às capacidades humanas, não um substituto para um jornalismo bem documentado e fiável. Para aplicar as políticas e garantir o cumprimento das normas, as redacções devem utilizar ferramentas de verificação, como o Pangram, para detectar casos não divulgados e inadequados de conteúdos gerados por IA. Embora as ferramentas de IA ofereçam uma eficiência aliciante, não respeitam a mesma credibilidade e os mesmos ideais éticos que as boas redacções. Ao adoptarem um quadro baseado na transparência e na responsabilização, as redacções podem tirar partido das ferramentas de IA sem comprometer a função democrática da imprensa.

Garanta que a sua publicação cumpre os mais elevados padrões de integridade na era atual da IA. Verifique hoje mesmo a autenticidade do seu conteúdo.

Leitura relacionada

Sim, a deteção por IA pode ser precisa

A detecção por IA consegue identificar o estilo de escrita do Claude?

Tudo sobre os falsos positivos nos detetores de IA

Marcação de água com IA: Por que é que as grandes empresas tecnológicas estão a apostar na proveniência com IA — e a sair a perder

Verificador de cartas de apresentação com IA - Como as equipas de RH estão a filtrar o ruído

Um passeio pelas expressões mais usadas na IA

para receber as nossas atualizações