Saiba imediatamente o que é publicado por pessoas e o que é gerado por IA no Twitter, LinkedIn, Substack e outras plataformas. Obtenha a nossa nova extensão para o Chrome.

Índice

- As faculdades de Direito utilizam detetores de IA nas redações de admissão?

- Utilizam-se detectores de IA nos trabalhos da faculdade de Direito?

- O problema da «linguagem jurídica»: será que vou obter um falso positivo?

- Orientar-se nas políticas de IA no ensino do Direito

- Melhores práticas para proteger o seu histórico académico

Frequentar a faculdade de Direito implica muita leitura e muita escrita. Recorrer a ferramentas de IA generativa, como o ChatGPT, é muito tentador, especialmente porque estas podem redigir cartas de apresentação, resumos de processos e notas de pesquisa.

Este guia aborda a forma como as políticas das diferentes faculdades de Direito estão a evoluir e explica por que razão deve ter muito cuidado com a forma como a IA é integrada na sua formação jurídica.

As faculdades de Direito utilizam detetores de IA nas redações de admissão?

A resposta a esta pergunta é «Sim». Muitos serviços de admissão de faculdades de Direito, consultores independentes especializados em preparação para o curso de Direito e escritórios de advogados utilizam ativamente software de deteção por IA para garantir que as cartas de apresentação e os ensaios sobre diversidade que compõem uma candidatura são, de facto, da autoria do candidato em questão.

As faculdades de Direito pretendem admitir candidatos com perspetivas únicas e vozes autênticas, bem como com a determinação intelectual necessária para ter sucesso nos seus cursos. Uma redação gerada pelo ChatGPT é, por natureza, genérica e acaba por contrariar o objetivo de uma carta de apresentação.

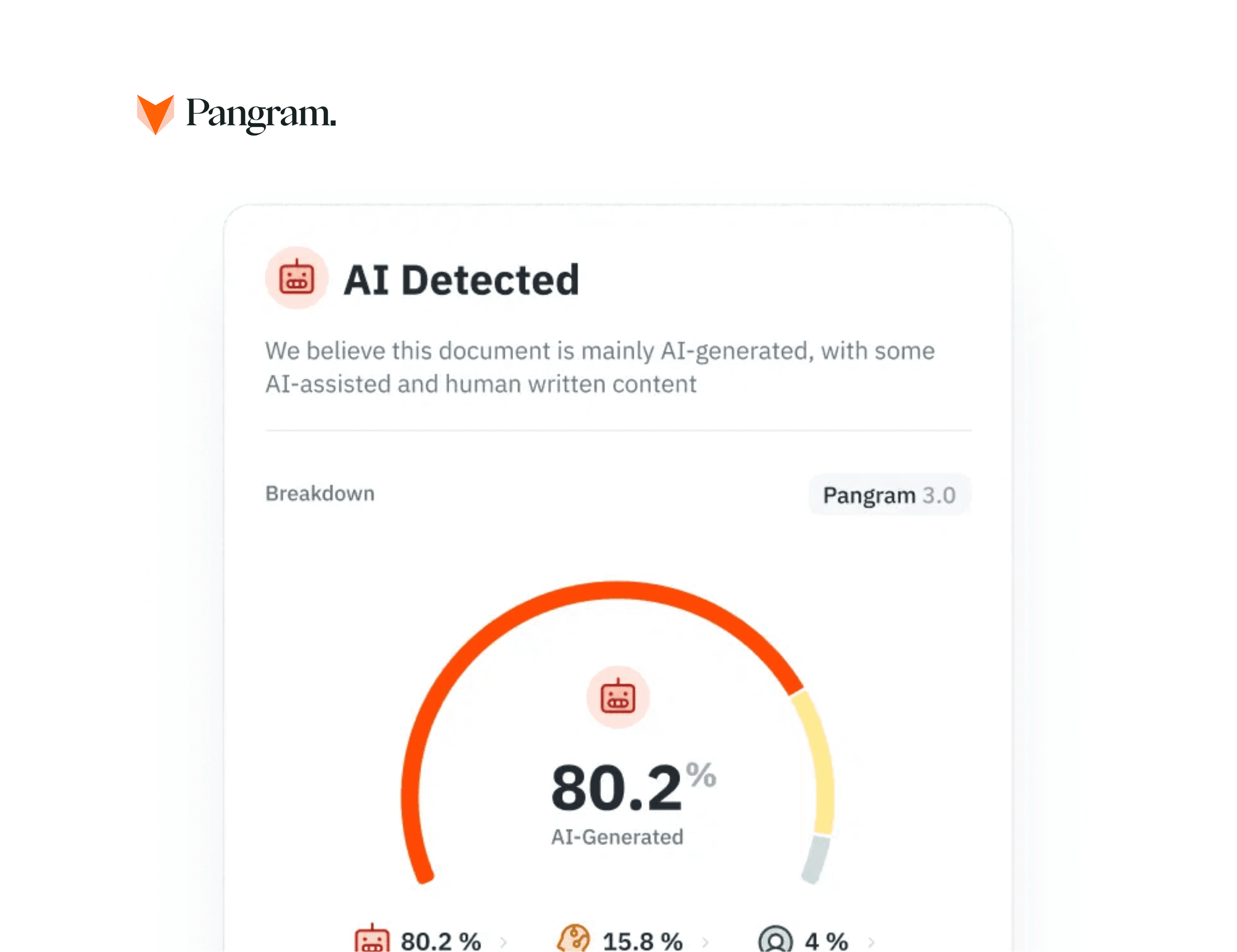

Os processos de admissão nas faculdades de Direito recorrem à deteção de IA logo no início do processo. Consultores de admissão de renome — como a Gradpilot, por exemplo — integram ferramentas como o Pangram diretamente no seu processo de análise. Desta forma, conseguem identificar a dependência excessiva de um candidato em relação à IA antes mesmo de a redação ser efetivamente enviada para a LSAC.

Utilizam-se detectores de IA nos trabalhos da faculdade de Direito?

Sim, os gabinetes de integridade académica e os professores de Direito utilizam detectores de IA de nível empresarial integrados nos seus Sistemas de Gestão da Aprendizagem para verificar todos os tipos de trabalhos da faculdade de Direito. Entre os trabalhos que verificam contam-se trabalhos de redação jurídica, memorandos de investigação e exames para fazer em casa.

Em qualquer tipo de texto jurídico, a precisão e a autenticidade são requisitos essenciais. A utilização de modelos de linguagem de grande escala (LLMs), como o ChatGPT, é problemática, pois estes tendem a inventar jurisprudência, citações e «factos» jurídicos. Por isso, recorrer à IA para trabalhos jurídicos não implica apenas o risco de ser acusado de plágio; implica também o risco de sofrer sanções académicas graves por inventar precedentes jurídicos.

Os professores utilizam as pontuações da IA como ferramenta de diagnóstico. Combinam o diagnóstico de um detector de IA para faculdades de Direito com o seu próprio conhecimento das capacidades de redação anteriores de um aluno para investigar casos de desonestidade académica. Esta abordagem multifacetada, quando aplicada, facilita a deteção do uso de IA.

O problema da «linguagem jurídica»: será que vou obter um falso positivo?

Os detectores de IA padrão e gratuitos são conhecidos por identificar erroneamente textos altamente formais e estruturados — como memorandos jurídicos, por exemplo — como sendo gerados por IA. No entanto, isso não acontece com as ferramentas empresariais que as universidades utilizam para verificar se os documentos jurídicos foram gerados por IA; estas ferramentas são treinadas para evitar essa falha e fornecer avaliações precisas sobre a IA.

A perplexidade é o que os detectores de IA padrão e gratuitos procuram. A perplexidade é uma medida da surpresa estatística, o que significa que os detectores de IA básicos procuram previsibilidade e um elevado nível de estrutura para detetar a utilização de IA.

Documentos como a «Declaração de Independência» são altamente estruturados e previsíveis, razão pela qual muitos detectores básicos de IA os identificam como sendo de IA. As ferramentas utilizadas pelas universidades, no entanto, são muito mais precisas nas suas avaliações.

Se és um estudante que escreve os teus próprios trabalhos e utiliza a IA apenas das formas permitidas, não tens nada com que te preocupar. Ferramentas universitárias premium, como o Pangram, utilizam a técnica de «Hard Negative Mining» para distinguir a sintaxe formal e legítima do texto gerado por IA. Isto resulta numa taxa de falsos positivos quase nula, de 1 em 10 000.

Orientar-se nas políticas de IA no ensino do Direito

Cada faculdade de Direito tem as suas próprias políticas em matéria de IA. Alguns professores são rigorosos: a IA é totalmente proibida. Outros professores mostram-se muito mais abertos à tecnologia e integram a IA nos seus programas de estudos para ensinar os futuros advogados a utilizar a tecnologia jurídica de forma responsável.

Atualmente, a profissão jurídica está a adotar a IA generativa para tarefas rotineiras. Algumas dessas tarefas incluem a revisão de documentos e a análise de contratos. Por esse motivo, alguns professores permitem o uso da IA para sessões de brainstorming ou para esboçar rascunhos — mas, na maioria dos casos, apenas se for apresentada uma declaração de atribuição relativa à IA utilizada.

Se o programa de estudos de uma determinada faculdade de Direito ou de um determinado professor de Direito não indicar explicitamente que a utilização de um LLM é permitida num trabalho, deve partir do princípio de que a utilização de um LLM é estritamente proibida. Caso exista uma política da faculdade de Direito relativa ao ChatGPT ou um conjunto de diretrizes sobre a utilização de LLMs, deve respeitar essa política ou essas diretrizes.

A apresentação de qualquer tipo de texto gerado por IA sem a devida indicação é amplamente considerada fraude académica. Poderá enfrentar consequências graves — sendo a expulsão uma das mais notáveis — caso seja considerado culpado de fraude académica.

Melhores práticas para proteger o seu histórico académico

Os estudantes de Direito e os candidatos devem seguir estas boas práticas para proteger o seu historial académico: elaborem sempre trabalhos originais, mantenham um registo do histórico de versões, guardem esse registo após o envio de um trabalho e verifiquem previamente os vossos documentos para ver se utilizaram IA para pequenas correções gramaticais, brainstorming ou qualquer outra finalidade.

Além de adotar essas boas práticas, deve verificar o seu trabalho à procura de expressões típicas da IA. As palavras «delve», «tapestry» e «pivotal» são algumas das expressões mais comuns da IA. Usar estas palavras em excesso pode levantar suspeitas e levar alguém a pensar que utilizou IA.

Se utilizar qualquer tipo de ferramenta de IA para a verificação ortográfica, um verificador de IA avançado para redação jurídica, como o Pangram, consegue distinguir entre verificações gramaticais «ligeiramente assistidas por IA» e textos «totalmente gerados por IA». Ser capaz de distinguir estes aspetos pode ajudar a provar que foi o autor dos argumentos centrais de um determinado documento.

As faculdades de Direito estão a acompanhar de perto a utilização da IA para proteger a integridade da profissão jurídica e das pessoas que nela atuam.

Embora a IA seja uma ferramenta poderosa para a síntese, não pode substituir o raciocínio jurídico rigoroso e o pensamento crítico necessários para obter um diploma de Direito.

Certifique-se de que a sua carta de apresentação ou memorando jurídico é inteiramente da sua autoria. Verifique a autenticidade do texto antes de o enviar.

Leitura relacionada

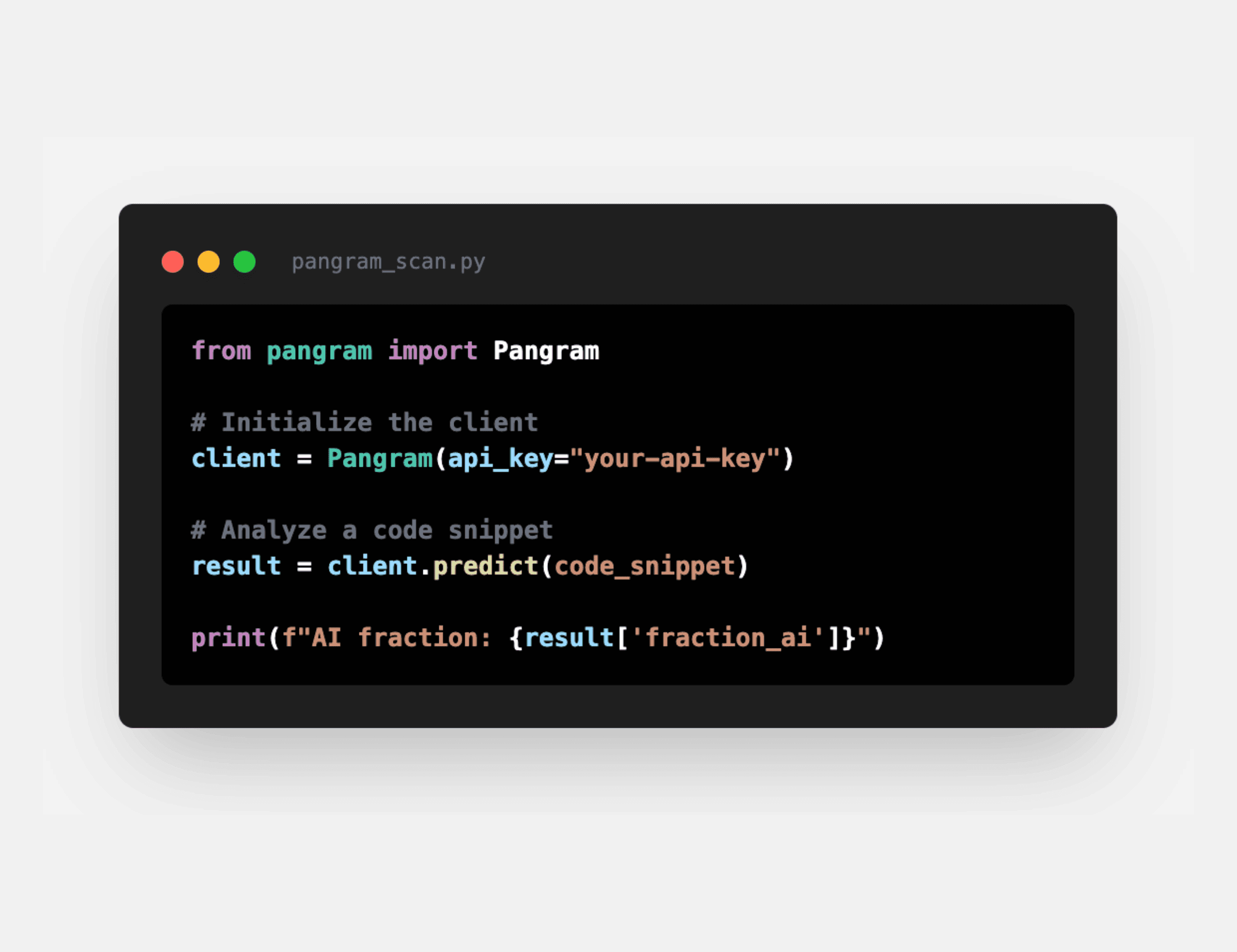

O Pangram funciona bem em código de IA?

O que significa a sua pontuação de deteção de IA?

Detetor de Código de IA: Como verificar se o código foi escrito pelo ChatGPT, Copilot ou Claude

Foi a IA que escreveu isto? 4 formas de verificar se o texto foi gerado

Uma abordagem mosaica à integridade académica na era da IA (com Chris Ostro)

Apresentando a deteção de plágio da Pangram

para receber as nossas atualizações