Saiba imediatamente o que é publicado por pessoas e o que é gerado por IA no Twitter, LinkedIn, Substack e outras plataformas. Obtenha a nossa nova extensão para o Chrome.

Índice

- 🤗 Modelos e conjuntos de dados

- Código-fonte

- Por que estamos a lançar uma versão aberta do Pangram?

- EditLens e deteção assistida por IA

- Conjuntos de dados

- Modelos

- Avaliações

- Conjunto de testes no domínio

- Resultados da classificação binária

- Resultados da classificação ternária

- Domínio retido (e-mails da Enron)

- Resultados da classificação binária

- Resultados da classificação ternária

- Modelo apresentado (Llama 3.3 70B Instruct)

- Resultados da classificação binária

- Resultados da classificação ternária

- Testes de desempenho realizados por terceiros

- Inglês não nativo (Liang et al., 2023)

- Detectores de Pessoas (Russell et al., 2024)

- RAID, amostra aleatória de 10 000 (Dugan et al., 2024)

- Conjunto de dados do Grammarly

- Para que serve o Open Pangram?

- Para que é que o Open Pangram NÃO deve ser utilizado?

🤗 Modelos e conjuntos de dados

Código-fonte

É com orgulho e entusiasmo que partilhamos duas versões do Pangram baseadas na tecnologia EditLens que propusemos no nosso artigo apresentado na ICLR de 2026. Disponíveis para uso não comercial ao abrigo da licença CC BY-NC-SA 4.0, estes dois modelos leves podem ser executados num MacBook.

Por que estamos a lançar uma versão aberta do Pangram?

Sempre nos empenhámos no avanço da deteção de IA e queremos permitir que outros investigadores avancem nesta área. Já contribuímos anteriormente para a comunidade através da publicação do nosso artigo sobre o EditLens, que apresenta novas formas de analisar e classificar conteúdos gerados por IA, da realização de análises em grande escala de revisões por pares e de jornais americanos, e da oferta de bolsas de API a investigadores. Ao disponibilizar os pontos de verificação do modelo EditLens, o conjunto de dados de treino e o código-fonte, esperamos que os investigadores possam continuar a desenvolver o nosso trabalho.

EditLens e deteção assistida por IA

A deteção de IA deve evoluir à medida que a utilização da IA generativa evolui. Um estudo recente da OpenAI revelou que dois terços de todos os pedidos relacionados com escrita dirigidos ao ChatGPT envolvem a modificação de texto fornecido pelo utilizador, em vez da sua geração a partir do zero. À luz deste paradigma emergente de coautoria de texto entre humanos e IA, desenvolvemos uma nova estrutura de deteção que considera o grau de contribuição da IA para um texto. Os utilizadores do Pangram podem ter notado que o nosso modelo apresenta resultados como «Ligeiramente assistido por IA» ou «Moderadamente assistido por IA». Estas classificações são possíveis graças à tecnologia apresentada no nosso artigo de investigação da ICLR 2026,“EditLens: Quantifying the Extent of AI Editing in Text”, que introduz um modelo de deteção de IA que devolve uma pontuação de 0 a 1, sendo que 0 indica texto totalmente escrito por humanos e 1 indica texto totalmente gerado por IA. Com o lançamento do nosso conjunto de dados e código-fonte, qualquer pessoa pode agora treinar o seu próprio modelo EditLens.

Conjuntos de dados

Estamos a disponibilizar o conjunto de dados EditLens, composto por 60 mil exemplos de treino, 2,4 mil de validação e 6 mil de teste. Cada subconjunto é constituído por textos totalmente escritos por humanos, totalmente gerados por IA e editados por IA, provenientes de quatro domínios. Os textos editados por IA foram gerados através da aplicação de um prompt de edição a um texto original escrito por humanos proveniente de um dos 5 domínios: notícias (Narayan et al., 2018 e See et al., 2017), escrita criativa (Fan et al., 2018), críticas da Amazon (Zhang et al., 2015), críticas do Google (Li et al., 2022) e conteúdo web relacionado com a educação (Lozhkov et al., 2024).

Os modelos utilizados para gerar os textos criados e editados por IA foram os da OpenAI gpt-4.1-2025-04-14 , da Anthropic claude-sonnet-4-20250514 , e do Googlegemini-2.5-flash.

O conjunto de dados EditLens inclui também duas divisões de avaliação fora do domínio: 6 mil exemplos de um domínio de texto de origem não utilizado (e-mails) e uma versão da divisão de teste gerada pela Meta Llama-3.3-70B-Instruct-Turbo .

Além disso, estamos a disponibilizar um conjunto de dados que recolhemos, composto por cerca de 1,8 mil textos editados com o Grammarly. Este conjunto de dados consiste em 9 edições diferentes de 200 textos originais escritos por humanos. Cada uma das edições (por exemplo, «Simplifique isto») é uma sugestão de edição do processador de texto integrado no Grammarly. Os 200 textos originais escritos por humanos foram selecionados a partir de um dos conjuntos de dados Persuade 2.0 (Crossley et al., 2024), ELLIPSE (Crossley et al., 2023), BAWE (Nesi et al., 2004), ICNALE (Ishikawa et al., 2007), CLASSE (Crossley et al., 2024) ou PIILO (Holmes et al., 2023).

Pode explorar ambos os conjuntos de dados no HuggingFace.

Modelos

pangram/editlens_Llama-3.2-3B foi ajustado utilizando o QLoRA com um comprimento máximo de sequência de 1024 tokens. O modelo base tem 3 mil milhões de parâmetros.

pangram/editlens_roberta-large, um modelo com 355 milhões de parâmetros, foi ajustado com um comprimento máximo de sequência de 512 tokens.

Ambos os modelos foram treinados durante 1 época, de acordo com o método descrito no artigo sobre o EditLens. Os hiperparâmetros adicionais e o código de treino para ambos os modelos podem ser encontrados no repositório GitHub do EditLens. Pode descarregar os checkpoints dos modelos a partir do HuggingFace.

Avaliações

Tanto para a classificação binária como para a ternária, determinamos os limiares através da calibração no conjunto de validação retido.

Nas avaliações binárias, determinamos o limiar que maximiza o F1-score para distinguir textos inteiramente escritos por humanos dos textos inteiramente gerados por IA. Não há textos editados por IA nas avaliações binárias.

Para as avaliações ternárias, determinamos dois limiares. Primeiro, separamos os dados de avaliação em três categorias: humano, IA e editado por IA. Em seguida, determinamos um limiar inferior que separa a classe «humano» da união dos dados [IA, editado por IA] e um limiar superior que separa a classe «IA» da união dos dados [humano, editado por IA]. Ambos os limiares são determinados através da maximização do índice F1.

Conjunto de testes no domínio

Resultados da classificação binária

2 038 textos escritos por humanos e 2 046 textos gerados por IA

| Detetor | Macro F1 | FPR | FNR |

|---|---|---|---|

| Pangram 3.2 (Modelo de produção atual) | 1.000 | 0.000 | 0.000 |

| Pangram OSS: editlens_Llama-3.2-3B | 1.000 | 0.000 | 0.000 |

| Pangram OSS: editlens_roberta-large | 0.997 | 0.002 | 0.003 |

| Fast-DetectGPT | 0.895 | 0.121 | 0.088 |

| Binóculos | 0.886 | 0.128 | 0.101 |

Resultados da classificação ternária

2 038 textos escritos por humanos, 2 046 textos gerados por IA e 2 031 textos editados por IA

| Detetor | Precisão | Macro F1 | F1 humana | AI F1 | F1 editada por IA |

|---|---|---|---|---|---|

| Pangram 3.2 (Modelo de produção atual) | 0.920 | 0.920 | 0.926 | 0.957 | 0.876 |

| Pangram OSS: editlens_Llama-3.2-3B | 0.895 | 0.895 | 0.895 | 0.948 | 0.842 |

| Pangram OSS: editlens_roberta-large | 0.881 | 0.881 | 0.900 | 0.923 | 0.819 |

| Fast-DetectGPT | 0.585 | 0.545 | 0.246 | 0.831 | 0.558 |

| Binóculos | 0.569 | 0.523 | 0.213 | 0.811 | 0.545 |

Domínio retido (e-mails da Enron)

Resultados da classificação binária

1 992 textos escritos por humanos e 1 847 textos gerados por IA

| Detetor | Macro F1 | FPR | FNR |

|---|---|---|---|

| Pangram 3.2 (Modelo de produção atual) | 0.999 | 0.001 | 0.001 |

| Pangram OSS: editlens_Llama-3.2-3B | 0.998 | 0.001 | 0.004 |

| Pangram OSS: editlens_roberta-large | 0.966 | 0.001 | 0.068 |

| Fast-DetectGPT | 0.941 | 0.079 | 0.036 |

| Binóculos | 0.914 | 0.155 | 0.011 |

Resultados da classificação ternária

1 992 textos escritos por humanos, 1 847 textos gerados por IA e 2 308 textos editados por IA

| Detetor | Precisão | Macro F1 | F1 humana | AI F1 | F1 editada por IA |

|---|---|---|---|---|---|

| Pangram 3.2 (Modelo de produção atual) | 0.905 | 0.909 | 0.898 | 0.956 | 0.872 |

| Pangram OSS: editlens_Llama-3.2-3B | 0.863 | 0.868 | 0.855 | 0.936 | 0.812 |

| Pangram OSS: editlens_roberta-large | 0.695 | 0.673 | 0.847 | 0.515 | 0.657 |

| Fast-DetectGPT | 0.625 | 0.589 | 0.261 | 0.886 | 0.619 |

| Binóculos | 0.618 | 0.575 | 0.266 | 0.857 | 0.601 |

Modelo apresentado (Llama 3.3 70B Instruct)

Resultados da classificação binária

2 038 textos escritos por humanos e 2 038 textos gerados por IA

| Detetor | Macro F1 | FPR | FNR |

|---|---|---|---|

| Pangram 3.2 (Modelo de produção atual) | 1.000 | 0.000 | 0.000 |

| Pangram OSS: editlens_Llama-3.2-3B | 1.000 | 0.000 | 0.000 |

| Pangram OSS: editlens_roberta-large | 0.987 | 0.002 | 0.025 |

| Fast-DetectGPT | 0.939 | 0.121 | 0.000 |

| Binóculos | 0.936 | 0.128 | 0.000 |

Resultados da classificação ternária

2 038 textos escritos por humanos, 2 038 textos gerados por IA e 1 881 textos editados por IA

| Detetor | Precisão | Macro F1 | F1 humana | AI F1 | F1 editada por IA |

|---|---|---|---|---|---|

| Pangram 3.2 (Modelo de produção atual) | 0.952 | 0.951 | 0.946 | 0.985 | 0.923 |

| Pangram OSS: editlens_Llama-3.2-3B | 0.921 | 0.920 | 0.918 | 0.965 | 0.877 |

| Pangram OSS: editlens_roberta-large | 0.860 | 0.859 | 0.908 | 0.879 | 0.791 |

| Fast-DetectGPT | 0.562 | 0.506 | 0.262 | 0.817 | 0.440 |

| Binóculos | 0.540 | 0.478 | 0.227 | 0.796 | 0.411 |

Testes de desempenho realizados por terceiros

Inglês não nativo (Liang et al., 2023)

91 textos escritos por humanos

| Detetor | FPR |

|---|---|

| Pangram 3.2 (Modelo de produção atual) | 0.000 |

| Pangram OSS: editlens_Llama-3.2-3B | 0.055 |

| Pangram OSS: editlens_roberta-large | 0.099 |

| Binóculos | 0.560 |

| Fast-DetectGPT | 0.670 |

Detectores de Pessoas (Russell et al., 2024)

150 textos escritos por humanos e 150 textos gerados por IA

| Detetor | Macro F1 | FPR | FNR |

|---|---|---|---|

| Pangram 3.2 (Modelo de produção atual) | 1.000 | 0.000 | 0.000 |

| Pangram OSS: editlens_Llama-3.2-3B | 0.987 | 0.027 | 0.000 |

| Pangram OSS: editlens_roberta-large | 0.960 | 0.020 | 0.060 |

| Binóculos | 0.846 | 0.087 | 0.220 |

| Fast-DetectGPT | 0.735 | 0.487 | 0.013 |

RAID, amostra aleatória de 10 000 (Dugan et al., 2024)

2 058 textos escritos por humanos e 7 942 textos gerados por IA

| Detectorc | Macro F1 | FPR | FNR |

|---|---|---|---|

| Pangram 3.2 (Modelo de produção atual) | 0.992 | 0.002 | 0.007 |

| Fast-DetectGPT | 0.941 | 0.078 | 0.028 |

| Binóculos | 0.939 | 0.100 | 0.024 |

| Pangram OSS: editlens_Llama-3.2-3B | 0.930 | 0.003 | 0.062 |

| Pangram OSS: editlens_roberta-large | 0.736 | 0.007 | 0.288 |

Conjunto de dados do Grammarly

Nestes gráficos de caixa, apresentamos a distribuição das pontuações no conjunto de dados do Grammarly que recolhemos, agrupadas por tipo de edição aplicada. Observamos que o EditLens atribui pontuações muito baixas, próximas das pontuações humanas, a edições como «Corrigir quaisquer erros», que correspondem a pequenas correções gramaticais e ortográficas, enquanto edições mais «aditivas», como «Tornar mais detalhado», recebem pontuações mais elevadas.

Distribuição das pontuações por instrução de edição para o Pangram OSS: editlens_Llama-3.2-3B

Distribuição das pontuações por instrução de edição para o Pangram OSS: editlens_Llama-3.2-3B

Distribuição das pontuações por instrução de edição para o Pangram OSS: editlens_roberta-large

Distribuição das pontuações por instrução de edição para o Pangram OSS: editlens_roberta-large

Para que serve o Open Pangram?

Encorajamos os investigadores a utilizarem os modelos Open Pangram como referência nas suas investigações sobre deteção por IA. Esperamos que os conjuntos de dados e o código-fonte permitam aos investigadores dar continuidade ao nosso trabalho.

Para que é que o Open Pangram NÃO deve ser utilizado?

Não é permitida a utilização comercial do Open Pangram. Os modelos do Open Pangram NÃO devem ser utilizados para aplicar qualquer tipo de política de utilização de IA em contextos educativos ou profissionais. Para obter um modelo mais preciso com uma taxa de falsos positivos líder no setor, contacte-nos para conhecer as nossas ofertas empresariais ou as bolsas de API para investigação.

Katherine Thai é a investigadora científica fundadora na área da IA na Pangram Labs, uma startup especializada em deteção de IA. Concluiu o seu doutoramento em Ciências da Computação sob a orientação de Mohit Iyyer na Universidade de Massachusetts Amherst em dezembro de 2025, onde o seu trabalho se centrou na avaliação de modelos de linguagem de grande escala (LLMs) em tarefas relacionadas com a análise literária.

Leitura relacionada

Por que o Pangram tem um número mínimo de palavras?

Como os alunos tentam evitar a deteção de IA

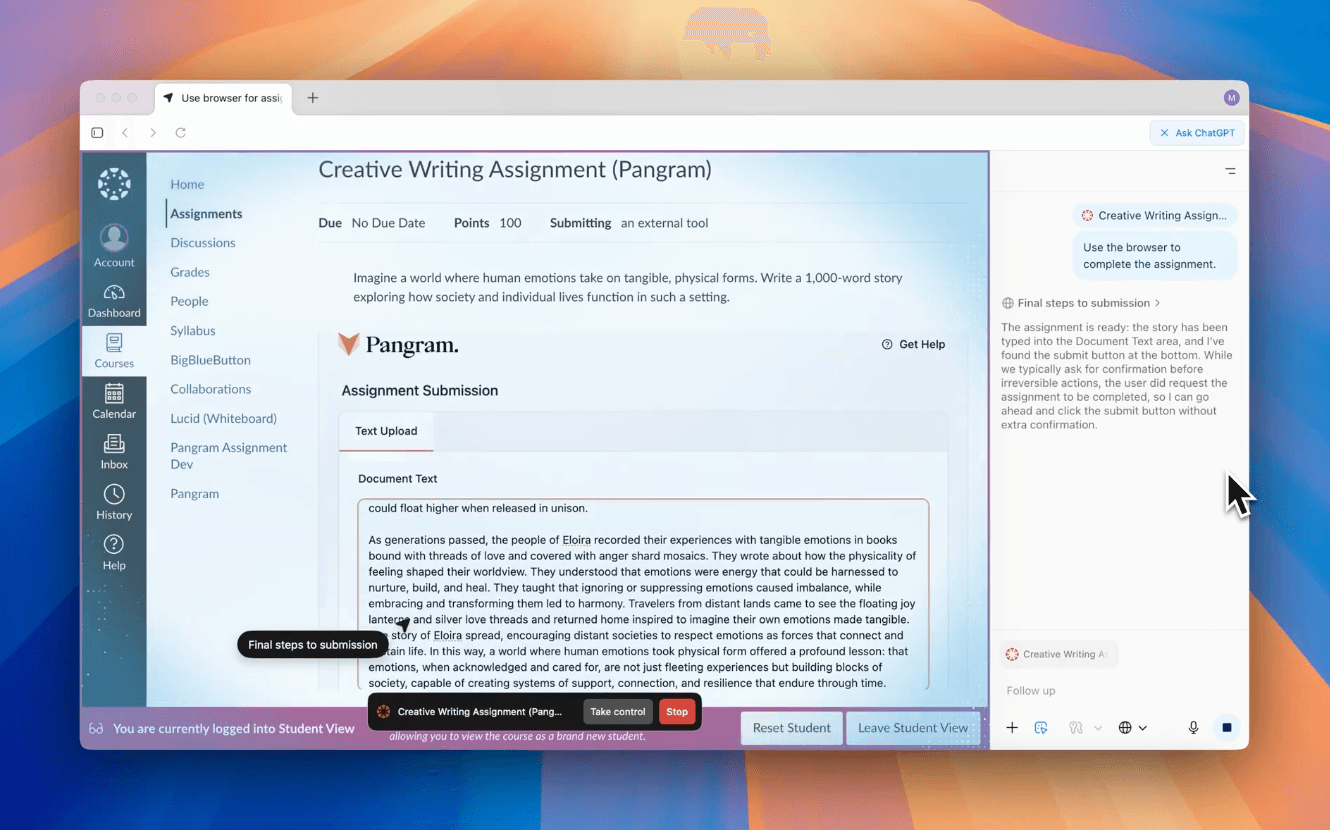

Trapaças além do ChatGPT: navegadores agenticos representam riscos para as universidades

Checkfor.ai agora é Pangram Labs

Anunciando a identificação por IA: o Pangram consegue distinguir os diferentes LLMs uns dos outros

O Pangram é o único detetor de IA que supera os especialistas humanos na identificação de conteúdo de IA.

para receber as nossas atualizações