لم يعد هناك قطاع لم يمسه الذكاء الاصطناعي.

لقد تأثرت كل المهن، من الأطباء والمحامين إلى المتخصصين في التسويق والمؤثرين على وسائل التواصل الاجتماعي، بالمحتوى الذي يولده الذكاء الاصطناعي. ولكن ماذا عن الصحفيين؟ تعتمد هذه المهنة على ثقة القراء؛ ومع ذلك، كشفت أبحاث حديثة عن طفرة في استخدام الذكاء الاصطناعي غير المنظم في هذا القطاع، حيث وصلت المقالات التي يولدها الذكاء الاصطناعي إلى صفحات الصحف الموثوقة والواسعة الانتشار. وبينما تقيّم القطاعات الأخرى قيمها الأخلاقية لتحديد الاستخدام المناسب للذكاء الاصطناعي، يتعين على الصحافة أن تفعل الشيء نفسه. يمكن لأدوات الذكاء الاصطناعي أتمتة المهام المتكررة ودعم سرد القصص القائم على البيانات، لكن هذه التكنولوجيا تتعثر بسبب التحيز والهلوسة. إن الافتقار إلى معيار ملزم قانونًا على مستوى القطاع لاستخدام الذكاء الاصطناعي بشكل مناسب يترك غرف الأخبار لتتنقل في هذه المياه غير المكتشفة بمفردها. أدناه، سنستكشف الأطر الحالية لتقييم الاستخدام الأخلاقي للذكاء الاصطناعي في غرفة الأخبار، ونحلل الثغرات، ونقترح نهجًا أخلاقيًا موحدًا يركز على الشفافية والإشراف البشري.

مشهد تتسم معالمه بتوجيهات مجزأة وغامضة

مع تسارع وتيرة تطور تكنولوجيا الذكاء الاصطناعي، لا تزال الحوكمة الأخلاقية متخلفة عن الركب. ومع ذلك، فقد أخذت عدة منظمات عالمية موثوقة زمام المبادرة في الجهود الرامية إلى اللحاق بالركب. وتسعى هذه المنظمات إلى مساعدة غرف الأخبار على استعادة السيطرة التحريرية وثقة القراء، في الوقت الذي لا تزال تكافح فيه لمعالجة مجموعة كاملة من المعضلات التي يواجهها المحررون والناشرون وكتابهم في عصرنا هذا.

اعتمدت منظمة الأمم المتحدة للتربية والعلم والثقافة (اليونسكو) في عام 2021 توصيات بشأن أخلاقيات الذكاء الاصطناعي، تركز على الإشراف البشري. يقدم القسم الذي يحدد توصيات صناعة الاتصالات والمعلومات بعض الإرشادات للصحفيين. تنص السياسة على أن أنظمة الذكاء الاصطناعي يجب أن تعزز حرية المعلومات وحرية التعبير والشفافية والكشف عن البيانات الرسمية. وهي تشجع أي شخص في صناعة الإعلام على دمج الذكاء الاصطناعي في عمله بطريقة أخلاقية. كما يطلب الإطار من الدول تعزيز بيئات شفافة وتعليمية حيث يمكن لوسائل الإعلام الإبلاغ عن أضرار وفوائد الذكاء الاصطناعي، ويمكن للمستهلكين بناء مهارات التثقيف الرقمي والإعلامي لمكافحة المعلومات المضللة وخطاب الكراهية.

ومع ذلك، لا يشغل الإطار الخاص بوسائل الإعلام سوى أربع فقرات من أصل 44 صفحة تحدد سياسات اليونسكو الأخلاقية المتعلقة بالذكاء الاصطناعي. ولا تكاد توجد أي إشارة إلى الصحافة والصحفيين على وجه التحديد، بل تبدو هذه السياسة أقرب إلى بيان للقيم ودعوة عامة لوضع سياسات أكثر شمولاً في المستقبل. وهو ما لا يوفر الكثير لوسائل الإعلام لتستند إليه.

اتبع معهد مهندسي الكهرباء والإلكترونيات (IEEE) نهجًا مشابهًا. فإطار عمل «التصميم المتوافق أخلاقيًا» الذي وضعه المعهد يعزز حرية الصحفيين في توعية الجمهور بقضايا الذكاء الاصطناعي وحرمة الحكم البشري والرقابة البشرية. ومع ذلك، فإن هذه السياسة هي بمثابة بيان للمثل والقيم وليست دليلًا مفصلاً للتعامل مع معضلات الذكاء الاصطناعي داخل غرفة الأخبار. كيف ينبغي لوسائل الإعلام التعامل مع الإفصاح عن استخدام الذكاء الاصطناعي؟ أو التعامل مع الاستخدامات غير الملائمة؟ ما الذي يُعرّف الاستخدام غير الملائم؟ كل هذه الشكوك تقلب غرف الأخبار رأساً على عقب وتترك ثقة الجمهور في حالة من عدم اليقين، لكن السياسة القوية يمكن أن توفر خريطة لهذا المجال المجهول.

ما هي الخطوة التالية؟: المبادئ الأساسية لسياسة أخلاقية بشأن استخدام الذكاء الاصطناعي في الصحافة

يحتاج الناشرون والمحررون والصحفيون بشدة إلى إرشادات ملموسة وشاملة وسليمة أخلاقياً لتنظيم حالات استخدام الذكاء الاصطناعي في غرف الأخبار وتوضيحها وتبريرها بشكل صحيح. وعند وضع سياسة صارمة ومدروسة بشأن الذكاء الاصطناعي، ينبغي لغرف الأخبار أن تستند في إرشاداتها إلى أربعة مبادئ غير قابلة للتفاوض، وهي: الشفافية والمساءلة والشمولية والإنصاف.

فيما يلي نقطة انطلاق لتطبيق هذه المبادئ على استخدام الذكاء الاصطناعي في غرفة الأخبار:

- الشفافية تعني الإفصاح للقراء عن استخدام الذكاء الاصطناعي بطريقة واضحة وصادقة وجلية. وسواء استخدم الصحفيون الذكاء الاصطناعي لتوليد أفكار صحفية، أو لإجراء البحوث، أو لإنشاء مواد بصرية، فإن جمهورهم يستحق دائمًا أن يكون على علم بذلك.

- المساءلة تعني تحديد المسؤولية عن الأخطاء التي تحدث في المحتوى والبحوث التي تنتجها الذكاء الاصطناعي. وينبغي على غرف الأخبار أن تحدد بوضوح من يتحمل المسؤولية عندما يسوء استخدام الذكاء الاصطناعي – فهل هو مطور برنامج الذكاء الاصطناعي؟ أم الصحفي؟ أم الخوارزمية نفسها؟ والمساءلة السليمة تعني الاعتراف بالأخطاء ومعاقبة الطرف المخطئ. لذا، فإن الأمر متروك لغرف الأخبار لتقرير من يتحمل المسؤولية وكيفية التعامل مع الموقف.

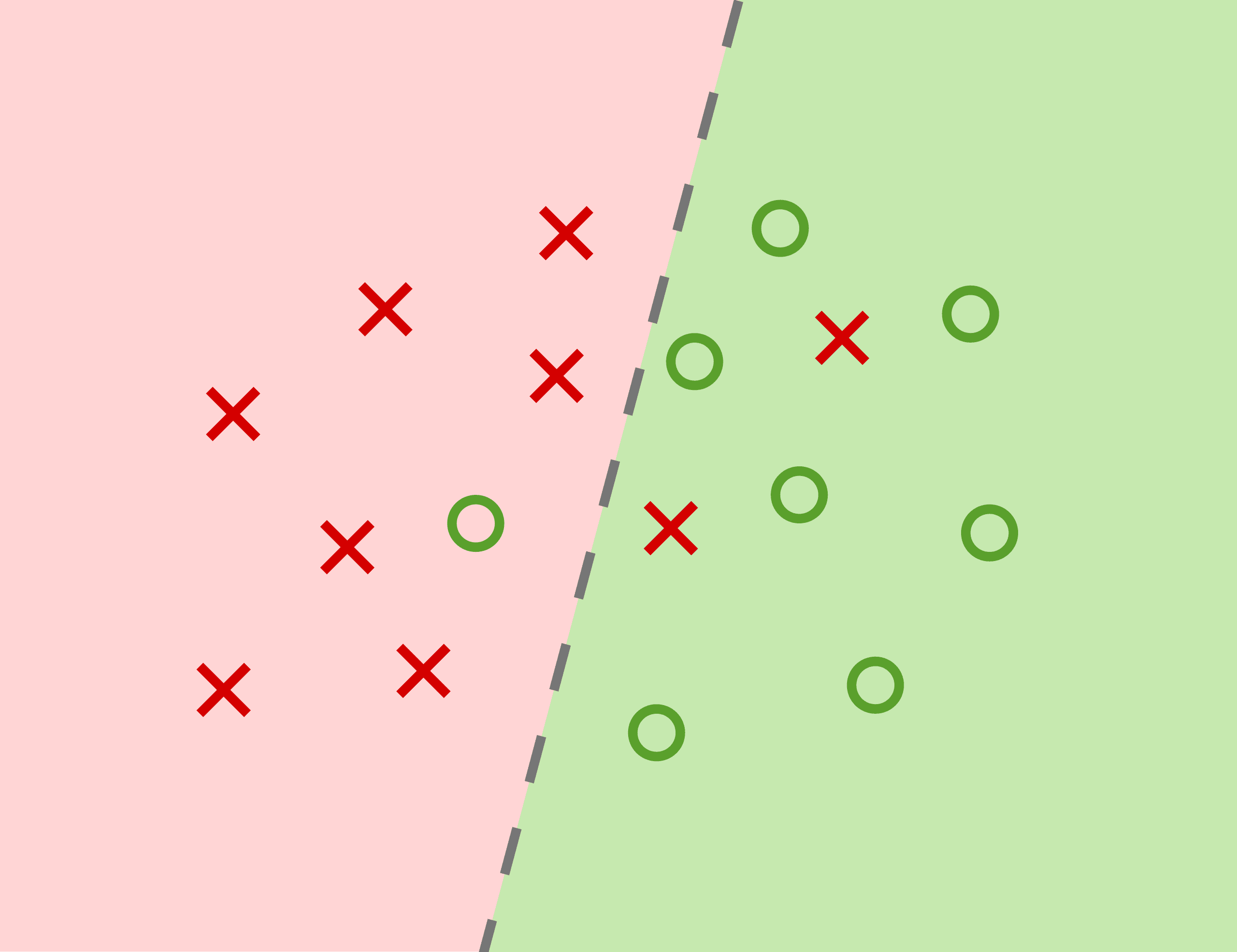

- الشمولية تعني تعزيز الوعي بالتحيزات الكامنة في أدوات الذكاء الاصطناعي والحد منها. تساهم البيانات التدريبية لخوارزميات الذكاء الاصطناعي في تحديد مخرجات الخوارزمية، مما يعني أن أدوات الذكاء الاصطناعي معرضة لخطر تضخيم التحيزات السائدة في المجتمع الذي تم تطويرها فيه. وينبغي أن يُؤخذ هذا الأمر دائمًا في الاعتبار عند استخدام الذكاء الاصطناعي في غرف الأخبار، كما يجب أن توفر السياسات استراتيجيات للتحقيق في هذه التحيزات والحد منها.

- الإنصاف يعني التطبيق العادل لهذه السياسة. يجب على فرق غرفة الأخبار الالتزام الصارم بالسياسة المعمول بها وتنفيذ التحديثات حسب الحاجة. يجب أن يكون التطبيق شاملاً للجميع، ولا ينبغي أن يمر الخروج عن السياسة دون عواقب ودون الإفصاح بوضوح عن الانتهاكات للجمهور.

خطر التحيز الخوارزمي و«اللحم الوردي»

تُشكل نماذج الذكاء الاصطناعي التي يتم نشرها دون ضوابط أخلاقية خطرًا يتمثل في تعزيز التفاوتات الاجتماعية والصور النمطية عن الفئات المهمشة، مع تعزيز المعتقدات المسبقة لدى المستخدمين وتعميق الاستقطاب. وقد وجدت منظمة اليونسكو، في بحثها حول الصور النمطية التي يولدها الذكاء الاصطناعي، أن نماذج اللغة الضخمة تُسند أدوارًا منزلية للنساء بمعدلات أعلى بكثير من الرجال، بينما تنتج محتوى سلبيًا عن المثليين وعن مجموعات عرقية معينة. ووجد باحثون من جامعة ستانفورد أن نماذج الذكاء الاصطناعي تكرس الصور النمطية العنصرية المتطرفة المرتبطة بفترة ما قبل حق الحقوق المدنية بعد أن طُلب منها وصف أشخاص يتحدثون الإنجليزية الأمريكية الأفريقية. يمكن أن يتسرب خطر تكريس التحيز من خلال استخدام أنظمة الذكاء الاصطناعي التي لا مفر من وجود عيوب فيها إلى الترجمة وتحليل البيانات وتوليد أفكار القصص وغيرها من الأعمال التي تعهد بها غرف الأخبار إلى هذه الأدوات. بالإضافة إلى ذلك، يمكن أن تستمر أنظمة التوصية بالذكاء الاصطناعي المصممة لتقديم محتوى مخصص، بما في ذلك الأخبار، في عرض محتوى يتفق معه القراء، مما يعزز تصوراتهم المسبقة عن العالم ويغلق أبوابهم أمام وجهات نظر بديلة أو معلومات توسع آفاقهم.

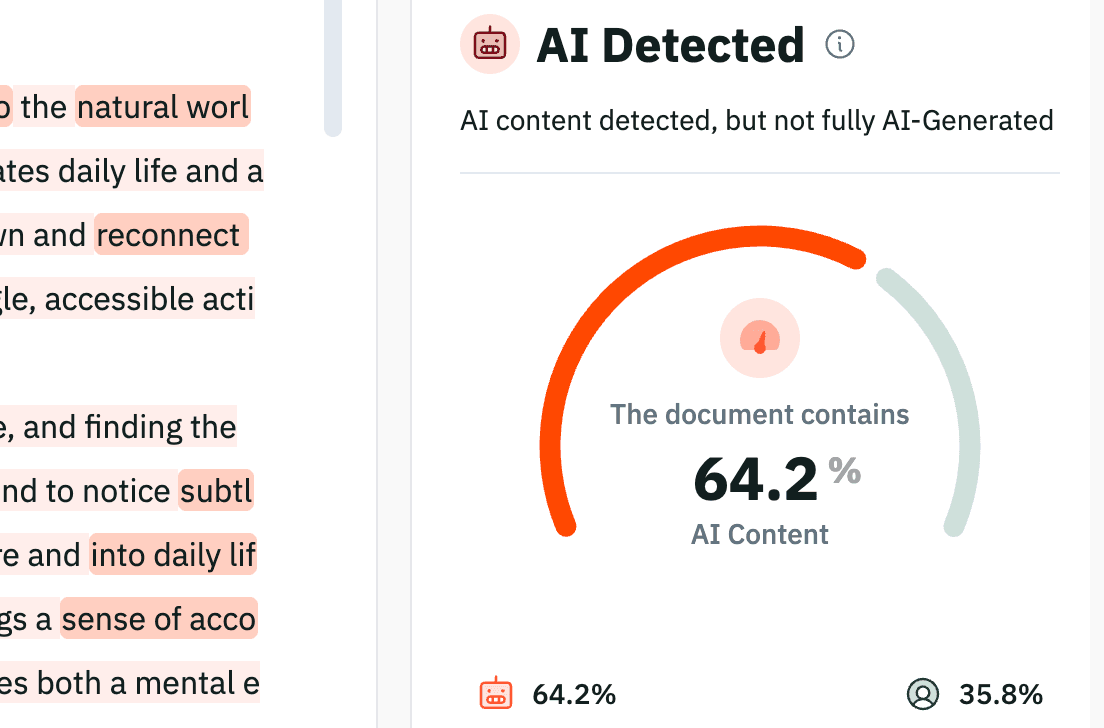

كما أن الكم الهائل من المحتوى الذي يُنتج بواسطة الذكاء الاصطناعي على الإنترنت قد يربك القراء ويهدد ثقتهم في وسائل الإعلام التقليدية. فقد كشفت دراسة أجرتها شركة «بانجرام» المتخصصة في كشف المحتوى المصطنع أن 60 ألف مقال إخباري يُنتج بواسطة الذكاء الاصطناعي يُنشر يوميًا، لا سيما في مجالات التكنولوجيا والجمال والأعمال. تستخدم المواقع الإخبارية ذات الجودة المنخفضة والجهات الفاعلة السيئة الذكاء الاصطناعي لإنتاج كميات هائلة من المحتوى منخفض الجودة (المعروف باسم "الطين الوردي") بتكلفة تقارب الصفر بهدف جني عائدات الإعلانات. هذه المزارع المحتوى تشوش المشهد الإخباري وتجعل من الضروري أكثر أن تضع المواقع الإخبارية الموثوقة والمهنية سياسات قوية بشأن الذكاء الاصطناعي وتكشف عنها لقرائها.

دراسات حالة: ما هي المؤسسات الإخبارية التي تقود الطريق؟

تنجح المؤسسات الإخبارية الرائدة، مثل «نيويورك تايمز» و«بي بي سي» و«بروبوبليكا»، في تحقيق التوازن بين الابتكار والأخلاقيات من خلال إبقاء الإشراف البشري في صدارة سياساتها، وسحب زمام الأمور من الخوارزميات وإعادته إلى أيدي المحررين الموثوق بهم. فقد فرضت هيئة الإذاعة البريطانية (BBC) – على سبيل المثال – على موظفيها توضيح استخدام الذكاء الاصطناعي في إنشاء المحتوى الخاص بهم وعرضه وتوزيعه. كما تشجع إرشاداتها على مراعاة ومراقبة التحيزات المتأصلة والهلوسة والسرقة الأدبية في مخرجات أدوات الذكاء الاصطناعي. ويجب على جميع الموظفين والمستقلين تقديم مقترح لاستخدام الذكاء الاصطناعي إلى مسؤول تحريري رفيع المستوى للموافقة عليه. تحدد إرشادات بي بي سي أيضًا حالات الاستخدام المناسبة للذكاء الاصطناعي، بما في ذلك عرض مخرجات الذكاء الاصطناعي في التقارير الإخبارية حول الموضوع أو تغيير أصوات المصادر التي ترغب في البقاء مجهولة الهوية. تستخدم بروبوبليكا الذكاء الاصطناعي صراحةً لفرز قواعد البيانات الضخمة في التحقيقات الحاسمة وتحديد الأنماط لكشف التحيز في الأنظمة الأخرى. أوضحت صحيفة نيويورك تايمز استخدامها للذكاء الاصطناعي في المساعدة في إنشاء العناوين الرئيسية والملخصات، وإنشاء نسخ صوتية من المقالات، وتحليل البيانات.

التنفيذ: كيف يمكن لغرف الأخبار أن تطبق المعايير الأخلاقية

من أجل وضع مبادئ توجيهية مناسبة وشاملة بشأن الذكاء الاصطناعي تتوافق مع مدونة أخلاقيات جمعية الصحفيين المحترفين، ينبغي على غرف الأخبار تشكيل فرق متعددة التخصصات تجمع بين الخبرة التقنية والأخلاقية لتغطية جميع الجوانب في هذا العالم الجديد الذي تهزه ثورة الذكاء الاصطناعي. ويجب أن يظل الإشراف البشري في صميم استخدام الذكاء الاصطناعي. كما يجب إجراء تدقيق مستمر لدقة النتائج التي ينتجها الذكاء الاصطناعي والمستخدمة في التقارير الإخبارية.

ينبغي أن يكون الذكاء الاصطناعي مكملاً لقدرات الإنسان، لا بديلاً عن الصحافة الموثوقة التي تستند إلى بحث دقيق. ولتطبيق السياسات وضمان الامتثال لها، ينبغي على غرف الأخبار استخدام أدوات التحقق مثل «بانغرام» (Pangram) للكشف عن الحالات غير المعلنة وغير الملائمة للمحتوى الذي يُنتج بواسطة الذكاء الاصطناعي. ورغم أن أدوات الذكاء الاصطناعي توفر كفاءة مغرية، إلا أنها لا تحافظ على نفس المصداقية والمُثُل الأخلاقية التي تتمسك بها غرف الأخبار الجيدة. ومن خلال اعتماد إطار عمل يرتكز على الشفافية والمساءلة، يمكن لغرف الأخبار الاستفادة من أدوات الذكاء الاصطناعي دون المساس بالوظيفة الديمقراطية للصحافة.

احرص على أن تحافظ منشوراتك على أعلى معايير النزاهة في عصر الذكاء الاصطناعي الحالي. تحقق من صحة محتواك اليوم.

مقالات ذات صلة

نعم، يمكن أن يكون الكشف عن الذكاء الاصطناعي دقيقًا

هل يمكن أن يكشف نظام الكشف القائم على الذكاء الاصطناعي عن أسلوب كتابة كلود؟

كل ما يتعلق بالنتائج الإيجابية الخاطئة في أجهزة الكشف التي تعمل بالذكاء الاصطناعي

العلامات المائية المدعومة بالذكاء الاصطناعي: لماذا تراهن شركات التكنولوجيا الكبرى على تتبع مصدر المحتوى باستخدام الذكاء الاصطناعي، وتخسر

أداة فحص خطابات التقديم بالذكاء الاصطناعي - كيف تقوم فرق الموارد البشرية بتصفية المعلومات غير المهمة

جولة في أكثر العبارات شيوعًا في مجال الذكاء الاصطناعي

لتلقي آخر أخبارنا