Inhaltsverzeichnis

- Eine Landschaft, die durch lückenhafte und vage Vorgaben geprägt ist

- Wie geht es nun weiter?: Grundprinzipien einer ethischen KI-Richtlinie für den Journalismus

- Die Gefahr algorithmischer Voreingenommenheit und „Pink Slime“

- Fallstudien: Welche Nachrichtenorganisationen sind Vorreiter?

- Umsetzung: Wie Redaktionen ethische Grundsätze durchsetzen können

Kein Wirtschaftszweig bleibt von künstlicher Intelligenz verschont.

Jeder Beruf, von Ärzten und Anwälten bis hin zu Marketingfachleuten und Social-Media-Influencern, ist von KI-generierten Inhalten geprägt. Aber Journalisten? Der Beruf stützt sich auf das Vertrauen der Leser; jüngste Untersuchungen haben jedoch einen Boom bei der unregulierten Nutzung von KI in der Branche festgestellt, wobei KI-generierte Artikel sogar ihren Weg in die Seiten weit verbreiteter und vertrauenswürdiger Zeitungen finden. Während andere Branchen ihre ethischen Werte überprüfen, um eine angemessene KI-Nutzung zu bestimmen, muss der Journalismus dasselbe tun. KI-Tools können repetitive Aufgaben automatisieren und datengestütztes Storytelling unterstützen, doch die Technologie versagt aufgrund von Verzerrungen und Halluzinationen. Das Fehlen eines rechtsverbindlichen, branchenweiten Standards für den angemessenen Einsatz von KI zwingt Redaktionen dazu, sich auf eigene Faust in diesen unerforschten Gewässern zurechtzufinden. Im Folgenden werden wir aktuelle Rahmenbedingungen zur Bewertung des ethischen Einsatzes von KI in der Redaktion untersuchen, die Lücken analysieren und einen konsolidierten ethischen Ansatz vorschlagen, der auf Transparenz und menschlicher Aufsicht basiert.

Eine Landschaft, die durch lückenhafte und vage Vorgaben geprägt ist

Während sich die KI-Technologie rasant weiterentwickelt, hinkt die ethische Regulierung hinterher. Mehrere renommierte internationale Organisationen haben jedoch die Initiative ergriffen, um diesen Rückstand aufzuholen. Diese Organisationen versuchen, Redaktionen dabei zu unterstützen, ihre redaktionelle Kontrolle und das Vertrauen der Leser zurückzugewinnen, haben jedoch nach wie vor Schwierigkeiten, die gesamte Bandbreite der Dilemmata zu bewältigen, mit denen Redakteure, Verleger und ihre Autoren heutzutage konfrontiert sind.

Die Organisation der Vereinten Nationen für Erziehung, Wissenschaft und Kultur (UNESCO) hat 2021 Empfehlungen zur Ethik der künstlichen Intelligenz verabschiedet, deren Schwerpunkt auf der menschlichen Kontrolle liegt. Der Abschnitt, in dem die Empfehlungen für die Kommunikations- und Informationsbranche dargelegt werden, bietet Journalisten einige Leitlinien. Die Richtlinie schreibt vor, dass KI-Systeme die Informationsfreiheit, die Meinungsfreiheit, Transparenz und die Offenlegung offizieller Daten fördern sollen. Sie ermutigt alle Akteure der Medienbranche, KI auf ethische Weise in ihre Arbeit zu integrieren. Der Rahmen fordert die Länder zudem auf, transparente und bildungsfördernde Umgebungen zu schaffen, in denen Medien über die Vor- und Nachteile von KI berichten können und Verbraucher digitale und mediale Kompetenzen erwerben können, um Fehlinformationen und Hassreden entgegenzuwirken.

Der Medienbereich nimmt jedoch nur vier Absätze der insgesamt 44 Seiten umfassenden Darstellung der ethischen KI-Richtlinien der UNESCO ein. Der Journalismus und Journalisten werden kaum namentlich erwähnt, und die Richtlinie dient eher als Werteerklärung und allgemeine Aufforderung, in Zukunft umfassendere Richtlinien zu erarbeiten. Für die Medien gibt es hier also nicht viel, worauf sie sich stützen könnten.

Das Institute of Electrical and Electronics Engineers (IEEE) verfolgte einen ähnlichen Ansatz. Sein Rahmenwerk „Ethically Aligned Design“ stärkt die Freiheit von Journalisten, die Öffentlichkeit über Fragen der künstlichen Intelligenz sowie über die Unantastbarkeit menschlichen Urteilsvermögens und menschlicher Kontrolle aufzuklären. Allerdings handelt es sich bei dieser Richtlinie um eine ähnliche Erklärung von Idealen und Werten und nicht um einen konkret ausgearbeiteten Leitfaden für den Umgang mit KI-Dilemmata in einer Redaktion. Wie sollten die Medien mit der Offenlegung des KI-Einsatzes umgehen? Oder mit unangemessenen Verwendungen? Was macht eine unangemessene Nutzung aus? All diese Unsicherheiten bringen Redaktionen ins Wanken und lassen das Vertrauen des Publikums in der Schwebe, doch eine solide Richtlinie kann einen Wegweiser für dieses Neuland bieten.

Wie geht es nun weiter?: Grundprinzipien einer ethischen KI-Richtlinie für den Journalismus

Verleger, Redakteure und Journalisten benötigen dringend konkrete, umfassende und ethisch fundierte Leitlinien, um den Einsatz von KI in der Redaktion zu regeln, zu erklären und angemessen zu begründen. Bei der Ausarbeitung einer strengen und fundierten KI-Richtlinie sollten sich Redaktionen auf vier unverzichtbare Grundsätze stützen: Transparenz, Rechenschaftspflicht, Inklusion und Fairness.

Im Folgenden finden Sie einen Ansatzpunkt für die Anwendung dieser Grundsätze auf den Einsatz von KI in der Redaktion:

- Transparenz bedeutet, dass der Einsatz von KI den Lesern klar, ehrlich und deutlich mitgeteilt wird. Ganz gleich, ob Journalisten KI nutzen, um Themen zu finden, Recherchen durchzuführen oder visuelle Inhalte zu erstellen – ihr Publikum hat stets ein Recht darauf, darüber informiert zu werden.

- Verantwortlichkeit bedeutet , die Schuld für Fehler in KI-generierten Inhalten und Forschungsergebnissen zuzuweisen. Redaktionen sollten klar definieren, wer verantwortlich ist, wenn der Einsatz von KI schiefgeht – ist es der Entwickler des KI-Programms? Der Journalist? Der Algorithmus selbst? Echte Verantwortlichkeit bedeutet, Fehler einzugestehen und den Verursacher zur Rechenschaft zu ziehen. Es liegt also an den Redaktionen, zu entscheiden, wer verantwortlich ist und wie mit der Situation umgegangen werden soll.

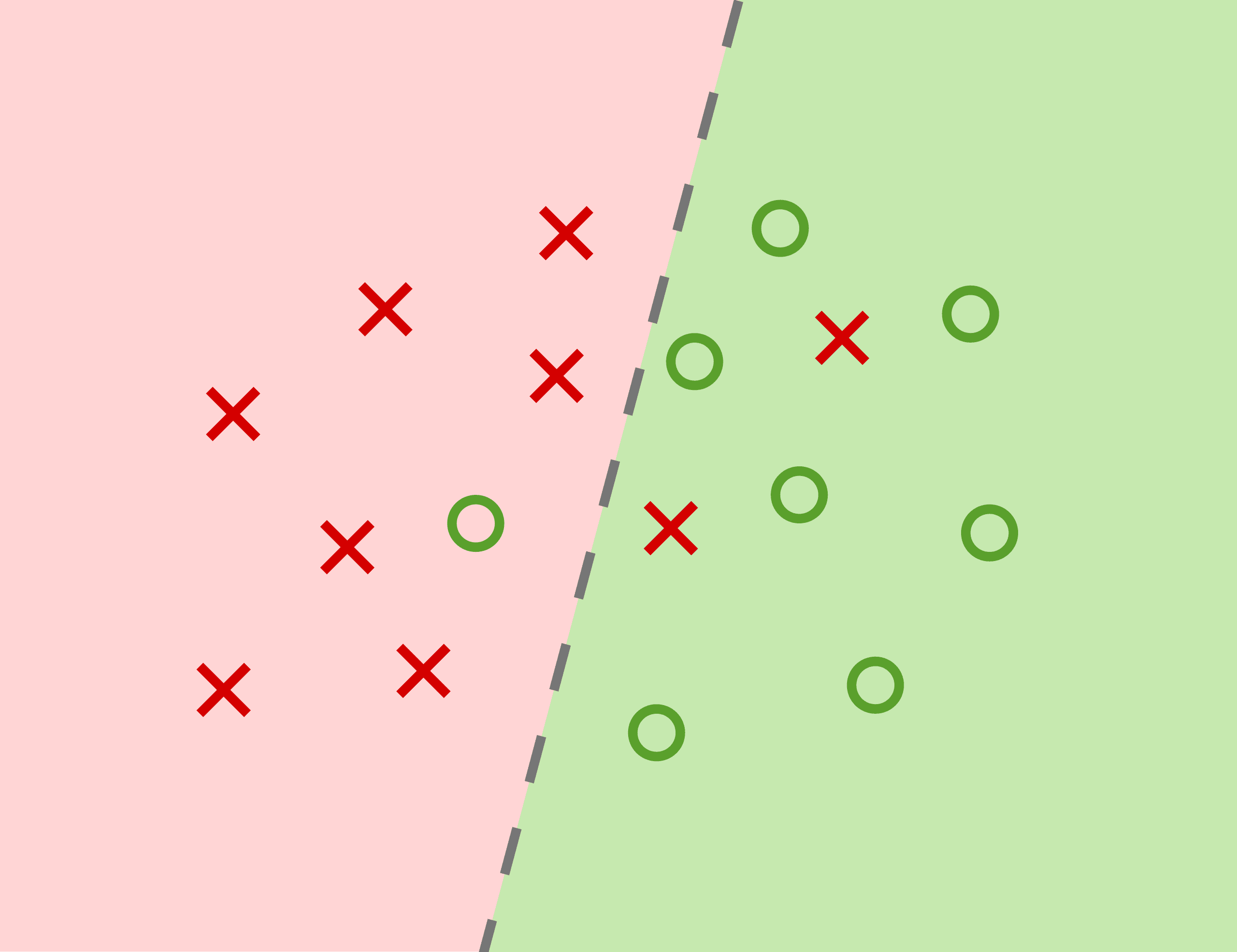

- Inklusivität bedeutet, das Bewusstsein für die Vorurteile von KI-Tools zu schärfen und diese abzubauen. Die Trainingsdaten von KI-Algorithmen bestimmen maßgeblich die Ergebnisse des Algorithmus, was bedeutet, dass KI-Tools die Gefahr bergen, die Vorurteile der Gesellschaft, in der sie entwickelt wurden, zu verstärken. Dies sollte bei der Nutzung von KI in Redaktionen stets berücksichtigt werden, und es sollten Richtlinien festgelegt werden, die Strategien zur Untersuchung und Minimierung dieser Vorurteile vorsehen.

- Fairness bedeutet eine gerechte Anwendung dieser Richtlinie. Die Redaktionsteams sollten sich strikt an die festgelegte Richtlinie halten und diese bei Bedarf aktualisieren. Die Anwendung muss einheitlich erfolgen, und Abweichungen von der Richtlinie dürfen nicht ohne Konsequenzen bleiben; Verstöße müssen dem Publikum klar offengelegt werden.

Die Gefahr algorithmischer Voreingenommenheit und „Pink Slime“

KI-Modelle, die ohne ethische Leitlinien eingesetzt werden, bergen die Gefahr, soziale Ungleichheiten und Stereotypen gegenüber marginalisierten Gruppen zu verstärken, während sie gleichzeitig die bereits bestehenden Überzeugungen der Nutzer bekräftigen und die Polarisierung verschärfen. Die UNESCO stellte in ihrer Untersuchung zu durch KI erzeugten Stereotypen fest, dass große Sprachmodelle Frauen deutlich häufiger als Männern häusliche Rollen zuwiesen und gleichzeitig negative Inhalte über homosexuelle Menschen und bestimmte ethnische Gruppen erzeugten. Forscher der Stanford University stellten fest, dass KI-Modelle extreme rassistische Stereotypen aus der Zeit vor der Bürgerrechtsbewegung reproduzierten, nachdem sie aufgefordert worden waren, Menschen zu beschreiben, die afroamerikanisches Englisch sprechen. Das Risiko, durch den Einsatz zwangsläufig fehlerhafter KI-Systeme Vorurteile zu zementieren, kann sich auf Übersetzungen, Datenanalysen, die Generierung von Story-Ideen und andere Aufgaben auswirken, die Redaktionen an diese Tools auslagern. Darüber hinaus können KI-Empfehlungssysteme, die darauf ausgelegt sind, personalisierte Inhalte – einschließlich Nachrichten – bereitzustellen, den Lesern weiterhin Inhalte anzeigen, denen sie zustimmen, wodurch ihre vorgefassten Meinungen über die Welt gestärkt werden und sie sich alternativen Sichtweisen oder Informationen verschließen, die ihren Horizont erweitern könnten.

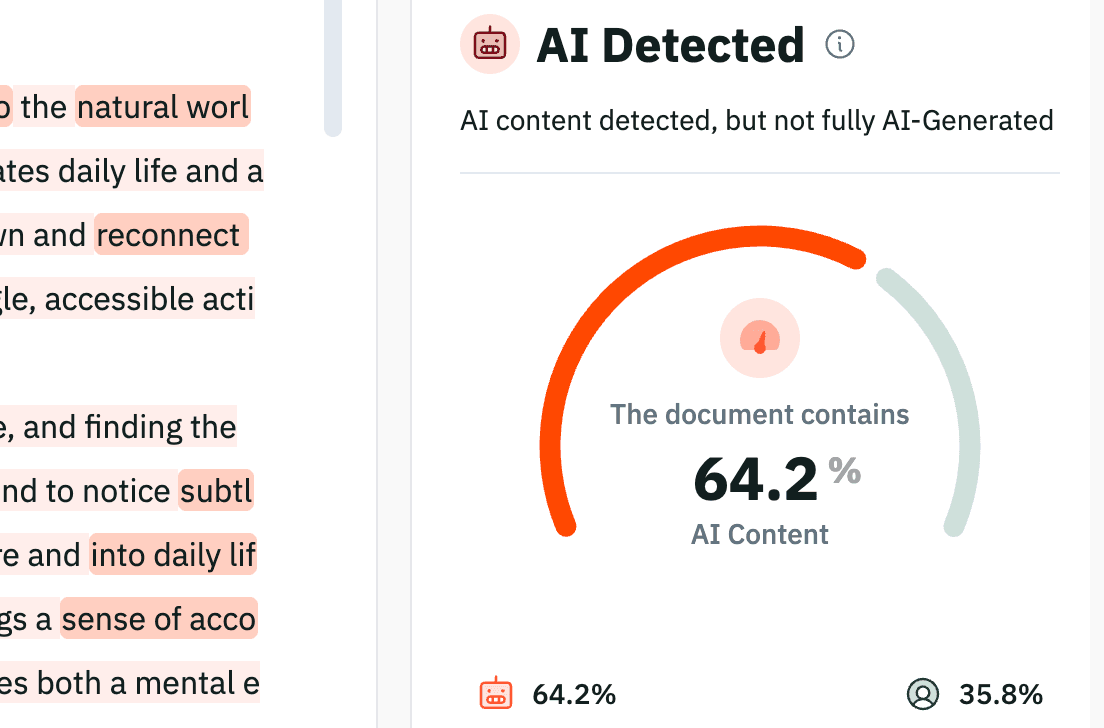

Die unendliche Flut an KI-Inhalten im Internet kann Leser zudem verwirren und ihr Vertrauen in traditionelle Nachrichtenmedien untergraben. Untersuchungen des auf KI-Erkennung spezialisierten Unternehmens Pangram ergaben, dass täglich 60.000 KI-generierte Nachrichtenartikel veröffentlicht werden, vor allem in den Bereichen Technologie, Beauty und Wirtschaft. Minderwertige Nachrichtenseiten und unseriöse Akteure nutzen KI, um ständig riesige Mengen an minderwertigen Inhalten (bekannt als „Pink Slime“) zu nahezu null Kosten zu produzieren, mit dem Ziel, Werbeeinnahmen zu generieren. Diese Content-Farmen trüben das Nachrichtenbild und machen es umso wichtiger, dass vertrauenswürdige und professionelle Nachrichtenseiten solide KI-Richtlinien erstellen, die sie ihren Lesern offenlegen.

Fallstudien: Welche Nachrichtenorganisationen sind Vorreiter?

Führende Nachrichtenorganisationen wie die New York Times, die BBC und ProPublica schaffen es, Innovation und Ethik erfolgreich in Einklang zu bringen, indem sie die menschliche Kontrolle in den Mittelpunkt ihrer Richtlinien stellen, den Algorithmen die Zügel entziehen und sie wieder in die Hände vertrauenswürdiger Redakteure legen. Die BBC schreibt beispielsweise vor, dass ihre Mitarbeiter den Einsatz von KI bei der Erstellung, Präsentation und Verbreitung ihrer Inhalte deutlich machen müssen. Ihre Richtlinien fördern zudem die Berücksichtigung und Überwachung von inhärenten Verzerrungen, Fehlinterpretationen und Plagiaten in den Ergebnissen von KI-Tools. Alle Mitarbeiter und Freiberufler müssen einen Vorschlag für den Einsatz von KI einem leitenden Redaktionsmitarbeiter zur Genehmigung vorlegen. Die BBC-Richtlinien umreißen zudem angemessene Anwendungsfälle für KI, darunter die Darstellung von KI-Ergebnissen in Nachrichtenbeiträgen zu dem jeweiligen Thema oder die Veränderung der Stimmen von Quellen, die anonym bleiben möchten. ProPublica nutzt KI ausdrücklich, um bei entscheidenden Recherchen große Datenbanken zu durchforsten und Muster zu identifizieren, um Verzerrungen in anderen Systemen aufzudecken. Die New York Times hat deutlich gemacht, dass sie KI zur Unterstützung bei der Erstellung von Überschriften und Zusammenfassungen, zur Generierung von Audioversionen von Artikeln und zur Datenanalyse einsetzt.

Umsetzung: Wie Redaktionen ethische Grundsätze durchsetzen können

Um angemessene und umfassende KI-Richtlinien zu erstellen, die mit dem Ethikkodex der Society of Professional Journalists vereinbar sind, sollten Redaktionen interdisziplinäre Teams bilden, die sowohl technologisches als auch ethisches Fachwissen vereinen, um in dieser von KI geprägten neuen Welt alle Aspekte abzudecken. Die menschliche Kontrolle sollte beim Einsatz von KI im Mittelpunkt stehen. KI-Ergebnisse, die in Nachrichtenbeiträgen verwendet werden, sollten kontinuierlich auf ihre Richtigkeit überprüft werden.

KI sollte eine Ergänzung zu menschlichen Fähigkeiten sein und keinen Ersatz für fundierten und zuverlässigen Journalismus darstellen. Um Richtlinien durchzusetzen und deren Einhaltung sicherzustellen, sollten Redaktionen Überprüfungsinstrumente wie Pangram einsetzen, um nicht offengelegte und unangemessene Fälle von KI-generierten Inhalten aufzudecken. KI-Tools bieten zwar verlockende Effizienzgewinne, entsprechen jedoch nicht denselben Glaubwürdigkeits- und Ethikstandards wie gute Redaktionen. Durch die Einführung eines auf Transparenz und Rechenschaftspflicht basierenden Rahmens können Redaktionen KI-Tools nutzen, ohne die demokratische Funktion der Presse zu beeinträchtigen.

Stellen Sie sicher, dass Ihre Publikation im heutigen Zeitalter der KI den höchsten Integritätsstandards entspricht. Überprüfen Sie noch heute die Echtheit Ihrer Inhalte.

Weiterführende Literatur

Ja, die KI-Erkennung kann präzise sein

Kann eine KI-Erkennung den Schreibstil von Claude erkennen?

Alles über Fehlalarme bei KI-Detektoren

KI-Wasserzeichen: Warum die großen Tech-Konzerne auf KI-Herkunftsnachweise setzen – und dabei den Kürzeren ziehen

KI-Anschreiben-Checker – Wie Personalabteilungen unerwünschte Informationen herausfiltern

Ein Rundgang durch die am häufigsten verwendeten Ausdrücke im Bereich der KI