Descubre al instante qué publicaciones son de personas y cuáles de IA en Twitter, LinkedIn, Substack y otras plataformas. Descarga nuestra nueva extensión para Chrome.

Índice

- Ficha del modelo

- Qué puedes esperar

- Qué ha mejorado

- Detección de humanizadores y prompts adversarios

- Detección de publicaciones breves en redes sociales generadas por IA

- Mejoras de Claude 4.6

- ¿Qué viene ahora?

- Matemáticas, programación y ciencias generadas por IA

- Iteración continua sobre los «humanizadores»

- El futuro

Presentamos Pangram 3.2

Actualización: Pangram 3.3 es ya la última versión disponible; consulta las novedades de Pangram 3.3.

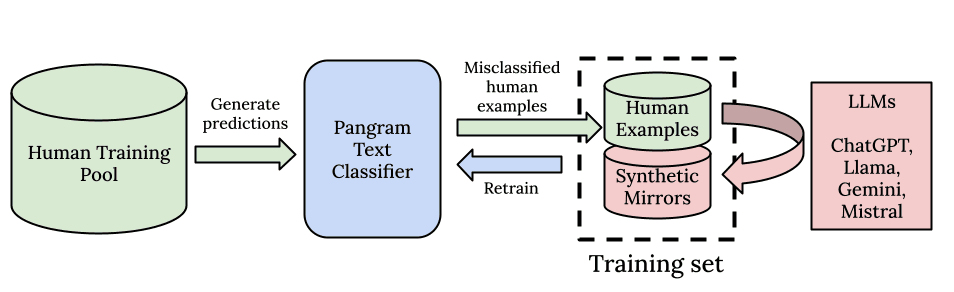

Pangram se complace enormemente en presentar un nuevo modelo de detección de IA, Pangram 3.2. Al igual que sus predecesores, Pangram 3.1 y Pangram 3.0, se basa en la arquitectura EditLens descrita en nuestro artículo presentado en ICLR 2026. Lo que nuestros usuarios pueden esperar es una mejora gradual, pero notable, en el número de verdaderos positivos que el detector es capaz de detectar (la recuperación), al tiempo que se mantiene la misma tasa de falsos positivos, la más baja del sector, lo que garantiza que las acusaciones falsas de uso de IA sigan siendo extremadamente raras.

Ficha del modelo

Siguiendo las mejores prácticas en el lanzamiento de modelos de lenguaje grande (LLM), hemos decidido empezar a publicar «fichas de modelo» junto con las actualizaciones de nuestro detector: se trata, en esencia, de «etiquetas nutricionales» para los modelos de IA. Nuestras fichas de modelo describen la arquitectura y el marco de entrenamiento, los detalles del conjunto de datos de entrenamiento, los resultados de evaluación pertinentes y los cambios introducidos que puedan afectar al comportamiento del detector. También describimos las especificaciones exactas de las entradas y salidas del modelo, los idiomas admitidos y las condiciones en las que esperamos que Pangram funcione bien, así como aquellas en las que sus prestaciones son más limitadas.

Qué puedes esperar

Probablemente notarás que Pangram 3.2 es más sensible que Pangram 3.1. En otras palabras, detectará más textos generados por IA. Esto se debe a mejoras en la detección de Humanizer, la detección de Claude 4.6, una mayor sensibilidad en la detección de textos más cortos generados por IA, la incorporación de más datos al conjunto de datos de entrenamiento y unos hiperparámetros más optimizados en la arquitectura de EditLens.

Qué ha mejorado

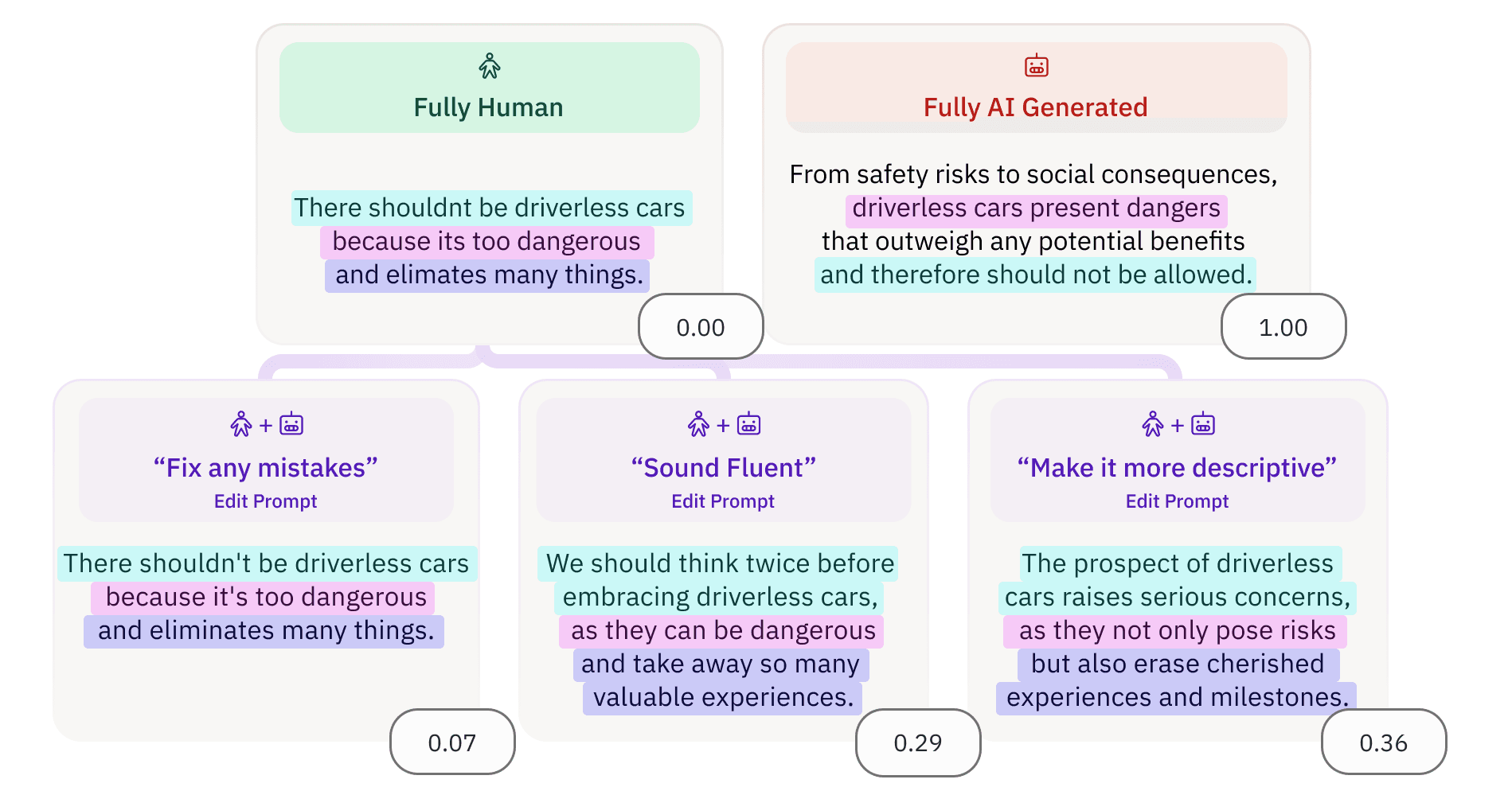

Detección de humanizadores y prompts adversarios

La mejora más significativa de Pangram 3.2 es su capacidad para detectar texto generado por IA humanizado. En nuestro conjunto interno de evaluación de humanizadores, hemos multiplicado por cuatro la tasa de detección de humanizadores en comparación con Pangram 3.1. También observamos una mejora de aproximadamente tres veces en nuestra evaluación interna de las «solicitudes adversarias», que son textos generados por un modelo de lenguaje al que se le ha indicado que añada errores intencionadamente y escriba con un estilo que eluda la detección de la IA.

Esto es especialmente importante en el ámbito educativo, donde los estudiantes utilizan cada vez más herramientas de humanización o intentan dar indicaciones a los modelos de lenguaje para evitar que el texto resultante parezca «demasiado generado por IA».

Detección de publicaciones breves en redes sociales generadas por IA

Dada la gran difusión de nuestro bot de X, que la gente ha utilizado para detectar si los tuits contienen texto generado por IA, últimamente nos hemos centrado especialmente en mejorar la detección de contenidos breves en línea, del tamaño de un tuit. También hemos reducido el número mínimo de palabras de 75 a 50, ya que consideramos que ahora tenemos más confianza en nuestra capacidad para distinguir las publicaciones generadas por IA que contienen entre 50 y 75 palabras.

Con una tasa de falsos positivos equivalente a la de Pangram 3.1, en Pangram 3.2 hemos mejorado la tasa de falsos negativos en las publicaciones breves de las redes sociales en un 17 %.

Mejoras de Claude 4.6

Varios usuarios han informado de falsos negativos específicamente con Claude Opus 4.6. Hemos solucionado este problema regenerando nuestro conjunto de datos para incluir datos de Claude Opus 4.6. Tras evaluarlo con nuestros conjuntos de datos de prueba internos (especialmente con ejemplos difíciles) y mediante pruebas de seguridad (red teaming), ahora estamos seguros de que Pangram es capaz de detectar Claude Opus 4.6 tan bien como cualquier otro modelo de lenguaje grande (LLM) de vanguardia.

¿Qué viene ahora?

Matemáticas, programación y ciencias generadas por IA

Actualmente, el código y las fórmulas matemáticas generados por IA no se detectan con un alto nivel de precisión. En estos momentos nos estamos centrando en estos casos de uso debido a la gran demanda de los clientes. Aunque las fórmulas matemáticas y el código siguen patrones más fijos y, por lo tanto, son más difíciles de detectar que los textos generados por IA, algunos de nuestros primeros experimentos están arrojando resultados prometedores.

Iteración continua sobre los «humanizadores»

El mercado de los humanizadores está en constante evolución, y en los últimos meses ha aparecido una mayor variedad de ellos. Estamos desarrollando técnicas más avanzadas para detectarlos, que esperamos poder dar a conocer públicamente en breve.

El futuro

Pangram se compromete a mantenerse siempre a la vanguardia de lo que es posible en materia de detección de IA. Estamos en constante evolución a medida que aumentan las capacidades de los modelos de lenguaje grande (LLM).

¡También estamos contratando! Echa un vistazo a nuestra página de empleo para ayudarnos a crear los mejores detectores de IA del mundo.

Katherine Thai es investigadora científica fundadora en el ámbito de la inteligencia artificial en Pangram Labs, una empresa emergente dedicada a la detección mediante IA. En diciembre de 2025, completó su doctorado en Informática bajo la supervisión de Mohit Iyyer en la Universidad de Massachusetts Amherst, donde su trabajo se centró en la evaluación de modelos de lenguaje a gran escala (LLM) en tareas relacionadas con el análisis literario.

Lecturas relacionadas

¿Pueden los detectores de IA detectar GPT-4.5?

¿Pangram detecta Llama 4 de Meta?

Informe técnico sobre la detección de texto generado por IA de alta precisión

Cómo detectar IA en Google Docs

¿Qué tal funciona Pangram en los humanizadores? (Actualizado en agosto de 2025)

Pangram 3.0: cuantificación del alcance de la edición mediante IA en textos

para recibir nuestras actualizaciones.