Descubre al instante qué publicaciones son de personas y cuáles de IA en Twitter, LinkedIn, Substack y otras plataformas. Descarga nuestra nueva extensión para Chrome.

Índice

- ¿Utilizan las facultades de Derecho detectores de IA en los ensayos de admisión?

- ¿Se utilizan detectores de IA en los trabajos de la facultad de Derecho?

- El problema de la «jerga jurídica»: ¿recibiré un falso positivo?

- Cómo orientarse entre las políticas sobre IA en la formación jurídica

- Buenas prácticas para proteger tu expediente académico

Estudiar Derecho implica leer mucho y escribir bastante. Es muy tentador utilizar herramientas de IA generativa como ChatGPT, sobre todo porque pueden redactar cartas de presentación, resúmenes de casos y notas de investigación.

Esta guía aborda la evolución de las políticas de las distintas facultades de Derecho y explica por qué debes actuar con extrema cautela a la hora de integrar la inteligencia artificial en tu formación jurídica.

¿Utilizan las facultades de Derecho detectores de IA en los ensayos de admisión?

La respuesta a esta pregunta es «Sí». Muchas oficinas de admisión de facultades de Derecho, asesores independientes especializados en estudios de Derecho y bufetes de abogados utilizan activamente programas de detección de IA para garantizar que las cartas de presentación y los ensayos sobre diversidad que componen una solicitud sean obra auténtica del solicitante en cuestión.

Las facultades de Derecho buscan admitir a personas con perspectivas únicas y voces auténticas, así como con la fortaleza intelectual necesaria para tener éxito en sus programas. Un ensayo generado por ChatGPT es, por naturaleza, genérico y, en última instancia, va en contra del propósito de una carta de presentación.

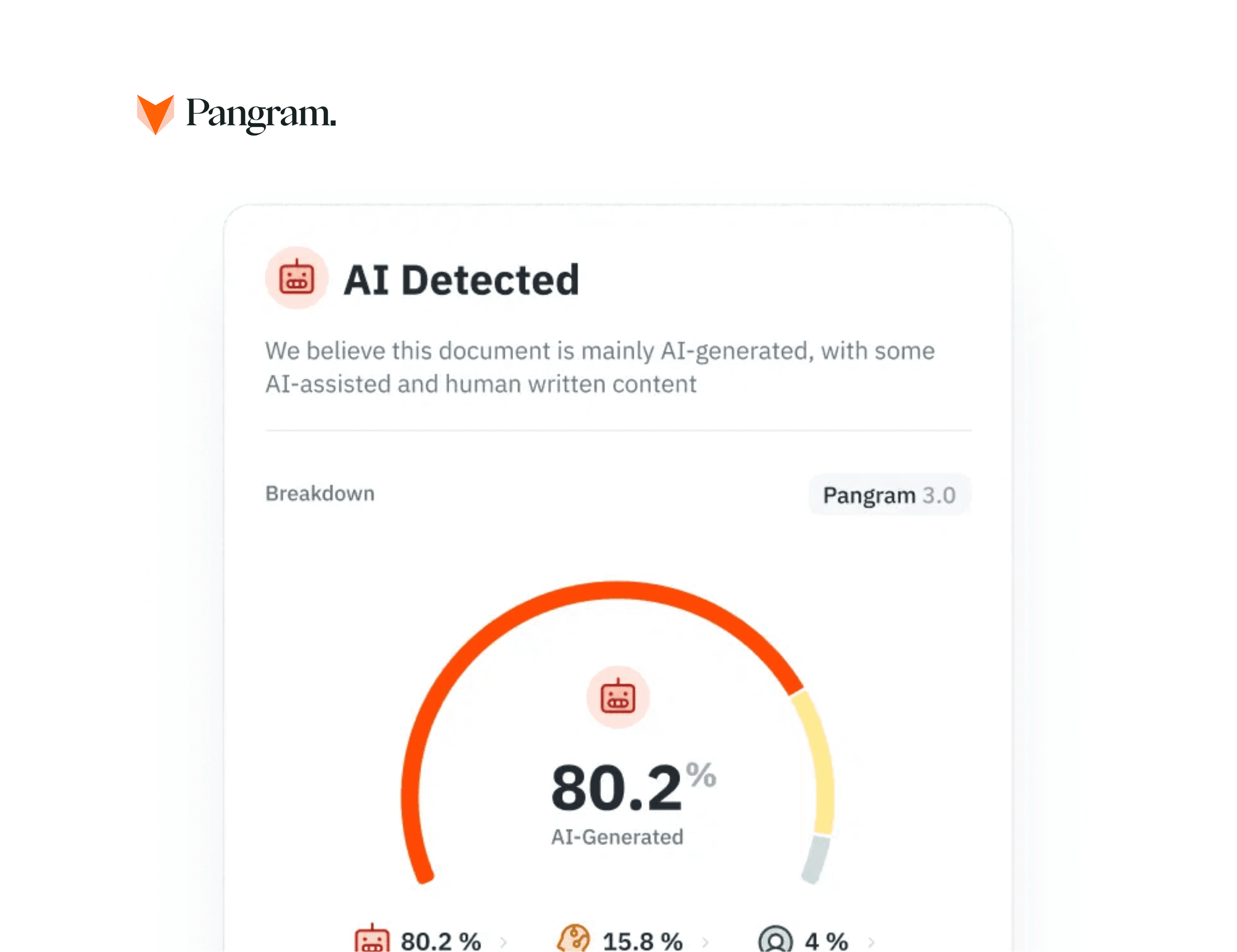

Las admisiones en las facultades de Derecho utilizan sistemas de detección de IA desde el inicio del proceso. Las consultoras de admisión de primer nivel —como, por ejemplo, Gradpilot— integran herramientas como Pangram directamente en su proceso de revisión. De este modo, pueden detectar si un solicitante ha recurrido en exceso a la IA incluso antes de que el ensayo se envíe al LSAC.

¿Se utilizan detectores de IA en los trabajos de la facultad de Derecho?

Sí, las oficinas de integridad académica y los profesores de Derecho utilizan detectores de IA de nivel empresarial integrados en sus sistemas de gestión del aprendizaje para revisar todo tipo de trabajos de la facultad de Derecho. Entre los trabajos que revisan se incluyen trabajos de redacción jurídica, informes de investigación y exámenes para realizar en casa.

En cualquier tipo de redacción jurídica, la precisión y la autenticidad son requisitos imprescindibles. El uso de modelos de lenguaje grande (LLM) como ChatGPT resulta problemático, ya que tienden a inventarse jurisprudencia, citas y «hechos» jurídicos. Por ello, recurrir a la IA para realizar trabajos jurídicos no solo conlleva el riesgo de ser acusado de plagio, sino también de sufrir graves sanciones académicas por inventarse precedentes jurídicos.

Los profesores utilizan las puntuaciones generadas por la IA como herramienta de diagnóstico. Combinan el diagnóstico de un detector de IA diseñado para facultades de Derecho con su propio conocimiento de las habilidades de redacción previas del estudiante para investigar posibles casos de falta de honestidad académica. Este enfoque combinado, cuando se aplica, facilita la detección del uso de la IA.

El problema de la «jerga jurídica»: ¿recibiré un falso positivo?

Los detectores de IA estándar y gratuitos son conocidos por marcar erróneamente como generados por IA textos muy formales y estructurados, como los memorandos jurídicos, por ejemplo. Sin embargo, este no es el caso de las herramientas empresariales que utilizan las universidades para detectar la presencia de IA en documentos jurídicos; estas herramientas están entrenadas para evitar este error y ofrecer evaluaciones precisas sobre el uso de la IA.

La perplejidad es lo que buscan los detectores de IA estándar y gratuitos. La perplejidad es una medida de la sorpresa estadística, lo que significa que los detectores de IA básicos buscan previsibilidad y un alto nivel de estructura para detectar el uso de la IA.

Documentos como la «Declaración de Independencia» tienen una estructura muy definida y son muy predecibles, por lo que muchos detectores básicos de IA los identifican como generados por IA. Sin embargo, las herramientas que utilizan las universidades son mucho más precisas en sus evaluaciones.

Si eres un estudiante que redacta sus propios trabajos y utiliza la IA únicamente de la forma permitida, no tienes nada de qué preocuparte. Las herramientas universitarias de alta calidad, como Pangram, utilizan el método «Hard Negative Mining» para distinguir la sintaxis formal y correcta del texto generado por IA. Esto se traduce en una tasa de falsos positivos prácticamente nula, de 1 entre 10 000.

Cómo orientarse entre las políticas sobre IA en la formación jurídica

Cada facultad de Derecho tiene sus propias políticas en materia de inteligencia artificial. Algunos profesores son estrictos: la inteligencia artificial está totalmente prohibida. Otros profesores se muestran mucho más abiertos a esta tecnología e incorporan la inteligencia artificial en sus planes de estudios para enseñar a los futuros abogados a utilizar la tecnología jurídica de forma responsable.

En la actualidad, el sector jurídico está incorporando la IA generativa para tareas rutinarias. Entre estas tareas se incluyen la revisión de documentos y el análisis de contratos. Por este motivo, algunos profesores permiten el uso de la IA para la generación de ideas o la elaboración de esquemas, aunque, en la mayoría de los casos, solo si se incluye una declaración de atribución relativa a la IA utilizada.

Si el programa de estudios de una facultad de Derecho concreta o de un profesor de Derecho no indica explícitamente que se permite el uso de un modelo de lenguaje grande (LLM) para realizar un trabajo, debes dar por hecho que su uso está estrictamente prohibido. Si existe una política de ChatGPT para la facultad de Derecho o una serie de directrices relativas al uso de modelos de lenguaje grandes (LLM), debes cumplir con dicha política o directrices.

La presentación de cualquier tipo de texto generado por inteligencia artificial sin indicarlo se considera, en general, un fraude académico. Si se te declara culpable de fraude académico, podrías enfrentarte a graves consecuencias, entre las que destaca la expulsión.

Buenas prácticas para proteger tu expediente académico

Los estudiantes de Derecho y los aspirantes a estudiar esta carrera deben seguir estas recomendaciones para proteger su expediente académico: redacten siempre trabajos originales, mantengan un registro del historial de versiones, conserven dicho historial tras entregar un trabajo y revisen previamente sus documentos para comprobar si han utilizado la inteligencia artificial para realizar correcciones gramaticales sencillas, generar ideas o cualquier otra tarea.

Además de aplicar esas buenas prácticas, deberías revisar tu trabajo en busca de expresiones típicas de la IA. Las palabras «profundizar», «tapiz» y «fundamental» son algunas de las expresiones más comunes de la IA. Usar estas palabras en exceso podría despertar las sospechas de alguien y hacerle pensar que has utilizado IA.

Si utilizas cualquier tipo de herramienta de IA para la corrección ortográfica, un corrector de IA especializado en redacción jurídica como Pangram puede distinguir entre revisiones gramaticales «ligeramente asistidas por IA» y textos «generados íntegramente por IA». Ser capaz de distinguir entre ambos puede ayudarte a demostrar que tú mismo has redactado los argumentos principales de un documento concreto.

Las facultades de Derecho están supervisando de cerca el uso de la inteligencia artificial para proteger la integridad de la profesión jurídica y de quienes la ejercen.

Aunque la inteligencia artificial es una herramienta muy eficaz para la síntesis, no puede sustituir al riguroso razonamiento jurídico y al pensamiento crítico que se requieren para obtener un título de Derecho.

Asegúrate de que tu carta de presentación o tu informe jurídico sea totalmente original. Comprueba la autenticidad del texto antes de enviarlo.

Lecturas relacionadas

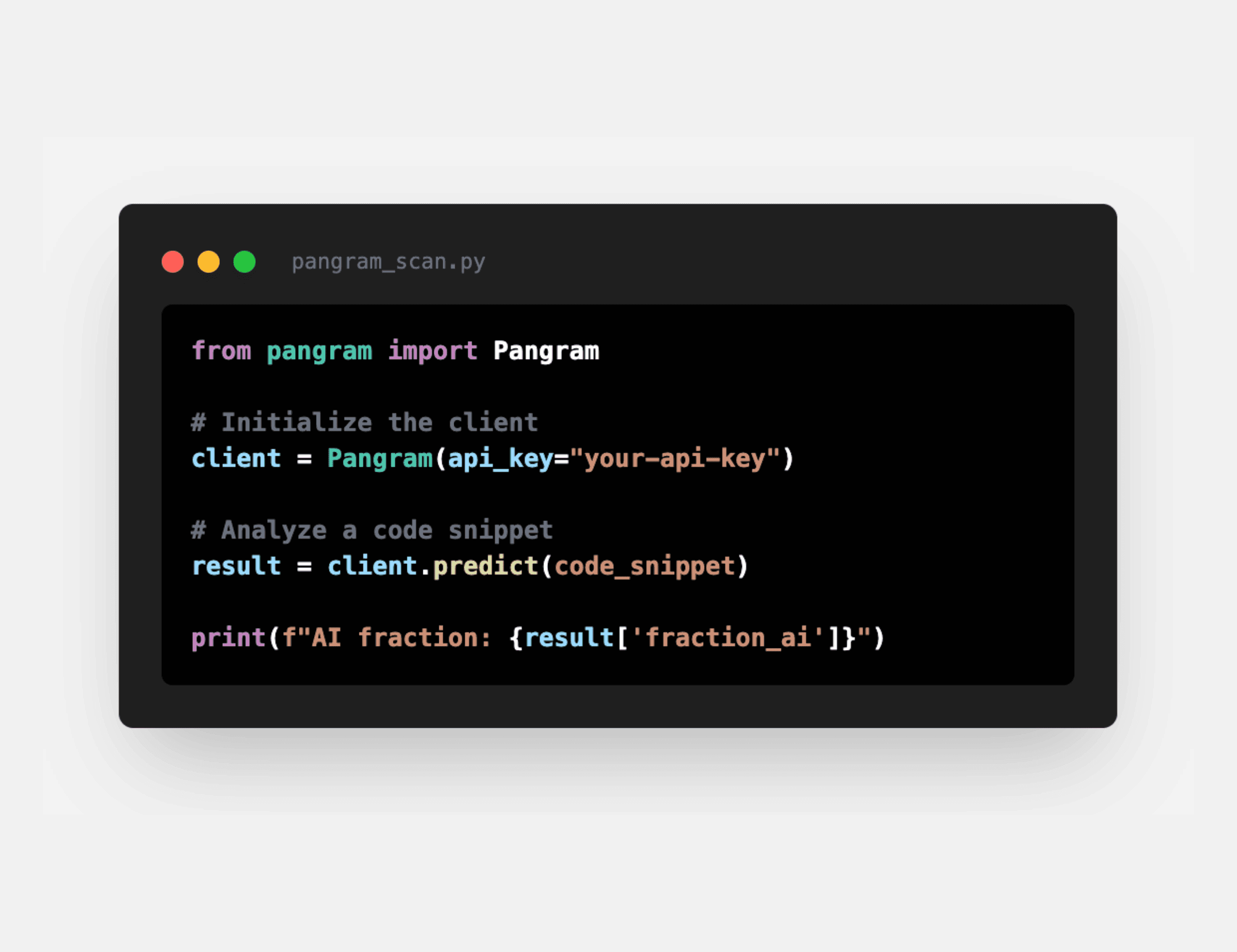

¿Qué tal funciona Pangram en el código de IA?

¿Qué significa tu puntuación de detección de IA?

Detector de código de IA: cómo comprobar si el código ha sido escrito por ChatGPT, Copilot o Claude

¿Lo ha escrito la IA? 4 formas de comprobar si un texto ha sido generado

Un enfoque mosaico de la integridad académica en la era de la IA (con Chris Ostro)

Presentamos la detección de plagio de Pangram

para recibir nuestras actualizaciones.