Descubre al instante qué publicaciones son de personas y cuáles de IA en Twitter, LinkedIn, Substack y otras plataformas. Descarga nuestra nueva extensión para Chrome.

Detector de código de IA: cómo comprobar si el código ha sido escrito por ChatGPT, Copilot o Claude

Índice

- ¿Por qué es tan difícil detectar el código de IA? (El problema de los «grados de libertad»)

- Caso de uso 1: Seguridad del software y gestión de la propiedad intelectual

- Caso práctico 2: Contratación de personal técnico y evaluaciones de desarrolladores

- Patrones a tener en cuenta: cómo detectar manualmente el código generado por IA

- Cómo funciona el detector de código de IA de Pangram

GitHub, Copilot, ChatGPT y Claude son asistentes de programación basados en IA. Permiten a los desarrolladores de software generar código a un ritmo más rápido. Esto ha revolucionado la productividad de los desarrolladores. Dicho esto, este aumento de la velocidad conlleva riesgos ocultos. La seguridad de la cadena de suministro de software, las cuestiones relacionadas con los derechos de autor y la integridad en la contratación se ven afectadas.

El sistema MOSS de Stanford suele ser capaz de determinar si un script ha sido generado por IA, pero un desarrollador con experiencia puede ajustar el orden de los métodos y modificar las variables para pasar desapercibido. Además, solo está disponible para uso no comercial. Para determinar con certeza si un código ha sido generado por IA se requiere una infraestructura especializada. Plataformas empresariales como Pangram están entrando ahora en escena para ofrecer servicios específicos de detección de código generado por IA.

Si te preguntas:«¿Se puede detectar el código generado por IA?», la respuesta es «Sí». Detectar código generado por IA es algo fundamentalmente diferente —y más difícil— que detectar texto generado por IA. En esta guía se analizan los siguientes puntos:

- Los patrones del código generado por ordenador.

- Casos de uso de la detección en el ámbito empresarial.

- Cómo implementar una estrategia de gobernanza «Human-in-the-Loop» para detectar código generado por IA.

Detección de pangramas mediante IA para desarrolladores

Detección de pangramas mediante IA para desarrolladores¿Por qué es tan difícil detectar el código de IA? (El problema de los «grados de libertad»)

El código generado por IA es más difícil de detectar que el escrito por humanos, ya que los lenguajes de programación tienen menos «grados de libertad». Un desarrollador dispone de menos opciones estilísticas y estructurales. Esto es especialmente cierto si se compara con las numerosas opciones estilísticas y estructurales de que dispone un autor.

Lenguajes como C y el ensamblador tienen requisitos sintácticos muy estrictos. Si un ser humano intenta resolver un problema, es posible que desarrolle la función más eficiente para ese problema. Una IA también podría desarrollar ese mismo código, ya que se trata de la función más eficiente. Tanto un ser humano como una IA pueden generar un código matemáticamente idéntico.

El código estándar predefinido no contiene apenas indicios estadísticos. Un detector de IA no podrá clasificar con certeza este tipo de código como generado por IA o escrito por humanos. Lo mismo ocurre con los archivos de configuración sencillos.

Caso de uso 1: Seguridad del software y gestión de la propiedad intelectual

Los directores de tecnología (CTO) y los equipos de operaciones jurídicas utilizan detectores de código de IA para verificar el origen de su código fuente. Lo hacen para asegurarse de que sus desarrolladores no publiquen propiedad intelectual de IA que no pueda protegerse con derechos de autor, ni lógica alucinada o vulnerable.

En Estados Unidos, los contenidos generados íntegramente por inteligencia artificial no pueden protegerse mediante derechos de autor. Si el producto principal de una startup fuera generado por completo por Copilot sin supervisión humana, es posible que dicha startup no pudiera protegerlo mediante derechos de autor.

Un detector de código generado por IA es un primer paso fundamental en los flujos de trabajo de seguridad. Si se identifica un fragmento de código como generado al 100 % por IA, es necesario someterlo a una rigurosa revisión de seguridad manual. Esta revisión debe realizarse antes de que se incorpore el código.

Caso práctico 2: Contratación de personal técnico y evaluaciones de desarrolladores

Los responsables de selección de personal utilizan un detector de código basado en IA en las pruebas técnicas que se realizan en casa. Recurren a este detector para asegurarse de que los candidatos comprenden la lógica del código que envían. No buscan candidatos que se limiten a copiar y pegar los resultados de ChatGPT, sino candidatos que comprendan la lógica que hay detrás de esos resultados.

Un desarrollador que confíe por completo en un modelo de lenguaje grande (LLM) para superar una prueba de programación probablemente fracasará cuando se le pida que depure sistemas heredados complejos y sin documentar. El código es complejo. Un desarrollador que no sea capaz de lidiar con estas complejidades sin ChatGPT podría no estar en condiciones de desempeñar su función.

En lugar de prohibir la IA de forma generalizada, los responsables de selección de personal utilizan herramientas de detección para plantear preguntas en las entrevistas. He aquí un ejemplo: «Veo que esta función depende en gran medida de la asistencia de la IA. ¿Podrías explicarme por qué el modelo eligió esta estructura de bucle concreta?».

Patrones a tener en cuenta: cómo detectar manualmente el código generado por IA

Para garantizar la precisión en la detección de IA en grandes volúmenes, se necesita software. Sin embargo, en el caso de volúmenes más reducidos, los revisores manuales pueden detectar el código de IA prestando atención a:

- Estilos de comentarios muy específicos.

- Exceso de documentación.

- Gran similitud interna.

Los modelos de IA, como Claude o ChatGPT, están entrenados para ser útiles. Esto hace que añadan comentarios exhaustivos y poco naturales en cada línea de código. Los desarrolladores humanos rara vez hacen esto, por lo que los comentarios de este tipo delatan que se trata de una IA.

En entornos académicos o de selección de personal, el código generado por IA suele ser idéntico en múltiples envíos. MOSS puede poner de relieve esta similitud. Esto permite que MOSS sirva como un indicador secundario de la generación por IA. Otras herramientas también pueden hacerlo.

Cómo funciona el detector de código de IA de Pangram

Para comprobar si un código ha sido generado por IA, Pangram utiliza el aprendizaje profundo. El aprendizaje profundo se utiliza para identificar la huella estadística de los modelos de IA.

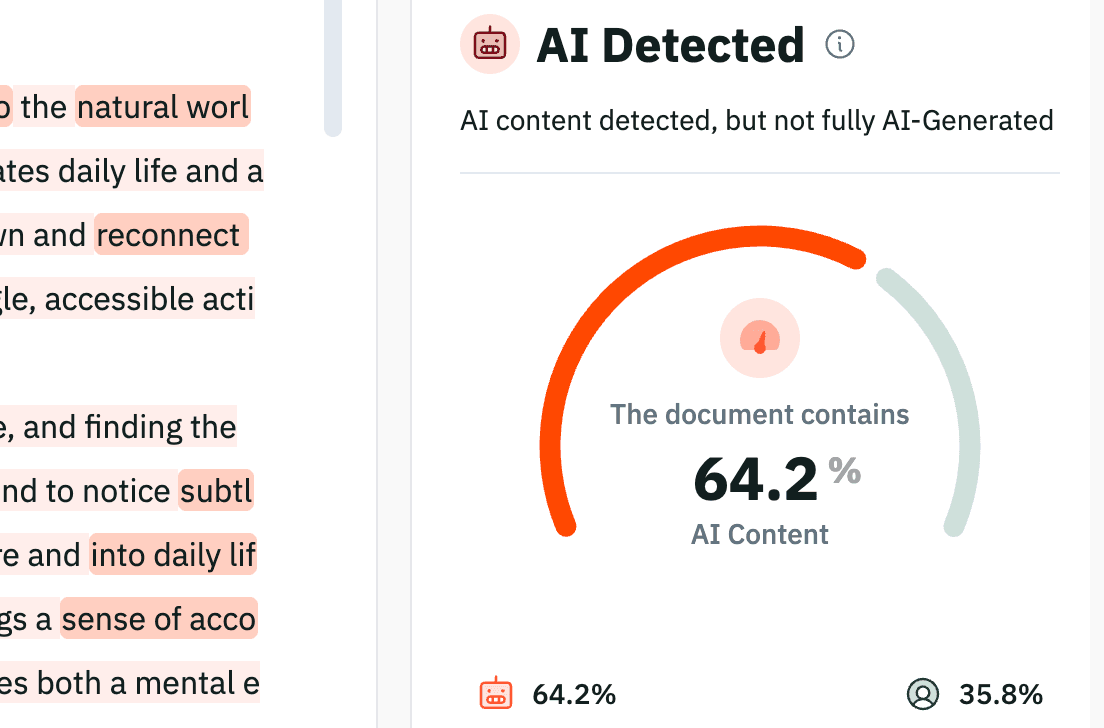

Pangram tiene una tasa de precisión del 96,2 %. Además, su tasa de falsos positivos es prácticamente nula, situándose en el 0,3 %. Esto se debe en gran medida al aprendizaje profundo.

Precisión de Pangram en códigos de más de 40 líneas

Precisión de Pangram en códigos de más de 40 líneasA diferencia de otros detectores de código generado por IA, Pangram es deliberadamente conservador. Está diseñado para pasar por alto algunas plantillas típicas de la IA: Pangram tiene una tasa de falsos negativos del 8,5 % en fragmentos largos de código. El objetivo es garantizar que nunca acuse erróneamente a un desarrollador humano.

Los equipos de ingeniería y de selección de personal pueden integrar Pangram a la perfección en sus flujos de trabajo corporativos. Pueden hacerlo a través del SDK de Python para la detección de código mediante IA de Pangram. O bien, pueden utilizar la API de Pangram. Ambas opciones permiten la comprobación automatizada del código mediante IA dentro de los flujos de trabajo existentes de Git o ATS.

Verificación de la integridad del código

Los asistentes de programación basados en IA son herramientas muy potentes que aceleran el desarrollo de todo tipo de software. Sin embargo, no se puede confiar ciegamente en ellos para crear una infraestructura segura y propia.

Al integrar un detector de código basado en IA de gran precisión en su flujo de trabajo, los equipos de ingeniería y de selección de personal pueden:

- Asegurar la cadena de suministro de su software.

- Proteger su propiedad intelectual.

- Asegurarse de que contratan a los mejores profesionales.

Comprueba la procedencia y la originalidad de tu código fuente con la plataforma de detección mediante IA más precisa del sector.

Alex Roitman es director de Crecimiento en Pangram Labs, una empresa dedicada a la detección de contenidos mediante IA. Su trabajo se centra en cómo el texto generado por IA está transformando la escritura, la educación y la confianza en la web abierta.

Lecturas relacionadas

¿Qué tal funciona Pangram en el código de IA?

Sí, la detección de IA puede ser precisa.

¿Google penalizará el contenido generado por IA en 2026?

¿Lo ha escrito la IA? 4 formas de comprobar si un texto ha sido generado

La integridad académica no consiste solo en pillar a los que copian. Se trata de enseñar a los estudiantes a asumir sus errores.

¿Las oficinas de admisión de las universidades comprueban si se ha utilizado IA?

para recibir nuestras actualizaciones.