اعرف على الفور ما هو منشور بواسطة البشر وما هو منشور بواسطة الذكاء الاصطناعي على تويتر ولينكدإن وسوبستاك وغيرها. احصل على ملحق كروم الجديد الخاص بنا.

كاشف كود الذكاء الاصطناعي: كيفية التحقق مما إذا كان الكود قد كُتب بواسطة ChatGPT أو Copilot أو Claude

جدول المحتويات

تعد GitHub وCopilot وChatGPT وClaude مساعدات برمجية تعمل بالذكاء الاصطناعي. فهي تتيح لمطوري البرمجيات إنتاج الأكواد بوتيرة أسرع. وقد أحدث ذلك ثورة في إنتاجية المطورين. ومع ذلك، فإن هذه السرعة المتزايدة تنطوي على مخاطر خفية. فهي تؤثر على أمن سلسلة توريد البرمجيات، وقضايا حقوق النشر، ونزاهة عمليات التوظيف.

يمكن لبرنامج MOSS التابع لجامعة ستانفورد عمومًا تحديد ما إذا كان البرنامج النصي قد تم إنشاؤه بواسطة الذكاء الاصطناعي، لكن المطور المتمرس يمكنه تعديل ترتيب الطرق وتغيير المتغيرات ليتجنب الكشف. كما أنه متاح للاستخدام غير التجاري فقط. ويتطلب تحديد ما إذا كان الكود قد تم إنشاؤه بواسطة الذكاء الاصطناعي بنية تحتية متخصصة. وتدخل الآن منصات المؤسسات مثل Pangram لتوفير خدمات مخصصة للكشف عن الكود الذي تم إنشاؤه بواسطة الذكاء الاصطناعي.

إذا كنت تتساءل:«هل يمكن الكشف عن الشفرة التي أنشأتها الذكاء الاصطناعي؟»، فإن الإجابة هي «نعم». يختلف الكشف عن الشفرة التي أنشأتها الذكاء الاصطناعي اختلافًا جوهريًا عن الكشف عن النص الذي أنشأته الذكاء الاصطناعي، كما أنه أكثر صعوبة. يتناول هذا الدليل النقاط التالية:

- أنماط الشفرات التي تولدها الآلة.

- حالات الاستخدام المؤسسي لأغراض الكشف.

- كيفية تطبيق استراتيجية حوكمة تعتمد على تدخل الإنسان (Human-in-the-Loop) للكشف عن الشفرات التي تم إنشاؤها بواسطة الذكاء الاصطناعي.

أداة "Pangram" للكشف عن الذكاء الاصطناعي للمطورين

أداة "Pangram" للكشف عن الذكاء الاصطناعي للمطورينلماذا يصعب اكتشاف كود الذكاء الاصطناعي؟ (مشكلة «درجات الحرية»)

يصعب اكتشاف الشفرة التي يُنتجها الذكاء الاصطناعي أكثر من تلك التي يكتبها الإنسان، لأن لغات البرمجة تتمتع بـ«درجات حرية» أقل؛ فهناك خيارات أسلوبية وهيكلية أقل متاحة للمطور. وينطبق هذا بشكل خاص عند مقارنتها بالخيارات الأسلوبية والهيكلية العديدة المتاحة للمؤلف.

تتسم لغات البرمجة مثل C و Assembly بمتطلبات نحوية صارمة للغاية. إذا حاول الإنسان حل مشكلة ما، فقد يطور الدالة الأكثر كفاءة لحل هذه المشكلة. وقد يطور الذكاء الاصطناعي أيضًا هذا الكود نفسه، لأنها الدالة الأكثر كفاءة. وقد ينتج كل من الإنسان والذكاء الاصطناعي كودًا متطابقًا من الناحية الحسابية.

لا يحتوي الكود النموذجي القياسي على الكثير من المؤشرات الإحصائية. ولن يتمكن كاشف الذكاء الاصطناعي من تصنيف هذا النوع من الكود بثقة على أنه مُنتج بواسطة الذكاء الاصطناعي أو مكتوب بواسطة الإنسان. وينطبق هذا أيضًا على ملفات التكوين البسيطة.

حالة الاستخدام 1: أمن البرمجيات وإدارة الملكية الفكرية

يستخدم الرؤساء التنفيذيون للتكنولوجيا وفرق العمليات القانونية أدوات الكشف عن أكواد الذكاء الاصطناعي للتحقق من مصادر قاعدة أكوادهم البرمجية. ويقومون بذلك للتأكد من أن مطوريهم لا ينشرون ملكية فكرية للذكاء الاصطناعي لا يمكن حمايتها بحقوق النشر، أو منطقًا وهميًا أو ضعيفًا.

في الولايات المتحدة، لا يمكن تسجيل حقوق الطبع والنشر للمحتوى الذي تم إنشاؤه بالكامل بواسطة الذكاء الاصطناعي. فإذا كان المنتج الأساسي لإحدى الشركات الناشئة قد تم إنشاؤه بالكامل بواسطة Copilot دون إشراف بشري، فقد لا تتمكن هذه الشركة من تسجيل حقوق الطبع والنشر لهذا المنتج.

يُعد كاشف الكود الذي يعتمد على الذكاء الاصطناعي خطوة أولى حاسمة في سير عمل الأمان. فإذا تم الإبلاغ عن جزء من الكود على أنه مُنتج بنسبة 100% بواسطة الذكاء الاصطناعي، فإنه يحتاج إلى مراجعة أمنية يدوية دقيقة. ويجب إجراء هذه المراجعة قبل دمج الكود.

حالة الاستخدام 2: التوظيف في المجال التقني وتقييم المطورين

يستخدم مديرو التوظيف أداة كشف الغش القائمة على الذكاء الاصطناعي في المهام الفنية التي يُطلب من المرشحين إجراؤها في المنزل. ويستخدمون هذه الأداة للتأكد من أن المرشحين يفهمون المنطق الكامن وراء الحلول التي يقدمونها. ولا يرغب مديرو التوظيف في توظيف مرشحين يقومون بنسخ ولصق مخرجات ChatGPT، بل يبحثون عن مرشحين يفهمون المنطق الكامن وراء هذه المخرجات.

من المرجح أن يفشل المطور الذي يعتمد كليًا على نموذج اللغة الكبيرة (LLM) لاجتياز اختبار البرمجة عندما يُطلب منه تصحيح أخطاء أنظمة قديمة معقدة وغير موثقة. فالبرمجة أمر معقد. وقد يعجز المطور الذي لا يستطيع التعامل مع هذه التعقيدات دون ChatGPT عن أداء مهامه.

بدلاً من فرض حظر شامل على الذكاء الاصطناعي، يستخدم مسؤولو التوظيف أدوات الكشف لتوجيه أسئلة خلال المقابلات. وإليك مثال على ذلك: "أرى أن هذه الوظيفة تعتمد بشكل كبير على مساعدة الذكاء الاصطناعي. هل يمكنك أن تشرح لي لماذا اختار النموذج بنية الحلقة هذه بالتحديد؟"

الأنماط التي يجب البحث عنها: كيفية التعرف يدويًا على كود الذكاء الاصطناعي

يلزم استخدام برامج لتحقيق دقة عالية في الكشف عن البرمجة الآلية (AI) عند التعامل مع كميات كبيرة من الكود. لكن، عند التعامل مع كميات أصغر، يمكن للمراجعين اليدويين الكشف عن الكود الآلي من خلال البحث عن:

- أنماط التعليق شديدة التحديد.

- الإفراط في التوثيق.

- تشابه داخلي شديد.

يتم تدريب نماذج الذكاء الاصطناعي، مثل Claude/ChatGPT، على تقديم المساعدة. ويؤدي ذلك إلى قيامها بإدراج تعليقات مستفيضة وغير طبيعية لكل سطر من سطور الكود. ونادراً ما يقوم المطورون البشريون بذلك، مما يجعل التعليقات من هذا النوع دلالة على استخدام الذكاء الاصطناعي.

في الأوساط الأكاديمية أو في سياقات التوظيف، غالبًا ما يبدو كود الذكاء الاصطناعي متطابقًا عبر عدة مشاركات. ويمكن لـ MOSS تسليط الضوء على هذا التشابه. وهذا يتيح لـ MOSS أن يكون بمثابة مؤشر ثانوي على أن النص تم إنشاؤه بواسطة الذكاء الاصطناعي. وهناك أدوات أخرى قادرة على القيام بذلك أيضًا.

كيف يعمل كاشف الأكواد بالذكاء الاصطناعي من Pangram

للتحقق مما إذا كان الكود قد تم إنشاؤه بواسطة الذكاء الاصطناعي، يستخدم Pangram تقنية التعلم العميق. وتُستخدم تقنية التعلم العميق لتحديد البصمة الإحصائية لنماذج الذكاء الاصطناعي.

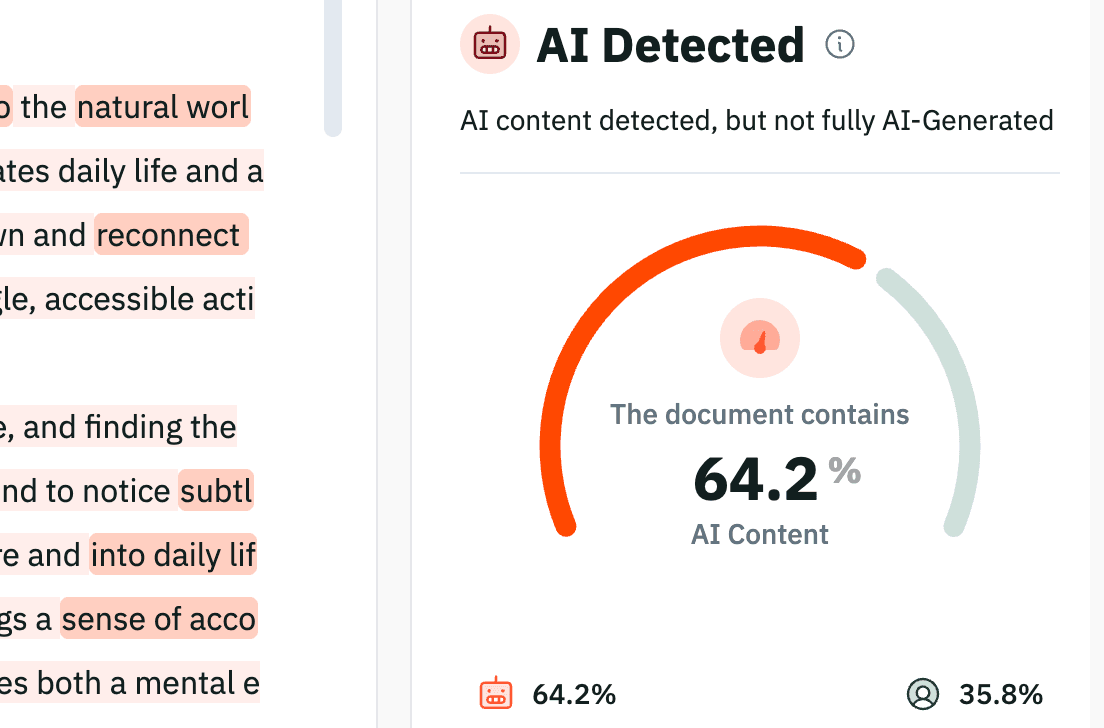

تبلغ دقة نظام «بانجرام» 96.2%. كما أن معدل الإيجابيات الخاطئة لديه يقترب من الصفر، حيث يبلغ 0.3%. ويعزى ذلك إلى حد كبير إلى تقنية التعلم العميق.

دقة بانغرام في فك الشفرات التي يزيد طولها عن 40 سطراً

دقة بانغرام في فك الشفرات التي يزيد طولها عن 40 سطراًعلى عكس أدوات الكشف عن الكود المكتوب بواسطة الذكاء الاصطناعي الأخرى، يتسم Pangram بطابع متحفظ عن قصد. فقد صُمم بحيث يتجاهل بعض النصوص النمطية التي يكتبها الذكاء الاصطناعي — حيث يبلغ معدل النتائج السلبية الخاطئة لـ Pangram 8.5% عند تحليل مقتطفات طويلة من الكود. ويهدف ذلك إلى ضمان عدم اتهامه مطورًا بشريًا زورًا بأي حال من الأحوال.

يمكن لفرق الهندسة والتوظيف دمج Pangram بسلاسة في سير عمل مؤسساتهم. ويمكنهم القيام بذلك من خلال حزمة تطوير البرامج (SDK) الخاصة بلغة Python المخصصة لاكتشاف الأكواد باستخدام الذكاء الاصطناعي من Pangram. أو يمكنهم استخدام واجهة برمجة التطبيقات (API) الخاصة بـ Pangram. ويتيح هذان الخياران إجراء فحص آلي للأكواد باستخدام الذكاء الاصطناعي ضمن سير عمل Git أو ATS الحالي.

التحقق من سلامة الكود

تعد مساعدات البرمجة التي تعمل بالذكاء الاصطناعي أدوات قوية تعمل على تسريع عملية تطوير البرمجيات بجميع أنواعها. لكن لا يمكن الوثوق بها بشكل أعمى لكتابة بنية تحتية آمنة ومملوكة.

من خلال دمج أداة دقيقة للكشف عن الأكواد باستخدام الذكاء الاصطناعي في سير عملها، يمكن لفرق الهندسة والتوظيف:

- تأمين سلسلة توريد برمجياتهم.

- حماية حقوق الملكية الفكرية الخاصة بهم.

- التأكد من توظيف كفاءات متميزة.

تحقق من مصدر وأصالة قاعدة الكود الخاصة بك باستخدام منصة الكشف بالذكاء الاصطناعي الأكثر دقة في القطاع.

أليكس رويتمان هو رئيس قسم النمو في شركة «بانغرام لابس»، وهي شركة متخصصة في الكشف عن المحتوى المُنتج بواسطة الذكاء الاصطناعي. يركز عمله على الكيفية التي يُعيد بها النص المُنتج بواسطة الذكاء الاصطناعي تشكيل ملامح الكتابة والتعليم والثقة في شبكة الإنترنت المفتوحة.

مقالات ذات صلة

ما مدى فعالية Pangram في عمل كود الذكاء الاصطناعي؟

نعم، يمكن أن يكون الكشف عن الذكاء الاصطناعي دقيقًا

هل ستعاقب Google المحتوى الذي تم إنشاؤه بواسطة الذكاء الاصطناعي في عام 2026؟

هل كتبته الذكاء الاصطناعي؟ 4 طرق للتحقق مما إذا كان النص قد تم إنشاؤه آليًا

النزاهة الأكاديمية لا تقتصر على ضبط الغشاشين فحسب، بل تتعلق بتعليم الطلاب تحمل مسؤولية أخطائهم.

هل تتحقق مكاتب القبول الجامعية من استخدام الذكاء الاصطناعي؟

للحصول على آخر المستجدات