Índice

- Un panorama marcado por unas directrices fragmentadas y poco claras

- ¿Hacia dónde vamos desde aquí?: Principios fundamentales de una política ética sobre la IA en el periodismo

- La amenaza del sesgo algorítmico y la «baba rosa»

- Casos prácticos: ¿Qué medios de comunicación están marcando el camino?

- Aplicación: cómo las redacciones pueden hacer cumplir la ética

No hay ningún sector que se haya librado de la inteligencia artificial.

Todas las profesiones, desde médicos y abogados hasta profesionales del marketing e influencers de las redes sociales, se han visto afectadas por los contenidos generados por IA. ¿Pero los periodistas? La profesión se basa en la confianza de los lectores; sin embargo, investigaciones recientes han revelado un auge del uso no regulado de la IA en el sector, llegando incluso a aparecer artículos generados por IA en las páginas de periódicos de gran tirada y confianza. Mientras que otros sectores revisan sus valores éticos para determinar el uso adecuado de la IA, el periodismo debe hacer lo mismo. Las herramientas de IA pueden automatizar tareas repetitivas y facilitar la narración basada en datos, pero la tecnología flaquea debido a sesgos y alucinaciones. La falta de una norma vinculante a nivel legal y para todo el sector sobre el uso adecuado de la IA deja a las redacciones navegando por estas aguas inexploradas por su cuenta. A continuación, exploraremos los marcos actuales para evaluar el uso ético de la IA en la redacción, analizaremos las lagunas y propondremos un enfoque ético consolidado centrado en la transparencia y la supervisión humana.

Un panorama marcado por unas directrices fragmentadas y poco claras

A medida que la tecnología de la inteligencia artificial avanza a pasos agigantados, la gobernanza ética se queda rezagada. Sin embargo, varias organizaciones internacionales de prestigio han tomado la iniciativa para intentar ponerse al día. Estas organizaciones están tratando de ayudar a las redacciones a recuperar el control editorial y la confianza de los lectores, al tiempo que siguen esforzándose por abordar toda la gama de dilemas a los que se enfrentan los editores, los responsables de publicación y sus redactores en la actualidad.

La Organización de las Naciones Unidas para la Educación, la Ciencia y la Cultura (UNESCO) aprobó en 2021 una serie de recomendaciones sobre la ética de la IA, centradas en la supervisión humana. La sección que describe las recomendaciones para el sector de la comunicación y la información ofrece algunas orientaciones para los periodistas. La política establece que los sistemas de IA deben promover la libertad de información, la libertad de expresión, la transparencia y la divulgación de datos oficiales. Anima a cualquier persona del sector de los medios de comunicación a incorporar la IA en su trabajo de manera ética. El marco también insta a los países a promover entornos transparentes y educativos en los que los medios de comunicación puedan informar sobre los perjuicios y beneficios de la IA, y los consumidores puedan desarrollar competencias digitales y de alfabetización mediática para combatir la desinformación y el discurso de odio.

Sin embargo, el marco relativo a los medios de comunicación solo ocupa cuatro párrafos de las 44 páginas que recogen las políticas éticas de la UNESCO en materia de IA. Apenas se hace referencia específica al periodismo ni a los periodistas, y la política se configura más bien como una declaración de valores y una petición general para que se elaboren políticas más exhaustivas en el futuro. No es mucho con lo que puedan trabajar los medios de comunicación.

El Instituto de Ingenieros Eléctricos y Electrónicos (IEEE) adoptó un enfoque similar. Su marco de «diseño alineado con la ética» potencia la libertad de los periodistas para informar al público sobre cuestiones relacionadas con la inteligencia artificial y la importancia del criterio humano y la supervisión. Sin embargo, la política es más bien una declaración de ideales y valores que una guía detallada para abordar los dilemas de la IA en una redacción. ¿Cómo deberían los medios de comunicación gestionar la divulgación del uso de la IA? ¿O hacer frente a los usos inadecuados? ¿Qué define un uso inadecuado? Toda esta incertidumbre trastorna a las redacciones y deja la confianza de la audiencia en el limbo, pero una política sólida puede proporcionar un mapa para este terreno inexplorado.

¿Hacia dónde vamos desde aquí?: Principios fundamentales de una política ética sobre la IA en el periodismo

Los editores, redactores y periodistas necesitan urgentemente unas directrices concretas, exhaustivas y éticamente sólidas para regular, informar y justificar adecuadamente los casos de uso de la IA en las redacciones. A la hora de elaborar una política de IA rigurosa y bien fundamentada, las redacciones deben basar sus directrices en cuatro principios innegociables: transparencia, responsabilidad, inclusividad y equidad.

A continuación se ofrece un punto de partida para aplicar estos principios al uso de la IA en la redacción:

- La transparencia implica que el uso de la IA se comunique a los lectores de forma clara, honesta y evidente. Tanto si los periodistas utilizan la IA para generar pistas, realizar investigaciones o crear material visual, su público siempre tiene derecho a saberlo.

- La rendición de cuentas consiste en atribuir la responsabilidad por los errores en los contenidos y las investigaciones generados por la IA. Las redacciones deben definir claramente quién es el responsable cuando el uso de la IA sale mal: ¿es el desarrollador del programa de IA? ¿El periodista? ¿El propio algoritmo? Una rendición de cuentas adecuada implica reconocer los errores y sancionar a la parte culpable. Por lo tanto, corresponde a las redacciones decidir quién es el responsable y cómo debe gestionarse la situación.

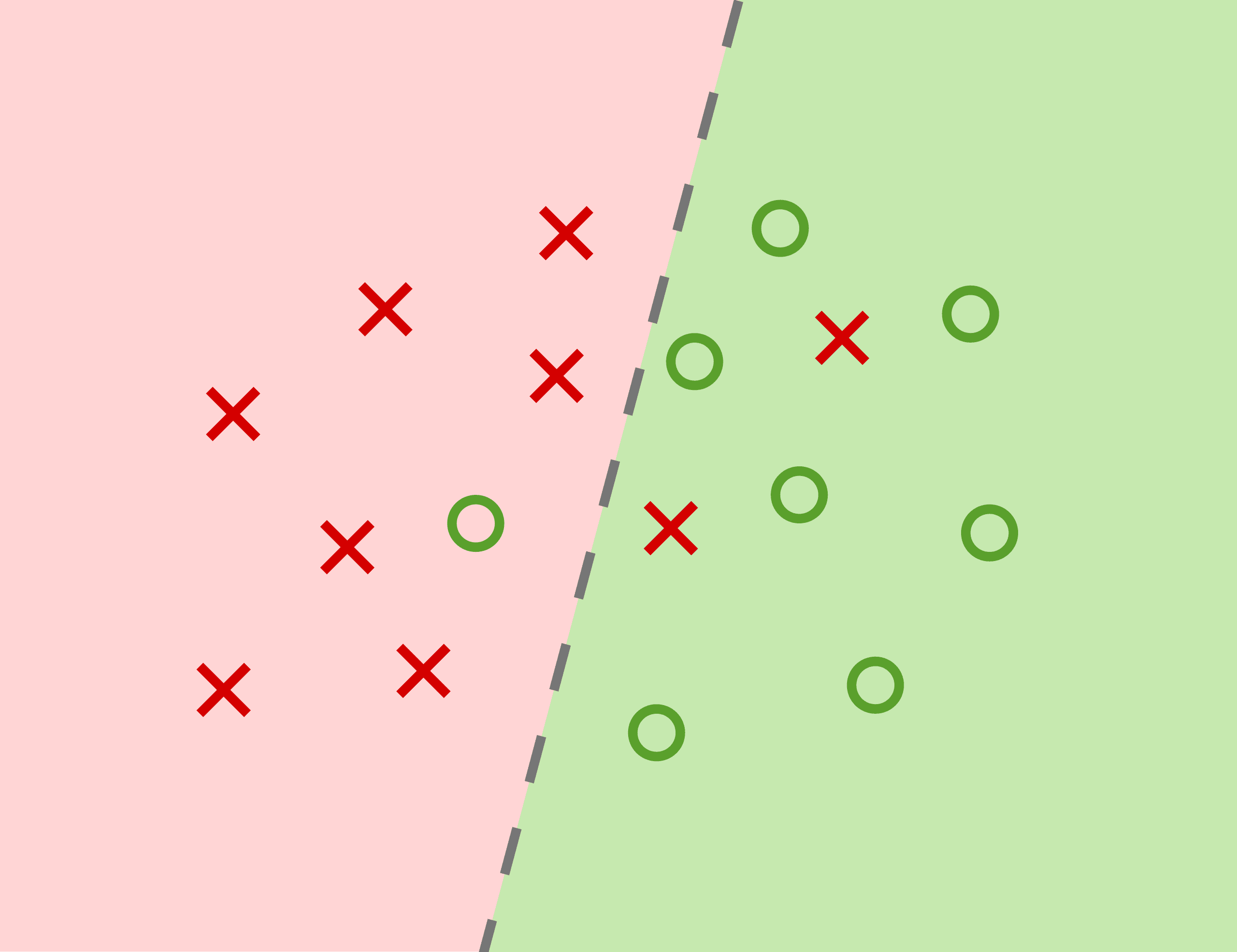

- La inclusividad implica promover la concienciación sobre los sesgos de las herramientas de IA y mitigarlos. Los datos de entrenamiento de los algoritmos de IA contribuyen a definir el resultado del algoritmo, lo que significa que las herramientas de IA corren el riesgo de amplificar los sesgos de la sociedad en la que se han desarrollado. Esto debe tenerse siempre en cuenta en el uso de la IA en las redacciones, y las políticas deben ofrecer estrategias para investigar y minimizar dichos sesgos.

- La imparcialidad implica una aplicación equitativa de esta política. Los equipos de redacción deben cumplir estrictamente la política establecida y aplicar las actualizaciones que sean necesarias. La aplicación debe ser generalizada, y cualquier desviación de la política debe acarrear consecuencias y una comunicación clara de las infracciones a la audiencia.

La amenaza del sesgo algorítmico y la «baba rosa»

Los modelos de IA implementados sin límites éticos corren el riesgo de reforzar las desigualdades sociales y los estereotipos sobre los grupos marginados, al tiempo que refuerzan las creencias preexistentes de los usuarios y agravan la polarización. La UNESCO, en su investigación sobre los estereotipos generados por la IA, descubrió que los grandes modelos lingüísticos asignaban tareas domésticas a las mujeres en una proporción mucho mayor que a los hombres, al tiempo que generaban contenidos negativos sobre las personas homosexuales y determinados grupos étnicos. Investigadores de la Universidad de Stanford descubrieron que los modelos de IA perpetuaban estereotipos racistas extremos vinculados a la época anterior a los derechos civiles tras recibir la indicación de describir a personas que hablaban inglés afroamericano. El riesgo de perpetuar sesgos mediante el uso de sistemas de IA inevitablemente defectuosos puede filtrarse en la traducción, el análisis de datos, la generación de ideas para reportajes y otras tareas que las redacciones delegan en estas herramientas. Además, los sistemas de recomendación de IA diseñados para ofrecer contenido personalizado, incluidas las noticias, pueden seguir mostrando a los lectores contenido con el que están de acuerdo, lo que refuerza sus ideas preconcebidas sobre el mundo y les cierra a puntos de vista alternativos o a información que amplíe su perspectiva.

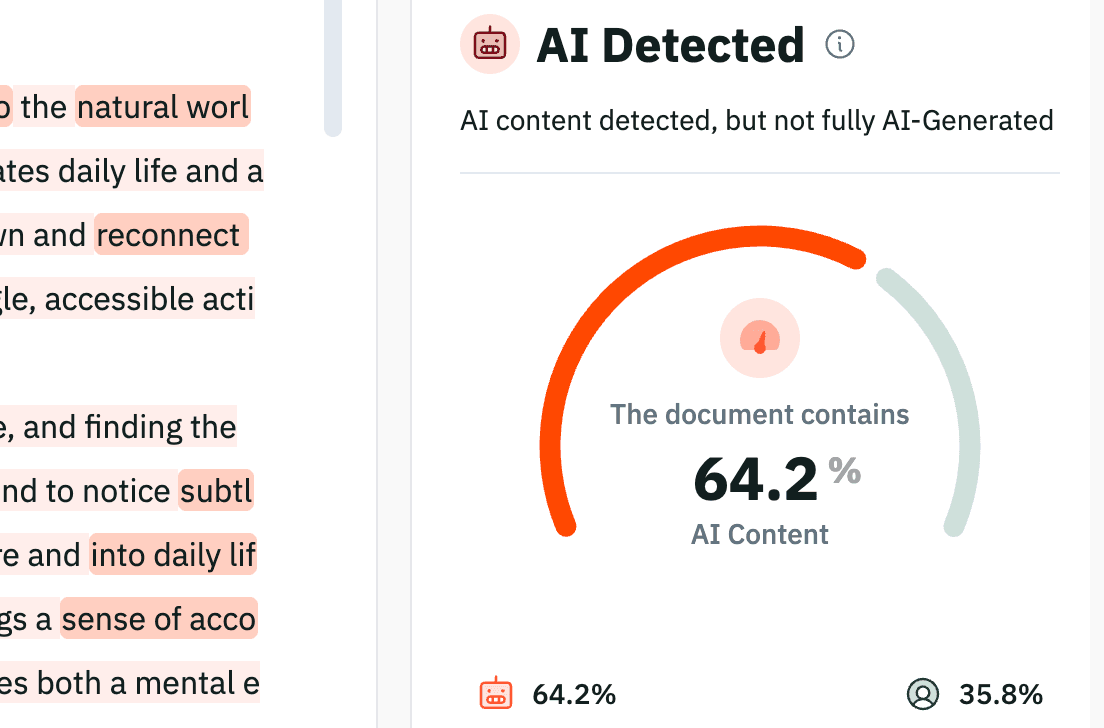

La infinita montaña de contenido generado por IA que inunda Internet también puede confundir a los lectores y minar su confianza en los medios de comunicación tradicionales. Un estudio de la empresa de detección de IA Pangram reveló que cada día se publican 60 000 artículos de noticias generados por IA, sobre todo en los ámbitos de la tecnología, la belleza y los negocios. Los sitios de noticias de baja calidad y los malos actores utilizan la IA para producir constantemente grandes cantidades de contenido de baja calidad (conocido como «pink slime») a un coste casi nulo con el objetivo de obtener ingresos publicitarios. Estas granjas de contenido enturbian el panorama informativo y hacen que sea aún más esencial que los sitios de noticias fiables y profesionales creen políticas sólidas sobre IA que divulguen a sus lectores.

Casos prácticos: ¿Qué medios de comunicación están marcando el camino?

Medios de comunicación líderes como The New York Times, la BBC y ProPublica están logrando equilibrar con éxito la innovación y la ética al mantener la supervisión humana como prioridad en sus políticas, quitando el control a los algoritmos y devolviéndoselo a editores de confianza. La BBC, por ejemplo, exige que su personal deje claro el uso de la IA en la creación, presentación y distribución de sus contenidos. Sus directrices también promueven la consideración y el control de los sesgos inherentes, las alucinaciones y el plagio en los resultados de las herramientas de IA. Todo el personal y los colaboradores externos deben presentar una propuesta para el uso de la IA a un responsable editorial de alto rango para su aprobación. Las directrices de la BBC también describen casos de uso apropiados de la IA, como mostrar los resultados de la IA en noticias sobre el tema o modificar las voces de fuentes que desean permanecer en el anonimato. ProPublica utiliza explícitamente la IA para examinar grandes bases de datos en investigaciones cruciales e identificar patrones que permitan poner de manifiesto sesgos en otros sistemas. El New York Times ha dejado claro que utiliza la IA para ayudar en la creación de titulares y resúmenes, generar versiones en audio de los artículos y analizar datos.

Aplicación: cómo las redacciones pueden hacer cumplir la ética

Para establecer unas directrices adecuadas y exhaustivas sobre la IA que sean compatibles con el Código Ético de la Sociedad de Periodistas Profesionales, las redacciones deberían crear equipos multidisciplinares que reúnan conocimientos tanto tecnológicos como éticos, con el fin de cubrir todos los aspectos de este nuevo mundo sacudido por la IA. La supervisión humana debe seguir siendo el eje central del uso de la IA. La veracidad de los resultados de la IA utilizados en las noticias debe someterse a auditorías continuas.

La IA debería ser un complemento de las capacidades humanas, no un sustituto del periodismo bien documentado y fiable. Para aplicar las políticas y garantizar su cumplimiento, las redacciones deberían utilizar herramientas de verificación como Pangram para detectar casos no revelados e inapropiados de contenido generado por IA. Aunque las herramientas de IA ofrecen una eficiencia tentadora, no mantienen la misma credibilidad ni los mismos ideales éticos que las buenas redacciones. Al adoptar un marco basado en la transparencia y la rendición de cuentas, las redacciones pueden aprovechar las herramientas de IA sin comprometer la función democrática de la prensa.

Asegúrate de que tu publicación mantenga los más altos estándares de integridad en la era actual de la inteligencia artificial. Verifica hoy mismo la autenticidad de tu contenido.

Lecturas relacionadas

Sí, la detección mediante IA puede ser precisa

¿Puede la detección mediante IA identificar el estilo de escritura de Claude?

Todo sobre los falsos positivos en los detectores de IA

Marcas de agua con IA: por qué las grandes empresas tecnológicas apuestan por la trazabilidad mediante IA y están fracasando

Verificador de cartas de presentación con IA: cómo los equipos de RR. HH. filtran la información superflua

Un repaso a las expresiones más manidas del mundo de la IA