Descubre al instante qué publicaciones son de personas y cuáles de IA en Twitter, LinkedIn, Substack y otras plataformas. Descarga nuestra nueva extensión para Chrome.

Marcas de agua con IA: por qué las grandes empresas tecnológicas apuestan por la trazabilidad mediante IA y están fracasando

Allá donde miren los usuarios de Internet, se topan con textos, vídeos e imágenes generados por IA, muchos de los cuales son indetectables. La inviolabilidad y la confianza de los espacios en línea se están desmoronando bajo el peso del contenido generado por IA. La orden ejecutiva de Biden sobre seguridad de la IA y la Ley de IA de la Unión Europea abogaban por un etiquetado adecuado de los resultados de la IA, también conocido como «marca de agua», pero estas regulaciones fueron derogadas en 2025. A pesar de la ausencia de una estrategia nacional o internacional, muchas empresas de IA siguen desarrollando e implementando señales de «marca de agua» en sus contenidos. Si bien se trata de un paso en la dirección correcta para recuperar la confianza del público y proteger a los consumidores, la marca de agua es un método defectuoso que se puede eludir fácilmente.

A continuación, analizaremos cómo funcionan las marcas de agua, por qué fallan y por qué los buenos métodos de detección basados en IA deben basarse en un tipo específico de reconocimiento de patrones.

Se detecta una marca de agua generada por IA, pero no se ve

Para los humanos, las marcas de agua generadas por IA son invisibles. A diferencia de las marcas de agua tradicionales, que muestran el nombre o el logotipo de una empresa, las marcas de agua generadas por IA se integran de forma imperceptible en el texto, las imágenes y los vídeos generados por un modelo de IA.

Google utiliza SynthID, que incorpora variaciones sutiles en los resultados de Gemini, detectables mediante la propia tecnología de Google. En el caso del texto, SynthID modifica los índices de previsibilidad de determinadas palabras según una función pseudoaleatoria, lo que hace que Gemini se incline por utilizar ciertas palabras. De este modo, cuando el texto se vuelve a introducir en el modelo, este puede reconocer su propia obra basándose en un análisis de la frecuencia de las palabras.

Según la legislación estadounidense, el contenido generado íntegramente por IA no puede ser objeto de derechos de autor, por lo que a las empresas de IA les conviene desarrollar un método para determinar la procedencia del contenido de sus modelos. De este modo, cuando el texto, la imagen o el vídeo generado por IA se difunda por Internet, habrá una firma que permita identificar su origen.

Reivindicar la autoría de las creaciones de sus modelos no es la única razón por la que las grandes empresas tecnológicas tienen tanto interés en la procedencia. Mientras los usuarios de Internet se quedan boquiabiertos ante la interminable avalancha de basura generada por la IA que les llega a diario, los principales desarrolladores de IA temen los riesgos legales, de reputación y de seguridad a los que podrían enfrentarse. Los malos actores utilizan herramientas de IA para crear deepfakes o difundir desinformación, lo que supone una amenaza para la seguridad global. Para evitar una posible represión en forma de mandatos gubernamentales estrictos, las grandes tecnológicas pretenden adelantarse a los acontecimientos creando herramientas de autorregulación. Si sus modelos pueden descodificar contenido con la misma facilidad con la que lo generan, ¿por qué tendría que supervisar su desarrollo ninguna entidad gubernamental?

Malas noticias: las marcas de agua no son infalibles

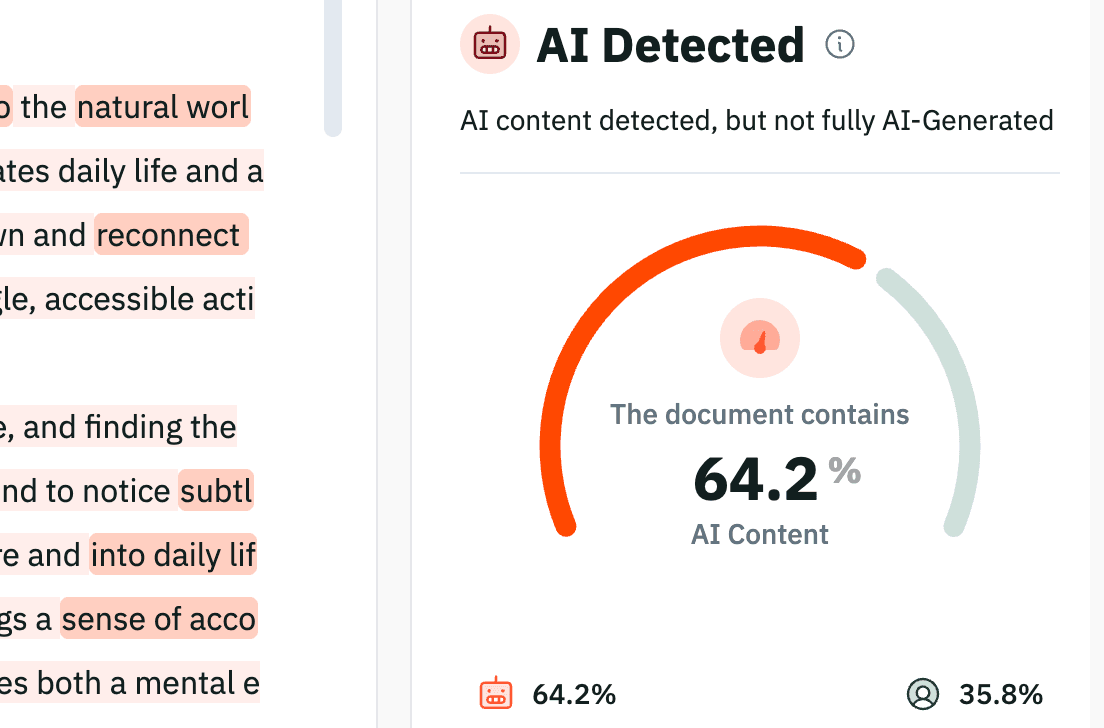

Si todo el mundo se comprometiera a no alterar nunca el contenido generado por IA, quizá las marcas de agua funcionarían. Pero en el mundo actual, los malintencionados pueden alterar fácilmente el contenido generado por IA de tal forma que se oculte su origen. Las herramientas de parafraseo secundarias, como los humanizadores, pueden cambiar fácilmente las palabras o la estructura de las frases, insertando errores o texto sin sentido en un intento de disimular el contenido generado por IA. Por desgracia, a veces este endeble disfraz funciona. Pangram Labs probó 19 humanizadores de IA diferentes y descubrió que muchos eliminaban con éxito las marcas de agua del texto.

Los delincuentes también pueden «blanquear» un texto sometiéndolo a múltiples traducciones antes de volver a traducirlo al inglés, eliminando así las marcas de agua y creando un texto limpio que no active las alertas de los sistemas de decodificación de las empresas de IA.

Las marcas de agua son delicadas y se pueden alterar fácilmente, lo que las hace inútiles. Para detectarlas se necesitan otras herramientas.

Reconocimiento de patrones estadísticos

Las empresas responsables de los contenidos de baja calidad generados por IA no pueden ser las únicas encargadas de detectar cuándo un contenido es suyo. La marca de agua requiere la colaboración de los desarrolladores de IA y puede eliminarse en un abrir y cerrar de ojos.

Pero cuando un método falla, otro sale al paso. Un método denominado «reconocimiento de patrones estadísticos independientes» resulta mucho más sólido y fiable a la hora de identificar contenidos generados por IA, y por eso lo utilizamos aquí en Pangram. No buscamos un código oculto incrustado en el texto generado por IA. En su lugar, los modelos de Pangram analizan el ADN lingüístico fundamental, la previsibilidad estructural y los patrones sintácticos de cualquier texto dado para lograr una detección de IA con una precisión del 99,98 %. Los detectores avanzados como Pangram no necesitan marcas de agua para funcionar. Se entrenan con diversos conjuntos de datos mediante un método denominado «minería de negativos duros», en el que se alimentan a los detectores con ejemplos difíciles de detectar. Pangram puede señalar contenido generado por IA a partir de modelos de código abierto o no publicados, identificar texto modificado de forma maliciosa y ofrecer un análisis línea por línea de textos mixtos, generados por IA y escritos por humanos.

De la autorregulación a la detección independiente

Las empresas de inteligencia artificial no se convertirán en las defensoras de la autenticidad en Internet. Las marcas de agua son una estrategia que no resiste ante los malos actores, y la detección independiente es la única solución real.

Nuestros modelos ya se están utilizando en la práctica. Plataformas que se basan en la confianza de los usuarios, como Quora, han integrado la detección a nivel de API en su servicio, utilizando Pangram para moderar millones de publicaciones y señalar el contenido generado por IA.

La verdadera autenticidad y transparencia en Internet solo pueden lograrse mediante un marco basado en la detección. Los detectores fiables, independientes y de última generación, como Pangram, están contribuyendo a establecer un sistema de controles y contrapesos para todo Internet.

Tanto si eres un académico, un profesional o un desarrollador informático: las marcas de agua no son la solución milagrosa. Para protegerse contra la falta de honestidad académica o el contenido spam generado por IA, es necesario recurrir a la detección. Para verificar con precisión el origen de ensayos, correos electrónicos y publicaciones en redes sociales, las organizaciones deben utilizar herramientas de detección que analicen el texto, en lugar de recurrir a las marcas de agua.

No confíes en las marcas de agua para proteger tu plataforma. Identifica al instante el contenido alterado generado por IA con Pangram.

Lecturas relacionadas

El reto de la evaluación

Cómo crear marcos éticos para la IA en el periodismo

¿Las oficinas de admisión de las universidades comprueban si se ha utilizado IA?

Políticas útiles sobre IA para educadores

Sí, la detección de IA puede ser precisa.

Correctores de ensayos, IA y plagio

para recibir nuestras actualizaciones.