İçindekiler

Yapay zekanın etkisinden kaçan hiçbir sektör kalmadı.

Doktorlardan avukatlara, pazarlama uzmanlarından sosyal medya influencer'larına kadar her meslek, yapay zeka tarafından üretilen içeriklerden etkilenmiştir. Peki ya gazeteciler? Bu meslek, okuyucuların güvenine dayanır; ancak son araştırmalar, sektörde denetimsiz yapay zeka kullanımında bir patlama olduğunu ortaya koymuştur. Yapay zeka tarafından üretilen makaleler, geniş kitlelerce okunan ve güvenilen gazetelerin sayfalarında bile yer almaktadır. Diğer sektörler, uygun yapay zeka kullanımını belirlemek için etik değerlerini gözden geçirirken, gazetecilik de aynısını yapmalıdır. AI araçları, tekrarlayan görevleri otomatikleştirebilir ve veriye dayalı hikaye anlatımını destekleyebilir, ancak bu teknoloji önyargılar ve yanılsamalar nedeniyle yetersiz kalmaktadır. Uygun AI kullanımı için yasal olarak bağlayıcı, sektör çapında bir standardın bulunmaması, haber odalarının bu keşfedilmemiş sularda kendi başlarına yol almalarına neden olmaktadır. Aşağıda, haber odalarında AI'nın etik kullanımını değerlendirmek için mevcut çerçeveleri inceleyecek, eksiklikleri analiz edecek ve şeffaflık ile insan denetimine odaklanan bütünleştirilmiş bir etik yaklaşım önereceğiz.

Parçalı ve Belirsiz Yönergelerle Şekillenen Bir Manzara

Yapay zeka teknolojisi hızla ilerlerken, etik yönetişim bu gelişmelerin gerisinde kalmaktadır. Bununla birlikte, saygın birçok küresel kuruluş bu açığı kapatma çabalarında öncülük etmiştir. Bu kuruluşlar, haber odalarının editoryal kontrolünü ve okuyucu güvenini yeniden kazanmalarına yardımcı olmaya çalışırken, aynı zamanda editörlerin, yayıncıların ve yazarlarının günümüzde karşı karşıya kaldığı tüm ikilemleri ele almak için de çaba sarf etmektedir.

Birleşmiş Milletler Eğitim, Bilim ve Kültür Örgütü (UNESCO), 2021 yılında insan denetimini merkezine alan yapay zeka etiği konusunda bir dizi tavsiye kararı kabul etti. İletişim ve bilgi endüstrisine yönelik önerileri özetleyen bölüm, gazeteciler için bazı rehberlik sağlıyor. Politika, yapay zeka sistemlerinin bilgi özgürlüğünü, ifade özgürlüğünü, şeffaflığı ve resmi verilerin açıklanmasını teşvik etmesini öngörüyor. Medya endüstrisindeki herkesi, yapay zekayı işlerine etik bir şekilde dahil etmeye teşvik ediyor. Çerçeve ayrıca ülkelerden, medyanın yapay zekanın zararları ve faydaları hakkında haber yapabileceği şeffaf ve eğitici ortamlar teşvik etmelerini ve tüketicilerin yanlış bilgilendirme ve nefret söylemiyle mücadele etmek için dijital ve medya okuryazarlığı becerilerini geliştirmelerini istiyor.

Ancak, UNESCO’nun yapay zeka ile ilgili etik ilkelerini özetleyen 44 sayfalık belgenin sadece dört paragrafı medya çerçevesine ayrılmıştır. Gazetecilik ve gazetecilere özel olarak neredeyse hiç değinilmemiştir; bu politika daha çok bir değerler beyanı niteliğinde olup, gelecekte daha kapsamlı politikalar geliştirilmesi yönünde genel bir çağrı niteliğindedir. Medyanın bu konuda dayanabileceği pek bir şey yok.

Elektrik ve Elektronik Mühendisleri Enstitüsü (IEEE) de benzer bir yaklaşım benimsemiştir. Kurumun “Etik Uyumlu Tasarım” çerçevesi, gazetecilerin yapay zeka konularında kamuoyunu bilgilendirme özgürlüğünü ve insan yargısının ve denetiminin kutsallığını ön plana çıkarmaktadır. Ancak bu politika, daha çok bir ideal ve değerler beyanı niteliğinde olup, haber odalarında yapay zeka ikilemlerini aşmak için ayrıntılı bir kılavuz değildir. Medya, yapay zeka kullanımının açıklanmasını nasıl ele almalıdır? Ya da uygunsuz kullanımlarla nasıl başa çıkmalıdır? Uygunsuz kullanımın tanımı nedir? Tüm bu belirsizlikler haber odalarını altüst etmekte ve izleyicilerin güvenini belirsizliğe sürüklemektedir, ancak sağlam bir politika bu keşfedilmemiş arazide bir yol haritası sağlayabilir.

Bundan Sonra Ne Yapacağız: Etik Gazetecilik Yapay Zeka Politikasının Temel İlkeleri

Yayıncılar, editörler ve gazeteciler, haber odalarında yapay zeka kullanımını düzenlemek, bu konuda bilgi vermek ve doğru bir şekilde gerekçelendirmek için somut, kapsamlı ve etik açıdan sağlam bir kılavuza acil olarak ihtiyaç duymaktadır. Haber odaları, sıkı ve bilgiye dayalı bir yapay zeka politikası oluştururken, kılavuzlarını dört vazgeçilmez ilkeye dayandırmalıdır: şeffaflık, hesap verebilirlik, kapsayıcılık ve adalet.

Aşağıda, bu ilkeleri haber odasındaki yapay zeka kullanımına uygulamak için bir başlangıç noktası yer almaktadır:

- Şeffaflık, yapay zekanın kullanımının okuyuculara açık, dürüst ve net bir şekilde açıklanması anlamına gelir. Gazeteciler ister haber ipuçları bulmak, ister araştırma yapmak, ister görsel içerik oluşturmak için yapay zeka kullansınlar, okuyucular her zaman bunu bilmeye hak eder.

- Hesap verebilirlik , yapay zeka tarafından üretilen içerik ve araştırmalardaki hataların sorumluluğunu belirlemek anlamına gelir . Haber kuruluşları, yapay zeka kullanımında bir sorun çıktığında kimin sorumlu olduğunu net bir şekilde tanımlamalıdır – bu kişi yapay zeka programının geliştiricisi mi? Gazeteci mi? Yoksa algoritmanın kendisi mi? Gerçek anlamda hesap verebilirlik, hataları kabul etmek ve hatayı yapan tarafı cezalandırmak demektir. Dolayısıyla, kimin sorumlu olduğuna ve durumun nasıl ele alınması gerektiğine karar vermek haber kuruluşlarına düşer.

- Kapsayıcılık, yapay zeka araçlarının önyargılarına ilişkin farkındalığı artırmak ve bu önyargıları azaltmak anlamına gelir . Yapay zeka algoritmalarının eğitim verileri, algoritmanın çıktısını belirlemede rol oynar; bu da, yapay zeka araçlarının, geliştirildikleri toplumun önyargılarını pekiştirme riski taşıdığı anlamına gelir. Bu husus, haber odalarında yapay zeka kullanımında her zaman göz önünde bulundurulmalı ve ilgili politikalar, bu önyargıyı araştırmaya ve en aza indirmeye yönelik stratejiler sunmalıdır.

- Adalet , bu politikanın adil bir şekilde uygulanması anlamına gelir . Haber odası ekipleri, belirlenen politikaya sıkı sıkıya uymalı ve gerektiğinde güncellemeleri uygulamalıdır. Uygulama genel olarak geçerli olmalı ve politikadan sapma, sonuçsuz kalmamalı; ihlaller izleyicilere açıkça bildirilmelidir.

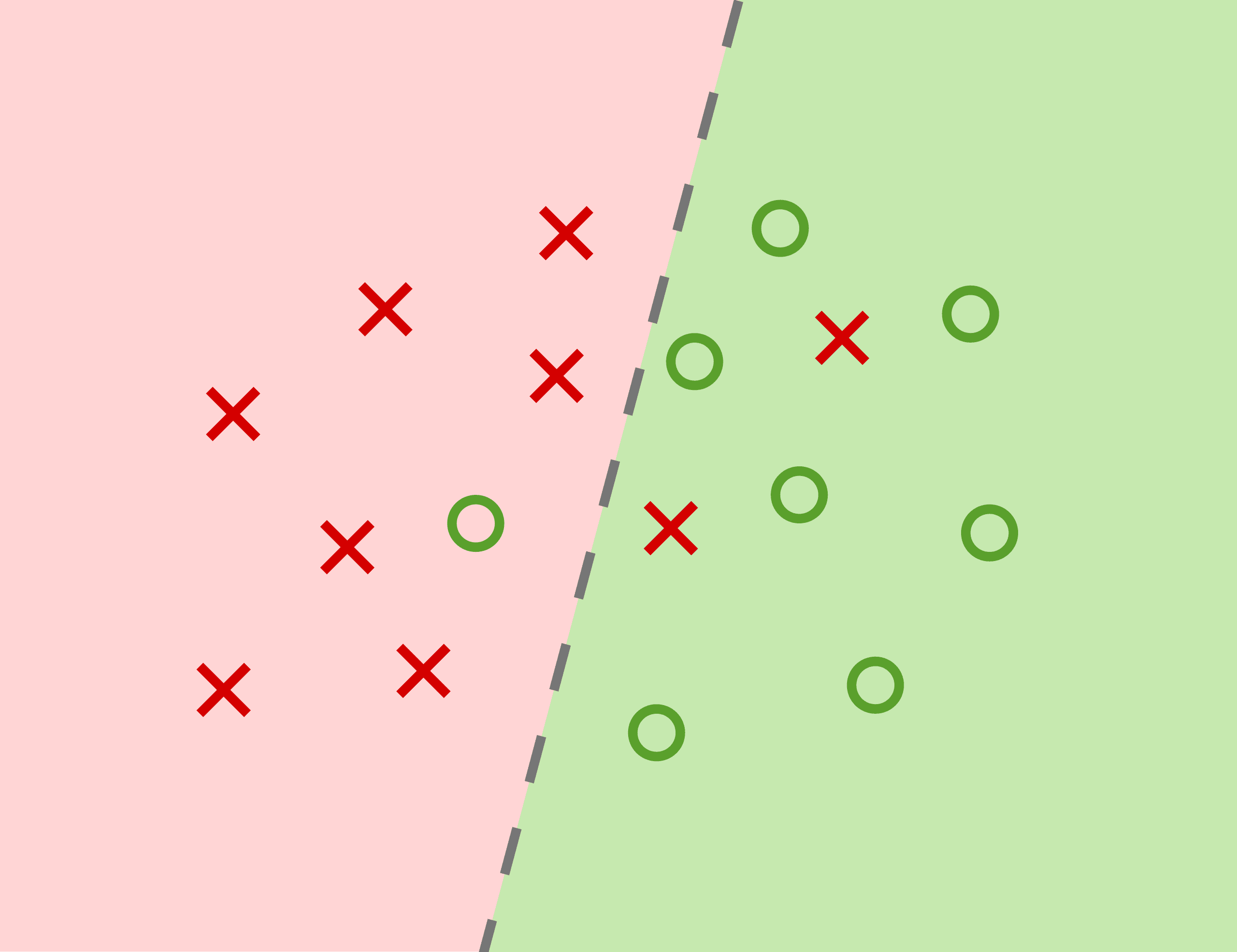

Algoritmik Önyargı ve “Pembe Sümük” Tehdidi

Etik denetimler olmaksızın devreye alınan yapay zeka modelleri, kullanıcıların mevcut inançlarını pekiştirip kutuplaşmayı derinleştirirken, toplumsal eşitsizlikleri ve marjinalleştirilmiş gruplara yönelik stereotipleri pekiştirme riski taşır. UNESCO, yapay zekanın ürettiği stereotiplere ilişkin araştırmasında, büyük dil modellerinin kadınlara erkeklere kıyasla çok daha yüksek oranda ev içi roller atadığını ve eşcinsel bireyler ile belirli etnik gruplar hakkında olumsuz içerikler ürettiğini ortaya koydu. Stanford Üniversitesi'nden araştırmacılar, AI modellerinin, Afrika kökenli Amerikalıların kullandığı İngilizceyi konuşan kişileri tanımlamaları istendiğinde, Sivil Haklar Dönemi öncesine ait aşırı ırkçı stereotipleri pekiştirdiğini tespit etmiştir. Kaçınılmaz olarak kusurlu AI sistemlerini kullanarak önyargıları sürdürme riski, çeviri, veri analizi, haber fikri üretimi ve haber odalarının bu araçlara devrettiği diğer işlere sızabilir. Ayrıca, haberler dahil kişiselleştirilmiş içerik sunmak için tasarlanmış AI öneri sistemleri, okuyuculara kendi görüşlerine uygun içerikleri göstermeye devam ederek, dünyaya dair ön yargılarını pekiştirebilir ve bakış açılarını genişletecek alternatif görüşlere veya bilgilere karşı kapılarını kapatabilir.

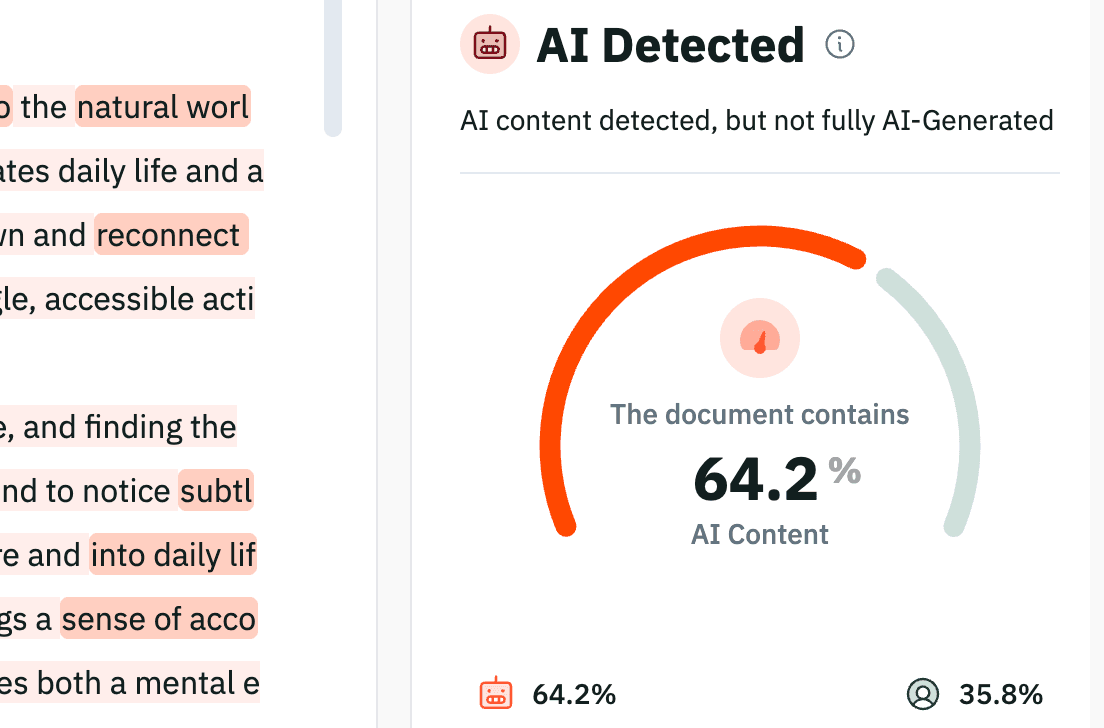

İnternetteki sonsuz AI içeriği yığını, okuyucuların kafasını karıştırabilir ve geleneksel haber kaynaklarına duydukları güveni sarsabilir. AI tespit şirketi Pangram’ın araştırmasına göre, her gün 60.000 adet AI tarafından üretilmiş haber makalesi yayınlanıyor; bunların en çok teknoloji, güzellik ve iş dünyası alanlarında yer aldığı görülüyor. Düşük kaliteli haber siteleri ve kötü niyetli kişiler, reklam gelirini artırmak amacıyla neredeyse sıfır maliyetle sürekli olarak bol miktarda düşük kaliteli içerik (kısaca "pink slime" olarak bilinir) üretmek için yapay zekayı kullanıyor. Bu içerik çiftlikleri haber dünyasını bulanıklaştırıyor ve güvenilir ve profesyonel haber sitelerinin okuyucularına açıkladıkları sağlam yapay zeka politikaları oluşturmalarını daha da önemli hale getiriyor.

Örnek Olaylar: Hangi Haber Kuruluşları Öncü Rol Oynuyor?

The New York Times, BBC ve ProPublica gibi önde gelen haber kuruluşları, insan denetimini politikalarının ön saflarında tutarak, kontrolü algoritmalardan alıp güvenilir editörlerin eline geri vererek inovasyon ile etik arasında başarılı bir denge kuruyorlar. Örneğin BBC, çalışanlarının içeriklerin oluşturulması, sunumu ve dağıtımında yapay zeka kullanımını açıkça belirtmelerini şart koşuyor. Kurumun kılavuzları ayrıca, yapay zeka araçlarının çıktılarında içsel önyargıların, sanrılar ve intihalin dikkate alınmasını ve izlenmesini teşvik ediyor. Tüm personel ve serbest çalışanlar, yapay zeka kullanımı için üst düzey bir editör yetkilisine onay için teklif sunmak zorundadır. BBC kılavuzları ayrıca, konuyla ilgili haberlerde yapay zeka çıktılarının gösterilmesi veya isimsiz kalmak isteyen kaynakların seslerinin değiştirilmesi dahil olmak üzere, yapay zekanın uygun kullanım örneklerini de özetlemektedir. ProPublica, önemli soruşturmalarda büyük veritabanlarını taramak ve diğer sistemlerdeki önyargıları ortaya çıkarmak için kalıpları belirlemek amacıyla yapay zekayı açıkça kullanmaktadır. New York Times, manşet ve özet oluşturulmasına yardımcı olmak, makalelerin sesli versiyonlarını oluşturmak ve verileri analiz etmek için yapay zeka kullandığını açıkça belirtmiştir.

Uygulama: Haber Odaları Etik Kuralları Nasıl Uygulayabilir?

Profesyonel Gazeteciler Derneği’nin Etik Kuralları ile uyumlu, uygun ve kapsamlı bir yapay zeka kılavuzu oluşturmak için, haber odaları, yapay zekanın sarsıcı etkisinin hissedildiği bu yeni dünyada her yönüyle ele almak üzere hem teknolojik hem de etik uzmanlığı bir araya getiren çok disiplinli ekipler kurmalıdır. Yapay zeka kullanımında insan denetimi her zaman merkezde yer almalıdır. Haberlerde kullanılan yapay zeka çıktıları, doğruluk açısından sürekli olarak denetlenmelidir.

Yapay zeka, insan yeteneklerini tamamlayıcı bir unsur olmalı, iyi araştırılmış ve güvenilir gazeteciliğin yerini almamalıdır. Politikalarını uygulamak ve kurallara uyumu sağlamak için haber odaları, yapay zeka tarafından üretilen içeriklerin açıklanmamış ve uygunsuz örneklerini tespit etmek üzere Pangram gibi doğrulama araçlarını kullanmalıdır. Yapay zeka araçları cazip bir verimlilik sunsa da, iyi haber odalarının sahip olduğu güvenilirlik ve etik ilkeleri aynı düzeyde korumazlar. Şeffaflık ve hesap verebilirliğe dayalı bir çerçeve benimseyerek, haber odaları basının demokratik işlevinden ödün vermeden yapay zeka araçlarından yararlanabilir.

Günümüzün yapay zeka çağında yayınınızın en yüksek dürüstlük standartlarını koruduğundan emin olun. İçeriğinizin gerçekliğini hemen doğrulayın.

İlgili makaleler

Evet, yapay zeka tabanlı algılama doğru sonuçlar verebilir

Yapay zeka algılama sistemi, Claude'un yazım tarzlarını tespit edebilir mi?

Yapay Zeka Algılayıcılarındaki Yanlış Pozitif Sonuçlar Hakkında Her Şey

Yapay Zeka ile Filigranlama: Büyük Teknoloji Şirketleri Neden Yapay Zeka Kaynak Takibine Bahis Yapıyor ve Kaybediyor?

AI Özgeçmiş Kontrol Aracı - İK Ekipleri Gürültüyü Nasıl Filtreliyor?

Yapay Zekanın En Sık Kullanılan İfadelerine Bir Bakış

adresinden güncellemelerimize abone olun