Erkenne sofort, was auf Twitter, LinkedIn, Substack und anderen Plattformen von Menschen und was von KI stammt. Hol dir unsere neue Chrome-Erweiterung.

Inhaltsverzeichnis

- Modelkarte

- Was Sie erwartet

- Was hat sich verbessert

- Erkennung von Humanizern und adversarische Prompting

- Erkennung von durch KI generierten kurzen Social-Media-Beiträgen

- Verbesserungen in Claude 4.6

- Wie geht es weiter?

- Von KI generierte Inhalte zu Mathematik, Programmierung und Naturwissenschaften

- Weiterentwicklung der Humanizer

- Die Zukunft

Ankündigung von Pangram 3.2

Update: Pangram 3.3 ist nun die aktuellste Version – hier erfahren Sie, was es in Pangram 3.3 Neues gibt.

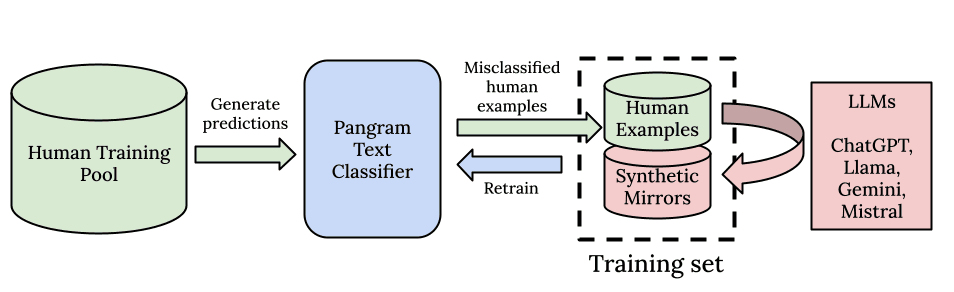

Pangram freut sich sehr, ein neues KI-Erkennungsmodell namens Pangram 3.2 vorzustellen. Wie seine Vorgänger Pangram 3.1 und Pangram 3.0 basiert es auf der EditLens-Architektur, die in unserem ICLR-2026-Beitrag beschrieben wird. Unsere Nutzer können eine schrittweise, aber spürbare Verbesserung der Anzahl der vom Detektor erkannten echten Treffer (Recall) erwarten, während die branchenweit niedrige Falsch-Positiv-Rate beibehalten wird, sodass falsche Anschuldigungen bezüglich der KI-Nutzung weiterhin äußerst selten sind.

Modelkarte

In Anlehnung an die bewährten Verfahren bei der Veröffentlichung von LLM-Modellen haben wir beschlossen, parallel zu unseren Detektor-Updates auch Modellkarten zu veröffentlichen: im Wesentlichen „Nährwertangaben“ für KI-Modelle. Unsere Modellkarten beschreiben die Trainingsarchitektur und das Framework, Details zum Trainingsdatensatz, relevante Bewertungsergebnisse sowie vorgenommene Änderungen, die sich auf das Verhalten des Detektors auswirken können. Außerdem beschreiben wir die genauen Spezifikationen der Ein- und Ausgänge des Modells, die unterstützten Sprachen sowie die Bedingungen, unter denen Pangram voraussichtlich gut funktioniert und wo seine Leistungsfähigkeit eingeschränkt ist.

Was Sie erwartet

Ihnen wird wahrscheinlich auffallen, dass Pangram 3.2 empfindlicher ist als Pangram 3.1. Mit anderen Worten: Es werden mehr KI-Texte erkannt. Dies ist auf Verbesserungen bei der Erkennung von Humanizer-Texten, der Erkennung von Claude 4.6, der Empfindlichkeit bei der Erkennung kürzerer KI-generierter Texte, der Erweiterung des Trainingsdatensatzes sowie auf optimiertere Hyperparameter in der EditLens-Architektur zurückzuführen.

Was hat sich verbessert

Erkennung von Humanizern und adversarische Prompting

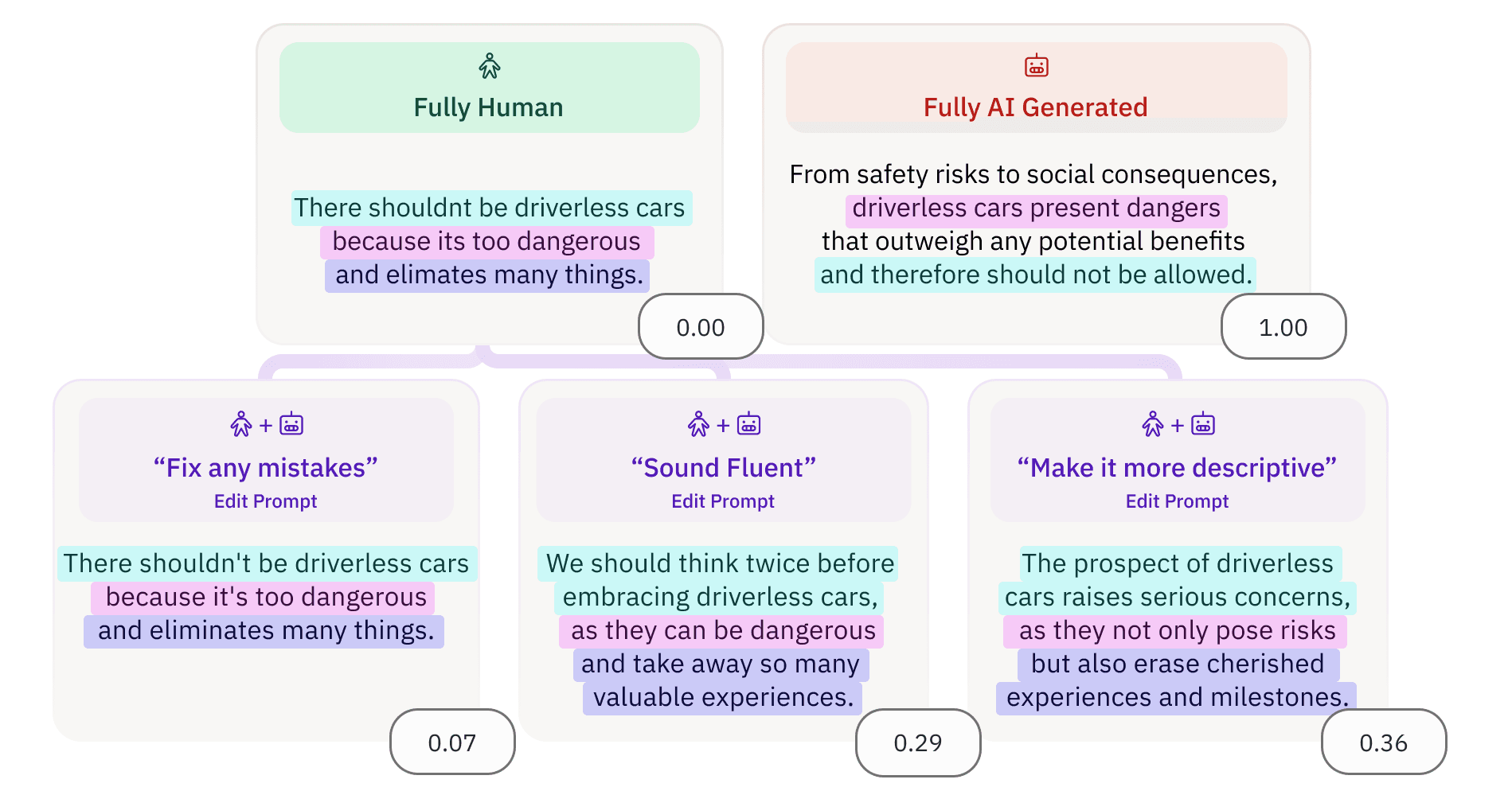

Die mit Abstand größte Verbesserung bei Pangram 3.2 ist die Fähigkeit, durch KI generierten Text zu erkennen, der „humanisiert“ wurde. In unserem internen Humanizer-Evaluierungsdatensatz konnten wir die Erkennungsrate von Humanizern im Vergleich zu Pangram 3.1 um das Vierfache verbessern. Außerdem verzeichnen wir eine etwa dreifache Verbesserung bei unserer internen Bewertung von „adversarial prompts“ – Texten, die von einem Sprachmodell generiert wurden, das angewiesen wurde, absichtlich Fehler einzubauen und in einem Stil zu schreiben, der der KI-Erkennung entgeht.

Dies ist besonders im Bildungsbereich von Bedeutung, wo Studierende zunehmend Humanizer-Tools nutzen oder versuchen, Sprachmodelle so zu steuern, dass der resultierende Text nicht „zu sehr nach KI“ wirkt.

Erkennung von durch KI generierten kurzen Social-Media-Beiträgen

Angesichts der großen Beliebtheit unseres X-Bots, mit dem Nutzer Tweets auf KI-generierten Text überprüfen können, haben wir uns in letzter Zeit intensiv darauf konzentriert, die Erkennung von kurzen Online-Inhalten in Tweet-Länge zu verbessern. Außerdem haben wir die Mindestwortzahl von 75 auf 50 gesenkt, da wir nun zuversichtlicher sind, dass wir KI-generierte Beiträge im Bereich von 50 bis 75 Wörtern zuverlässig unterscheiden können.

Bei einer Falsch-Positiv-Rate, die der von Pangram 3.1 entspricht, haben wir in Pangram 3.2 die Falsch-Negativ-Rate bei kurzen Social-Media-Beiträgen um 17 % verbessert.

Verbesserungen in Claude 4.6

Eine Reihe von Nutzern hat speziell bei Claude Opus 4.6 von Fehlalarmen berichtet. Wir haben dieses Problem behoben, indem wir unseren Datensatz unter Einbeziehung von Daten zu Claude Opus 4.6 neu generiert haben. Nach der Auswertung anhand unserer internen Testdatensätze (insbesondere schwieriger Beispiele) und Red-Teaming-Tests sind wir nun zuversichtlich, dass Pangram Claude Opus 4.6 ebenso zuverlässig erkennen kann wie jedes andere hochmoderne LLM.

Wie geht es weiter?

Von KI generierte Inhalte zu Mathematik, Programmierung und Naturwissenschaften

KI-generierter Code und mathematische Formeln werden derzeit noch nicht mit hoher Erkennungsrate erkannt. Aufgrund der hohen Kundennachfrage konzentrieren wir uns derzeit auf diese Anwendungsfälle. Obwohl mathematische Formeln und Code eher formelhaft sind und sich daher schwerer erkennen lassen als KI-generierte Texte, zeigen einige unserer ersten Experimente vielversprechende Ergebnisse.

Weiterentwicklung der Humanizer

Der Markt für Humanizer entwickelt sich ständig weiter, und in den letzten Monaten ist eine größere Vielfalt an Humanizern auf den Markt gekommen. Wir arbeiten an fortschrittlicheren Techniken zur Erkennung von Humanizern, die wir hoffentlich bald der Öffentlichkeit vorstellen können.

Die Zukunft

Pangram hat es sich zum Ziel gesetzt, stets an der Spitze der Möglichkeiten im Bereich der KI-Erkennung zu stehen. Wir entwickeln uns ständig weiter, während die Leistungsfähigkeit von LLMs weiter zunimmt.

Wir stellen auch ein! Schau dir unsere Karriereseite an und hilf uns dabei, die weltweit besten KI-Detektoren zu entwickeln.

Katherine Thai ist Gründungswissenschaftlerin für KI-Forschung bei Pangram Labs, einem Start-up im Bereich KI-Erkennung. Im Dezember 2025 schloss sie ihre Promotion in Informatik unter der Betreuung von Mohit Iyyer an der University of Massachusetts Amherst ab, wo sich ihre Arbeit auf die Bewertung von LLMs bei Aufgaben im Zusammenhang mit der Literaturanalyse konzentrierte.

Weiterführende Literatur

Können KI-Detektoren GPT-4.5 erkennen?

Erkennt Pangram Meta's Llama 4?

Technischer Bericht zur hochpräzisen Erkennung von KI-generierten Texten

Wie man KI in Google Docs erkennt

Wie gut funktioniert Pangram bei Humanizern? (Aktualisiert im August 2025)

Pangram 3.0: Quantifizierung des Ausmaßes der KI-Bearbeitung in Texten

, um unsere Updates zu erhalten.