Comment mettre en place des cadres éthiques pour l'IA dans le journalisme

Table des matières

- Un paysage marqué par des lignes directrices fragmentées et floues

- Quelle voie suivre ? Les principes fondamentaux d'une politique éthique en matière d'IA appliquée au journalisme

- La menace des biais algorithmiques et de la « bouillie rose »

- Études de cas : quels organes de presse ouvrent la voie ?

- Mise en œuvre : comment les rédactions peuvent faire respecter l'éthique

Aucun secteur n'échappe à l'intelligence artificielle.

Toutes les professions, des médecins aux avocats en passant par les professionnels du marketing et les influenceurs sur les réseaux sociaux, ont été touchées par les contenus générés par l’IA. Mais qu’en est-il des journalistes ? Cette profession repose sur la confiance des lecteurs ; pourtant, des recherches récentes ont mis en évidence une explosion de l’utilisation non réglementée de l’IA dans le secteur, des articles générés par l’IA se frayant même un chemin dans les pages de journaux très lus et réputés pour leur fiabilité. Alors que d’autres secteurs font le point sur leurs valeurs éthiques pour déterminer une utilisation appropriée de l’IA, le journalisme doit faire de même. Les outils d'IA peuvent automatiser les tâches répétitives et faciliter la narration fondée sur les données, mais cette technologie présente des failles en raison de biais et d'hallucinations. L'absence de norme juridiquement contraignante à l'échelle du secteur concernant l'utilisation appropriée de l'IA oblige les rédactions à naviguer seules dans ces eaux inexplorées. Ci-dessous, nous examinerons les cadres actuels permettant d'évaluer l'utilisation éthique de l'IA dans les rédactions, analyserons les lacunes et proposerons une approche éthique consolidée axée sur la transparence et le contrôle humain.

Un paysage marqué par des lignes directrices fragmentées et floues

Alors que les technologies d'intelligence artificielle progressent à grands pas, la gouvernance éthique reste à la traîne. Cependant, plusieurs organisations internationales reconnues ont pris les devants pour tenter de rattraper ce retard. Ces organisations s'efforcent d'aider les rédactions à reprendre le contrôle éditorial et à regagner la confiance des lecteurs, tout en continuant à se heurter à l'ensemble des dilemmes auxquels sont confrontés les rédacteurs en chef, les éditeurs et leurs journalistes à l'heure actuelle.

L'Organisation des Nations unies pour l'éducation, la science et la culture (UNESCO) a adopté en 2021 des recommandations sur l'éthique de l'IA, axées sur le contrôle humain. La section présentant les recommandations pour le secteur de la communication et de l'information fournit des orientations aux journalistes. Cette politique stipule que les systèmes d'IA doivent promouvoir la liberté d'information, la liberté d'expression, la transparence et la divulgation des données officielles. Elle encourage tous les acteurs du secteur des médias à intégrer l'IA dans leur travail de manière éthique. Ce cadre demande également aux pays de promouvoir des environnements transparents et éducatifs où les médias peuvent rendre compte des avantages et des inconvénients de l'IA, et où les consommateurs peuvent acquérir des compétences en matière de culture numérique et médiatique afin de lutter contre la désinformation et les discours de haine.

Cependant, le volet consacré aux médias ne représente que quatre paragraphes sur les 44 pages qui exposent les politiques éthiques de l'UNESCO en matière d'IA. Le journalisme et les journalistes ne sont pratiquement pas mentionnés de manière spécifique, et cette politique s'apparente davantage à une déclaration de principes et à un appel général à l'élaboration de politiques plus complètes à l'avenir. Les médias n'ont donc pas grand-chose sur quoi s'appuyer.

L'Institute of Electrical and Electronics Engineers (IEEE) a adopté une approche similaire. Son cadre de « conception éthiquement alignée » met en avant la liberté dont disposent les journalistes pour sensibiliser le public aux enjeux de l'intelligence artificielle, ainsi que le caractère sacré du jugement et du contrôle humains. Cependant, cette politique se présente davantage comme une déclaration d'idéaux et de valeurs que comme un guide concret permettant de gérer les dilemmes liés à l'IA au sein d'une rédaction. Comment les médias devraient-ils gérer la divulgation de l'utilisation de l'IA ? Ou faire face aux utilisations inappropriées ? Qu'est-ce qui définit une utilisation inappropriée ? Toute cette incertitude bouleverse les salles de rédaction et laisse la confiance du public dans l'incertitude, mais une politique solide peut fournir une feuille de route pour ce terrain inconnu.

Quelle voie suivre ? Les principes fondamentaux d'une politique éthique en matière d'IA appliquée au journalisme

Les éditeurs, les rédacteurs en chef et les journalistes ont désespérément besoin de lignes directrices concrètes, exhaustives et éthiquement irréprochables pour encadrer, éclairer et justifier de manière appropriée les cas d'utilisation de l'IA dans les salles de rédaction. Pour élaborer une politique stricte et éclairée en matière d'IA, les salles de rédaction doivent fonder leurs lignes directrices sur quatre principes non négociables : la transparence, la responsabilité, l'inclusivité et l'équité.

Voici quelques pistes pour mettre en pratique ces principes dans le cadre de l'utilisation de l'IA dans les salles de rédaction :

- La transparence implique que l'utilisation de l'IA soit communiquée aux lecteurs de manière claire, honnête et évidente. Que les journalistes recourent à l'IA pour trouver des pistes, mener des recherches ou créer des visuels, leur public a toujours le droit d'en être informé.

- La responsabilité consiste à attribuer la responsabilité des erreurs commises dans les contenus et les recherches générés par l'IA. Les rédactions doivent définir clairement qui est responsable lorsque l'utilisation de l'IA tourne mal : s'agit-il du développeur du programme d'IA ? Du journaliste ? De l'algorithme lui-même ? Une responsabilité adéquate implique de reconnaître les erreurs et de sanctionner la partie en faute. Il appartient donc aux rédactions de décider qui est responsable et comment la situation doit être gérée.

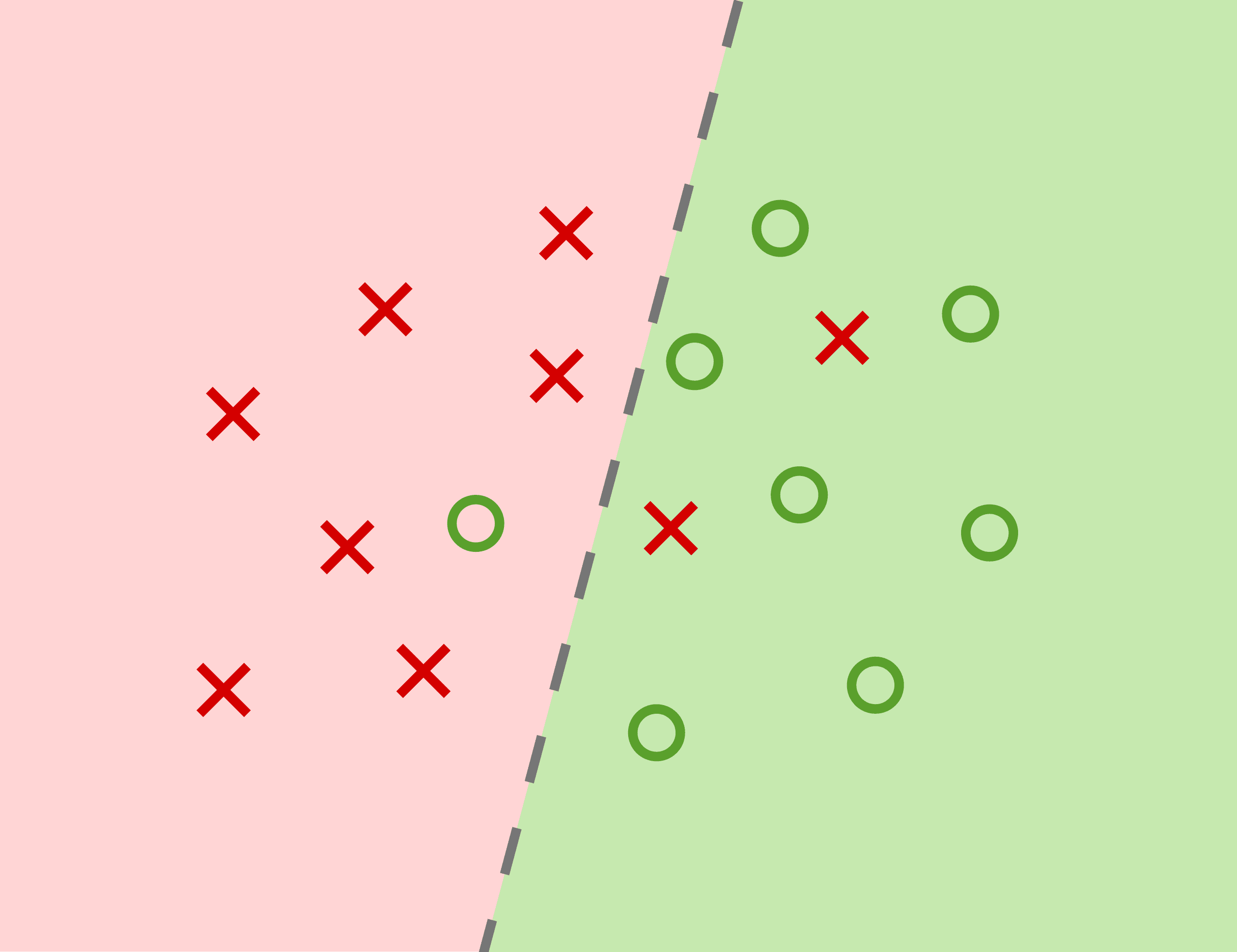

- L'inclusivité consiste à sensibiliser aux biais des outils d'IA et à les atténuer. Les données d'entraînement des algorithmes d'IA contribuent à définir les résultats de ces derniers, ce qui signifie que les outils d'IA risquent d'amplifier les biais de la société dans laquelle ils ont été développés. Cet aspect doit toujours être pris en compte lors de l'utilisation de l'IA dans les rédactions, et les politiques mises en place devraient prévoir des stratégies visant à identifier et à réduire ces biais.

- L'équité implique une application juste de cette politique. Les équipes de la rédaction doivent respecter scrupuleusement la politique établie et mettre en œuvre les mises à jour nécessaires. Cette application doit être systématique, et tout écart par rapport à la politique doit entraîner des conséquences et faire l'objet d'une communication claire au public.

La menace des biais algorithmiques et de la « bouillie rose »

Les modèles d'IA déployés sans garde-fous éthiques risquent de renforcer les inégalités sociales et les stéréotypes à l'égard des groupes marginalisés, tout en consolidant les croyances préexistantes des utilisateurs et en aggravant la polarisation. L'UNESCO, dans ses recherches sur les stéréotypes générés par l'IA, a constaté que les grands modèles linguistiques attribuaient des rôles domestiques aux femmes à un taux bien plus élevé qu'aux hommes, tout en produisant des contenus négatifs à l'égard des personnes homosexuelles et de certains groupes ethniques. Des chercheurs de l'université de Stanford ont constaté que des modèles d'IA perpétuaient des stéréotypes racistes extrêmes liés à l'époque antérieure au mouvement des droits civiques après avoir été invités à décrire des personnes parlant l'anglais afro-américain. Le risque de perpétuer des préjugés en utilisant des systèmes d'IA inévitablement imparfaits peut s'immiscer dans la traduction, l'analyse de données, la génération d'idées d'articles et d'autres tâches que les rédactions confient à ces outils. De plus, les systèmes de recommandation basés sur l'IA, conçus pour fournir du contenu personnalisé, y compris des actualités, peuvent continuer à présenter aux lecteurs des contenus avec lesquels ils sont d'accord, renforçant ainsi leurs idées préconçues sur le monde et les coupant de points de vue alternatifs ou d'informations susceptibles d'élargir leur perspective.

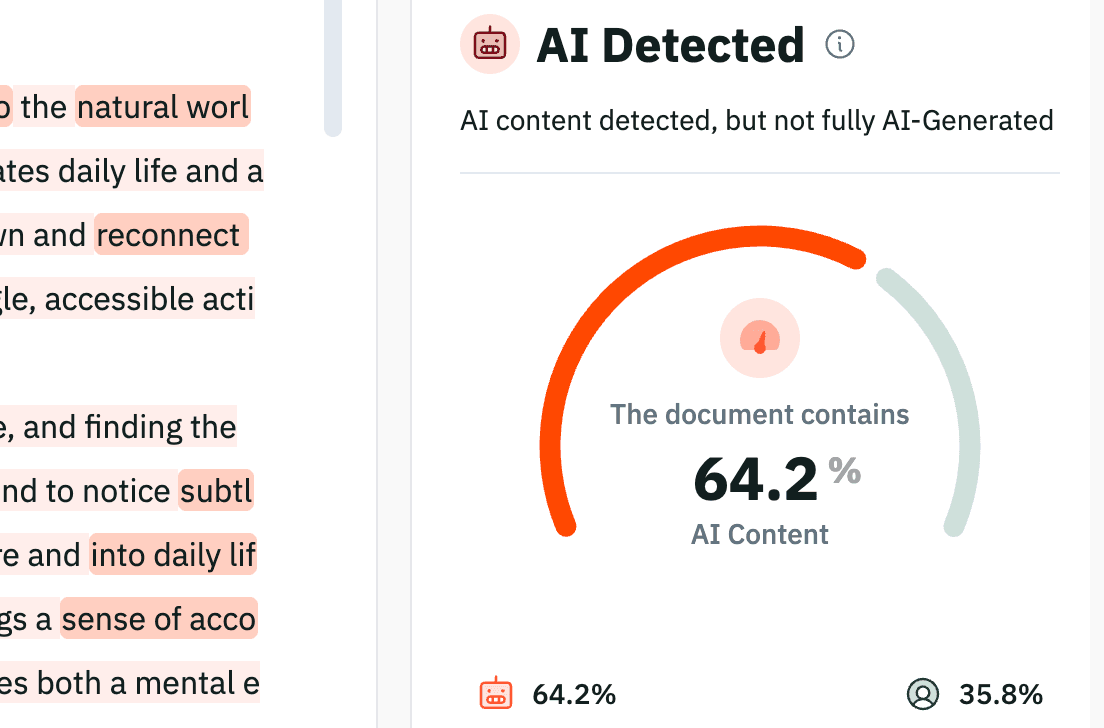

La montagne infinie de contenu généré par l'IA sur Internet peut également semer la confusion chez les lecteurs et menacer leur confiance dans les médias traditionnels. Une étude menée par la société Pangram, spécialisée dans la détection de l'IA, a révélé que 60 000 articles d'actualité générés par l'IA sont publiés chaque jour, principalement dans les domaines de la technologie, de la beauté et des affaires. Les sites d'information de mauvaise qualité et les acteurs malveillants utilisent l'IA pour produire en permanence de grandes quantités de contenu de mauvaise qualité (appelé « pink slime ») à un coût quasi nul, dans le but de générer des revenus publicitaires. Ces fermes de contenu brouillent le paysage médiatique et rendent d'autant plus indispensable que les sites d'information fiables et professionnels élaborent des politiques solides en matière d'IA, qu'ils communiquent à leurs lecteurs.

Études de cas : quels organes de presse ouvrent la voie ?

De grands organes de presse tels que le New York Times, la BBC et ProPublica parviennent à concilier innovation et éthique en plaçant le contrôle humain au cœur de leurs politiques, en retirant le pouvoir aux algorithmes pour le confier à des rédacteurs de confiance. La BBC, par exemple, impose à son personnel de signaler clairement l’utilisation de l’IA dans la création, la présentation et la diffusion de ses contenus. Ses directives encouragent également la prise en compte et la surveillance des biais inhérents, des erreurs et du plagiat dans les résultats générés par les outils d’IA. L’ensemble du personnel et des pigistes doit soumettre toute proposition d’utilisation de l’IA à un responsable éditorial senior pour approbation. Les directives de la BBC décrivent également des cas d’utilisation appropriés de l’IA, notamment la présentation des résultats de l’IA dans des reportages sur le sujet ou la modification de la voix de sources souhaitant rester anonymes. ProPublica utilise explicitement l’IA pour trier de vastes bases de données dans le cadre d’enquêtes cruciales et identifier des schémas permettant de mettre en évidence les biais dans d’autres systèmes. Le New York Times a clairement indiqué qu’il utilisait l’IA pour aider à la création de titres et de résumés, générer des versions audio d’articles et analyser des données.

Mise en œuvre : comment les rédactions peuvent faire respecter l'éthique

Afin d'établir des lignes directrices appropriées et exhaustives en matière d'IA, conformes au code de déontologie de la Society of Professional Journalists, les rédactions devraient mettre en place des équipes pluridisciplinaires réunissant à la fois des compétences techniques et éthiques, afin de couvrir tous les aspects de ce nouvel univers bouleversé par l'IA. Le contrôle humain doit rester au cœur de l'utilisation de l'IA. L'exactitude des résultats générés par l'IA et utilisés dans les reportages doit faire l'objet d'une vérification continue.

L'IA doit venir compléter les capacités humaines, et non se substituer à un journalisme rigoureux et fiable. Afin de faire respecter leurs politiques et de garantir la conformité, les rédactions devraient déployer des outils de vérification tels que Pangram pour détecter les cas non signalés et inappropriés de contenu généré par l'IA. Si les outils d'IA offrent une efficacité séduisante, ils ne garantissent pas la même crédibilité ni les mêmes principes éthiques que les bonnes rédactions. En adoptant un cadre fondé sur la transparence et la responsabilité, les rédactions peuvent tirer parti des outils d'IA sans compromettre la fonction démocratique de la presse.

Assurez-vous que votre publication respecte les normes d'intégrité les plus strictes à l'ère de l'IA. Vérifiez dès aujourd'hui l'authenticité de votre contenu.

Lectures complémentaires

Oui, la détection par IA peut être précise

La détection par IA peut-elle repérer le style d'écriture de Claude ?

Tout ce qu'il faut savoir sur les faux positifs dans les détecteurs basés sur l'IA

Le tatouage numérique par IA : pourquoi les géants de la tech misent sur la traçabilité par IA… et échouent

Outil de vérification des lettres de motivation par IA : comment les équipes RH filtrent le bruit

Un tour d'horizon des expressions les plus galvaudées dans le domaine de l'IA