Sachez immédiatement ce qui est publié par des humains et ce qui l'est par l'IA sur Twitter, LinkedIn, Substack et bien d'autres plateformes. Téléchargez notre nouvelle extension Chrome.

Le tatouage numérique par IA : pourquoi les géants de la tech misent sur la traçabilité par IA… et échouent

Partout où se tournent les internautes, ils sont assaillis par des textes, des vidéos et des images générés par l’IA, dont beaucoup sont indétectables. Le caractère sacré et la confiance dans les espaces en ligne s’effritent sous le poids des contenus générés par l’IA. Le décret présidentiel de Biden sur la sécurité de l’IA et la loi sur l’IA de l’Union européenne préconisaient un étiquetage approprié des contenus générés par l’IA, également appelé « filigrane », mais ces réglementations ont été abrogées en 2025. En l'absence de stratégie nationale ou internationale, de nombreuses entreprises spécialisées dans l'IA continuent néanmoins à développer et à déployer des signaux de « filigranage » dans leurs contenus. Bien qu'il s'agisse d'un pas dans la bonne direction pour regagner la confiance du public et protéger les consommateurs, le filigranage est une méthode imparfaite qui peut être facilement contournée.

Nous allons voir ci-dessous comment fonctionnent les filigranes, pourquoi ils échouent et pourquoi les bonnes méthodes de détection par IA doivent s'appuyer sur un type spécifique de reconnaissance de formes.

Le filigrane généré par l'IA est détecté, mais n'est pas visible

Pour l'œil humain, le tatouage numérique par IA est invisible. Contrairement au tatouage traditionnel qui affiche le nom ou le logo d'une entreprise, les tatouages numériques par IA sont intégrés de manière imperceptible dans les textes, images et vidéos générés par un modèle d'IA.

Google utilise SynthID, une technologie qui intègre de subtiles variations dans les résultats générés par Gemini, détectables par la technologie propre à Google. Pour le texte, SynthID modifie les scores de prévisibilité de certains mots selon une fonction pseudo-aléatoire, ce qui incite Gemini à privilégier l'utilisation de certains mots. Ainsi, lorsque le texte est réintroduit dans le modèle, celui-ci est capable de reconnaître sa propre production grâce à une analyse de la fréquence des mots.

En vertu de la législation américaine, un contenu entièrement généré par l'IA ne peut pas être protégé par le droit d'auteur; il est donc dans l'intérêt des entreprises spécialisées dans l'IA de mettre au point une méthode permettant de déterminer la provenance du contenu produit par leurs modèles. Ainsi, lorsque le texte, l'image ou la vidéo généré par l'IA circule sur le web, une signature permet d'identifier son origine.

Revendiquer la paternité des créations de leurs modèles n’est pas la seule raison pour laquelle les géants de la tech accordent tant d’importance à la traçabilité. Alors que les internautes sont submergés par le flot incessant de contenus générés par l’IA qui leur est livré quotidiennement, les principaux développeurs d’IA redoutent les risques juridiques, de réputation et de sécurité qui pourraient les menacer. Des acteurs malveillants utilisent des outils d'IA pour créer des deepfakes ou diffuser de fausses informations, menaçant ainsi la sécurité mondiale. Pour éviter une éventuelle répression sous la forme de mandats gouvernementaux stricts, les géants de la tech cherchent à prendre les devants en développant des outils d'autorégulation. Si leurs modèles peuvent décoder du contenu aussi facilement qu'ils peuvent en générer, pourquoi une entité gouvernementale aurait-elle besoin de surveiller leur développement ?

Mauvaise nouvelle : le tatouage numérique n'est pas infaillible

Si tout le monde s'engageait à ne jamais modifier les contenus générés par l'IA, le tatouage numérique fonctionnerait peut-être. Mais dans le monde actuel, des personnes mal intentionnées peuvent facilement altérer ces contenus de manière à en masquer l'origine. Des outils de paraphrase secondaires, tels que les « humaniseurs », peuvent facilement modifier les mots ou la structure des phrases, en y insérant des erreurs ou du charabia afin de dissimuler le contenu généré par l'IA. Malheureusement, ce déguisement de fortune fonctionne parfois. Pangram Labs a testé 19 « humaniseurs » IA différents et a constaté que bon nombre d'entre eux parvenaient à supprimer le filigrane du texte.

Les personnes mal intentionnées peuvent également « blanchir » un texte en le faisant passer par plusieurs traductions différentes avant de le retraduire en anglais, ce qui leur permet d'éliminer les traces et d'obtenir un texte « propre » qui ne déclenchera pas les systèmes de détection des entreprises spécialisées dans l'IA.

Les filigranes sont fragiles et faciles à altérer, ce qui les rend inutiles. Leur détection nécessite d'autres outils.

Reconnaissance statistique des formes

Les entreprises à l'origine de contenus de mauvaise qualité générés par l'IA ne peuvent pas être seules responsables de la détection des contenus qui leur appartiennent. Le tatouage numérique nécessite la coopération des développeurs d'IA et peut être supprimé en un clin d'œil.

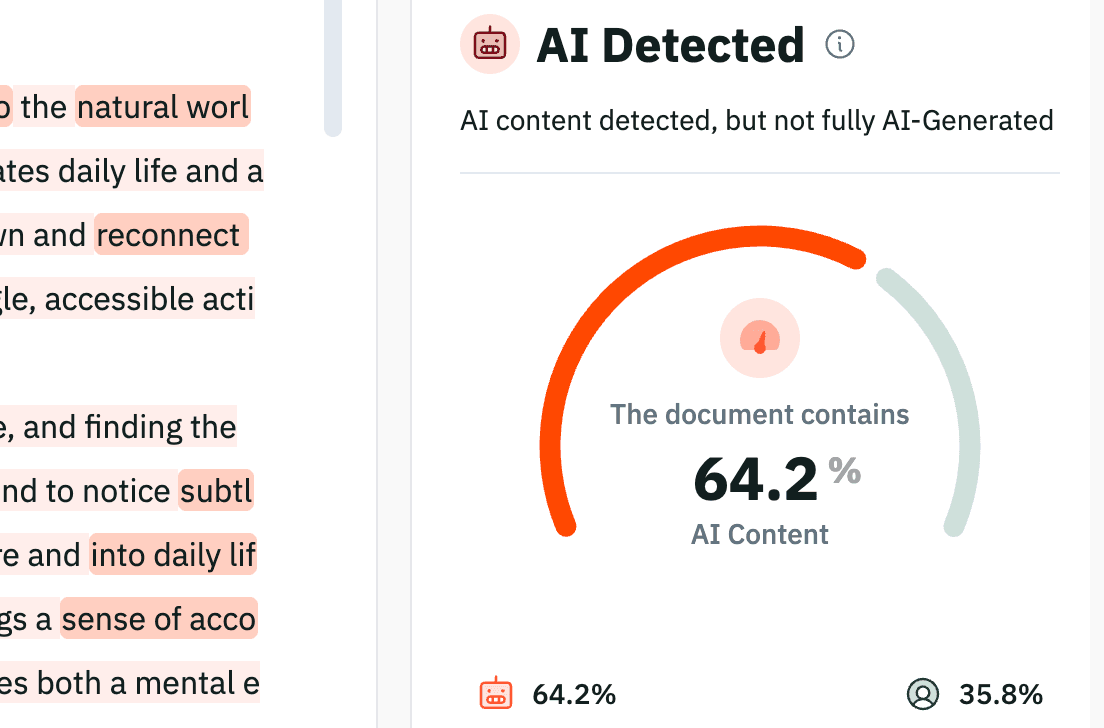

Mais là où une méthode échoue, une autre s'impose. Une méthode appelée « reconnaissance statistique indépendante des modèles » s'avère bien plus robuste et fiable pour identifier les contenus générés par l'IA, c'est pourquoi nous l'utilisons ici chez Pangram. Nous ne recherchons pas de code caché intégré dans un texte généré par l'IA. Au contraire, les modèles de Pangram analysent l'ADN linguistique fondamental, la prévisibilité structurelle et les schémas syntaxiques de n'importe quel texte pour une détection de l'IA précise à 99,98 %. Les détecteurs avancés comme Pangram n'ont pas besoin de filigranes pour fonctionner. Ils sont entraînés sur des ensembles de données variés grâce à une méthode appelée « hard negative mining », dans laquelle les détecteurs sont alimentés par des exemples difficiles à détecter. Pangram peut signaler le contenu généré par l'IA à partir de modèles open source ou non publiés, identifier les textes modifiés de manière malveillante et proposer une analyse ligne par ligne des textes mixtes générés par l'IA et rédigés par des humains.

De l'autocontrôle à la détection indépendante

Les entreprises spécialisées dans l'IA ne deviendront pas les garantes de l'authenticité sur Internet. Le tatouage numérique est une stratégie qui ne résiste pas aux acteurs malveillants, et la détection indépendante est la seule véritable solution.

Nos modèles sont déjà utilisés dans la pratique. Des plateformes qui reposent sur la confiance des utilisateurs, comme Quora, ont intégré une fonctionnalité de détection au niveau de l'API à leur service, en utilisant Pangram pour modérer des millions de publications et signaler les contenus générés par l'IA.

Une véritable authenticité et transparence sur Internet ne peuvent exister qu'avec un cadre fondé sur la détection. Des détecteurs fiables, indépendants et à la pointe de la technologie, tels que Pangram, contribuent à mettre en place un système de freins et contrepoids pour l'ensemble d'Internet.

Que vous soyez universitaire, professionnel ou développeur informatique, le tatouage numérique n'est pas la solution miracle. Pour lutter contre la tricherie académique ou le spam généré par l'IA, il faut recourir à la détection. Afin de vérifier avec précision l'origine des dissertations, des e-mails et des publications sur les réseaux sociaux, les organisations doivent utiliser des outils de détection qui analysent le texte, plutôt que le tatouage numérique.

Ne comptez pas sur les filigranes pour protéger votre plateforme. Détectez instantanément les contenus modifiés générés par l'IA grâce à Pangram.

Lectures complémentaires

Le défi de l'évaluation

Comment mettre en place des cadres éthiques pour l'IA dans le journalisme

Les services d'admission des universités vérifient-ils si les candidatures ont été rédigées par une IA ?

Politiques utiles en matière d'IA pour les enseignants

Oui, la détection par IA peut être précise.

Vérificateurs d'essais, IA et plagiat

pour recevoir nos mises à jour.