Twitter、LinkedIn、Substackなどで、投稿が人間によるものかAIによるものかを即座に見分けられます。新しいChrome拡張機能を入手してください。

法科大学院に通うということは、膨大な量の読書と多くの執筆作業を伴う。ChatGPTのような生成AIツールを使いたくなるのは当然のことだ。特に、自己紹介文や判例要約、研究メモなどの下書きを作成できるからだ。

このガイドでは、各法科大学院の方針がどのように変化しているか、そして法学教育へのAIの導入について、なぜ細心の注意を払う必要があるのかについて解説します。

法科大学院は入学エッセイの審査にAI検出ツールを使用しているのか?

この質問に対する答えは「はい」です。多くのロースクールの入学事務局、独立系の法科大学院進学カウンセラー、および法律事務所は、出願書類を構成する自己紹介文やダイバーシティに関するエッセイが、その志願者本人の真正な作品であることを確認するために、AI検出ソフトを積極的に活用しています。

法科大学院は、独自の視点と本物の声を持ち、かつそのプログラムで成功するための知的な強さを備えた学生を受け入れたいと考えています。ChatGPTによって生成されたエッセイは、本質的にありきたりな内容であり、結局のところ、志望動機書の本来の目的を台無しにしてしまいます。

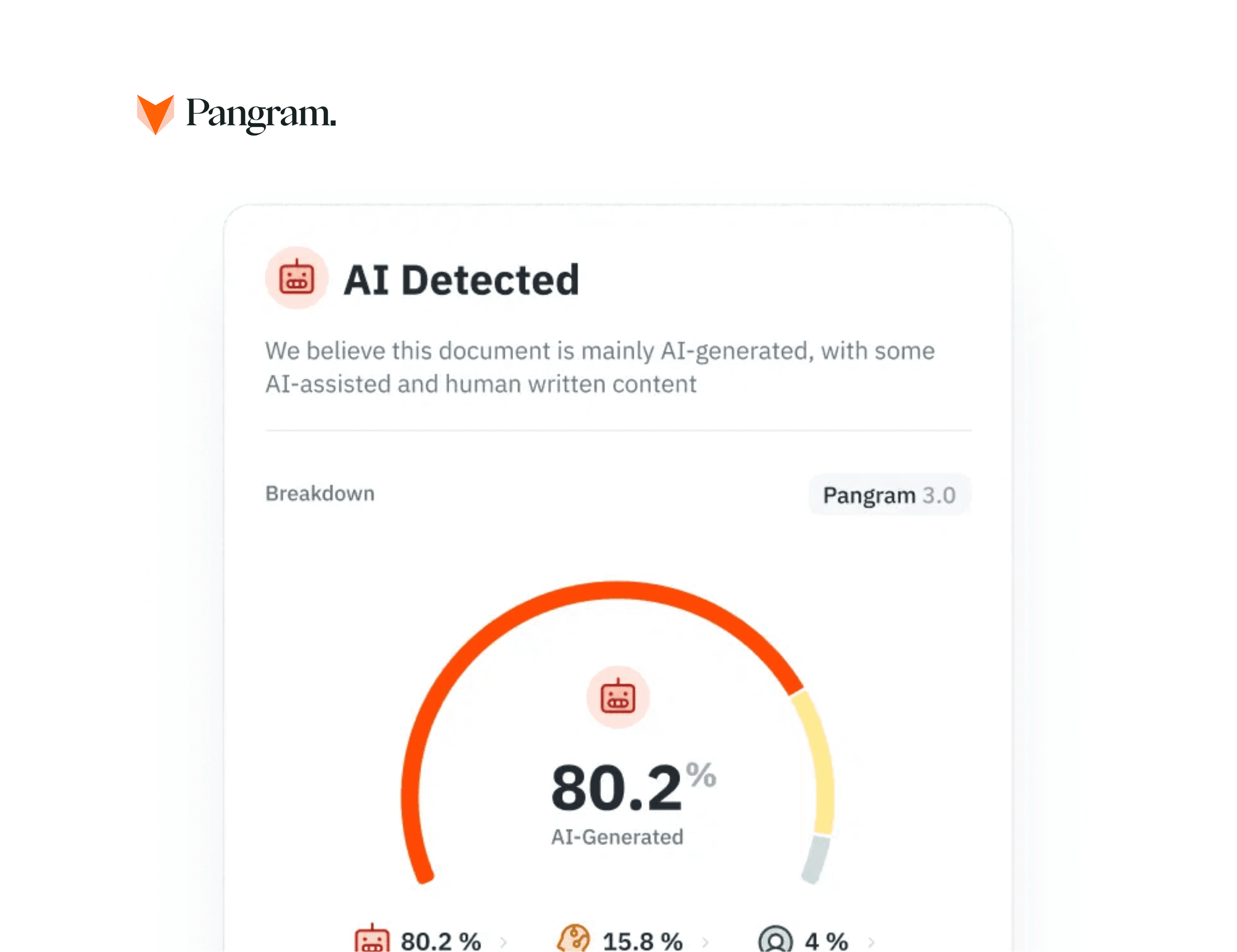

法科大学院の入学審査では、プロセスの初期段階からAI検出技術が活用されています。Gradpilotなどの一流の入学コンサルティング会社は、Pangramのようなツールを審査プロセスに直接組み込んでいます。これにより、エッセイが実際にLSACに提出される前から、志願者がAIに過度に依存しているかどうかを特定することができるのです。

法科大学院の課題でAI検出ツールは使われているのか?

はい、学術的誠実性を担当する部署や法学部の教授たちは、学習管理システム(LMS)に統合されたエンタープライズグレードのAI検出ツールを使用して、法科大学院のあらゆる種類の課題をチェックしています。チェックの対象となる課題には、法学論文、調査報告書、持ち帰り試験などが含まれます。

どのような法的文書においても、正確性と信頼性は最低限の要件です。ChatGPTのようなLLM(大規模言語モデル)の使用は、判例や引用、法的な「事実」をでっち上げやすいという点で問題があります。そのため、法学の課題作成においてAIに依存することは、単なる剽窃の疑いを招くだけでなく、法的先例を捏造したことによる厳しい学業上の処分を受けるリスクも伴います。

教授たちはAIスコアを診断ツールとして活用しています。彼らは、法科大学院向けのAI検出ツールによる診断結果と、学生のこれまでの文章作成能力に関する自身の知見を組み合わせ、学業上の不正行為の有無を調査しています。このモザイク的なアプローチを採用することで、AIの使用をより容易に検知できるようになります。

「法律用語」の問題:誤検知されることはあるのか?

一般的な無料のAI検出ツールは、法律メモなど、形式ばった構造化された文章を誤ってAI生成と判定してしまうことで知られています。しかし、大学が法的文書のAI使用の有無を確認するために使用するエンタープライズ向けツールでは、そのようなことはありません。これらのツールは、この欠点を回避し、正確なAI判定を行うよう学習されています。

一般的な無料のAI検出ツールが注目しているのは「パープレキシティ」です。パープレキシティとは統計的な意外性を測る指標であり、つまり基本的なAI検出ツールは、AIの使用を検知するために、予測可能性や高度な構造性を探しているのです。

「独立宣言」のような文書は、構成が整然としており、予測可能なため、多くの基本的なAI検出ツールがそれらをAI生成物として検知してしまいます。しかし、大学が使用しているツールは、その判定においてはるかに正確です。

自分で論文を執筆し、AIを許可された範囲内でのみ利用している学生であれば、心配する必要は一切ありません。Pangramなどの高品質な大学向けツールは、「ハードネガティブマイニング」技術を用いて、正式な学術的構文とAI生成テキストを区別しています。その結果、誤検知率は1万件に1件と、ほぼゼロに近い水準となっています。

法学教育におけるAI政策の在り方

法科大学院ごとに独自のAIに関する方針があります。厳格な教授もいれば、AIを全面的に禁止しているところもあります。一方で、この技術に対してはるかに前向きな教授もおり、将来の弁護士がリーガルテックを責任を持って活用できるよう、AIをカリキュラムに取り入れているところもあります。

現在、法律業界では、日常業務に生成AIが導入されつつあります。こうした業務には、文書レビューや契約書の分析などが含まれます。そのため、一部の教授はブレインストーミングやアウトライン作成にAIの使用を認めていますが、ほとんどの場合、AIを使用した旨の明記を条件としています。

特定のロースクールや法学教授のシラバスに、課題作成におけるLLMの使用が許可されていると明示されていない場合は、LLMの使用が厳格に禁止されているものとみなすべきです。ロースクールにChatGPTに関する方針や、LLMの使用に関する一連のガイドラインが存在する場合は、その方針・ガイドラインに従う必要があります。

AIによって生成されたテキストを、その旨を明記せずに提出することは、一般的に学術不正とみなされます。学術不正の罪が認められた場合、退学処分をはじめとする深刻な結果に直面する可能性があります。

学業成績を守るためのベストプラクティス

法学部の学生や志願者は、自身の学業成績を守るために、以下のベストプラクティスを実践すべきです。常に独自の論文を作成すること、バージョン履歴を管理すること、課題を提出した後もバージョン履歴を保管しておくこと、そして、AIを文法の軽微な修正やアイデア出し、その他の目的で使用していないか、事前に文書を確認することです。

こうしたベストプラクティスを実践するだけでなく、文章の中にAI特有の表現が含まれていないか確認する必要があります。「delve(深く掘り下げる)」、「tapestry(織物)」、「pivotal(極めて重要な)」といった言葉は、AIが好んで使う表現の代表例です。これらの言葉を多用すると、AIを使ったのではないかと疑われる恐れがあります。

スペルチェックに何らかのAIツールを使用する場合、Pangramのような高度な法律文書向けAIチェッカーなら、「AIによる軽微な補助」を受けた文法チェックと、「完全にAIによって生成された」テキストとを区別することができます。こうした点を区別できることは、特定の文書における核心的な主張をあなたが自ら執筆したことを証明する上で役立ちます。

法科大学院は、法曹界の品位とそこで働く人々の利益を守るため、AIの利用状況を積極的に監視している。

AIは創作において強力なツールではありますが、法学博士号(JD)を取得するために必要な厳密な法的推論や批判的思考に取って代わることはできません。

自己紹介文や法的メモは、必ずご自身で作成したものであることを確認してください。提出する前に、文章の真正性を確認してください。

関連記事

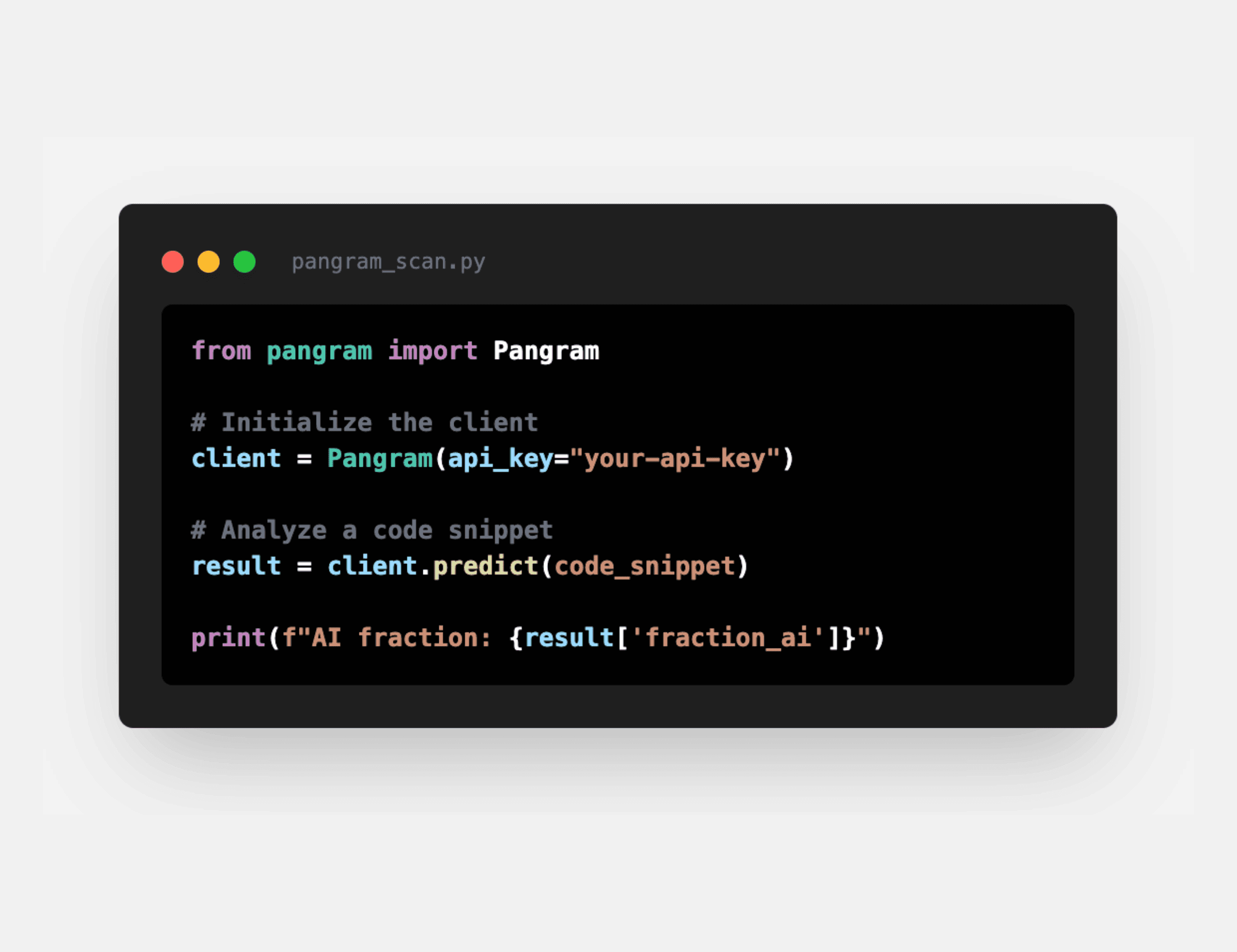

パングラムはAIコードに対してどの程度効果的か?

AI検出スコアは何を意味するのでしょうか?

AIコード検出ツール:コードがChatGPT、Copilot、またはClaudeによって作成されたかどうかを確認する方法

これはAIが書いたもの? テキストが生成されたものかどうかを確認する4つの方法

AI時代における学術的誠実さへのモザイク的アプローチ(クリス・オストロとの共著)

パングラムの盗用検出機能のご紹介

の更新情報を購読する