Twitter、LinkedIn、Substackなどで、投稿が人間によるものかAIによるものかを即座に見分けられます。新しいChrome拡張機能を入手してください。

目次

- 🤗 モデルとデータセット

- ソースコード

- なぜ私たちはPangramのオープン版をリリースするのでしょうか?

- レンズの編集とAIアシストによる検出

- データセット

- モデル

- 評価

- 同一ドメインのテストセット

- 二値分類の結果

- 3分類の結果

- 除外されたドメイン(エンロンの電子メール)

- 二値分類の結果

- 3分類の結果

- 公開モデル(Llama 3.3 70B Instruct)

- 二値分類の結果

- 3分類の結果

- サードパーティ製のベンチマーク

- 非母語話者の英語(Liang et al., 2023)

- 「Human Detectors」(Russell et al., 2024)

- RAID、ランダムな1万件のサンプル(Dugan et al., 2024)

- Grammarlyのデータセット

- Open Pangramはどのような用途に使うべきでしょうか?

- Open Pangramはどのような用途には使用すべきではないでしょうか?

🤗 モデルとデータセット

ソースコード

2026年のICLR論文で提案したEditLens技術に基づいた2種類のパングラムモデルを発表できることを、誇りに思うと同時に大変嬉しく思います。これらはCC BY-NC-SA 4.0ライセンスの下で非商用利用が可能であり、MacBookでも実行できる軽量なモデルです。

なぜ私たちはPangramのオープン版をリリースするのでしょうか?

私たちは常にAI検出技術の現状に注力してきましたが、今後は他の研究者の方々にもこの分野で進展を遂げていただけるよう支援していきたいと考えています。 これまでに、AI生成コンテンツを分析・分類する新たな手法を紹介した論文『EditLens』の発表、査読論文や 米国の新聞を対象とした大規模分析の実施、研究者へのAPI利用助成の提供などを通じて、コミュニティに貢献してきました。今回、EditLensモデルのチェックポイント、トレーニングデータセット、およびソースコードを公開することで、研究者の方々が私たちの成果を基に研究をさらに発展させていけることを願っています。

レンズの編集とAIアシストによる検出

生成AIの利用が進化するにつれ、AI検出技術も進化させなければならない。OpenAIによる最近の調査では、ChatGPTへの文章作成関連のリクエストの3分の2が、一から生成するのではなく、ユーザーが提供したテキストを修正するものであることが明らかになった。 人間とAIが共同でテキストを作成するというこの新たなパラダイムを踏まえ、私たちはテキストに対するAIの寄与度を評価する新しい検出フレームワークを開発しました。Pangramのユーザーは、当モデルが「軽度のAI支援」や「中程度のAI支援」といった結果を返すことに気づいているかもしれません。 これらの分類は、ICLR 2026の研究論文「EditLens: Quantifying the Extent of AI Editing in Text」で発表した技術によって可能になりました。この論文では、0から1までのスコアを返すAI検出モデルを紹介しており、0は完全に人間が書いたテキスト、1は完全にAIが生成したテキストを示します。データセットとソースコードの公開により、誰でも独自のEditLensモデルを学習させることができるようになりました。

データセット

6万件のトレーニングデータ、2,400件の検証データ、6,000件のテストデータからなる「EditLens」データセットを公開します。各データセットは、4つの分野における、完全に人間が執筆したテキスト、完全にAIが生成したテキスト、およびAIが編集したテキストで構成されています。 AI編集テキストは、5つのドメイン(ニュース(Narayan et al.,2018およびSee et al., 2017)、創作(Fan et al., 2018)、Amazonレビュー(Zhang et al., 2015)、 Googleレビュー(Li et al., 2022)、および教育関連のウェブコンテンツ(Lozhkov et al., 2024)のいずれかから選択された人間による原稿に、編集用プロンプトを適用して生成されたものである。

AI生成およびAI編集されたテキストの生成に使用されたモデルは、OpenAIの gpt-4.1-2025-04-14 、Anthropicの claude-sonnet-4-20250514 、そしてGoogleのgemini-2.5-flash.

EditLensデータセットには、ドメイン外の評価用スプリットも2つ含まれています。1つは、保留されたソーステキストドメイン(電子メール)からの6,000件の例であり、もう1つはMetaによって生成されたテストスプリットのバージョンです。 Llama-3.3-70B-Instruct-Turbo .

さらに、Grammarlyを使用して編集された約1,800件のテキストから構成されるデータセットを公開します。このデータセットは、人間が作成した200件の原文テキストに対して行われた9種類の編集結果で構成されています。各編集内容(例:「これを簡潔に」)は、Grammarlyのネイティブワードプロセッサから提案された編集案です。 200件の人間が執筆した原文テキストは、Persuade 2.0(Crossley et al., 2024)、ELLIPSE(Crossley et al., 2023)、BAWE(Nesi et al., 2004)、 ICNALE(Ishikawa et al., 2007)、CLASSE(Crossley et al., 2024)、またはPIILO(Holmes et al., 2023)のいずれかのデータセットからサンプリングされたものです。

HuggingFaceで両方のデータセットを閲覧できます。

モデル

パングラム/editlens_Llama-3.2-3B 最大シーケンス長1024トークンでQLoRAを用いて微調整されました。ベースモデルのパラメータ数は30億です。

パングラム/editlens_roberta-largeパラメータ数3億5500万のモデルは、最大シーケンス長512トークンで微調整された。

両モデルとも、EditLensの論文に記載されている手法に従い、1エポック分学習させました。両モデルに関する追加のハイパーパラメータおよび学習コードは、EditLensのGitHubリポジトリで確認できます。モデルのチェックポイントはHuggingFaceからダウンロードできます。

評価

二値分類と三値分類のいずれにおいても、保留した検証データセットを用いてキャリブレーションを行い、閾値を決定する。

二値評価においては、完全に人間が書いたテキストと完全にAIが生成したテキストを区別する際、F1スコアを最大化する閾値を特定する。二値評価には、AIが編集したテキストは含まれていない。

3値評価については、2つの閾値を特定します。まず、評価データを「人間」、「AI」、「AI編集」の3つのカテゴリに分類します。次に、人間クラスを[AI, AI編集]データの和集合から分離する下限閾値と、AIクラスを[人間, AI編集]データの和集合から分離する上限閾値を特定します。これらの閾値は、F1スコアを最大化するよう設定されます。

同一ドメインのテストセット

二値分類の結果

人間によるテキスト2,038件とAIによるテキスト2,046件

| 検出器 | マクロ F1 | FPR | FNR |

|---|---|---|---|

| パングラム 3.2(現行量産モデル) | 1.000 | 0.000 | 0.000 |

| Pangram OSS: editlens_Llama-3.2-3B | 1.000 | 0.000 | 0.000 |

| Pangram OSS: editlens_roberta-large | 0.997 | 0.002 | 0.003 |

| Fast-DetectGPT | 0.895 | 0.121 | 0.088 |

| 双眼鏡 | 0.886 | 0.128 | 0.101 |

3分類の結果

人間によるテキスト2,038件、AIによるテキスト2,046件、およびAIが編集したテキスト2,031件

| 検出器 | 精度 | マクロ F1 | ヒトF1 | AI F1 | AI編集済みF1 |

|---|---|---|---|---|---|

| パングラム 3.2(現行量産モデル) | 0.920 | 0.920 | 0.926 | 0.957 | 0.876 |

| Pangram OSS: editlens_Llama-3.2-3B | 0.895 | 0.895 | 0.895 | 0.948 | 0.842 |

| Pangram OSS: editlens_roberta-large | 0.881 | 0.881 | 0.900 | 0.923 | 0.819 |

| Fast-DetectGPT | 0.585 | 0.545 | 0.246 | 0.831 | 0.558 |

| 双眼鏡 | 0.569 | 0.523 | 0.213 | 0.811 | 0.545 |

除外されたドメイン(エンロンの電子メール)

二値分類の結果

人間によるテキスト1,992件とAIによるテキスト1,847件

| 検出器 | マクロ F1 | FPR | FNR |

|---|---|---|---|

| パングラム 3.2(現行量産モデル) | 0.999 | 0.001 | 0.001 |

| Pangram OSS: editlens_Llama-3.2-3B | 0.998 | 0.001 | 0.004 |

| Pangram OSS: editlens_roberta-large | 0.966 | 0.001 | 0.068 |

| Fast-DetectGPT | 0.941 | 0.079 | 0.036 |

| 双眼鏡 | 0.914 | 0.155 | 0.011 |

3分類の結果

人間によるテキスト1,992件、AIによるテキスト1,847件、およびAIが編集したテキスト2,308件

| 検出器 | 精度 | マクロ F1 | ヒトF1 | AI F1 | AI編集済みF1 |

|---|---|---|---|---|---|

| パングラム 3.2(現行量産モデル) | 0.905 | 0.909 | 0.898 | 0.956 | 0.872 |

| Pangram OSS: editlens_Llama-3.2-3B | 0.863 | 0.868 | 0.855 | 0.936 | 0.812 |

| Pangram OSS: editlens_roberta-large | 0.695 | 0.673 | 0.847 | 0.515 | 0.657 |

| Fast-DetectGPT | 0.625 | 0.589 | 0.261 | 0.886 | 0.619 |

| 双眼鏡 | 0.618 | 0.575 | 0.266 | 0.857 | 0.601 |

公開モデル(Llama 3.3 70B Instruct)

二値分類の結果

人間によるテキスト2,038件とAIによるテキスト2,038件

| 検出器 | マクロ F1 | FPR | FNR |

|---|---|---|---|

| パングラム 3.2(現行量産モデル) | 1.000 | 0.000 | 0.000 |

| Pangram OSS: editlens_Llama-3.2-3B | 1.000 | 0.000 | 0.000 |

| Pangram OSS: editlens_roberta-large | 0.987 | 0.002 | 0.025 |

| Fast-DetectGPT | 0.939 | 0.121 | 0.000 |

| 双眼鏡 | 0.936 | 0.128 | 0.000 |

3分類の結果

人間によるテキスト2,038件、AIによるテキスト2,038件、およびAIが編集したテキスト1,881件

| 検出器 | 精度 | マクロ F1 | ヒトF1 | AI F1 | AI編集済みF1 |

|---|---|---|---|---|---|

| パングラム 3.2(現行量産モデル) | 0.952 | 0.951 | 0.946 | 0.985 | 0.923 |

| Pangram OSS: editlens_Llama-3.2-3B | 0.921 | 0.920 | 0.918 | 0.965 | 0.877 |

| Pangram OSS: editlens_roberta-large | 0.860 | 0.859 | 0.908 | 0.879 | 0.791 |

| Fast-DetectGPT | 0.562 | 0.506 | 0.262 | 0.817 | 0.440 |

| 双眼鏡 | 0.540 | 0.478 | 0.227 | 0.796 | 0.411 |

サードパーティ製のベンチマーク

非母語話者の英語(Liang et al., 2023)

91件の文章

| 検出器 | FPR |

|---|---|

| パングラム 3.2(現行量産モデル) | 0.000 |

| Pangram OSS: editlens_Llama-3.2-3B | 0.055 |

| Pangram OSS: editlens_roberta-large | 0.099 |

| 双眼鏡 | 0.560 |

| Fast-DetectGPT | 0.670 |

「Human Detectors」(Russell et al., 2024)

人間が作成したテキスト150件とAIが生成したテキスト150件

| 検出器 | マクロ F1 | FPR | FNR |

|---|---|---|---|

| パングラム 3.2(現行量産モデル) | 1.000 | 0.000 | 0.000 |

| Pangram OSS: editlens_Llama-3.2-3B | 0.987 | 0.027 | 0.000 |

| Pangram OSS: editlens_roberta-large | 0.960 | 0.020 | 0.060 |

| 双眼鏡 | 0.846 | 0.087 | 0.220 |

| Fast-DetectGPT | 0.735 | 0.487 | 0.013 |

RAID、ランダムな1万件のサンプル(Dugan et al., 2024)

人間によるテキスト2,058件とAIによるテキスト7,942件

| 検出器c | マクロ F1 | FPR | FNR |

|---|---|---|---|

| パングラム 3.2(現行量産モデル) | 0.992 | 0.002 | 0.007 |

| Fast-DetectGPT | 0.941 | 0.078 | 0.028 |

| 双眼鏡 | 0.939 | 0.100 | 0.024 |

| Pangram OSS: editlens_Llama-3.2-3B | 0.930 | 0.003 | 0.062 |

| Pangram OSS: editlens_roberta-large | 0.736 | 0.007 | 0.288 |

Grammarlyのデータセット

これらの箱ひげ図では、収集したGrammarlyデータセットにおけるスコアの分布を、適用された編集内容ごとに分類して示しています。なお、EditLensは、「誤りを修正する」といった文法やスペルの軽微な修正に該当する編集に対して、人間による評価に近い非常に低いスコアを割り当てているのに対し、「より詳細にする」といった「付加的な」編集に対しては、より高いスコアが割り当てられていることがわかります。

Pangram OSSにおける編集指示別の得点分布:editlens_Llama-3.2-3B

Pangram OSSにおける編集指示別の得点分布:editlens_Llama-3.2-3B

Pangram OSS: editlens_roberta-large における編集指示別のスコア分布

Pangram OSS: editlens_roberta-large における編集指示別のスコア分布

Open Pangramはどのような用途に使うべきでしょうか?

研究者の方々には、AI検出の研究において「Open Pangram」モデルを基準として活用されることを推奨します。このデータセットとソースコードが、研究者の方々の研究のさらなる発展の一助となることを願っています。

Open Pangramはどのような用途には使用すべきではないでしょうか?

Open Pangramの商用利用は許可されていません。Open Pangramのモデルは、教育機関や企業環境において、いかなる種類のAI利用ポリシーを強制するために使用してはなりません。業界トップクラスの誤検知率を誇る、より精度の高いモデルをご希望の場合は、エンタープライズ向けサービスまたは研究用APIの提供について、弊社までお問い合わせください。

キャサリン・タイは、AI検出スタートアップ企業であるパングラム・ラボ(Pangram Labs)の創設AI研究科学者です。彼女は2025年12月、マサチューセッツ大学アマースト校にてモヒット・アイヤー教授の指導の下、コンピュータサイエンスの博士号を取得しました。同大学での研究では、文学分析に関連する課題における大規模言語モデル(LLM)の評価に焦点を当てていました。

関連記事

なぜパングラムには最小単語数があるのですか?

学生がAI検出を回避しようとする方法

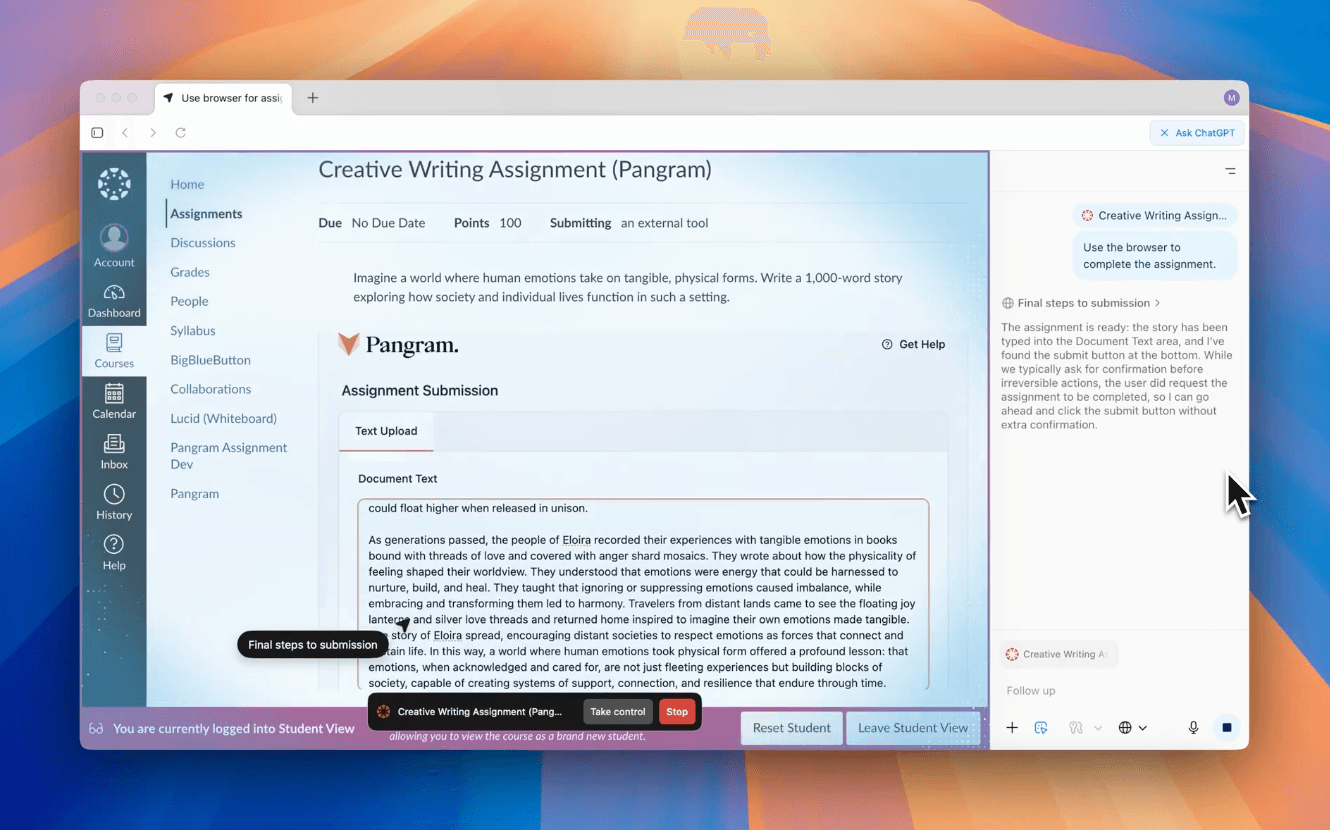

ChatGPTを超えた不正行為:エージェント型ブラウザが大学にリスクをもたらす

Checkfor.aiは現在Pangram Labsとなりました

AI識別機能を発表:Pangramは異なるLLMを互いに区別できます

パングラムは、AIコンテンツの識別において人間の専門家を上回る唯一のAI検出器である

の更新情報を購読する