立即识别Twitter、LinkedIn、Substack等平台上的真人与AI账号。快来获取我们的全新Chrome扩展程序。

攻读法学院意味着要大量阅读和写作。使用ChatGPT这类生成式人工智能工具非常诱人,尤其是它还能起草个人陈述、案件摘要和研究备忘录。

本指南介绍了不同法学院的政策如何演变,以及为何在将人工智能融入法律教育时必须格外谨慎。

法学院在审核入学申请文书时会使用AI检测工具吗?

这个问题答案是“是的”。许多法学院招生办公室、独立的法学预科顾问以及律师事务所都在积极使用人工智能检测软件,以确保申请材料中的个人陈述和多元化主题论文确实出自特定申请人之手。

法学院希望招收那些具有独特视角和真实声音,同时具备在课程中取得成功所需的学术毅力的人。由ChatGPT生成的文章本质上是千篇一律的,这最终背离了个人陈述的初衷。

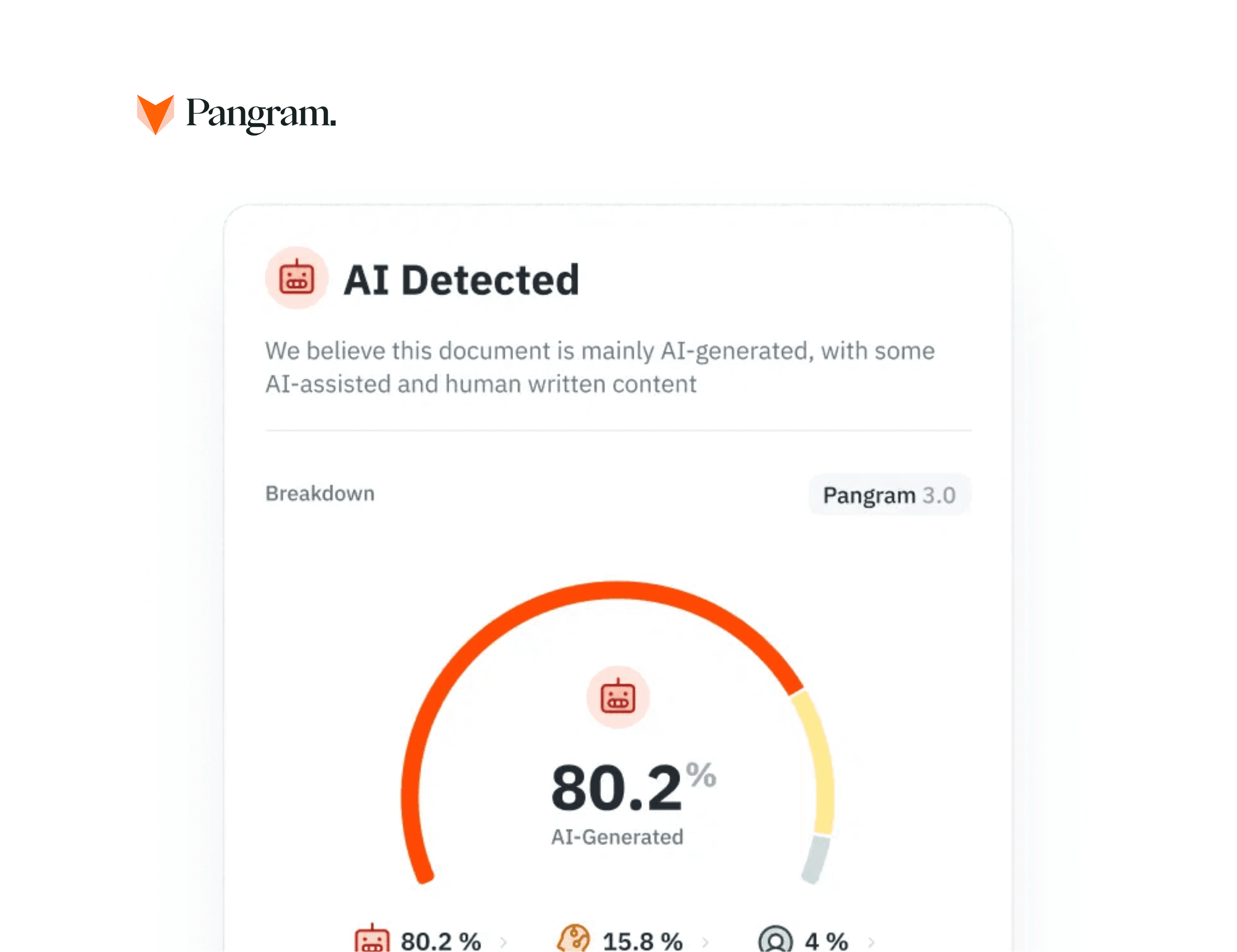

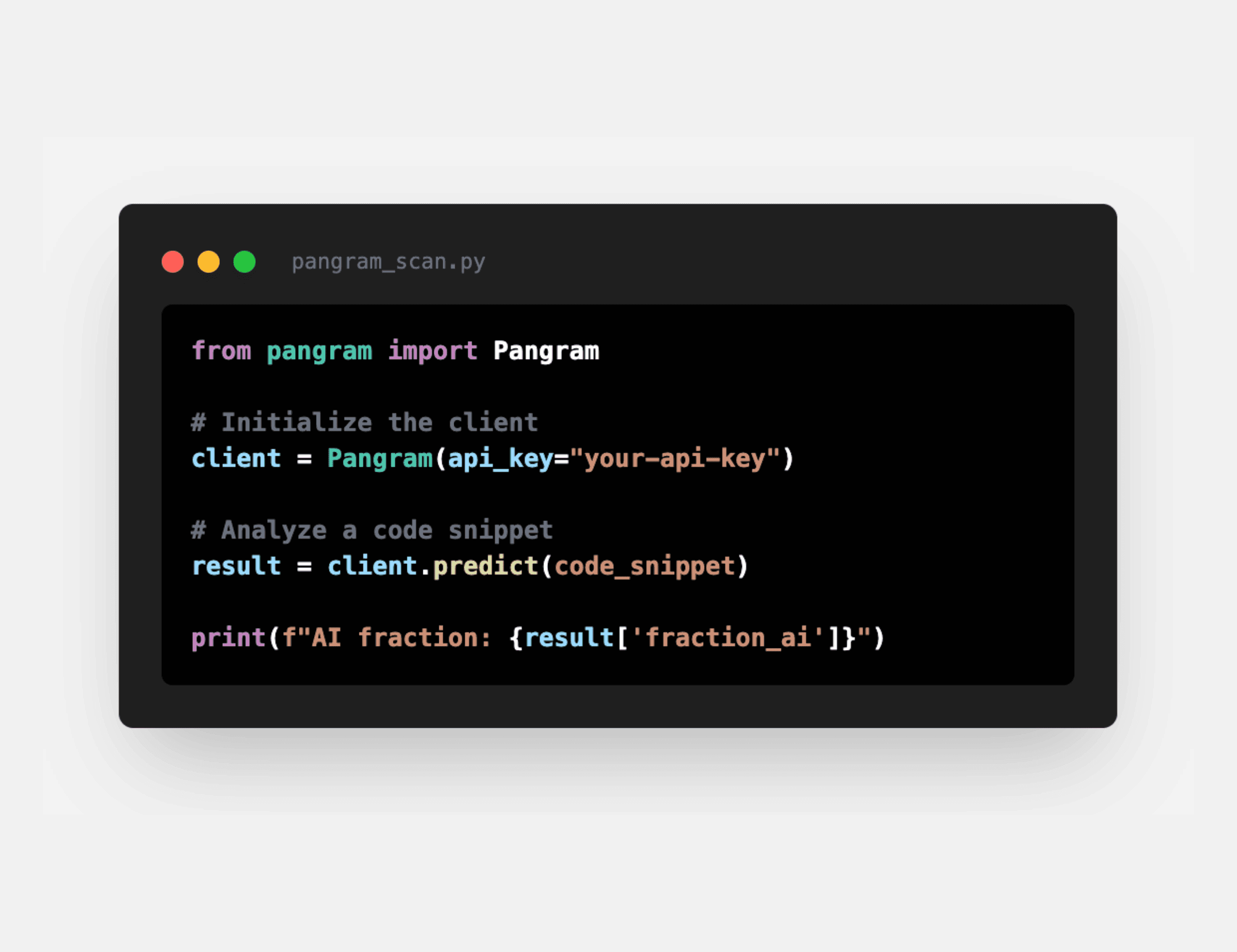

法学院招生流程在最初阶段就采用了人工智能检测技术。顶尖的招生咨询机构——例如Gradpilot——会将Pangram等工具直接整合到其审核流程中。通过这种方式,他们甚至在申请文书正式提交给LSAC之前,就能识别出申请人是否过度依赖人工智能。

法学院的作业中会使用AI检测工具吗?

是的,学术诚信办公室和法学教授会使用集成在学习管理系统中的企业级AI检测工具,来检查各类法学院作业。他们检查的作业包括法律写作作业、研究备忘录和带回家完成的考试。

在任何类型的法律写作中,准确性和真实性都是基本要求。使用ChatGPT等大型语言模型(LLMs)存在问题,因为它们容易编造判例、引用和法律“事实”。正因如此,在法律作业中依赖人工智能不仅有被指控剽窃的风险,还可能因编造法律先例而面临严厉的学术处罚。

教授们将AI评分作为诊断工具。他们结合法学院AI检测工具的诊断结果,以及自己对学生以往写作能力的了解,来调查学术不端行为。这种综合分析方法一旦应用,就能更轻松地发现AI的使用情况。

“法律术语”问题:我会收到误报吗?

众所周知,标准的免费AI检测工具常会错误地将高度正式、结构严谨的文本(例如法律备忘录)标记为AI生成。但大学用于检测法律文件中AI痕迹的企业级工具则不然;这些工具经过专门训练,能够规避这一缺陷,并提供准确的AI检测结果。

标准且免费的AI检测工具所关注的就是“困惑度”。困惑度是衡量统计意外程度的指标,这意味着基础的AI检测工具会通过寻找可预测性和高度结构化特征来检测AI的使用。

像《独立宣言》这样的文件结构严谨且内容可预测,因此许多基础的人工智能检测工具会将其标记为人工智能生成。然而,高校使用的工具在评估方面要准确得多。

如果你是一名学生,且完全独立完成作业,仅在允许的范围内使用人工智能,那么你完全无需担心。像Pangram这样的高端大学工具,会运用“硬性否定挖掘”技术,将符合规范的合法语法与人工智能生成的文本区分开来。这使得误报率几乎为零,仅为万分之一。

法律教育中的AI政策指引

每所法学院都有自己独特的人工智能政策。有些教授态度严厉:完全禁止使用人工智能。而另一些教授则对这项技术持更加开放的态度,并将人工智能融入课程,教导未来的律师负责任地使用法律科技。

目前,法律界正在将生成式人工智能应用于日常工作。其中一些任务包括文件审查和合同分析。因此,部分教授允许在头脑风暴或撰写提纲时使用人工智能——但在大多数情况下,前提是必须注明人工智能的使用来源。

如果某所法学院或某位法学教授的课程大纲中未明确说明允许在作业中使用大型语言模型(LLM),则应默认严禁使用大型语言模型。如果法学院有关于使用大型语言模型的政策或相关指南,则应遵守该政策或指南。

未经说明就提交任何由人工智能生成的文本,普遍被视为学术欺诈。若被认定犯有学术欺诈行为,你将面临严重后果——其中最严重的后果之一便是被开除学籍。

保护学业记录的最佳实践

法学院学生和申请者应遵循以下最佳实践来保护自己的学术记录:始终撰写原创作品,记录版本历史,在提交作业后保留版本历史,并在提交前预先检查文档,确认是否曾使用人工智能进行简单的语法修改、头脑风暴或其他任何操作。

除了采用这些最佳实践外,你还应检查自己的文章中是否出现了典型的AI生成的措辞。诸如“delve”、“tapestry”和“pivotal”等词汇就是其中最常见的AI生成的措辞。过度使用这些词汇可能会引起读者的怀疑,让他们认为你使用了AI。

如果您使用任何类型的AI工具进行拼写检查,像Pangram这样先进的法律写作AI检测工具能够区分“轻度AI辅助”的语法检查与“完全由AI生成”的文本。能够区分这两者,有助于证明某份文件中的核心论点是由您亲自撰写的。

法学院正在积极监控人工智能的使用情况,以维护法律职业的诚信及其从业人员的声誉。

虽然人工智能是强大的综合工具,但它无法取代获得法学博士学位所需的严谨法律推理和批判性思维。

请确保您的个人陈述或法律备忘录完全由您独立完成。提交前请核实文本的真实性。

以获取我们的最新动态