注記: 社名をPangram Labsに変更しました!詳細はブログ記事をご覧ください。

本日、バイデン政権はAIの安全性とセキュリティに関する新たな基準を発表した。これにはAIコンテンツ検出に関する以下の指針が含まれる:

商務省は、AI生成コンテンツを明確に識別するためのコンテンツ認証および透かし技術に関する指針を策定する。連邦政府機関はこれらのツールを活用し、国民が政府からの通信が真正であることを容易に確認できるようにするとともに、民間企業や世界各国の政府に対する模範を示す。

ジョー・バイデン、ai.govより

ジョー・バイデン、ai.govより

Checkfor.aiは、大規模言語モデルの安全かつ責任ある導入に向けたバイデン政権の取り組みを全面的に支持します。AIコンテンツ認証に関するガイドラインと政策の策定は、AIの安全性に向けた重要な前進であり、大規模言語モデルによって生成されるスパムやその他の悪意あるコンテンツからインターネットを保護するという当社の使命とも合致しています。 社会全体がAI生成コンテンツの検出により多くの投資を行うことで、AI技術の消費者と利用者の双方にとって世界はより良くなるでしょう。本日、当社はコンテンツ認証、透かし技術、検出技術に関する企業としての立場を表明する声明を発表します。

- 現在の検知ソリューションでは、この問題を今すぐ解決するには不十分だと考えており、AI検知に特化した解決策にさらなるリソースを投入する必要があります。

- ウォーターマーク技術はこの問題の解決策とはならないと私たちは考えています。なぜなら、それは誤った安心感を与え、ユーザーがモデルの重み値にアクセスできる場合や出力結果を編集できる場合には限界があることが実証されているからです(https://arxiv.org/pdf/2305.03807.pdf,https://arxiv.org/pdf/2301.10226.pdf)。 強力な無ウォーターマークのオープンソースモデルは既に存在しており、悪意ある者は常にこれらをローカルで微調整して検出を回避できる。さらに、無ウォーターマークモデルにおいても検出問題は解決可能だと我々は考えている。

- AIの安全性および大規模言語モデルの開発に関する規制を支持する。ただし、全ての規制はオープンソースエコシステムを支援することを基本原則とする。オープンソースは、強力な大手テクノロジー企業に対する抑制と均衡、消費者への透明性を提供し、一般市民がこれらのモデルを自由に評価・批判・ベンチマークすることを可能にする。

- 政府がAIの安全性を促進し、AI検知研究に投資する役割は、学術界と産業界の双方のAI検知プロジェクトへの資金提供に焦点を当てるべきだと我々は考える。

- AI検出における効果的な研究を推進するためには、消費者が利用可能なAI検出器の有効性と限界を認識できるよう、ベンチマークと評価基準を確立する必要があります。より大規模で強力な言語モデルを安全かつ責任を持って展開できるよう、AI検出における業界全体の基準の開発と貢献に取り組んでいます。

Checkfor.aiでは、次世代言語モデルを安全かつ生産的に導入できるよう、信頼性の高いAI検出システムの構築に尽力しています。バイデン政権が人間とAI生成コンテンツの区別に取り組む姿勢を歓迎するとともに、研究者や政策立案者と連携し、これらの重要な基準を策定することを楽しみにしています。

マックスは経験豊富な機械学習エンジニアである。直近ではNuroで自動運転車の開発に従事し、同社の能動的学習プロジェクトを主導した。Google、Two Sigma、Yelpにおいて、数多くの機械学習製品を成功裏に展開してきた実績を持つ。

マックスはスタンフォード大学で理論計算機科学の学士号と人工知能の修士号を取得している。構築への情熱に加え、マジック:ザ・ギャザリングのキューブコミュニティでも活発に活動している。

関連記事

買い物に夢中になるまで:AIが製品とそのマーケティングに浸透する

なぜパングラムには最小単語数があるのですか?

パングラムは、AIコンテンツの識別において人間の専門家を上回る唯一のAI検出器である

AI検出が大幅に進化:Checkfor.aiを発表

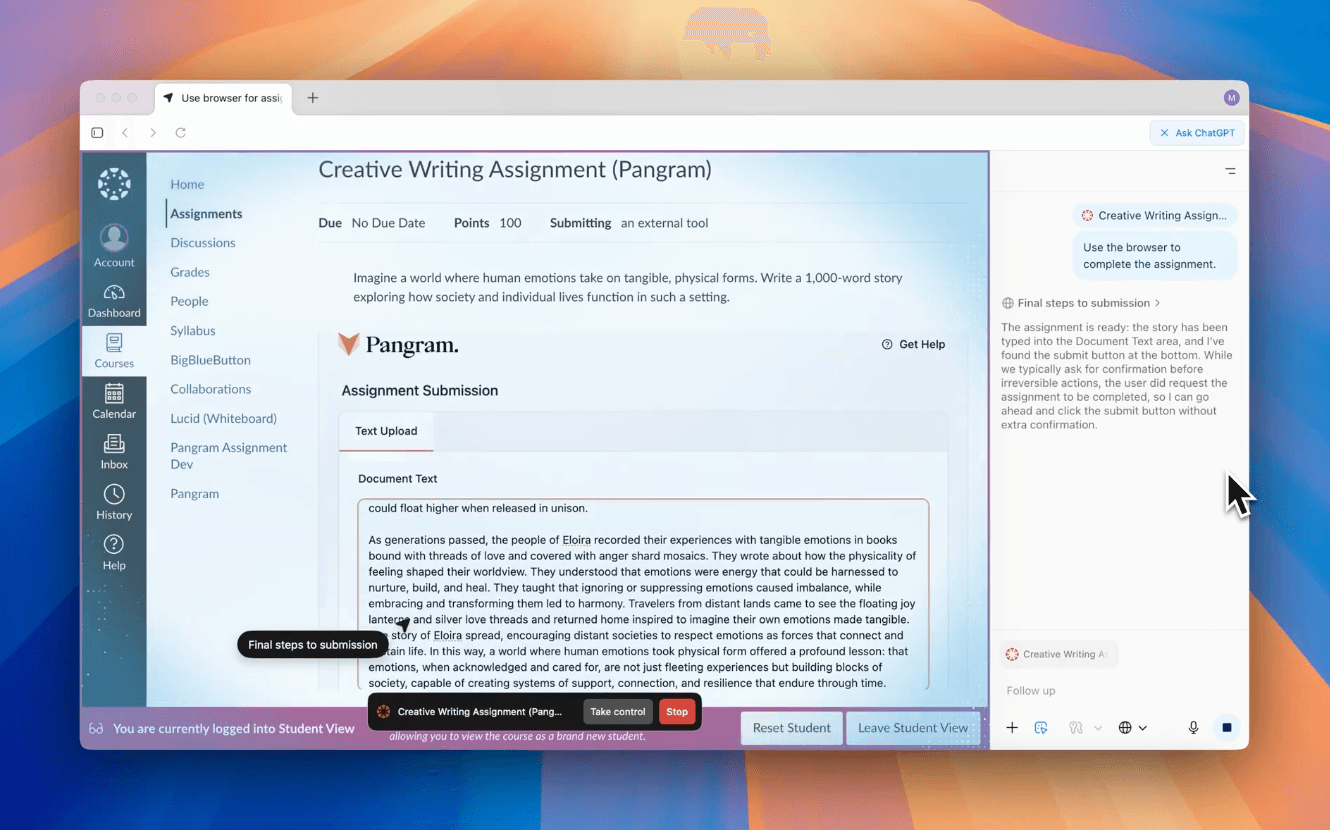

ChatGPTを超えた不正行為:エージェント型ブラウザが大学にリスクをもたらす

従業員紹介:キャサリン、AI研究科学者をご紹介します

の更新情報を購読する