照片由安吉尔·贝纳拍摄。

照片由安吉尔·贝纳拍摄。

上周,欧洲议会通过了《人工智能法案》(AI法案),该法案为欧盟成员国监管人工智能产品和服务提供了全面的框架。

《人工智能法案》旨在作为消费者安全立法,对使用人工智能的产品或服务采取"基于风险的方法"——人工智能应用的风险越高,面临的审查就越严格。风险等级被划分为不同类别,包括:

- 采用“潜意识、操纵性或欺骗性技术来扭曲行为并损害知情决策”的人工智能系统,或对“基本人权构成明显风险”的人工智能系统,将被视为“不可接受的风险”并予以禁止。

- 被视为"高风险"的人工智能系统——例如应用于关键基础设施、教育、医疗、执法、边境管理或选举领域的系统——必须遵守严格要求。

- 不属于高风险类别的通用人工智能系统将被视为有限风险,其透明度义务要求相对宽松。生成式人工智能应用将被视为通用人工智能系统。

无论是生产者(如OpenAI/谷歌)还是用户(使用这些应用程序的企业),都必须通过准确性和透明度测试,确保终端用户(消费者)知晓其正在与人工智能交互。未能遵守这些新要求的企业将面临最高3500万欧元或其全球年收入7%的罚款。

这对在线平台意味着什么?

任何企业,无论其总部设在何处,只要其产品面向欧盟终端用户并运用人工智能系统,都将受《人工智能法案》约束。尽管该法案适用范围广泛且存在一定模糊性,但可以明确的是,使用或发布人工智能内容的在线平台必须遵守这些新的监管义务。

随着众多用户生成内容平台上人工智能生成内容的发布量激增,大多数在线网站(例如出版商、市场平台及社交媒体网站)很可能需要建立透明度和审核机制,包括:

- 披露平台上生成或发布的内容是否由人工智能创建。

- 设计该平台以拒绝非法的人工智能生成内容提交。

- 发布用于训练内部模型的受版权保护数据摘要。

在内容平台传播人工智能生成的内容时,必须对其进行标注,并通过标注实现检测。此要求适用于所有形式的内容——包括文本、音频、图像和视频:

提供合成音频、图像、视频或文本内容的人工智能系统(包括通用人工智能系统)的供应商,应确保人工智能系统的输出结果以机器可读格式标记,并可被识别为人工生成或经过处理的内容。

虽然我们支持欧盟推动安全人工智能系统的立法意图,但也意识到企业解读并遵守该法律可能面临困惑。这些义务似乎相当模糊,《人工智能法案》并未明确说明次级内容类型(如用户评论或留言)是否受这些要求约束,也未详细说明企业需要纳入哪些合规检查机制。

企业如何在《人工智能法案》实施前抢占先机?

好消息是,企业将有时间制定解决方案以实现合规。该法案预计将于五月正式生效,其条款将分阶段实施,其中许多透明度要求将在一年后才开始适用。

话虽如此,我们认为企业现在可以采取某些行动来预防法律的强制执行。值得注意的是,企业应着眼于发展:

- 围绕用户生成内容制定明确的指导方针和治理机制。

- 更高效的内容审核工作流程,用于识别人工智能生成的内容。

- 用于防止人工智能生成内容扩散的自动化措施。

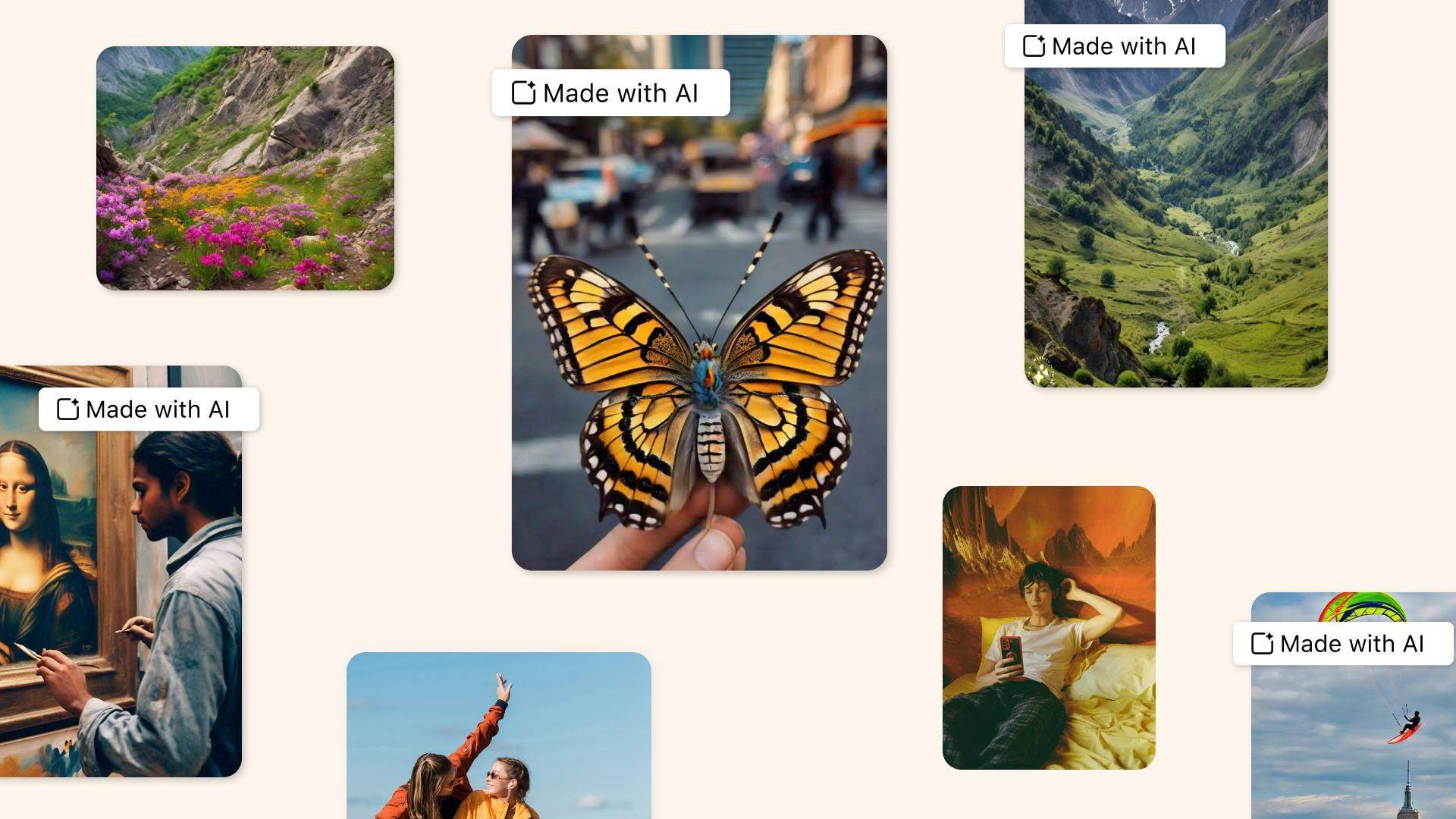

我们已看到部分企业开始采取行动——YouTube和Instagram等平台要求用户在上传"逼真"的AI生成内容时主动申报。这种"信任机制"能否满足法案要求尚不明确,但这强烈表明行业领军者正认真对待这项立法及AI安全问题。

在Pangram Labs,我们正致力于打造最顶尖的人工智能检测系统,助力企业构建安全可靠的在线平台。欧盟推动互联网透明化的目标令我们倍感鼓舞,期待与研究人员及政策制定者携手完善这些重要标准。

想联系我们吗?请发送邮件至info@pangram.com!

以获取我们的最新动态